DeepMind首席科学家斯坦福“认罪”SValley

最近,一个斯坦福大学的讲座在AI圈子里悄悄流传,但奇怪的是,转发它的人几乎全是搞研究的——普通网友基本没人知道这件事。

讲座的主角叫 Denny Zhou,Google DeepMind的首席科学家兼研究总监。他在斯坦福大学最热门的AI课程CS25上做了一场讲座,主题是:LLM推理的本质到底是什么?

没有PPE,没有营销话术,没有"AI改变世界"的煽情。这个男人站在斯坦福的讲台上,用平静的语气,把你每天在用的ChatGPT、Gemini、Claude背后那套"让AI变聪明"的技术,从头到尾拆了个干净。

💣 拆完之后你会发现:那些让你瞠目结舌的AI推理能力,核心逻辑早在2017年就被发现了。而且,原理简单到你看完会有点生气。

我把这场讲座完整看了一遍,整理出了里面最猛、最值得普通人知道的那些内容。

放心,不需要你有任何技术背景,我会用人话讲完。

先认识一下这个男人:Denny Zhou,现任 Google DeepMind Research Scientist,曾任Google Brain Reasoning Team创始人和负责人,是当今大语言模型(LLM)推理领域最具影响力的核心人物之一。他被业界誉为“思维链之父”之一,其工作深刻塑造了ChatGPT、Gemini等前沿AI系统的推理能力。

Denny Zhou拥有扎实的机器学习理论基础。他早期在Google从事多项基础研究,2010年代后期开始专注于大型语言模型的推理问题。2022年,他与Jason Wei等同事共同提出的Chain-of-Thought Prompting(思维链提示)论文轰动AI界。这篇工作证明:在提示中加入“一步一步思考”(Let’s think step by step),就能让大规模语言模型在数学、常识推理等复杂任务上实现质的飞跃。该方法迅速成为LLM应用的标准范式,被广泛应用于教育、编程、科学发现等领域。

随后,Denny Zhou创立并领导Google Brain的Reasoning Team(现并入DeepMind Gemini团队),系统性地推动LLM从“鹦鹉学舌”向真正“会思考”进化。他提出并实践了自洽性(Self-Consistency)、无需提示的思维链解码、强化学习微调(RL Finetuning)结合验证器(Verifier)等一系列关键技术。这些创新帮助AI在可验证任务上大幅超越传统监督微调(SFT),并为o1等新一代推理模型提供了重要理论基础。

说白了:你现在跟AI对话时,AI能"一步步思考"而不是瞎猜,很大程度上得感谢这个人。

然而他本人在讲台上的气质,不像一个坐拥数十亿美元研究成果的科学家,更像一个已经看透一切、只想把真相说清楚的大学老师。

然后他就说了很多"真相"。

第一个真相:AI的"推理",没你想的那么玄

很多人以为AI的推理能力是某种神秘的涌现,是几百亿参数自发产生的高级智能。

Denny Zhou在斯坦福的第一张PPT就给你泼了冷水——

"LLM的推理,本质上只是:在给出最终答案之前,先生成一系列中间token(词元)。它跟不跟人类的思维方式一样,根本不重要。"

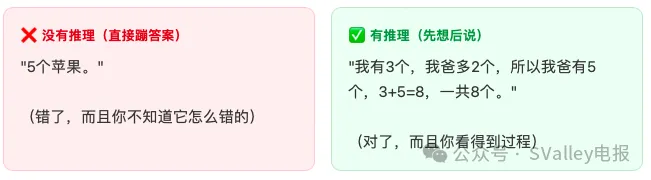

听起来很抽象?我们来翻译成人话。

你问AI:"我有3个苹果,我爸比我多2个,我们一共有几个苹果?"

那串"我爸有5个,3+5=8",就是中间token,就是所谓的"推理"。

所以你现在明白了——AI的"思考",从技术角度看,就是"多说了几步话"。

更让人意外的是,Denny Zhou说:这件事,早在2017年就有人用论文证明了。

2017年,一篇叫《Program Induction by Rationale Generation》的论文,第一次用自然语言描述中间推理步骤。那时候,大家连GPT都不知道是什么。

💡 所以,当你2024年看到Gemini、DeepSeek在"一步步推理"时感到惊艳的那一刻——那个底层逻辑,其实是个快8岁的老技术。

第二个真相:AI原本就会推理,只是你不知道怎么"打开"它

这是整场讲座里最反直觉、也是最炸裂的一个观点。

长期以来,AI研究界有一个"公认常识":预训练好的大语言模型,不经过额外的微调或提示工程,是没有推理能力的。

Denny Zhou在PPT上打出这句话,然后在旁边打了四个大字:

"这是错的。预训练的大模型已经具备推理能力,我们需要的,只是解码方式。"

解码是啥意思?

通常AI回答问题用的是"贪婪解码"——就是每次选概率最高的那个词。快,但不一定对。

他的团队发现:如果你不用贪婪解码,而是让AI多生成几个候选答案,然后再看哪个答案的置信度最高——那些有中间推理步骤的答案,置信度会远高于直接蹦出结论的答案。

换句话说:AI其实"知道"自己在胡说,当它只给出结论时,它自己的置信度也很低;当它一步步推理时,它的置信度反而高很多。

这就是 Chain-of-Thought Decoding(思维链解码):

① 让AI多生成几个候选回答,而不是只生成一个

② 挑那个对最终答案"最有把握"的回答

③ 那个最有把握的,往往就是有推理步骤的那个

注意:这里完全不需要额外训练模型,也不需要给AI任何特殊提示——模型本来就有这个能力,只是需要用对方式"打开"。

🤯 这意味着什么?意味着很多人花大钱做的所谓"推理模型微调",有时候只是在帮模型做一件它本来就能做的事。

第三个真相:"让我们一步步来想"这句话,到底有多大魔力

2022年,Jason Wei和Denny Zhou等人发表了那篇著名的CoT论文——《思维链提示在大语言模型中激发推理》。

核心发现:只要在问题后面加上一些"示范推理步骤",或者哪怕只是加上"Let's think step by step"(让我们一步步来思考)这句话,AI的数学和逻辑推理能力就会大幅提升。

这篇论文被引用了几万次。它直接影响了ChatGPT、Gemini、Claude的训练方式,也是今天所有"推理模型"的技术起点。

但Denny Zhou自己在讲台上说——

"提示词方法(Prompting)其实挺奇怪的。你去问一个真实的人一个问题,难道你会先给他看几道例题,然后最后加一句'请一步步思考'吗?当然不会!"

所以他们在意识到提示词方法的局限之后,转向了更本质的方向:把推理能力"烧进"模型本身,而不是靠每次提示词来"唤醒"它。

这就引出了下一个话题。

第四个真相:为什么人类写的答案,不如让AI自己"卷"

训练AI推理能力,最直觉的方法是:找人类专家,让他们一步步手写推理过程,然后拿这些数据来训练模型——这叫 SFT(监督微调)。

听起来很合理,对吧?找最聪明的人,让他们展示最好的推理,让AI学。

但Denny Zhou说,这方法有个致命问题:

"SFT的泛化能力很差,而且扩大规模帮助不大。人类的推理方式,不一定适合模型的'思维方式'。"

更粗暴的类比:就像你让迈克尔·乔丹手把手教一个AI学打篮球,但AI的"身体结构"跟人类完全不同,乔丹那套动作对AI来说可能根本不是最优解。

答案是 RL微调(强化学习微调),核心逻辑是:

🔁 第一步:让模型自己生成解题步骤

✅ 第二步:只保留那些最终答案正确的步骤

📈 第三步:拿这些"模型自己悟出来的正确方法"来训练模型

🔁 不断重复,让模型越来越会推理

说白了就是:别让人类教AI怎么想,让AI自己摸索出最适合自己的思考方式。

这个方法被Google DeepMind、OpenAI、DeepSeek等几乎所有顶级实验室独立"发现",并成为了今天o1、o3、Gemini Thinking等"推理模型"的核心训练方法。

第五个真相:整个AI推理领域,真正最重要的不是算法,而是"验证器"

这里有一句话,是我觉得整场讲座最被低估的爆炸性观点。

Denny Zhou在讲到RL微调时说:

"在强化学习微调中,最关键的不是RL算法本身,而是验证器(Verifier)——一个可靠的验证器,比任何RL算法都重要。"

然后他引用了一句话,出自AI领域的老祖宗之一,Rich Sutton,时间是——2001年:

你没看错,2001年。