千问AI眼镜这操作真把我看愣了量子位

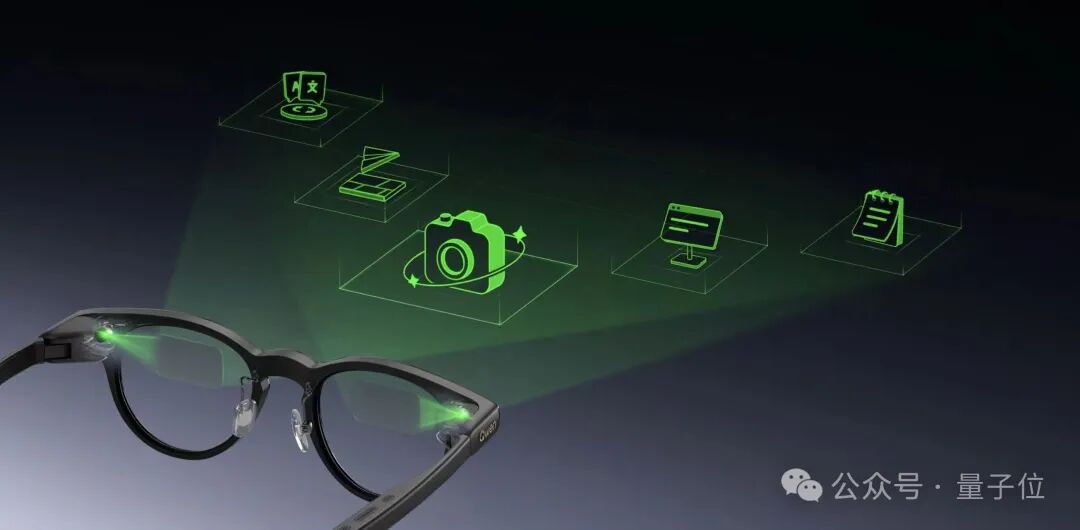

就在刚刚,闷声干大事儿的千问又给 AI 眼镜 S1 来了一波「大升级」——

不仅新增了能够智能提醒大家伙出门带伞、适时抬头放松活动的主动服务能力。

而且本月还将上线打车、闪购、拍题答疑等一箩筐的生活 AI 能力,直接一口气把智能体验铺到 N 个日常高频场景里。

这还没完,因为嘛,S1 这次带来的还有行业首创的空间 3D 显示。

通过增加眼镜信息展示的纵深感,让导航提示、信息卡片、内容展示这些信息也能「平面变 3D」了~

咱就是说,AI 眼镜拼到底,还得是大模型能力。(doge)

能主动服务,能打车闪购,显示还来了波大升级,千问这波操作,是真冲着大家的生活痛点来的啊!?

让 AI 眼镜主动替人服务,做 AI 能力真正「抗大」的 AI 眼镜

都 2026 了,大家都有相同的感受,那就是 AI 眼镜能做的事儿确实越来越多了……

功能点一个赛一个的炫,查看天气、定时提醒、翻译、提词、显示各种能力可以说是层出不穷。

但一个扎心的事实是,很多功能再丰富,本质上依然依赖用户主动发起,用户得先想起来用、主动唤醒、明确提出需求,这套智能链路才能真正跑起来。

但偏偏日常生活里,最容易出问题的就是这三个字:「想不起」。

一方面,在时间和精力都被分得很碎的生活中,我们大多数时间真的懒得动手或张嘴发号施令。(doge)

另一方面,像查天气、看路况这类小事,本来就很难让人第一时间想到交给一副眼镜来办。

大家沉淀的设备使用习惯,很难让我们在第一时间自然联想到:这件事也可以交给一副眼镜来完成。

△AI 生成

所以千问这次给 S1 眼镜做的一个关键升级,就是把人与 AI 眼镜的交互逻辑往前推了一步,让眼镜从等你指令变成「主动服务」。

它瞄准的,正是日常生活里那些最容易被忽略、也最容易忘记或懒得主动提需求的瞬间,让真正「有价值的协助」发生在我们开口之前 ——举个再常见不过的例子:早上出门太赶,没来得及看天气预报,结果走到半路才发现没带伞。照以前的情况,大概率只能认倒霉,要么淋着走,要么临时找地方买伞。

而千问AI眼镜的主动服务能力,则能够在我们出门前结合当天的天气、时间、位置,主动提醒今天有雨,出门时记得带伞。(马大哈本人狂喜.jpg)

工作场景里也是一样,眼镜也不再只是定时提醒,其还能结合用户佩戴状态、使用时长、低头姿态等信息,判断并提醒该抬头活动一下。

当 AI 能在你开口之前,就察觉到那些容易被忽略的小需求,AI 眼镜和用户之间的关系,也就从我问你答、被动响应变成了替你多想一步。

当然这还只是开胃菜,千问AI眼镜的主动服务能力还覆盖了更多领域,比如早间新闻播报、专属推荐歌单生成、运动轨迹记录等等~(期待.jpg)

大家也不难发现,相比过去你问我答、你说我做的被动式 AI 交互,AI 眼镜主动服务的核心变化在于 ——

真正打破了 AI 眼镜与用户之间的指令壁垒,让 AI 眼镜真正具备更强的「需求预判」能力。

对于穿戴式智能终端来说,其核心竞争力从来不是功能的多少,而是融入场景的高效性和省力性,而主动服务,正是实现这一目标的关键。

在主动服务时,千问 AI 眼镜可以通过对用户偏好、行为的记忆,结合时间地点、外部环境等需求,为用户提供主动性的提醒或服务执行。

这也意味着 AI 眼镜也开始从一个等待被调用的工具,向更懂用户、更贴近日常的智能伙伴演进,千问 AI 眼镜,这波也是摇身一变成超贴心的「生活搭子」了……

能主动服务是一方面,但对于 AI 眼镜而言,真正决定体验上限的核心还有「AI 能力」本身。

Omdia 数据显示,2025 年全球 AI 眼镜出货量已经达到 870 万台。

数字如此之惊人的背后,一个很明显的趋势是现在 AI 眼镜正在快速从小众尝鲜,走向更大规模的消费市场。

But,出货量涨得快归快,行业的快速扩张背后仍存在明显的 AI 能力上的体验短板 —— 目前市面上大多数 AI 眼镜的「AI 能力」仍然集中在翻译、识物、会议转录等基础场景里。

从大众日常生活来看,AI 眼镜要真正成为高频入口,还需要进一步接住用户「每天都会反复发生」的生活需求。

这也正是千问 AI 眼镜 S1 这次升级的另一个关键点:

基于阿里强大的应用生态,通过本月即将上线的「千问 AI 助手」一系列生活 AI 能力,让 AI 能力真正走进打车、点外卖、查店铺评分、拍题答疑、买电影票等更深度或更高频的生活场景。

其实像打车、点外卖、查评分、解题看起来都是很具体的小事,但它们有一个共同点 ——那就是发生频率高、决策链路短,在这种情况下我们当然希望越省事越好。

当一副 AI 眼镜的 AI 能力足够支撑用户日常的高频需求场景后,很多原本需要每天掏手机点来点去才能完成的小事,都可以直接通过面前这副小小的眼镜来完成,自然就是一个《大省心》。

而这,也让 AI 眼镜从一个单纯能戴在脸上的智能硬件,成为了一个真正随时在线、能帮用户处理日常任务的 AI 入口。

(千问 AI 眼镜产品名里的「AI」,体现在性能上,那是真实诚啊……)

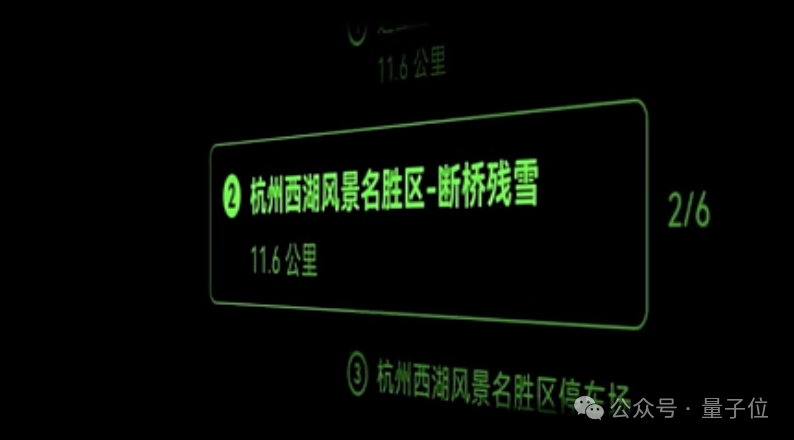

行业首创空间 3D 显示:眼镜里的信息第一次「立」起来了

这次同步升级的,还有一个看似微不足道,但事实上非常影响用户使用体验的能力 ——「行业首创空间 3D 显示」。

给大家小小科普一下,过去 AI 眼镜里的信息展示,说到底还是偏平面的。

导航、提醒、信息卡片确实都能显示出来,但很多时候更像是在视野前多盖了一层画面,功能倒有,空间感却不够。

用户确实能看得到提示,但信息一多,就容易挤在同一层视觉平面里,显得生硬,也更容易打断注意力!!

而 S1 这次升级的重点之一,就是让眼镜显示能够从「2D 变 3D」——通过首创真 3D 显示,双光机搭配双目立体成像技术,进而让信息拥有纵深、层次和距离感,这样一来无论是导航提示、信息卡片,还是内容展示,都可以更立体地出现在眼前~

事实上这背后,离不开产品研发团队对于用户需求的长期洞察。

在千问 AI 眼镜团队看来,现实世界天然是立体的,有景深感,而人的双眼天然具备双目视差,可以直接感受到立体环境的存在。

团队正是看透了人眼这套天然的视觉逻辑,顺着人类亿万年进化而来的视物习惯去做还原、去做适配。

贴合人眼本能,才让 AI 眼镜那副小小的显示屏像真实世界一样,感受到自然的景深和空间感。

当导航提示有了前后关系,信息卡片有了空间层次,内容展示有了距离感,AI 眼镜就不再只是把手机里的信息搬到眼前,而是开始形成一种更适合头戴设备的显示逻辑。