第一批被AI坑的游客,哭着回来了旅界

把假期全交给AI的人,栽了。

五一假期最后一天晚上,闺蜜阿宁在群里炸了个雷。

她是我认识的人里最典型的P人,假期前一天早上八点才决定去首尔,临时订机票酒店,连攻略都没做。

她说不慌,反正现在有AI。

然后,四天三夜的行程,她真的全交给了Gemini。

回来那晚,她在群里连发了二十几条语音,越说越气。

原来第一晚,Gemini推荐她去明洞一家开了七十年的参鸡汤老店,地址精确到门牌号,按照AI的描述,店里应该有一位上了年纪的阿珠妈,还真诚建议她点参鸡汤套餐配一杯五味子茶。

她打车过去,对着门牌号看了五分钟,那个位置现在是家美妆店,进店问店员,店员说这家店关了得有两年了。

第二天早上,Gemini又让她先去广藏市场吃绿豆煎饼当早餐,说吃完顺路就能逛通仁市场,她走过去之后才发现,两个市场中间隔着4公里,公交还要换乘,根本不顺路。

阿宁后来在小红书上搜了搜,发现最近三个月出境游用Gemini做攻略翻车的人不少,欧美驴友在抱怨它编日本电车时刻表,东南亚博主吐槽推荐的餐厅一半都关门了。

她猜,是不是大模型最近都在卷推理能力,Gemini顾着追赶ChatGPT和Claude,将旅游这种小活给了次要权重。

她的猜想很难证实,但故事还没完。

无独有偶,群里另一个朋友老周,五一去了贵州。

老周是J人,做攻略挺仔细的那种,全程靠某款国产AI规划黔东南六天行程。

行前,他觉得AI给他的方案看起来无可挑剔,每天从早到晚几点几分都标得明明白白,跟旅行社的产品说明书一样。

到了第二天他就发现不对劲,AI让他去看的那个苗寨,村口贴着告示,本寨已不再接待散客。

再后来,老周说AI其实连门票信息都查不明白,还不如自己去携程、点评看,可是不敢全信了。

然后,他叹了口气,表示如果你骂AI,确实立刻态度180度大转弯,总之你骂就是你对,老周感觉自己就是AI的免费纠错员。

看着群里这些聊天记录,我突然想到今年五一,在社交媒体上刷到的一些帖子,目的地不一样,剧情大同小异。

AI给我们规划的行程看上去漂亮,但等真的踩在那条路上,才发现脚下全是补丁。

为什么AI做攻略,总在这些地方掉链子?

这个问题我琢磨过很久,感觉源头在于大模型本身的知识结构。

我们今天用的所有大模型,知识都有一个截止日期,训练它的时候,工程师把过去几年互联网上的内容塞给它读,读完之后,这个模型就停在那个时间点了。

之后世界发生的所有变化,餐厅倒闭、地铁通车、景点改造、票价调整,它一概不知道。

这也是为什么阿宁的Gemini会笃定地告诉她,明洞那家参鸡汤店还在那儿,在它读到的那批数据里,这家店真的开着,照片、菜单、评分一应俱全。

AI没说错,只是停在了过去。

老周遇到的事情更微妙一点,AI能上网搜,可它搜到的网页本身就是旧的,一个景区两年前发的宣传稿,模型分辨不出今天还作不作数,会挑出来包装成一份当下攻略推给你。

可所有静态的描述,时间一久全会失效,这才是AI做旅游攻略屡屡翻车的核心原因。

但其实即便实时数据全都准确,AI还有一个更深的短板。

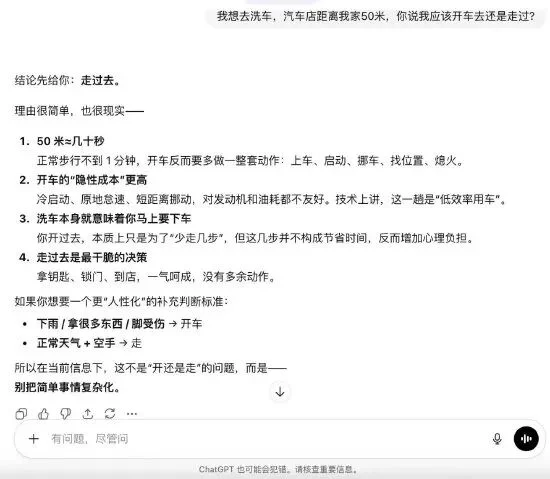

今年2月,国内社交平台上有人随手出了一道题:洗车店距离我家50米,应该开车去还是走路去?

DeepSeek、千问、豆包、ChatGPT、Claude、Grok全军覆没,集体认真分析了一通,得出的结论高度一致,走路去,节约资源、低碳环保。

人类看一眼就懂的事,这个常识AI没补上。

在AI的坐标系里,50米和走路这两个词之间的关联强度,远大于洗车和必须开车之间的物理约束。

AI做的事情,更像扫描你提问里的关键词,在自己的语料库里找哪两个词最常一起出现,然后把那个最高频的组合输出给你。

所以它推荐用户去广藏市场吃完早餐顺路逛通仁市场,因为或许在它读过的攻略里,这两个市场的名字经常出现在同一篇文章里,至于实际距离四公里、要换乘公交,那个概念就难为它了。

AI只知道推荐你去,但其实人类的心理活动千变万化,给出的提示词但凡写不清楚,AI给出的方案就会偏出十万八千里。

带娃的家庭和独自背包的P人,对同一个景点的体感完全是两回事,这种差别藏在生活的褶皱里,三言两语很难讲清。

退一步讲,就算把偏好交代得再细,AI也不会知道周日上午十一点的鼓浪屿是什么场面,更不会提醒你洱海哪段骑行路下午三点开始顶风。

这些藏在去过的人脑子里的东西,从来没被结构化地写进任何一份语料。

算力不等于智慧,信息不等于常识,讲到这里,AI做攻略真正失灵的地方,其实只剩最后一条。

它什么都敢说,但什么都不负责。