不好,CPU也要被干涨价了差评X.PIN

过去几年,老黄靠着 GPU 几乎把全世界的热钱都赚进了兜里,大家都说,搞 AI 只要显卡够多就行。

但是最近,风向偷摸摸的变了。

就看起来和显卡八杆子打不着的 CPU,都要开始涨价了。

就连前段时间各种动荡,一直成绩低迷被人看不起的英特尔,股价也是迎来了一波猛涨。

上周五股价直接暴涨 27%,突破了它们在 26 年前创下的股价历史高点。

是的,现在搞 AI,光靠 GPU 已经不够了。

CPU 实力的高低也成了不得不品的一环。

其实严格来说,CPU 从来没离开过 AI。

因为在显卡真正成为 AI 主角之前,AI 很长一段时间,都是靠 CPU 硬算出来的。

1998 年,图灵奖得主 LeCun 在一篇论文中就提到,他们当时要训练一个 CNN 模型的话,得在单个 CPU 上跑个两三天时间。

想要训练更大的模型?就得用上更多更强的 CPU。

但我们现在知道,用 CPU 来训练 AI,本质上是个非常低效的行为。

在当时大家也没钱买这么多 CPU。

这就导致了当时训练出来的 AI 都很拉。

拉到当时的一些论文审稿人,看到文章名字里带有“神经网络”,就会考虑直接拒稿。

于是,大家为了不让自己的论文被直接扔进垃圾堆,不得不给神经网络起个花名,来蒙混过关。

但是很快,大家发现神经网络真正的 CP,其实是 GPU。

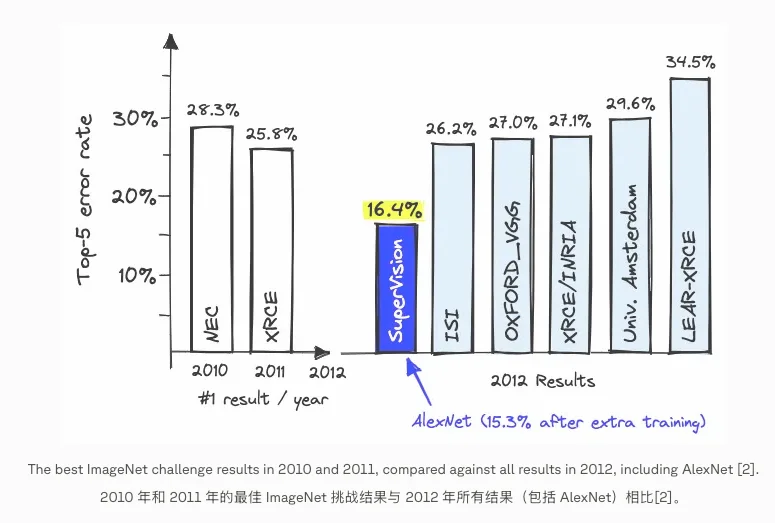

2012 年的 ImageNet 大赛上,图灵奖得主 Hinton 带领的小队打出了遥遥领先的战绩。

用两张电脑城里买到的 GTX580 显卡,把图像识别的准确率给直接提升了十个百分点。

也就是从这一天起,路边一条的神经网络直接起飞。

AI 成了新时代的黄金,而 GPU 成了那个能挖掘金矿的铲子。

老黄也穿着他的标志性皮衣,通过卖铲子,一路把英伟达的市值干到了世界第一。

而曾经的王者 CPU,在这场 AI 狂欢中彻底沦为了配角,只能干点杂活儿。

但就像咱们开头说的一样:风水轮流转,莫欺少年穷。

到了 2026 年的今天,大家突然发现,想要搞好 AI,光靠 GPU 已经不够了。

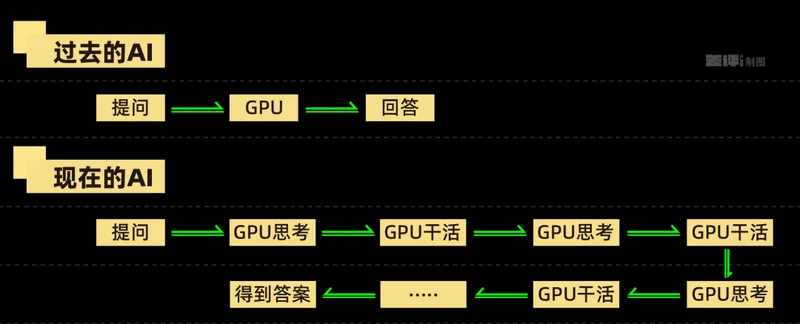

过去我们用 AI,不管是 ChatGPT 还是 DeepSeek,大家基本上都是对着一个网页唠嗑。

我们提问,然后那边的 GPU 在原地狠狠的做矩阵运算,预测下一个 Token 是什么,再把答案一段段吐出来。

这种简单的流程基本就没有什么 CPU 插手的空间了。

但是随着 Claude Code,龙虾这样的 Agent 工具越来越火,事态逐渐发生了一些变化。

AI 干活不再是简单的一问一答的互动环节。

我们把一个问题丢给 AI 后,AI 需要自己想办法把整个问题给补完。

举个例子,我们让 AI 来帮我们去买个奶龙玩偶,那 AI 最先做的,就是搞清楚,什么是奶龙?

如果不认识的话,就要去网上搜一搜看看这是啥,确认完之后,它还得去选合适的工具。

GPT-image-2做的图,示意一下

比如调用电商平台的接口,或者浏览器工具,去搜奶龙玩偶的价格、款式、店铺和销量。

最后还得把这些信息整理核实一下,判断一下哪个链接更靠谱,哪个产品的价格更合理,最后再把结果给端上来。

看完这个过程,我们会发现现在的 Agent 在干活的时候,都是先让 GPU 干点活,然后让 CPU 接力再干点活,接着再让 GPU 来干活的连环交替类型。

你要是 CPU 性能拉了,那 GPU 直接开始摆烂。

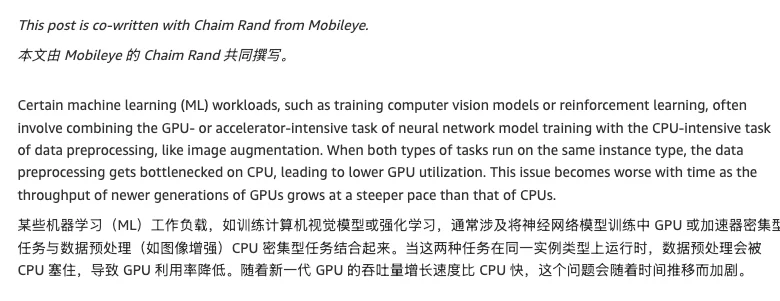

所以现在,大家为了不让 GPU 摸鱼,所以都在想方设法给数据中心里塞进更多的 CPU。

微软在建设最新的数据中心 Fairwater 的时候,就专门额外建了一栋全是 CPU 的大楼。

除此之外,大家也发现,现在想要让模型的性能变得更强,也离不开 CPU 在后面发光发热。

现在想让模型变得更聪明,光给它多塞几张显卡堆规模,很多时候已经不太够用了。

这一代模型想进步,越来越依赖 RL,也就是强化学习的功劳。