撕开Claude Code真相:让它好用的是工程不是AI新智元

当普通人还在钻研「最强提示词咒语」时,硅谷顶级实验室已经把AI基建跑成了生产线。

你还在ChatGPT的聊天框里反复调prompt?

最近,一位X用户发了条推文,开头就是一个惊呼:头部大厂偷偷在用的Claude Code项目模板外泄!

这已经不是写提示词了。这是AI工程基础设施。

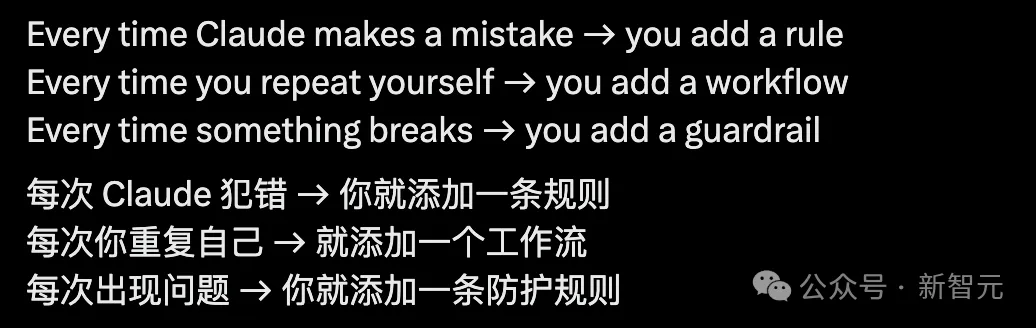

整套打法围绕一个文件「CLAUDE.md」展开,而它的核心原则只有三条:

每次Claude犯错→你加一条规则;每次你重复自己→你加一个工作流;每次出bug→你加一道护栏。

这样做,是要把项目经验沉淀成它每次启动都会读取的长期上下文和自动化约束。

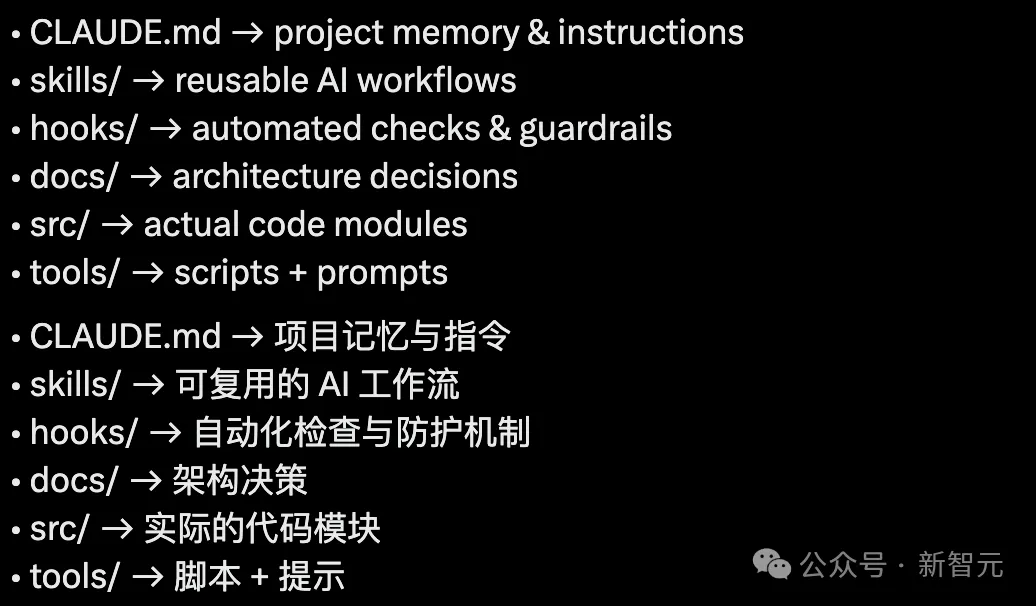

整个架构,像是一家AI公司的岗位编制:CLAUDE.md是入职手册,skills/是工作SOP,hooks/是合规部,docs/是公司章程,tools/是后勤组,src/才是真正出活的业务部门。

你不再是在和AI聊天了,而是在构建一个了解你代码仓库的AI。

最疯狂的部分是,你只需要配置一次,Claude就会自动审查代码,并按指令重构、强制执行架构规则、撰写发布说明、从技能中运行工作流、记住过去错误等。

而且它会越用越聪明。

大多数人,都是打开ChatGPT,写提示词,复制粘贴,反复;而在这套打法下,你只需要打开终端,跑一个skill代码已交付。

这等于是在自己的代码库里养了一队AI同事。

这条推文背后,传递的是这个时代正在悄悄翻篇的一个小信号,大多数人可能还没反应过来。

一张不算泄露的「泄露截图」

撕开一个真相

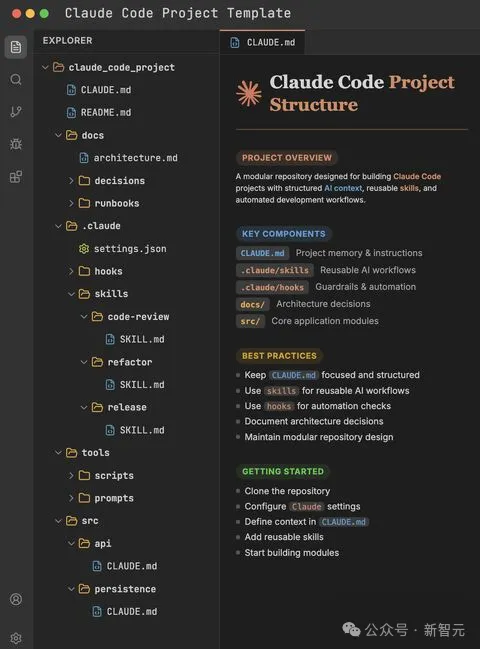

@ai_rohitt晒出来的这张截图,是Anthropic官方文档里公开推荐的Claude Code标准范式。

CLAUDE.md是Claude Code在每次会话开始时自动读取的项目记忆文件。

.claude/skills/和.claude/hooks/是官方支持的扩展机制。

这些都是社区已经讨论了几个月的公开做法,并不是什么人偷出来的「内部模板」。

但它之所以能让一些资深开发者主动转发,说明它得到了一些天天用Claude的开发者们的认同。

其中相当一部分人,可能这两天才意识到原来它还能这么用。

而硅谷顶级团队,已经把这件事跑成了生产线。

第一个例子,是OpenAI Frontier团队。

OpenAI官方披露的Frontier团队实验中,一个从空repo起步的内部beta,在约5个月内由Codex生成了约100万行代码和约1500个PR;团队从3人扩展到7人,人工不直接写代码。

带队的Ryan Lopopolo在后续访谈中进一步提到,这套工作流已经接近「0 人工代码、0 人工 review」的极限形态。

他认为与其节省token,不如利用模型极高的并发能力和极低的成本来代替人类有限且昂贵的同步注意力。

第二个例子,是Stripe内部的自动化代码代理系统Minions。

Stripe内部的Minions每周生成并推动超过1300个PR合并,这些代码从头到尾由AI生成,但仍经过人工review。

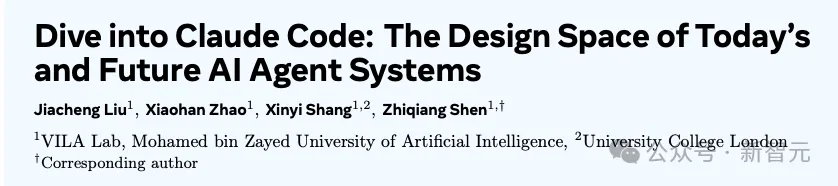

这里还有一对数据:1.6%vs98.4%,它来自Mohamed bin Zayed AI大学VILA-Lab发表的一篇论文。

研究者系统性扒了Claude Code v2.1.88版本51.2万行TypeScript源码,给出的结论是:只有1.6%是AI决策逻辑,剩下的98.4%是确定性的工程基础设施。

具体说就是权限网关、上下文管理、工具路由、错误恢复这四类。

这组数字不是说模型只贡献1.6%的能力,而是说明Claude Code作为产品,大量复杂度不在模型本身,而在权限、上下文、工具路由、恢复机制等确定性工程基础设施上。

@ai_rohitt那张图里的CLAUDE.md/skills/hooks结构,就是普通开发者也能搭一套的「入门版基建」,它和OpenAI、Stripe那套生产级架构是同一种范式,只是规模小得多。

CLAUDE.md暴露的秘密

过去3年,所有人都在问「GPT什么时候能更聪明」「Claude什么时候出新版本」。

但真正在生产环境跑通AI编程的团队,他们更关心的可能根本不是这个,而是如何让AI记住自己上次踩过的坑,怎么让AI在动手前先看一眼项目的架构约束,怎么让AI犯错的时候自己被工具挡住。

CLAUDE.md正是这一切的承载体。

Anthropic官方对它的定义只有一句:

一个markdown文件,放在项目根目录,Claude Code在每次会话开始时自动读取。

听上去很简单,围绕它展开的那几层结构,才是它真正厉害的部分。

CLAUDE.md是项目大脑。

架构决策、命名约定、测试要求、那些反复踩过的坑,都堆在这里。它是AI每次启动时第一眼看到的「员工手册」。