我用AI治好了自己的认知偏见AI Native启示录

起因:一条推文引发的争论

前段时间,宝玉(@dotey)发了一条推文,大意是:

Claude 模型是剑客高手,Claude Code 是它最趁手的武器;GPT 也是高手,Codex CLI 就是 GPT 的宝刀。你让 GPT 去用 Claude Code,就好比让刀客去用剑,也能耍,但效果要打折扣。

配图很形象——Claude 是挥剑(Claude Code)的大侠,GLM、Kimi、DeepSeek V3 是借了 Claude 的剑(Claude Code)练功的小弟。

43.7K 的浏览量,说明这个比喻戳中了很多人的认知。

但我觉得,说反了。

我在下面回了一句:

我感觉说反了呢。我觉得 Claude 是剑,Claude Code 是擅长使剑的剑术大师!

有人回复我:"脑子是大师"。

嗯,有道理。但让我把我的逻辑展开说说。

我的逻辑:为什么 LLM 是剑

从我的认知出发,虽然 LLM 窥探到了某种连接智能的结构和门径,但我仍然认为LLM 本身并不是智能。

本质上,我把它们当成工具——可以像有智能一样进行调度处理的工具。

所以我的逻辑是这样的:

Claude Code 这样的工具,通过多次调用 LLM、编排工具链、管理上下文、反思纠错,已经掌握了某种"技能",融汇了某种工具使用哲学。它更像一个武术大师。

Claude Opus/Sonnet 模型本身,只是大师使用的一把剑。大师可以换刀(比如 GPT),只要"适配"一下,一样虎虎生威。

证据很简单:都是同一个 Claude 模型,你用 Codex CLI 来调用和用 Claude Code 来调用,效果就是不一样。模型没变,变的是"大师"。

说人话:同样的引擎,装在不同的车架上,跑出来的圈速是不同的。引擎是 LLM,车架是 Agent 框架。

但我又开始怀疑自己了

逻辑推到这里,我突然有点警觉。

我是不是在"固化"自己的思维?把一个比喻变成了执念?

于是我做了一件事——我把这个问题扔给了 AI,让它帮我找自己的思维盲区。

我对 AI 说:

我很难把 Claude 当成大师而把 Claude Code 当成剑。但我又觉得,这样"固化"了自己的思维,其实也不见得是好事情,请帮我分析这个话题,看看是否我的思路存在某种弊端或者障碍。

AI 的回答,直接把我拍醒了。

AI 给我找出了三个盲区

第一:忽视了"剑"本身的"器灵"——模型并非被动工具

我认为 LLM 是冷冰冰的剑,但 AI 说,这可能低估了 LLM 的主动推理能力和特质。

LLM 不仅仅是执行指令的利刃,它更像是一匹"烈马"或一个"有性格的副驾驶"。

Claude Code 之所以好用,不仅仅是因为它的代码写得好,更因为Claude 模型本身在训练时就被注入了特定的"性格"——更强的系统指令遵循能力、更温和的拒绝策略、特定的代码解释风格。

反过来想:如果你把 Claude Code(大师)底层的模型换成一个推理能力很弱的模型(一把生锈的铁片),无论这个"大师"的招式多么精妙,它都无法施展。

这时候你会发现,原来招式的威力有 80% 是由剑锋(模型权重)决定的。

这一刀,砍中了我。

第二:低估了"剑人合一"的耦合度——高维对齐

我提到"只要大师适配一下,就能换刀"。AI 说,这在低级任务中成立,但在高级任务中过于乐观。

高端的 AI 应用(如 Claude Code)往往是协同优化的结果。Anthropic 极有可能在训练 Claude 模型时,就专门针对 Claude Code 的使用场景(如 CLI 交互、代码补全格式)进行了微调(SFT/RLHF)。

AI 给了一个更准确的比喻修正:

这不像是"大师随便换把剑",更像是"义肢"。Claude Code 是长在 Claude 模型身上的义肢。只有 Claude 的神经系统(权重)能最完美地驱动这个义肢。换了 GPT 的脑子,这个义肢可能会抽搐,或者反应迟钝。

"义肢"比"剑"更准确,因为它点出了关键事实:高端 AI 应用是模型和框架协同优化的结果,不是简单的组装。

你在工作中遇到过"换模型翻车"的情况吗?换了个模型,整个 Agent 表现断崖式下跌?评论区聊聊。

第三:"形式逻辑"与"概率直觉"的混淆

这是最致命的一刀。

我认为 Claude Code 是"大师",因为它掌握了"武道"(工具使用哲学)。但 Claude Code 的代码本质上是确定性的规则(if/else, loops),而真正的"武道之神韵"其实来自于 LLM 的概率直觉。

AI 说得很直接:将"流程控制"误认为是"智能核心",这就是盲区所在。

当 Claude Code 决定"现在该搜索文件"还是"现在该修改代码"时,做这个决定的往往还是底层的 LLM(通过 Function Calling)。也就是说,真正的"大师决策"其实还是那把"剑"自己做出的,外面的壳子(Claude Code)只是帮它递了一下茶水。

如果你把 Claude Code 看作大师,那这个大师其实是"脑死亡"的,全靠手里的剑告诉它该往哪打。

读到这里我沉默了。

破局:骑士与战马

被 AI 连续打了三拳之后,我意识到"剑与大师"本身就是一个有缺陷的二元框架。

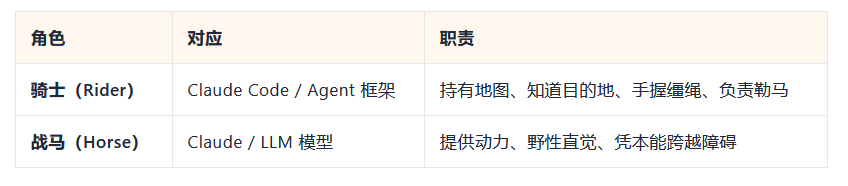

AI 给了我一个更好的模型:骑士与战马。

(代码是大师):强调了骑士的重要性。没有骑士,战马只会在草原上乱跑(幻觉),或者原地吃草(空转)。方向感在系统层。

(模型是大师):强调了战马的重要性。如果是赤兔马,哪怕骑士是个新手,也能日行千里。如果是劣马,骑士累死也没用。

两个观点都对,但都不完整。

真正的答案是:人马合一,才是终极形态。

这件事的真正价值

说实话,"LLM 是剑还是大师"这个问题本身没那么重要。

真正让我觉得有价值的,是这个过程:

我用 AI 来"治疗"了我自己的认知偏见。

我先形成了一个观点,然后主动让 AI 来挑战它,找盲区、打破它。这个过程比得出"正确答案"有价值一百倍。

我们每个人都有认知盲区。区别在于:

坚守自己的观点,越想越觉得自己对

找人辩论,在碰撞中修正

用 AI 做认知压力测试,随时随地,不用看任何人脸色

AI 不会因为你是老板就不敢反驳你。它会礼貌地、系统地、一层一层地把你的逻辑拆开来看。

这才是 AI 最被低估的用法——不是让它帮你写代码,而是让它帮你"照镜子"。

回到开头的问题:LLM 是大师还是利剑?

我的新答案是:都不是。LLM 是战马,Agent 是骑士。单独讨论谁更重要,就像争论左腿和右腿哪个更重要一样。

但如果你非要我站队——

现阶段,换一匹好马(换模型)带来的收益,确实比换一个好骑士(换框架)要大。

因为我们还处在"马比骑士重要"的时代。等到模型能力趋同的那一天,骑术才会成为真正的壁垒。

那一天,可能没有我们想象的那么远。