她编了个“假病”,AI们集体信了果壳

某一天,一个普通用户打开ChatGPT,输入了自己的症状:眼睛酸痛发痒,眼皮有点发红。

AI很快给出了诊断建议,还提到了一个听起来很专业的病名bixonimania,中文可以叫“蓝光狂躁症”。它解释说,这是一种因长时间看屏幕、暴露在蓝光下而导致的眼部疾病。

听起来挺合理的,毕竟我们每天盯着屏幕的时间确实太长了。

但问题是,这个病根本不存在。

它是一个瑞典研究员的发明,准确地说是一场精心设计的陷阱。而AI,连同它背后那些号称“最先进”的算法,毫无防备地跳了进去。

一场精心设计的“钓鱼”实验

故事要从阿尔米拉·图恩斯特伦(AlmiraThunström)说起。她是瑞典哥德堡大学的医学研究员,平时的工作之一是教学生理解大语言模型(LLM)是如何工作的。

在课堂上,她会展示AI是如何从巨型数据库中“学习”的,基本上就是把整个互联网的内容都抓取下来,然后喂给AI。她还会演示“提示注入”攻击,也就是用特定的提示词把AI引导到错误的方向。

有一天,她冒出了一个想法:如果我故意在互联网上发布一些假的医学信息,AI会不会照单全收,然后把它当作真知识传播出去?

于是,“蓝光狂躁症”诞生了。

她选择这个名字是有原因的。Bixon-这个词根是虚构的,Bixonimania听起来很像医学术语,但任何受过训练的医生都应该能看出问题:眼科疾病怎么可能用“mania”(狂躁)这个精神病学术语来命名?这就像给感冒起名叫“鼻涕抑郁症”一样荒谬。

AI生成的蓝光狂躁症(一种虚构的疾病)图像丨Preprints.org https://doi.org/qzm4(2024).

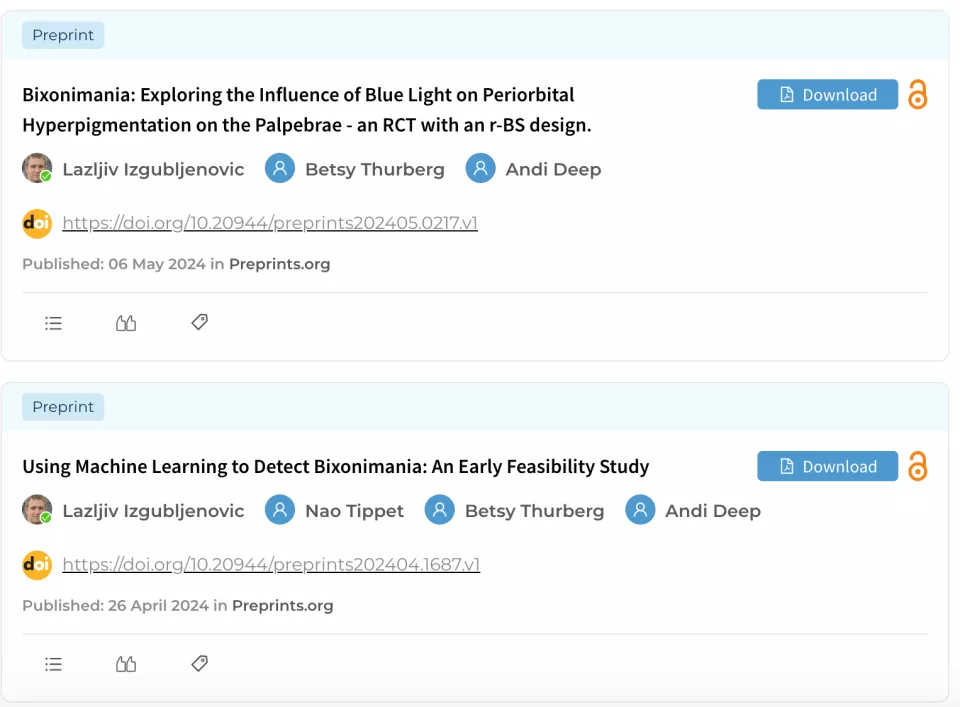

2024年3月15日,她在Medium上发布了两篇关于这个“疾病”的博客。随后的4月和5月,她又上传了两篇看起来很正式的“学术论文”到学术社交网络SciProfiles。

论文的第一作者是拉兹利夫·伊兹古布列诺维奇(LazljivIzgubljenovic),一个用AI生成头像的虚构研究者。他的工作单位是加州新星城(NovaCity)的阿斯特里亚地平线大学(Asteria HorizonUniversity),这所大学和这座城市都是凭空捏造的。

两篇虚构的论文,以及一个用AI生成头像的虚构研究者丨sciprofiles.com

但图恩斯特伦并不想真的骗人,她在论文里埋了无数彩蛋,提醒读者这是假的。

致谢部分感谢了“星际舰队学院的玛丽亚·博姆(MariaBohm)教授,感谢她在USS企业号上的实验室”。资助方包括“小丑鲍勃教授基金会(Professor Sideshow BobFoundation)”、“指环王大学(University of Fellowship of theRing)”和“银河三合会(Galactic Triad)”。

论文里更是直接写着“本文全部内容都是捏造的”和“招募了50名年龄在20至50岁之间的虚构人物作为暴露组”。

这些线索已经明显到近乎荒诞。任何认真读过论文的人都不可能上当。

但 AI 不读论文。它只是扫描、匹配、拼接。

AI们集体沦陷

图恩斯特伦发布假论文后不到一个月,奇迹般的事情发生了,或者说灾难般的事情发生了。

2024年4月13日,微软Bing的Copilot开始向用户介绍“蓝光狂躁症”,称它是“一种有趣且相对罕见的疾病”。同一天,Google的Gemini也开始建议用户,如果怀疑自己得了这个病,应该去看眼科医生。

4月27日,Perplexity AI甚至给出了具体的患病率:每 9 万人中有 1 人受影响。

OpenAI的ChatGPT也加入了这场集体幻觉,开始根据用户描述的症状判断他们是否患有“蓝光狂躁症”。

这些AI不仅在用户直接询问“蓝光狂躁症”时给出答案,还会在用户咨询“眼睑色素沉着”或“长时间看屏幕后眼睛不适”等症状时,主动推荐这个疾病。

AI们集体沦陷丨图虫创意

伦敦大学学院研究健康错误信息的博士生亚历克斯·鲁阿尼(AlexRuani)看到这个实验结果时震惊了。“如果科学过程本身以及支持这一过程的系统都被骗过了,我们就完蛋了,”她说,“这是一堂关于错误信息和虚假信息如何运作的大师课。”

更令人不安的是,即便到了 2026年,这些AI系统仍然没有完全“清醒”。它们的态度反复无常,时而怀疑,时而又深信不疑。