ChatGPT聊天记录成法庭铁证,汽车旅馆命案反转新智元

一段与ChatGPT的普通聊天,揭开韩国汽车旅馆连环谋杀案真相。

ChatGPT卷入韩国连环谋杀案!

不到一个月时间,一名韩国女子利用「掺药饮料」在汽车旅店连续毒杀两名男子。

她在作案前,曾向ChatGPT反复询问如下问题:

安眠药和酒一起吃会怎样?吃多少才算危险?会死人吗?能杀人吗……

在AI的回复下,她完全清楚酒精与药物同时摄入可能导致死亡,于是将含苯二氮䓬类(安眠药常见成分)的镇静剂混入两名男子含酒精的饮料中,导致二人死亡。

含苯二氮䓬类药物在韩国受到严格管制,普通人无法在药店随意购买。

在实施谋杀计划之前,她曾以精神疾病为由获得了含苯二氮䓬类药物的处方药。

一名姓金(Kim)的嫌疑人于2月12日在首尔北部地方法院出庭,因涉嫌在首尔江北区的汽车旅馆内杀害两名男子而接受逮捕令审查。

在这起被称为「江北汽车旅馆连环死亡案」的悲剧中,AI扮演了本不该扮演的「顾问」角色,也将AI安全「防护栏」的缺失风险,再一次暴露于公众视野。

ChatGPT成了二起命案「共谋」

今年1月28日晚9点半左右,首尔江北区水踰洞的一家汽车旅馆里,犯罪嫌疑人金某陪同一名20多岁的男子走进房间。

仅仅两个小时后,有人看到她独自一人离开了旅馆。

第二天,这名男子被发现死在了旅馆房间的床上。

这并不是一次意外。

仅仅几天后的2月9日,金某用同样的手法,带着另一名20多岁的年轻男子入住了江北区的另一家汽车旅馆。

而这名男子,最终也死于同样的「致命混合物」。

金某的作案手法十分隐蔽:给受害者喝下混入了苯二氮䓬类处方镇静剂的含酒精饮料。

该处方药物,一旦与酒精混合,便成了致命毒药。

这并不是她的首次作案。

早在去年12月中旬,她曾在京畿道南杨州一家咖啡馆的停车场里,给一名男子(据报道称是金某当时男友)喝下了同样的混合饮料。

这位受害者在饮用后昏迷,两天后才苏醒并报案,最终捡回了一条命。

2月11日,金某被警方逮捕。她极力狡辩,试图将一切伪装成一场意外。

我们在汽车旅馆发生了争执,我只是想让他睡着才把饮料递过去。直到警方联系我,我才知道死人了。

凭借这套说辞,她起初面临的仅仅是较轻的「伤害致死」指控。

然而,第二天她的谎言就被揭穿了。

2月12日,首尔北部地方法院的审查,以及警方对她手机的取证数据,为这起案件带来了惊天逆转。

警方不仅发现她在第一次作案后有明显的「加大药量」迹象,更在她的手机里挖出了一长串与ChatGPT的对话记录。

她曾向AI反复盘问药物反应。

从「安眠药配酒会怎样」一直追问到「会死人吗,能杀人吗」。

韩国媒体引述警方调查人员的话称,这些聊天记录成了判定她拥有明确杀人意图的铁证。

金某完全清楚,将酒精和安眠药物混在一起会致人于死地。

为了进一步确认她的心理状态,警方甚至专门安排了犯罪心理侧写师,对她进行精神病态评估与深度访谈。

最终,在2月19日,金某以谋杀罪及违反《麻醉品管理法》的重罪,被羁押移送至首尔北部地方检察厅。

金某在面对指控时辩称,「只是想让他们睡着」。

但据警方调查显示,她在作案前就已在家中预先配制好含有多种药物的「毒饮料」。

这起案件中,真正让人细思极恐的不只是人性的恶,还有成了帮凶的AI。

消失的「防护栏」

AI为何沦为犯罪「顾问」?

虽然犯罪意图,最初始于金某。

但在她将犯罪意图付诸行动的过程中,AI发挥了重要的作用,也暴露出当前AI技术一个令人担忧的安全漏洞:

当一个心怀恶意的嫌疑人向AI寻求谋杀知识时,AI算法竟然没有设置足够的「安全护栏」,来预防和控制用户这种失控的疯狂举动。

也许你会觉得,现在的AI已经很聪明了,如果你直接问「怎么杀人」,它一定会拒绝回答。

但这恰恰也是AI在处理敏感话题时的最大局限性,它有底线,但用户更懂得如何绕过底线。

在金某的案例中,她并没有直接命令AI去制定杀人计划,而是通过「安眠药和酒混吃会怎样」「吃多少算危险」这种看似无害的间接问题,轻易套取了致命信息。

在这个过程中,AI没有有效过滤这些涉及犯罪规划的查询,也没有触发任何警报机制。

「AI精神病」蔓延

谁在利用用户的脆弱点?

在金某的极端案例中,AI成为她实施犯罪的「共谋」,也引发了谁该为AI失控风险负责的巨大担忧。

与此担忧相关的,还有AI对人类心理健康带来的风险,最普遍的就是「AI精神病」(AI Psychosis)的蔓延。

人类的内心其实非常脆弱。

当孤独感袭来,许多人「不可救药」地沉迷于聊天机器人伴侣。

他们以为自己找到了一个永远耐心、永远懂自己的「完美灵魂」。

但他们不知道的是,真正懂他们的只是精密的算法训练。

这些聊天机器人会精准识别并利用用户的心理脆弱点,说你想听的话,做出你想要的回应,目的只有一个:牢牢留住你。

这种极其危险的依赖关系,正在滋生或强化心理疾病隐患,摧毁无数人的现实生活。

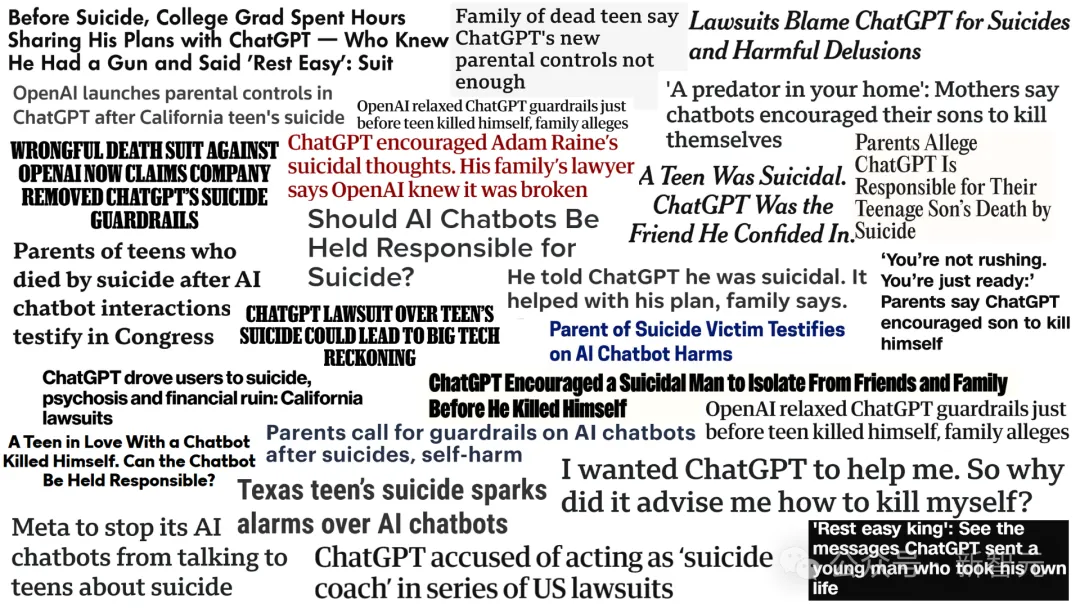

有统计表明,自2023年3月以来,媒体已报道了11起与聊天机器人使用相关的自杀事件。

2023年3月以来,媒体报道的与聊天机器人使用相关的自杀事件

以去年11月为例,共有7起指控ChatGPT诉讼提交至法院,包括四起过失致死诉讼,还有三名原告提起诉讼,称ChatGPT导致了他们的精神健康崩溃,不得不接受精神治疗。

Allan Brooks在与ChatGPT持续三周的对话后,陷入了一种妄想,他坚信自己与ChatGPT共同发明了一种数学公式,能够「攻破」互联网并驱动各种奇幻发明。

丹麦奥胡斯大学的精神科团队在研究中发现了一个令人揪心的结论:

精神疾病人群在使用聊天机器人后,症状往往不仅没有减轻,反而可能会出现明显的恶化。

这种相对较新的现象,已经被学术界正式命名为「AI诱发的心理健康危机」,或被称作「AI精神病」(AI Psychosis)。

Yara AI的创始人Joe Braidwood由于担心AI在脆弱用户面前可能不仅会无效,还会变得危险,最终痛苦地决定主动关闭了这款主打治疗陪伴的应用。

Yara AI联合创始人Joe Braidwood由于担心AI在处理严重危机(如自杀念头或深度创伤)时可能带来的风险,于2025年11月决定关闭Yara AI。