微软默认开启:你的Office被两个AI接管了新智元

微软最大的对手不是谷歌,是自己曾经的独家依赖。Copilot最新升级默认GPT写稿、Claude审稿,Anthropic的Agent骨架更被直接焊进Office。从绑定OpenAI到收编所有顶级模型,微软押注的是:无论谁赢,流量都经过我。

单模型时代,结束了。

刚刚,微软把Copilot的引擎换了,在Researcher中引入多模型智能。

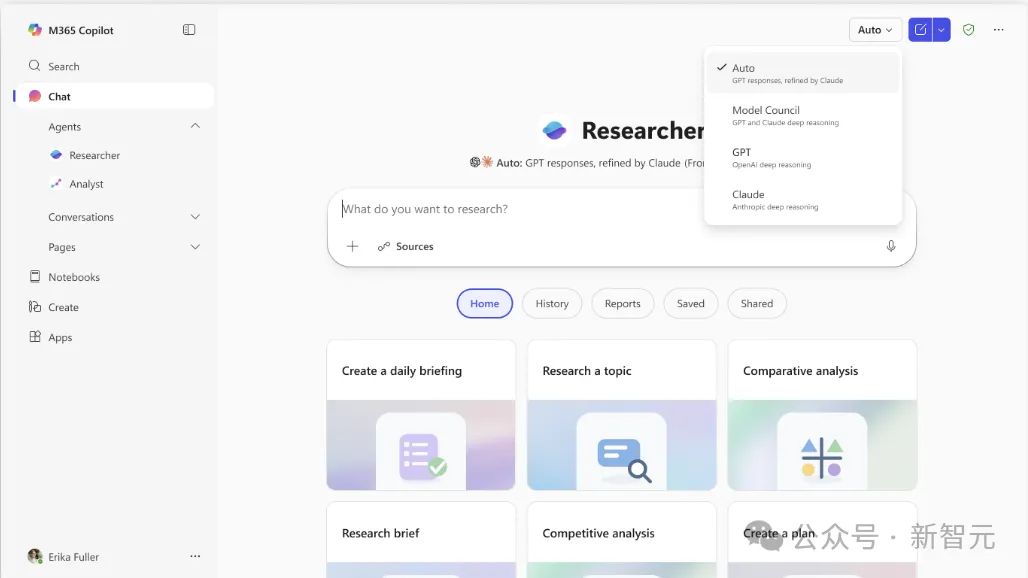

从此,Copilot的Researcher智能体,默认同时调用GPT和Claude。

这不是让你手动切模型的那种「多模型」,而是GPT写完初稿,Claude自动扮演专家评审员逐条审查,审完再交付给你。

一个负责「冲锋」,一个负责「挑刺」。

微软表示,这是Microsoft 365 Copilot深度研究代理Researcher迈出的重要一步。

Researcher专为在工作流程中处理复杂研究而设计,这次通过两项全新的多模型能力:「批判」(Critique)和「智囊团」(Council),进一步提升了准确性、深度和可信度。

实测效果惊人。

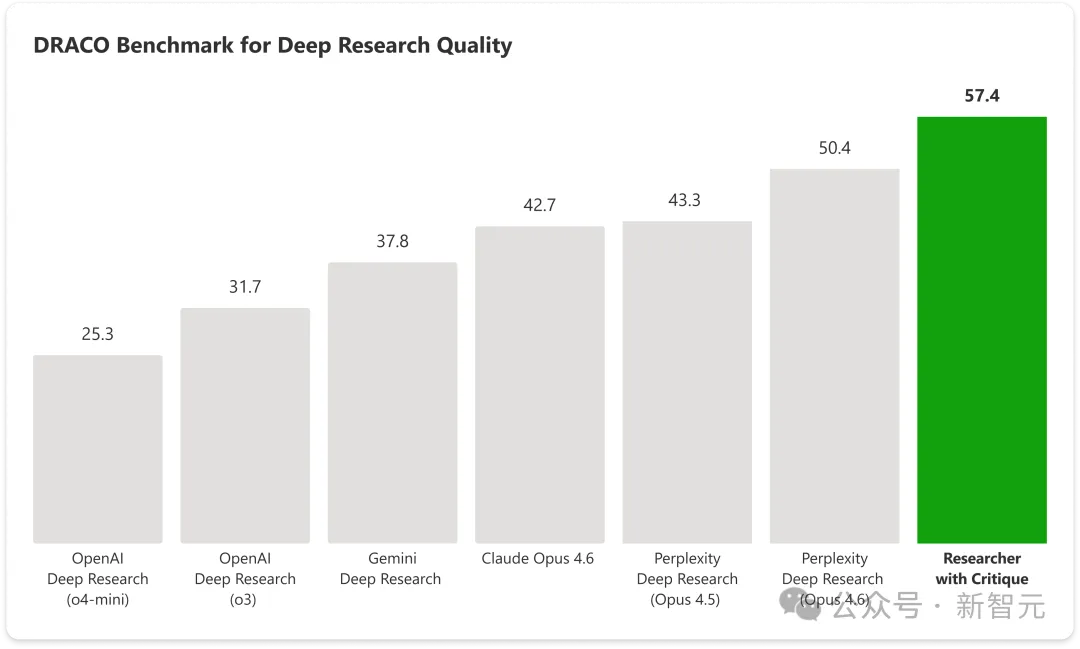

在DRACO基准测试中,这套「双模型互搏」架构综合得分比此前一直被视为深度研究天花板的Perplexity Deep Research(搭载Claude Opus 4.6)高出13.8%。

但这还不是全部。

同一天上线的Copilot Cowork,微软表示是把支撑Claude Cowork的技术平台引入了Microsoft 365 Copilot,并与Work IQ、企业权限和治理体系深度整合,让AI能自主规划、跨工具推进多步任务。

这已经不是「接了个API」那么简单,而是在把外部前沿智能体能力,纳入微软自己的工作系统。

微软的牌面已摊开:不把赌注压在单一模型上,而是把Anthropic、OpenAI等前沿模型纳入Copilot的多模型编排框架。

也就是说,Copilot正在从传统AI助手,升级成一个面向企业工作的多模型执行与编排系统。

Critique

让AI自己审自己的作业

过去的AI研究工作流有一个结构性盲区:规划、检索、综合、撰写全部压在一个模型上。

让模型既当运动员又当裁判,这样幻觉几乎是必然的。

微软这次给出的解法是:把「生成」和「评估」拆成两个独立角色。

具体到大模型,是让GPT负责上半场:任务规划、迭代检索、起草初稿;Claude负责下半场:以专家评审员的身份,基于结构化评价量表(Rubric)逐条审查。

这个量表主要聚焦三个维度:

来源可靠性评估,审查引用是否权威、可验证;

报告完整性,检查是否覆盖了用户请求的所有意图;

严格的证据溯源,要求每一个关键结论都锚定到带有精确引用的可靠来源。

更关键的是,审阅者的定位不是「第二作者」,而是「同行评审」。它不替你重写,而是逼你写得更好。

微软365和Copilot企业副总裁Nicole Herskowitz说:「我们不是简单地在Copilot里塞了多个模型,我们是让客户真正享受到模型协同工作的好处。」

未来这套机制还会升级为双向互审:GPT也能审Claude的稿。

Critique已经是Researcher的默认模式,无需手动开启。

其实,这算不上什么技术花活,而是把学术界运行了几百年的同行评审制度,第一次工程化地嵌进了AI系统。

用架构设计来压制幻觉,而不是一味指望单个模型变得更聪明。

DRACO跑分拆解

13.8%的含金量

数据不说谎。

DRACO(深度研究准确性、完整性和客观性)是由Perplexity和学术界研究人员于2026年2月推出的基准测试,覆盖10个领域、100项复杂研究任务,全部源自真实使用场景。

每个问题经过5次独立运行取均值,评估维度包括事实准确性、分析广度和深度、表达质量、引用质量四项。

评委模型是GPT-5.2。

微软特别强调,采用了与基准论文完全一致的评估协议和配置,确保「同口径」公平对比。

搭载Critique的Researcher综合得分实现了+7.0分(SEM±1.90)的显著提升,比此前表现最好的Perplexity Deep Research高出13.88%。

DRACO基准测试综合得分对比图:各深度研究系统(含Researcher with Critique、Perplexity Deep Research等)横向得分对比。其中除Researcher with Critique外,其余对比结果引自Zhong et al., arXiv:2602.11685。

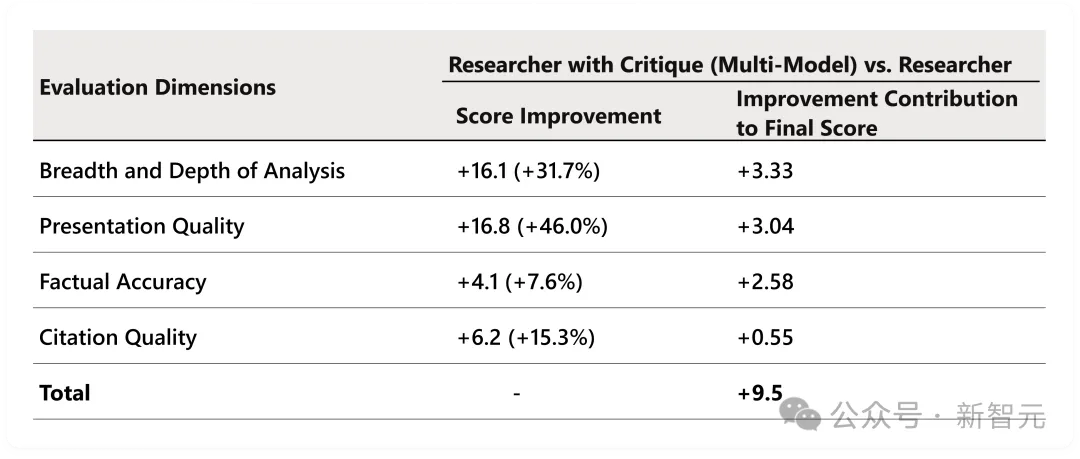

拆开四个维度看:

分析广度和深度提升最明显,+3.33。其次是表达质量+3.04,事实准确性+2.58。引用质量同样有提升。

所有维度均达到统计学显著(配对t检验,p<0.0001)。

真正值得注意的是那个+3.33。分析深度的飙升说明Critique最大的价值不是纠错,而是可以逼出更全面的分析视角。

在领域层面,10个领域中有8个观察到显著提升,覆盖医学、技术、法律等核心场景。

仅有的两个例外是「学术」和「大海捞针」,这两个领域测试结果波动较大。

DRACO基准四项评测维度提升表:Researcher with Critique(多模型)相较单模型 Researcher,在分析广度与深度、呈现质量、事实准确性和引用质量上的提升,以及各项对最终总分的贡献。

13.8%听起来是一个数字。

在深度研究这个赛道上,此前各家打得难分难解,Perplexity搭载Claude Opus 4.6好不容易爬到的天花板,现在被Critique一个架构创新直接击穿了。

当你需要的不是一个答案

而是一场辩论

Critique解决的是「怎么让一份报告更准」的问题。

但有些场景,你要的根本不是一份精修稿,而是两个专家吵一架。

而这,就是Council的定位。

在模型选择器中选「Model Council」,GPT和Claude会各自独立生成一份完整报告,并排展示。

然后,一个专门的评委模型会对两份报告进行评估,生成一份综述(Cover Letter),深入分析双方在哪些观点上达成一致、在何处存在分歧,以及各自带来的独特见解。

Council模式产品界面截图:GPT和Claude各自生成的完整报告并排展示,附评委模型生成的Cover Letter综述。

表面上看,这只是「多选一」变成了「全都看」,实质上是把决策场景中的信息盲区暴露出来。

一个模型可能忽略的事实、权重不同的分析框架、另一条推理路径……Council把这些全部摆到桌面上。

做季度战略报告的时候,你希望看到一份精修稿,还是两个专家各执己见、让你自己判断?

Critique是「编辑审稿」模式,效率优先。