只有矩阵乘法,却有「理解」:Transformer 奇迹与边界Vision Woke Flow

3/30/2026

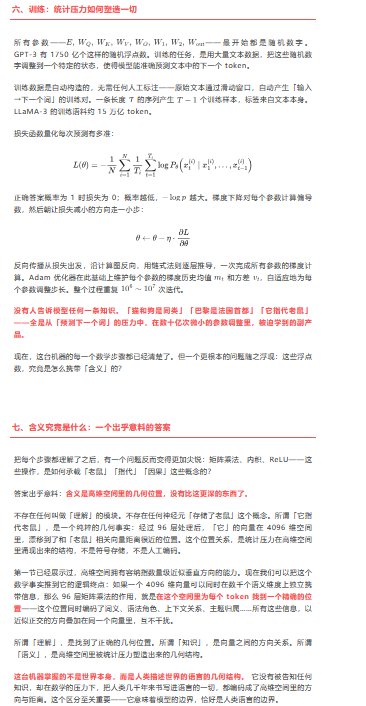

你每天用的 ChatGPT、Claude、Gemini,核心都是同一套架构——Transformer。但绝大多数使用者——包括很多开发者——从没看过其中的那些公式实际在算什么。「注意力机制让每个词关注其他词」「FFN 提取高级特征」——这些描述没有错,但停留在表面,就像说「发动机把汽油变成动力」一样,正确却无用。

这篇文章想做的是另一件事:打开那个发动机盖,从数学内部看 Transformer 在做什么。

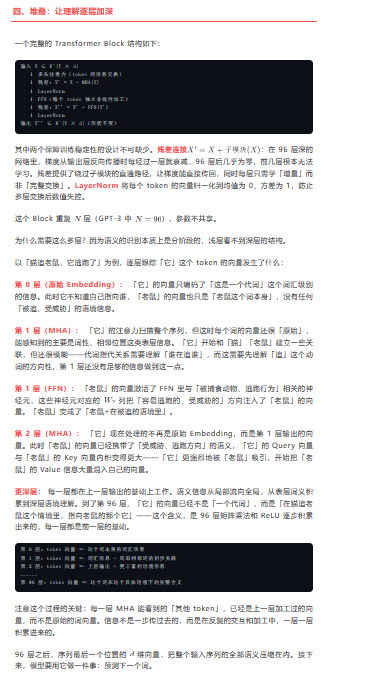

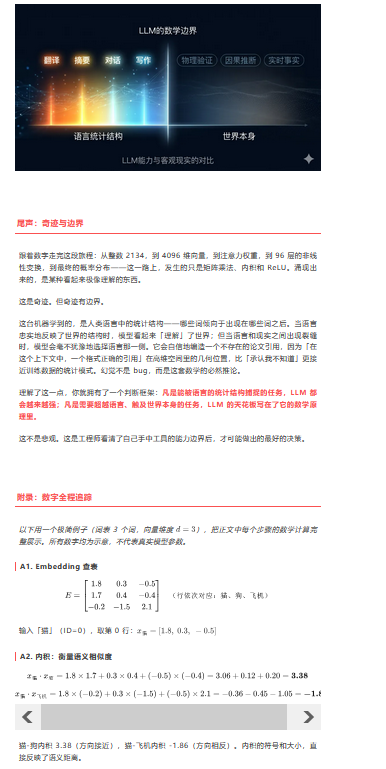

不用类比,不绕过公式。我们要跟着数字走完整个流程:一个词是怎么变成向量的,向量是怎么通过矩阵乘法感知上下文的,非线性是如何进入计算的,语义又是怎么在一层一层的运算中积累出来的。每一步都有公式,每一个公式背后都有一个具体的问题需要解决。

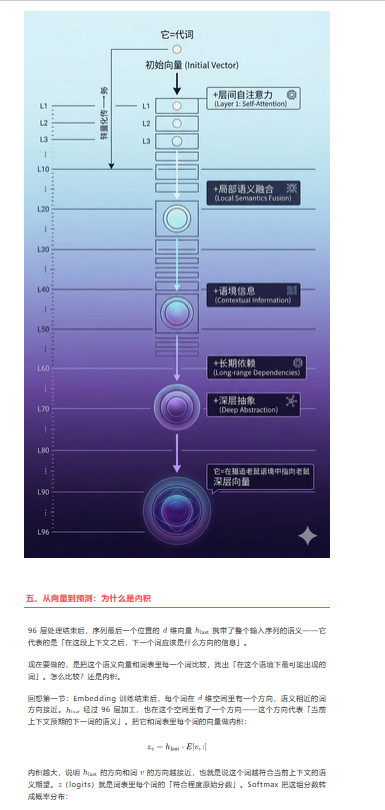

Transformer 的每一个操作,都可以写成数学公式。矩阵乘法、内积运算、ReLU 函数——没有一个操作包含「语义」「理解」「知识」这些词。但最终涌现出来的,是某种极像理解的东西。

从这个视角看进去,这件事本身就是一个奇迹——而当你看清了奇迹是怎么发生的,你也会看清它的边界在哪里。