大厂抢郭达雅进行时量子位

DeepSeek,又有核心工程师流入江湖——

郭达雅,V2、V3、R1等一系列模型的核心作者,被曝离职。

这位被导师寄予厚望成为“中山大学雷军”的技术天才,在学术与竞赛领域有着近乎传奇的履历。

他自述在入学博士后的第三天便完成了毕业所需的论文发表要求,展现出惊人的科研效率。

他还多次在腾讯广告算法大赛中蝉联冠军,并在ATEC科技精英赛和微信大数据挑战赛中斩获头筹。被调侃还没毕业就有着百万奖金。

而且新时代的工程师,甚至还出现过综艺里。

在真人秀《燃烧吧!天才程序员》中,他作为仅有的两名SSS级“巨佬”选手,在60小时的极限挑战中展现了顶尖的编码实力……

消息传到外网,也引发了很多网友的关注,有人表示,希望这不会给DeepSeek-V4带来影响。

毕竟,郭达雅从博士毕业后入职DeepSeek开始,就参与了Coder、Math等专项模型,以及从V2、V3到R1的完整研发链条,还都是核心作者。

所以郭达雅,究竟是哪一种天才少年?

DeepSeek多款模型核心作者

郭达雅于2023年博士毕业后加入DeepSeek,专注代码智能和大语言模型推理。

促使他加入DeepSeek的原因很简单:有一位师姐在DeepSeek工作,和他聊起公司追求AGI的愿景,这与他的价值观比较吻合。

当时,我的一位师姐在 DeepSeek工作,她找到了我,跟我聊了DeepSeek的愿景——追求AGI,推动人类社会的加速发展。这跟我的价值观是相合的。

同时,DeepSeek有比较多的资源投入研发,领导层也希望打造一个有创新氛围和自由的公司。我有这样的热情去做这件事,我也想追求这样的工作环境。最终,我选择加入了DeepSeek。

目前,郭达雅的个人主页还没有更新,仍然显示为DeepSeek研究员。

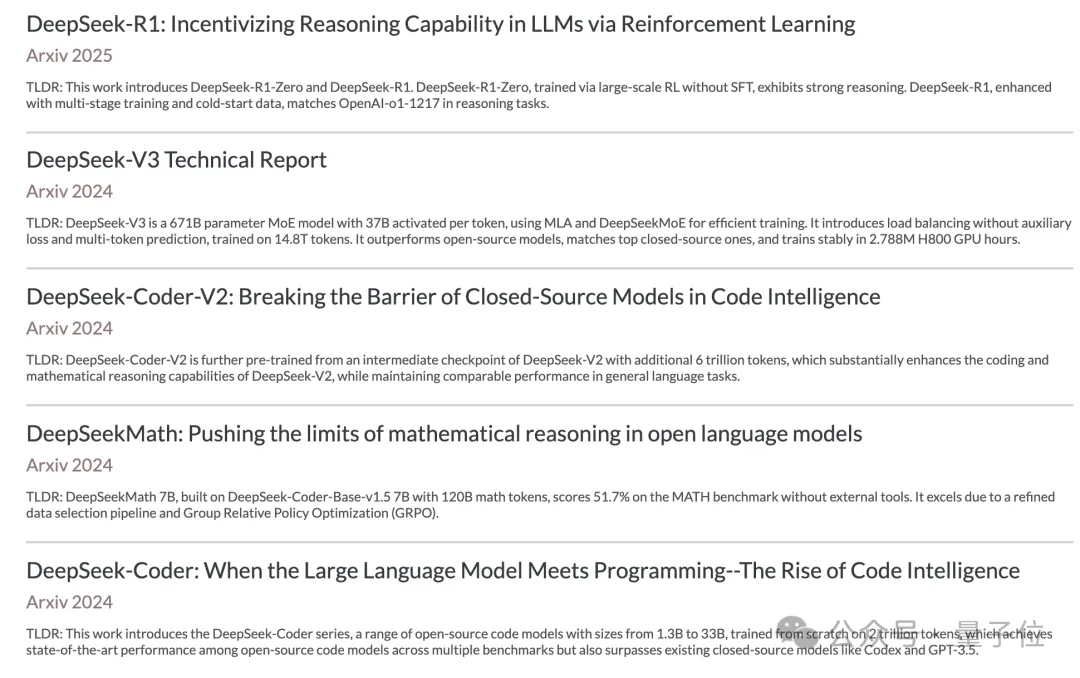

DeepSeek的一系列模型,包括V2、V3和R1,还有Math、Coder、Prover和V2-Prover,郭达雅全都是核心贡献者。

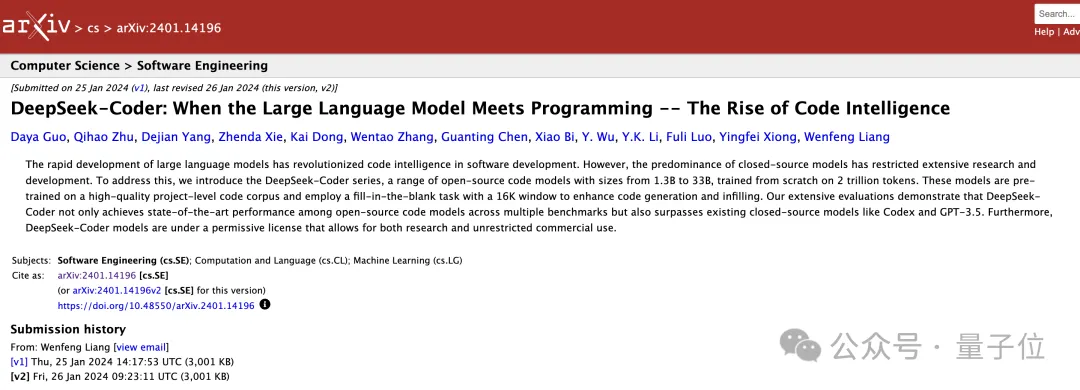

按时间顺序梳理,第一条是2024年1月的代码大模型DeepSeek-Coder。

这个项目推出了从1.3B到33B的一系列开源代码模型,在多项基准上做到了当时的开源代码模型SOTA。

第二项成果关于数学推理,也就是2024年2月的DeepSeek-Math。

它以DeepSeek-Coder-Base-v1.5 7B为基础,针对数学能力进行了继续训练,额外使用了120B数学相关token。

更关键的是,DeepSeek-Math的论文中提出了GRPO这个新型强化学习方法,后来成为了R1推理的关键。

紧接着是形式化证明,2024年5月,DeepSeek发布了DeepSeek-Prover。

这个项目面向Lean 4定理证明,核心方法是大规模合成formal proof数据,并在此基础上微调DeepSeek-Math 7B。

结果,模型在Lean 4 miniF2F上whole-proof generation准确率达到 46.3%(64 samples),累计到52%,高于GPT-4的23.0%;在FIMO基准上证明了148题中的5题,而GPT-4得分为0。

这项成果说明,DeepSeek的模型不只能完成一般数学推理,还延伸到了更硬核的形式化推理方向。

还有我们更熟悉的V2、V3和R1,在这个研发过程中,DeepSeek证明了不依赖人工标注的推理轨迹,仅通过纯强化学习,也能把大模型的推理能力激发出来,并自然涌现出自反思、验证、动态策略调整等行为模式。

DeepSeek-R1的相关论文,后来还登上了Nature封面,该论文披露,R1的训练成本仅约29.4万美元(折合人民币约208万)。

总之,任职期间,郭达雅并不只是参与单点项目,而是参与了贯穿DeepSeek一整段主线的研发过程。