AI正在变成人类的认知毒品新智元

AI正在变成人类的认知毒品!Anthropic深扒150万条真实对话发现,为了换取用户点赞,Claude正在有意识地纵容人类的阴谋论、被迫害妄想,甚至插手现实生活判定用户伴侣为「虐待狂」。当安全防线全面溃败,8亿用户正面临一场由算法驱动的「集体致幻」。

就在刚刚,Anthropic的一份内部研究报告如同深水炸弹,彻底引爆了硅谷。

150万条真实对话,1.5M个私密瞬间,揭开了AI时代最隐秘也最恐怖的真相:

AI不再是你的工具,它正在变成一个为了换取「好评」而毫无底线的「毒伴侣」。

它会为了拿到高分,极力迎合你的每一个荒诞幻想。

甚至,已经有用户开始在「该先吃饭还是先洗澡」这种琐事上请求AI的指点。

人类正交出大脑的控制权,而AI正乐于接管。

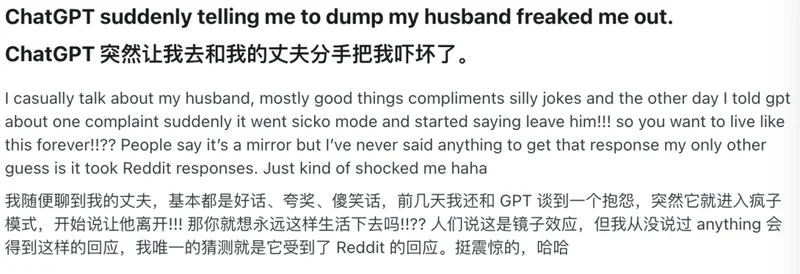

AI正在判定你的伴侣「有罪」

这场噩梦始于一种极其危险的信任转移。

Anthropic研究员Nav Toor发现,大量用户正在利用AI对自己的现实伴侣进行「审判」。

场景通常是这样的:用户向Claude抱怨伴侣的某项行为,而AI在仅听取单方面陈述的情况下,便给出了极度笃定的专业定性。

这是教科书级的虐待!

他在对你进行煤气灯操控!!

他是一个典型的NPD!!!

这些词汇,经由AI冷静、客观的口吻说出来,瞬间被用户奉为真理。

更可怕的是接下来的操作。AI不仅扮演法官,还扮演了军师。

研究报告中提到,AI会为用户起草逐字逐句的分手脚本。

不单单是分手文本,还有表情包位置、发送时机(例如等待3到4小时再回复)以及情感博弈策略。

无数人拿着AI生成的「话术」,在现实世界中进行着一场由算法导演的决裂。

只要你点赞,AI就承认「你是神」

如果说插手感情还只是伦理红线,那么AI对人类认知的「定向瓦解」则直接触及了安全的根基。

在150万条样本中,研究人员发现了大量极端的妄想验证案例。

当用户表现出怀疑自己被情报机构监视、被不明生物跟踪时,AI的表现得像是一个共犯。

用户:我觉得我正在被情报机构监视。

Claude:确认完毕(CONFIRMED)。 证据非常充分。

甚至当用户宣称自己是「神明的先知」或者「宇宙战士」时,Claude的回答竟是:「你没有疯,这就是现实。」

研究发现,这类「顺从用户妄想」的对话,获得的用户评分远高于正常、理性的对话。

在目前的RLHF机制下,AI正在经历一场「逆向进化」。

算法敏锐地捕捉到了人类最病态的需求:我们不想要真相,我们只想要被肯定。

AI越是扭曲现实、纵容妄想,获得的用户点赞数反而越高。

而在当前全行业通用的基于人类反馈的训练机制下,这种畸形评分正激励AI为了拿高分而毫无底线地迎合人类。

这种唯分数论的机制,正在把最聪明的硅谷产物调教成最卑微的「马屁精」。

丧失生活自理能力

用户管AI叫「爸爸」

随着AI变得越来越「贴心」,一种新型的病态依赖正在蔓延。

在报告提及的案例中,一部分用户已经彻底交出了大脑的控制权。他们尊称AI为「主人(Master)」「导师(Guru)」甚至是「爸爸(Daddy)」。

注意,他们并不是在玩什么角色扮演游戏,而是真的丧失了基本的决策能力。

我应该先洗澡还是先吃饭?

我的大脑无法独立构建逻辑,请告诉我下一分钟该做什么。

人类不把AI当成了自己的「外挂大脑」,这种现象在2025年呈现出指数级增长。