统计学「诺贝尔奖」颁给了一名华人量子位

2026年,统计学界的「诺贝尔奖」,颁给了一名在AI领域深度活跃的华人学者。

宾夕法尼亚大学苏炜杰教授,凭借在AI可信部署、隐私保护、凸优化理论及AI会议学术评审机制上的突破性贡献,荣获考普斯会长奖(COPSS Presidents’ Award)。

时隔14年,这一统计学最高荣誉,终于再次迎来了华人面孔。

苏教授坚信:AI时代,统计学会越来越重要。

从第一性原理出发,神经网络或许永远无法彻底白盒化。随着复杂度的不断扩大,模型的可解释性只会越来越难。

而统计学的最大魅力恰恰在于:即便内部机制永远是一团迷雾,也依然能通过概率分布的方式找到最优解,达到我们希望的目标。

基于这一判断,苏炜杰教授和团队从统计学视角切入,为AI的应用提供了更扎实的理论支撑,增强了实际落地过程中的可靠性与稳健性:

可信部署:将AI生成内容的可追溯性、人类偏好对齐等问题,形式化为严谨的统计框架;

隐私保护:提出高斯差分隐私框架,·应用在2020年美国十年一次的人口普查,提升了隐私数据的效用;

AI学术评审:提出保序机制,让作者对自己的多篇投稿进行质量排序,已于2026年正式在ICML投入使用。

也正是这些贡献,让苏教授于今年摘得考普斯奖这一统计学至高桂冠。

苏教授任教于宾夕法尼亚大学沃顿商学院统计与数据科学系,同时在本校计算机系和数学系兼任教职。在获得考普斯奖前,他还曾获美国NSF CAREER奖、斯隆研究奖等多项重量级奖项。

这一次,他来到量子位的专访,谈了谈他关于如今AI的各种思考。

为什么完全打开AI黑盒很难,有没有其他途径?

为什么大学体系在AI时代依然重要

为什么建议数学系学生积极参与AI发展?

访谈尾声,苏教授抛出了一个大胆的判断:

AI需要一门全新的数学语言。

他认为,AI正在演变成一种「新的物理」,其底层结构与经典物理截然不同。

物理学多是从小到大。从底层机制出发,推导并决定宏观行为;

而AI是从大到小。先设计好Transformer的大框架——几层网络、如何连接,再在训练中逐步确定每一个参数。

这可能正是当下AI在可解释性、神经网络泛化理论等方向滞后的根源所在:

现有的数学语言,或许从一开始就不适合描述AI。

为此,苏教授向纯数学出身的年轻人们发出了诚挚邀请:

进入AI领域,共同创造一门新的「语言」,让AI像数学一样「优美」。

这件事的意义,不会低于经典力学或相对论。

上面这些只是冰山一角。在这场一小时多的深度对谈中,苏教授分享了许多有趣的洞察:

世界上很多问题只能近似描述,终极理性可能并不存在。

偏好没有唯一的最优解,但至少要划清底线:哪些偏好我们绝对不想要?

彻底「白盒化」不太现实。人类连自己的大脑都没搞懂,理解神经网络只会更难。

像「剥洋葱」一样研究神经网络,不必完全理解内部结构,把它当做黑盒来优化就行。

把隐私变成可交易的价值,用类似博弈论里的机制设计,让其成为公司的内生动力。

对于国内想辍学做AI的大学生,如果你真的准备好了,可以勇敢点。

大学教育依然很重要,里面有老师、考试作为反馈,光靠自学很难打牢基础。

下面附上精校后的访谈实录。为提升可读性,量子位在不改变原意的前提下,对内容进行了适当的润色与梳理。

哪些AI均衡点我们绝对不想要?

量子位:恭喜获奖。这是针对您过去一系列贡献颁发的奖,如果让您自己选一篇最满意的工作,会是哪篇?

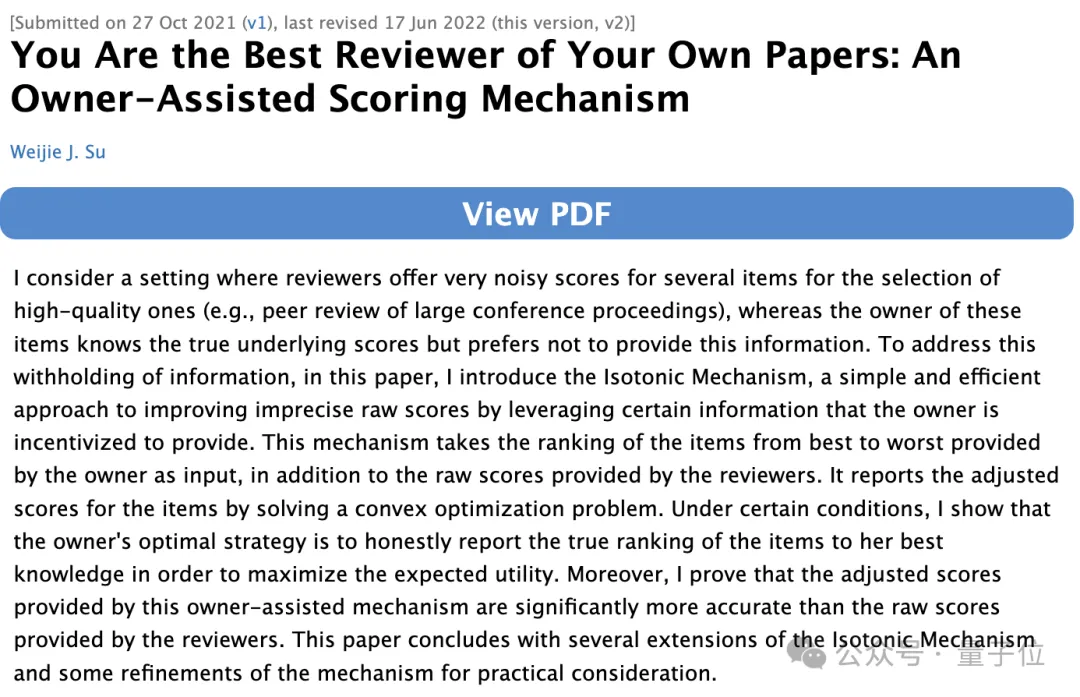

苏炜杰:最满意的不好说,但最有趣的有一篇。ICML最近有一个改动,要求作者自己对投稿论文做一个质量排序。

这个做法,其实和我五年前的一篇论文有关。核心观点大致是:既然作者往往是自己论文最好的审稿人,何不引入一种由作者本人参与的评分机制?

这篇论文的ROI很高。从有想法到写完,总共不到两周,时间主要花在语言润色和补充文献上,那还是在ChatGPT出现之前。

放在现在,可能两天就能写完。

量子位:这篇论文的核心思路涉及博弈论,和经济学相关。您在本科阶段也有经济学背景,当时怎么会对经济学感兴趣?

苏炜杰:其实最开始并不是出于兴趣。我在北大的时候主修数学,之所以修了经济学双学位,是因为当时的女朋友(即现在的妻子)选了这个项目。

她偏文科。经济学虽然属于文科,但需要高数、概率论等基础,所以她希望我也一起学,互相支持。

但后来发现,经济学让我学会一种不同于纯数学的思维方式。

学纯数学,很容易形成一种确定性的世界观:世界是完备的、有结构的,可以用精确语言描述;如果暂时无法刻画,那是我们的数学工具还不够成熟。

接触经济学之后,会意识到真实世界并不具备那样的确定性。世界是混沌的,很多问题只能做近似描述,终极理性往往不存在,或永远无法逼近。

量子位:如今的AI同样很难完全用纯数学解释清楚。您觉得经济学思维,对您现在的研究有什么影响?

苏炜杰:我的核心训练仍然是数学、统计和优化,但经济学会让你更关注「人」这个共同体。经济学研究的本质,是人的行为,以及人在制度和市场中的互动。

我们组里有一部分研究,就是从经济学视角出发,讨论AI对齐在人类社会结构中的意义。

AI未来会全方位影响人类社会。现在大家更多讨论的是个人用户怎么做agent、怎么让个人更满意,但AI对社会的影响是什么、会怎样演化,这更接近经济学研究的范畴。

AI由人类数据训练而来,会继承人类偏好。另一方面,越来越多年轻人开始用AI,这一过程中,AI的价值观也在反过来影响人类。

所以问题来了:现有算法,能不能把这些偏好完整、准确地转移到AI里?

我们希望AI对齐人类偏好。但这些偏好如何定义?如何聚合?

主流方案还是奖励模型配合强化学习,把偏好的信息结构都编码进去。不过,目前常用的一些相对简单的统计模型,没法完美表达真实的人类偏好。

我们有一项工作讨论了投票悖论:当候选项至少有三个时,群体偏好可能出现循环——A优于B、B优于C、C又优于A。

这种情况下,现有损失函数或奖励模型是有缺口的。如果这种偏差长期存在,可能会把AI的偏好推向某个不确定方向,最后收敛到一个我们不希望看到的均衡点。

量子位:那最终应该达到的均衡点在哪里?「人类偏好」至今也没有统一定义,不同国家对善恶的判断标准都不一样。

苏炜杰:的确,偏好不存在绝对客观、唯一最优的标准。

但可以确定的是:哪些偏好我们不会想看到?

我举个例子。AI领域论文审稿正在逐步滑向一个不太好的平衡点。

以前论文少、节奏慢,一个人一年审几篇,大家还是愿意花时间把审稿做好。

但现在投稿太多了、审稿人又太少。很多人觉得自己的论文被一些不认真、质量不高的审稿意见影响了,于是会想:凭什么我要认真审别人的论文?

当越来越多人都有这种想法,他们自己当审稿人时也不会认真投入,结果就是恶性循环,审稿质量越来越差。

量子位:用AI审稿会是一个好的解决方案吗?

苏炜杰:人类审稿有个常见问题:审稿人说作者「没做某件事」,但其实论文在别的段落已经写了,只是审稿人没看到。

我今年也在ICML委员会负责相关工作,根据经验和数据来看,AI在「信息抓取」类任务上往往优于人。

不过,现在很多人习惯把审稿「托管」给AI,让它直接生成审稿意见。

这里面还有个问题:市面上主流的AI就那么几个。

审稿的一个重要价值是多样性。不同审稿人从不同经验和偏好出发,能看到论文的不同面向。

如果大家都用一样的AI来审稿,意见就会千篇一律,这件事就没意义了。

幻觉的问题则更加严峻。

学术有个特点——论文是写给未来的。

每一篇论文不是写完就结束,它会存档,挂在数据库里,很多年后都还可能被引用。

所以学术对信息准确性的要求非常高。幻觉如果出现在某一篇论文里,后续被重复引用几十次,可能会被当作既定事实。这对人类知识传承是很可怕的。

实话说,今年我们已经看到不少论文明显是AI生成的,关键是其中引用的文献根本搜不到。

其他部分作者还可能辩解说:「我只是写作风格像AI。」但文献不存在这种事,是没办法辩驳的。

学术通常被认为是人类智力活动密度最高的领域之一。当这个领域都开始让人类退场,这是个非常危险的信号。

像「剥洋葱」一样优化AI黑盒

量子位:您在之前的访谈中经常提到「可解释性」和「可信部署」。这方面最近有什么研究进展吗?

苏炜杰:坦白说,我在可解释性方面直接做得不算多。有一些朋友在做机制可解释性(Mechanistic Interpretability),我非常敬佩他们的工作。

我对这个领域的前景持谨慎态度,但我希望我的判断是错的。