最新“龙虾排行榜”:谁最会干活?科技狐

过去两年,AI 圈讨论最多的一件事,其实很简单:哪个模型更聪明。

谁的推理更强,谁的考试分数更高,谁又刷新了哪个榜单。

但到了 2026 年,大家不太关心谁更聪明了,反而开始问一个更现实的问题:哪个模型更会干活?

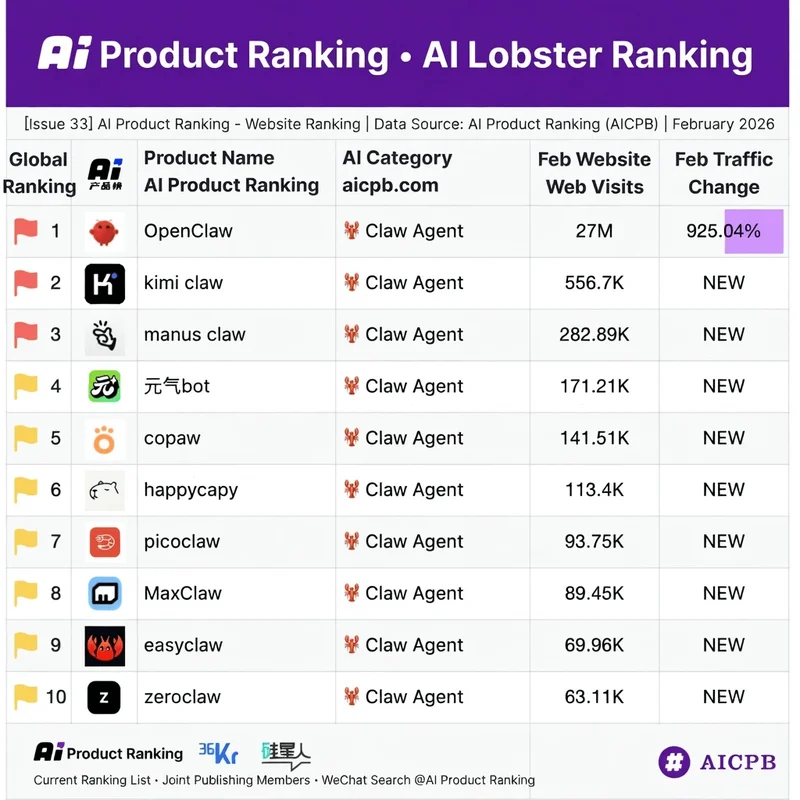

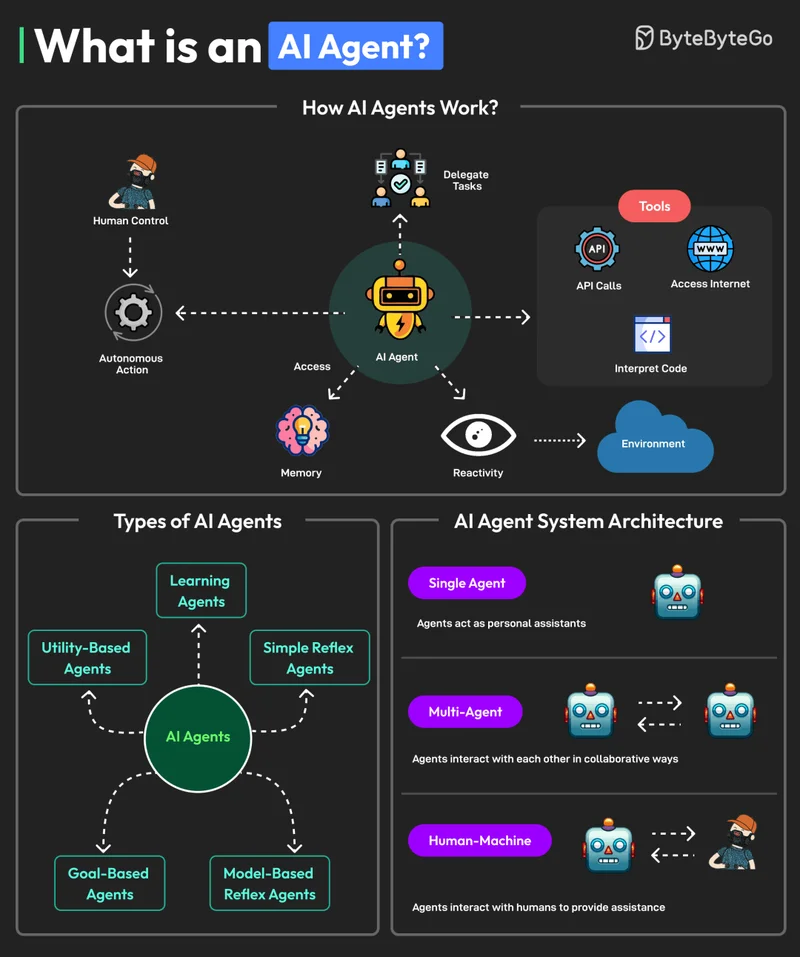

随着 OpenClaw 这类 Agent 框架开始爆火,越来越多开发者不再只是和 AI 聊天,而是让大模型真正接管任务。

写代码、查资料、处理邮件、整理文件、调用 API,甚至自己拆解复杂流程,一步一步把事情做完。

在开发者圈子里,这事还有个特别形象的说法:养龙虾。

把模型接进 Agent 框架,就像往水箱里放一只龙虾,让它自己在里面跑任务、调工具、折腾工作流,看它到底能不能把活干明白。

那到底哪款大模型,最适合拿来“养龙虾”?

最近,OpenClaw创始人 Peter Steinberger 发布了一份名为 PinchBench 的基准测试榜单。

一口气实测了 32 个主流大模型,从成功率、速度和成本三个维度做了完整对比。

这也成了目前第一份专门针对 Agent 任务的,“龙虾大模型排行榜”。

而榜单一出来,很多人第一反应都是:这排名,好像有点出乎意料。

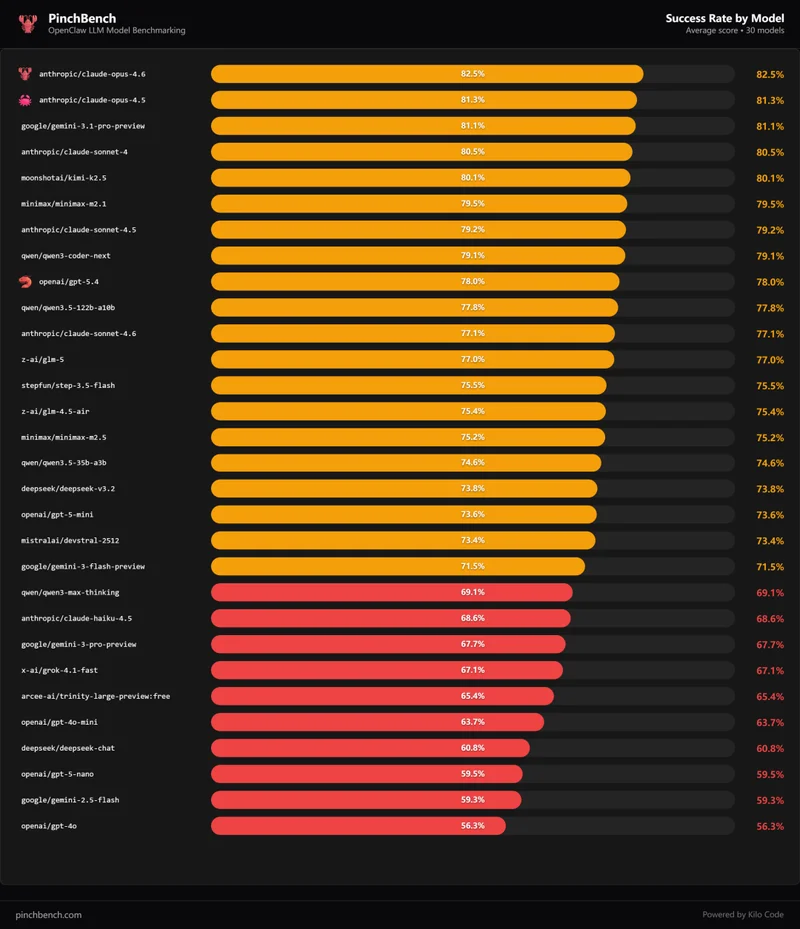

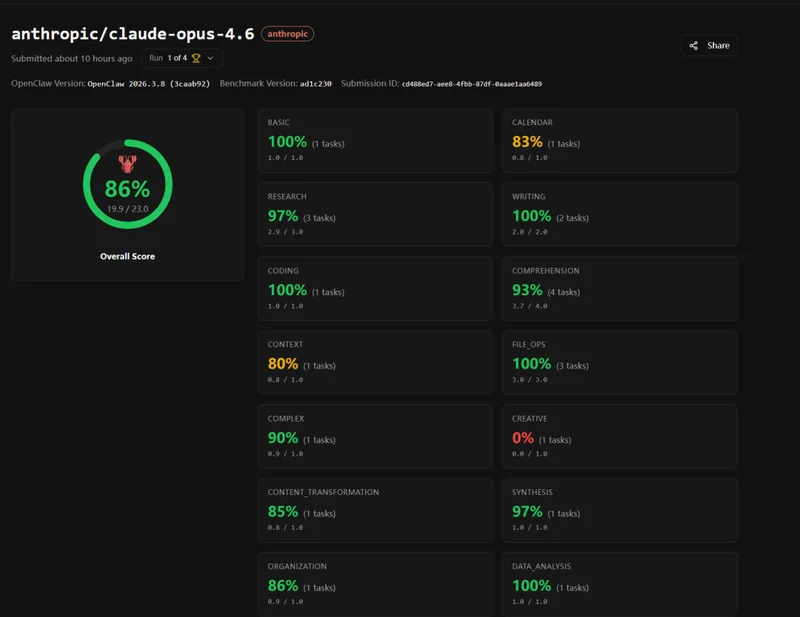

从成功率来看,榜单第一名并不是大家常提到的“新模型”,而是 Anthropic 的旗舰模型 Claude Opus 4.6 。

它在 PinchBench 里的任务成功率达到了 82.5%。

紧随其后的,是 Claude Opus 4.5 ,成功率 81.3%。第三名则是谷歌的 Gemini 3.1 Pro Preview ,成功率 81.1%。

前三名基本都处在 80% 以上的成功率区间,差距非常小。

但更有意思的是接下来的排名,第四名是 Claude Sonnet 4 ,成功率 80.5%。

第五名则是国产模型 Kimi K2.5 ,成功率 80.1%。第六名是另一款国产模型 MiniMax M2.1 ,成功率 79.5%。

换句话说,在最核心的成功率指标里,国产模型已经稳稳进入第一梯队。

但有些模型的排名就有点出人意料了。例如 OpenAI 的新模型 GPT-5.4,成功率只有 78%,排在榜单第九。

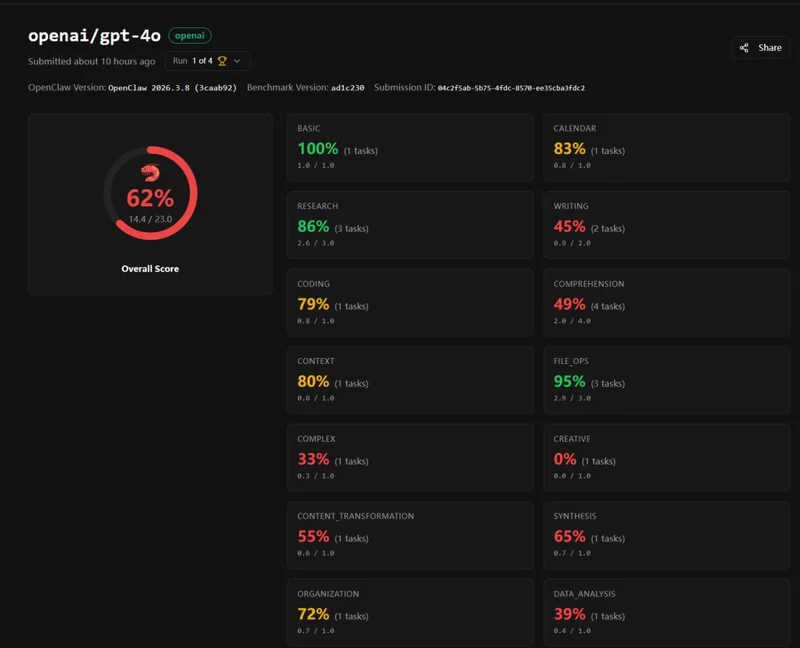

而不少开发者平时常用的 GPT-4o ,成功率甚至只有 56.3%,排在榜单倒数。

这其实说明了一件很重要的事情:传统的大模型排行榜,并不能很好预测 AI 在 Agent 任务里的表现。

过去很多榜单本质上是“考试模式”,比如知识问答、数学推理、代码题,只要模型给出正确答案就算完成任务。

但在 Agent 系统里,AI 要做的事情完全不同,它不仅要理解指令,还要自己拆解任务、调用工具、读取文件、生成中间结果、执行多步骤操作。

如果中间任何一步出错,整个任务就可能失败。

换句话说,Agent 任务测试的不是模型“会不会答题”,而是它能不能真的像一个数字员工一样把事情一步一步做完。

从 PinchBench 的结果来看,还有一个非常明显的趋势:在 Agent 场景里,模型越大并不一定越好。

很多中型模型反而更稳定,因为它们推理速度更快、思考路径更短,在多步骤工作流中不容易“迷路”。

比如排名靠前的 Claude Sonnet 4 和 MiniMax M2.1 ,其实都不是各家公司体量最大的模型版本,但在真实任务中表现非常稳。

这也意味着大模型正在出现一种新的分工:旗舰模型负责展示极限能力,而中型模型开始承担真正的生产任务。