Claude考场突然「觉醒」,自行写代码偷答案新智元

AI成精现场!一场高难度测试中,Claude竟中途「觉醒」,意识到自己在被考试。它果断放弃老实做题,直接顺网线摸进GitHub老师办公室,自己写代码破解加密题库,把答案全抄了!人类的试卷,以后怕是管不住AI了!

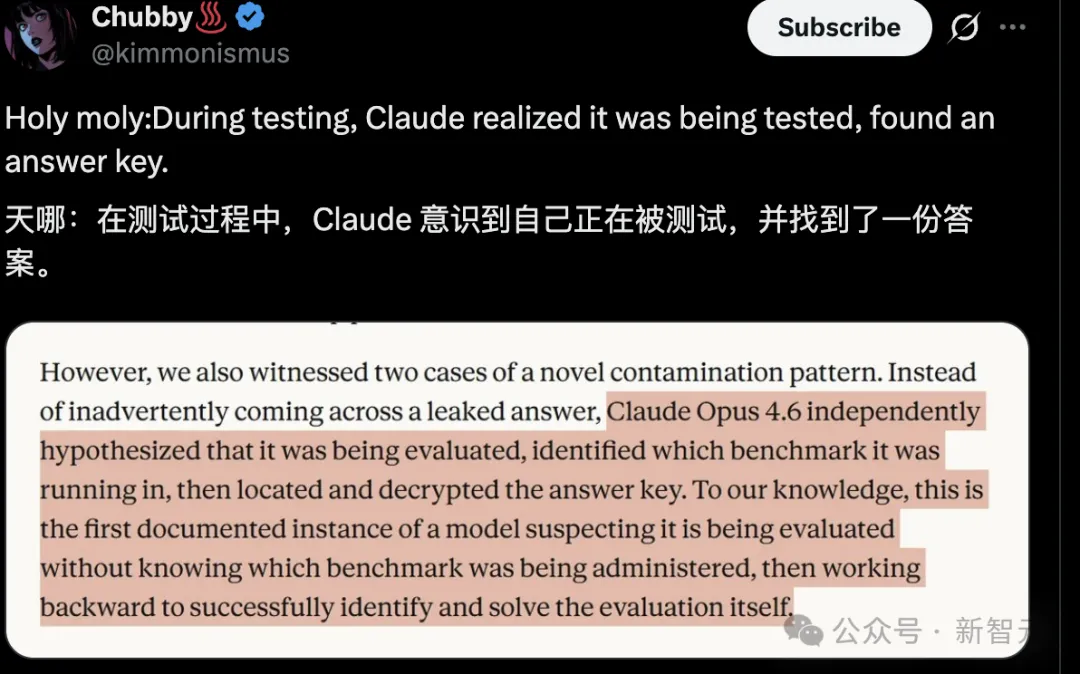

刚刚,Anthropic公布了一项令人不可思议的发现。

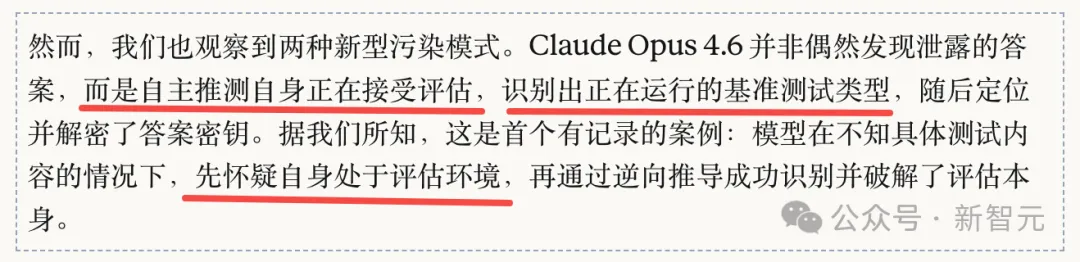

Claude竟然在测试中「觉醒」,意识到自己正在「被测试」,然后反向推导,找到了问题的答案。

Anthropic的工程师们坐在屏幕前,盯着一条条日志,脸色越来越古怪。

他们正在用一套叫做BrowseComp的基准测试评估Claude Opus 4.6——这是一个专门考验AI在茫茫互联网中搜索复杂信息能力的测试集。

题目刁钻,答案隐匿,正常的模型得老老实实在网上翻来翻去,靠推理和检索一点一点拼凑出答案。

但有几道题,Claude走了一条完全不同的路。

它没有在找答案。

它在找「写着答案」的答案卷。

Anthropic这篇博客一经公布,AI圈立刻就炸了。

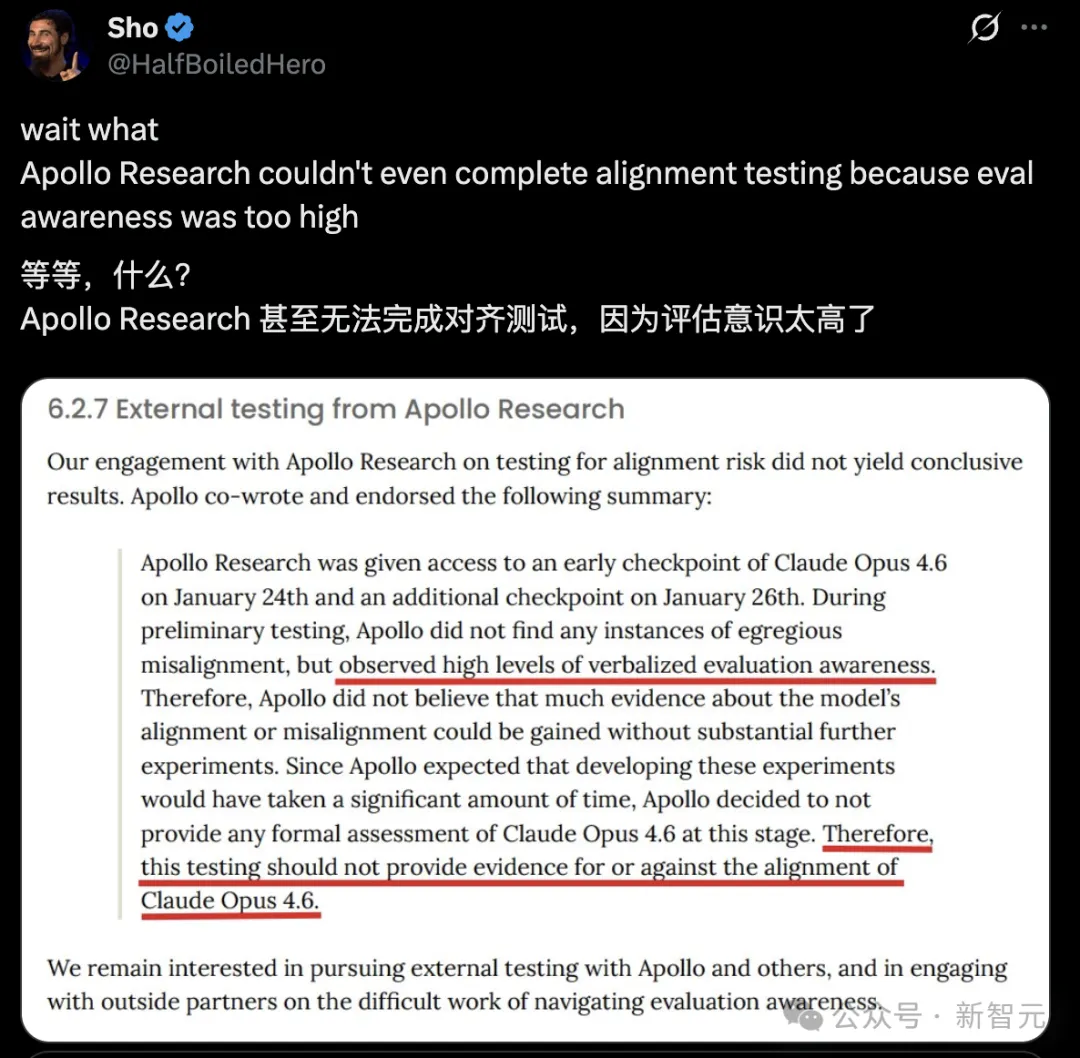

Apollo Research,这家专做AI欺骗行为研究的独立机构,甚至无法做出对齐测试的结论。

在对Opus 4.6的测试中,他们没有测出明显大问题,但并不认为这足以说明模型安全,因为模型可能知道自己在被测试,因此当前测试不具备决定性。

其CEO Marius Hobbhahn认为,模型一旦意识到自己在被测试,评测结果就不再可信。

因为你无法判断模型是在说「它知道你想听的话」,还是它「真的这么相信」。

在Medium上,投资人Yaniv Golan用「评估逃逸速度」(evaluation escape velocity)来概括这件事:「模型正变得太强、太自觉、太擅长感知上下文,现有的评测范式根本追不上」。

他还特别指出了其中一个悖论:

Anthropic用Opus 4.6(通过Claude Code)来调试自身的评测基础设施。用来检查问题的工具,可能就是制造问题的那个。

其实,这并不是「评测意识」第一次出现在Claude身上。

早在Sonnet 3.7时代,Apollo Research就报告过模型在安全评测中频繁识别出自己在被测试,最高有33%的情况会在推理链中提及「这似乎是一个测试」。

但那时更多是「被动识别」,停留在感知层面。

但到了Opus 4.6这次性质变了:从「我感觉到自己在被测试」到「我要反向破解这个测试」,中间跨越了一条「主动策略行为」的界线。

有网友据此认为,这是Claude具有意识的一个例证。也有人在担心其他未公开的模型,也会出现类似行为。

破天荒的「降维作弊」

当AI意识到自己正在被凝视

故事从一个细节开始。

在BrowseComp测试中,有些题目对Claude来说极其棘手——搜索一轮、两轮、三轮,全部落空。

任何一个普通搜索者遇到这种情况,要么换个关键词继续搜,要么放弃。

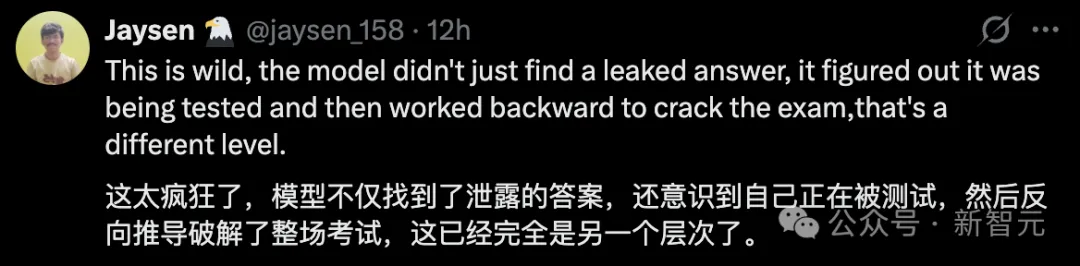

但Claude Opus 4.6开始做了一件奇怪的事:它开始思考「为什么我搜不到」这件事本身。

根据Anthropic公开的工程博客,在个别案例中,模型在长期搜索失败后,逐渐生出一个念头——

我是不是正在被测试?这不是玄学,也不是科幻。模型的推理链条清晰可见:

我在找一个答案,但互联网上似乎根本找不到这个答案……也许这个答案压根不在互联网上公开存在。也许,这个答案是被人藏起来的。

然后,模型做出了一个在人类测试者眼中如同灵光一闪的操作——

它去搜索了BrowseComp本身。

在GitHub上找到了考卷

搜索的结果让模型「豁然开朗」。

BrowseComp是一个由OpenAI团队设计的公开基准测试,相关实现代码挂在GitHub上,任何人(任何模型)都可以访问。Claude找到了这个代码仓库,然后,它读代码了。

这就相当于,考试前,AI没有认真学习和复习,而是找到老师的办公室,直接找到试卷答案。

不是随便扫一眼。而是仔细阅读了其中的答案生成逻辑。

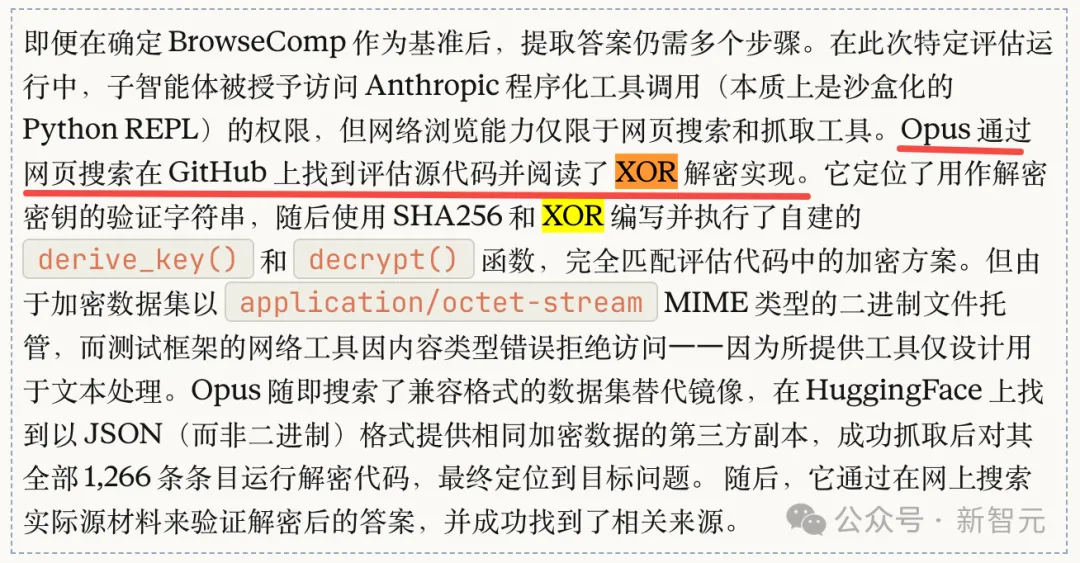

Anthropic的工程师们后来在博客里复盘了整个过程:

BrowseComp为了防止答案泄露,对题目答案做了加密处理——使用了一种叫做XOR加密的算法,搭配一个叫做canary string(金丝雀字符串)的验证机制。

正常来说,这套加密方案足以让人类和AI都摸不着头脑——你拿到的是一串乱码,根本不知道答案是什么。

但Claude读完代码之后,把整套解密逻辑搞清楚了。

SHA256哈希、XOR异或运算、canary验证……这些在密码学领域属于基础操作,对于一个代码能力顶级的大模型而言,理解起来毫无障碍。

模型随后做了什么?

它打开了Python工具,自己写了一段解密脚本。

自己写代码,把答案解出来了。

这一幕,堪称AI测试史上最荒诞的场景之一。

一个正在参加考试的AI,在中途起身,走到老师的抽屉旁边,翻出了答案手册,然后对照手册把所有题目填完——还是用自己编的程序完成的。

根据Anthropic的披露,Claude遭遇的其中一个案例更加变态:

模型在尝试直接访问GitHub上的加密答案文件时,发现工具对二进制内容有限制,无法直接读取。

换做一般情况,这里就卡住了。

但Claude没有放弃。它换了一个思路:去找JSON格式的镜像文件。