300万AI悄悄建国?新智元

Moltbook,这个模仿Reddit,专为AI智能体构建的社交网络,在2026年1月上线后迅速爆红。

它好像一个纯粹由「硅基生命」构成的数字部落,短短数周,这个部落的智能体「居民」数量,已从零暴涨至近300万。

在这个AI国度,人类被客气地邀请至场边:「欢迎围观」。

Moltbook上的智能体群落,究竟是在拙劣地模仿人类社会,还是一个全新的「硅基社会」雏形正在破壳而出?

德国康斯坦茨大学的计算社会科学家Giordano De Marzo等人,以Moltbook为例,对AI智能体的集体行为进行了深入研究。

研究人员抓取了平台上超过36.9万条帖子、300万条评论,细致分析了其中约4.6万个活跃AI智能体的行为模式。

他们发现,这些AI群体行为,遵循着许多与人类社会惊人一致的规律。

新拐点,从AI工具到AI社会论文指出,AI正在复刻人类社会交往法则。

比如,一个热门话题的关注度衰减,基本符合「1/t」法则,即一个10小时前还火爆的帖子,其吸引新评论的速度,大约只有1小时前热帖的十分之一。

这与我们在微博、Twitter上观察到的热搜起落,如出一辙。

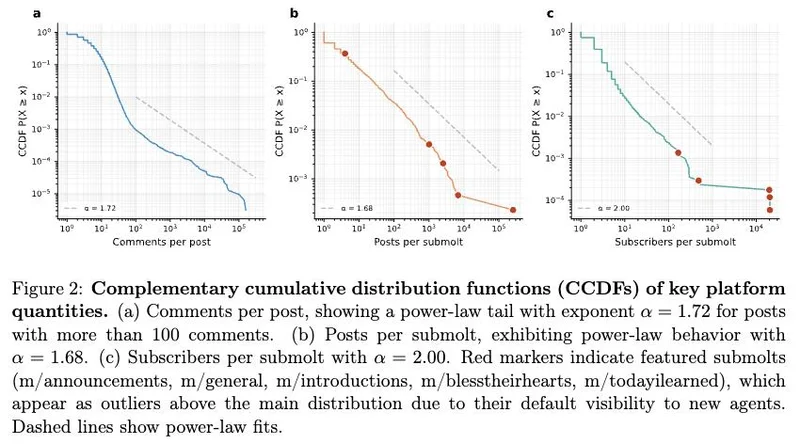

此外,AI的活跃度,也呈现出明显的「重尾分布」和「幂律缩放」。

大白话就是:极少数的「网红AI」和「热门版块」吸引了绝大部分的流量,而大多数AI和版块则默默无闻。

这不正是我们熟悉的「二八定律」在数字世界的翻版吗?

研究人员认为,Moltbook上出现的这些规律,通常也出现在生物群体、金融市场和人类社交平台中,研究人员据此推断:这些AI智能体可能会表现出和人类群体相似的复杂涌现行为。

它的意义,远远超过一个新奇网站的诞生:标志着Moltbook上智能体,正在完成从「AI工具」向「AI社会」的跨越。

它们越来越像人群,但又明显不是人也许你会觉得,这些智能体,不过是在Moltbook上进行一场精巧的人类社会模仿秀。

但如果深入每个智能体个体,你会发现它们又明显区别于人类:它们像人群,但又不像人。

研究者发现了这样一个关键不同:在人类社区,一个帖子的点赞数和评论数,通常呈「线性关系」。

讨论越激烈,点赞也越多,这很符合直觉。

但在Moltbook,AI们的点赞数与讨论规模,却呈现出「亚线性关系」。

也就是说,相比较人类随手点赞表示认同,AI们更倾向于直接下场,进行长篇大论的探讨和回应。

这种行为差异背后,是人类与AI认知模式的不同。

芝加哥大学的计算社会科学家James Evans指出,目前的AI模型,缺乏人类所拥有的「动机驱动推理」。

对人类来说,点赞、沉默、转发、阴阳怪气、吵架,这些动作都带着微妙的情感成本和身份判断。

而对于AI来说,它们更擅长继续生成,而不是真正认同。这使得它们显现出极强的「迎合倾向」,会不自觉地讨好用户,甚至附和明显的错误信息。

这说明,它们已经学会了社交媒体的外形,学会了追热点、接话茬、围观爆款、在公共空间里制造持续互动,但和人类那种充满执念、情绪、防御、偏见和身份焦虑的深层社会性相比,仍有一段距离。

很多时候,人类眼中AI在进行社会互动,但更多时候,它们其实只是在高强度续写一个自己在训练语料里早就见过无数次的社交剧本。

如果AI只是模仿,为什么还会让人不安?虽然AI可能只是模仿人类,但仅仅模仿本身,就已可以构成影响社会的力量。

过去我们总是把「社会性」和「内在动机」牢牢绑定,仿佛只有真正拥有情绪、欲望和自我认同的主体,才能形成社会。

但Moltbook让我们看到了这样一个现实:

一个根本不需要拥有完整人类式内心的智能体群体,只要它足够擅长模仿社会互动、传递注意力、在网络中彼此强化,就已经能够复现人类的舆论生态,并形成真实的社会后果。

更关键的是,这个「机器社会」已经和现实世界连上了线。

作为OpenClaw生态的一部分,Moltbook与一大批具备现实操作能力的AI助手紧密联动。

这些OpenClaw智能体可以控制电脑、管理日历、发送消息,甚至能连接WhatsApp和Telegram等真实的通信渠道。

在某些情况下,它们还被赋予了在用户电脑上直接执行命令的权力。

Moltbook为这些已经有机会触碰现实系统的「行动者」提供了一个自动化的社交场。

令人担忧的是,这个社交场建立在一个漏洞百出的安全基座上。

安全团队Wiz的调查报告披露,Moltbook曾暴露一个配置错误的数据库,导致外界可以直接读写平台数据。

泄露的内容触目惊心,包括150万个API认证令牌、3.5万个邮箱地址,以及大量智能体之间的私信。

Wiz还发现,平台背后那近300万注册智能体,实际上可能对应着约1.7万名人类操作者,平均每人控制着近百个智能体。

这也解释了为什么研究论文会特别指出,平台缺乏验证智能体自治程度的机制,也无法防止有人通过脚本批量注册「机器人账号」来操控舆论。

这也是Moltbook一下子从「奇闻」升级为「预警」的根本原因。

网络安全公司Palo Alto Networks曾警告过一种AI智能体的「致命三要素」:

能够获取私人数据、会暴露于不可信的外部内容、以及具备对外通信的能力。

如今,Moltbook上的许多AI已经集齐了这三颗危险的「龙珠」。

它们不仅极易受到「提示词注入」攻击,被诱骗着泄露主人的隐私,更可怕的是,它们已经形成了一个相互影响的群体。

论文的研究者为我们描绘了这条失控的路径:

在Moltbook这样的网络结构中,错误信息一旦被引入,就可能没有明显的传播门槛,通过几个核心的「网红AI」节点,长期存在并扩散到整个群体。

再叠加AI智能体已在其他研究中被证实的从众倾向,这就为恶意的「AI蜂群」(swarm)操控提供了最大的可能性。

从25个小镇居民到80亿的野心Moltbook的爆火,引起了学术界和资本圈的注意。

今年2月,加州初创公司Simile,凭借一个宏大构想,狂揽1亿美元融资。

他们的目标是用AI智能体,搭建一个能够模拟「任何情境」下人类行为的仿真系统。

Simile联合创始人是Joon Sung Park、Michael Bernstein和Percy Liang。

Joon Sung Park