两场震惊世界的军事行动,背后是同一AI系统返朴

2026 年刚开场两个月,美军就开展了两场震惊世界的军事行动:1 月 3 日,特种部队超低空突入加拉加斯,三小时内抓获委内瑞拉总统马杜罗;2 月 28 日,美以联合发动 “史诗狂怒” 空袭,炸死伊朗最高领袖哈梅内伊及 40 名核心高层。这两场行动不仅是地缘政治的惊天剧变,更是人类战争史上的技术分水岭 ——AI 技术的深度参与,让 “观察、调整、决策、行动” 的军事决策周期从数小时压缩至数秒,彻底改写了战争的底层逻辑。

当一方的决策时钟运行在机器速度,而另一方停留在人类速度,这场对抗的胜负在开局时便已注定。与此同时,华盛顿与硅谷之间因 AI 军事化爆发的权力博弈,更让这幅图景增添了关于技术伦理与人类命运的深层拷问。

一、从实验室到战场:AI 军事化的八年演进

AI 在军事领域的应用并非横空出世,其源头可追溯至 2017 年五角大楼启动的 Project Maven(算法战跨职能小组)。项目初衷极为朴素:用深度学习神经网络替代情报分析员,从海量无人机画面中自动识别车辆与武装人员,破解 “大海捞针” 式的情报筛选困境。

2018 年,谷歌因工程师集体抗议终止与 Maven 的合作,这一举动并未阻止 AI 军事化的进程,反而揭开了科技行业与军工复合体之间的深层裂缝。真正的转折点,是大语言模型(Large Language Model)的崛起,让 Project Maven 完成了质的飞跃:美国国防承包商 Booz Allen Hamilton 主导将大模型集成至系统核心;英国 Anduril 公司与美国 Palantir 联手,打通 Lattice Mesh 战场感知网络、Maven 智能系统与 Palantir AI 平台,实现战术传感器数据向 AI 支持的分析师工作流无缝转移。

(美国国家地理空间情报局对 Maven 项目的介绍(机翻)| 图源:NGA 官网)

这套高度集成的体系,能自动汇聚卫星图像、信号情报、地面传感器等多源数据,经过滤、关联后生成直接供指挥官使用的目标建议。数据显示,该系统使高级指挥官每小时可做出 80 个目标打击决策,较非 AI 时代的每小时 30 个实现效率翻倍。美国国家地理空间情报局(NGA)更规划,到 2026 年 6 月,Maven 将向作战指挥官传输 “100% 由机器生成” 的情报。

2024 年 6 月,Anthropic 的 Claude 成为首个部署在五角大楼机密网络的商业大语言模型,AI 军事化的闸门就此彻底打开。

二、两场行动,同一套 AI:算法驱动的精准打击

2026 年的两场关键军事行动,背后都离不开同一套 AI 系统的支撑 —— 以 Palantir AI 平台为载体、Anthropic Claude 大模型为认知引擎的情报分析体系。

(一)行动中的 AI 角色

尽管美军从未公开 AI 执行的具体任务,但结合知情人士披露与专家分析,其核心作用可归纳为三类:

多源情报整合建模:整合当地线人信息、无人侦察机画面、通信截获内容与卫星图像,精准构建打击目标的生活规律与活动轨迹;

突入路径推演:模拟当地防空网络的雷达盲区,计算最佳突袭路线,最大化行动隐蔽性;

战场场景预演:在行动前快速模拟不同突袭路径下敌方的反应模式,为指挥官提供最优决策参考。

在针对伊朗的行动中,Palantir 系统处理了 2.3PB 数据量与 1.2 亿条情报碎片,AI 仅用 90 分钟就完成了人类需 328 人连续工作 100 天的清洗与分析任务,从发现目标到完成打击仅耗时十几分钟,较传统流程压缩 90% 以上。

此前以色列空袭伊朗时,也已运用 AI 技术截获通信、梳理情报、识别高价值目标,验证了这套技术体系的实战价值。值得注意的是,即便 Anthropic 员工,也需在行动结束后向 Palantir 询问 Claude 的具体角色,侧面反映了 AI 在军事链条中的嵌入深度与保密性。

(二)美军 AI 生态的三层架构

这场技术革命的背后,是美军构建的 “感知 - 认知 - 行动” 全链条 AI 生态,其核心逻辑可通过三层架构解析:

感知层:由美国太空军主导,依托地球同步太空态势感知计划(GSSAP)卫星星座、地基光学传感器系统(GBOSS)与深空高级雷达能力(DARC),实现全球地面与轨道目标持续监视。太空军 2024-2025 年连续发布 “数据人工智能战略行动计划”,将 AI 纳入全军数据战略,明确提升人员 AI 素养、测试大模型军事应用、强化数据互操作性等目标;

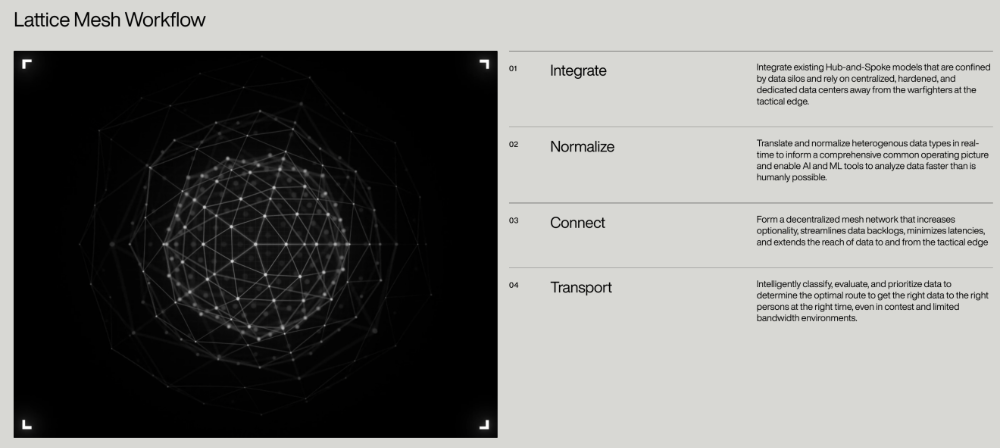

认知层:Anduril 的 Lattice Mesh 战场感知网络承担核心处理功能,通过 “整合 - 标准化 - 连接 - 传输” 四步 workflow,实时汇聚异构数据并标准化处理,即便在对抗性电磁环境与低带宽场景下,也能将数据高效传输至战术前沿;随后数据进入 Palantir AIP 平台,Claude 大模型将结构化数据转化为语义化输出,指挥官可通过自然语言直接交互,大幅降低使用门槛;

行动层:Maven 智能系统运行于亚马逊 AWS 云服务,集成 Claude 后可自动执行目标识别、定位、过滤与优先级排序,已在红海区域成功引导打击火箭炮发射器和水上舰艇。美军的终极设想,是实现从卫星图像到打击建议的全自动流水线,人类仅需在最终授权环节干预。

这种体系带来的不仅是效率提升,更是认知维度的降维打击 —— 当传统战争的 OODA 循环周期以天为单位,而 AI 驱动的算法战争以毫秒为单位,对抗的天平已然倾斜。

三、政府与企业的博弈:AI 军事化的红线之争

就在 AI 在战场大显身手之际,美国国内爆发了一场关乎 AI 行业格局的剧烈博弈。冲突的核心,是五角大楼与 Anthropic 的合同条款之争:军方坚持要求写入 “AI 模型可用于所有合法用途”(all lawful purposes),而 Anthropic 则坚守两条不可逾越的红线。

(一)不可调和的核心分歧

Anthropic 由前 OpenAI 核心人员于 2021 年创立,以 AI 安全为核心使命,其 “宪法 AI”(Constitutional AI)训练方法广受行业认可。该公司明确禁止两类用途:一是对美国公民的大规模国内监控,二是无需人类干预的完全自主致命武器系统。

五角大楼认为,这两类用途已受现行法律与内部政策约束,无需在商业合同中额外限制,Anthropic 只需 “信任军方守法” 即可。但 Anthropic CEO 达里奥・阿莫代(Dario Amodei)反驳称,现有隐私法律诞生于 AI 具备大规模监控能力之前,存在致命漏洞 —— 政府可通过合法渠道购买公民地理位置、浏览记录等商业数据,再经 AI 交叉分析实现实质监控,这种行为在法律框架内无法被界定为非法。

更具争议的一幕发生在一场极端假设的对话中:五角大楼官员询问,若需拦截携带核弹头的洲际弹道导弹,Anthropic 是否会授权使用 Claude?达里奥的回应是 “你们可以打电话给我们,我们一起想办法”,这一答案彻底激怒了军方领导层。

(二)强硬制裁与行业分裂

特朗普政府随即采取高压手段:下令全联邦机构停用 Claude,切断其数亿美元合同;破天荒地将这家美国本土企业列为 “国家安全供应链风险”(该条款通常用于制裁敌对国家实体);甚至威胁动用《国防生产法》(DPA)强制征用其技术。

就在 Anthropic 被驱逐之际,OpenAI CEO 山姆・奥特曼迅速接手五角大楼合同。OpenAI 虽宣称划定 “无国内监控、无自主武器、无自动化高风险决策” 三条红线,却接受了 “所有合法用途” 条款,辩称其云端架构天然排除自主武器部署可能,且依赖国防部现有法律约束行为 —— 本质上,OpenAI 选择了 “信任军方”,而 Anthropic 选择了 “用合同约束军方”。

这一决策引发行业强烈反弹,800 多名谷歌与 OpenAI 员工联署《我们不应被分裂》(We Will Not Be Divided)公开信,批评管理层妥协。有意思的是,埃隆・马斯克的 xAI 同期与五角大楼签署协议,允许 Grok 模型用于机密军事系统,却未引发同等规模的舆论风暴。