美国真的用AI斩首?差评

要说这几天最大的新闻,当属是美国、以色列和伊朗的这篓子事了。

关于地缘政治和军事冲突的博弈,差评君不是专家,就不在这里班门弄斧了。但值得注意的是,随着远方炮火声一同在互联网上引爆的,还有一波大家对 AI 参战的深深恐惧。

这两天,一篇把 AI 在战场上描绘得神乎其神的文章在各个群里炸开了锅,获得了病毒式的传播。

文章链接我就不贴了,简单摘要两句话来给大家一起看吧:

在那篇文章里,这场被美军命名为“史诗愤怒行动”的斩首突袭,被认为是 “它是人类历史上第一次由人工智能(AI)多轮辅助“杀伤链”(Kill Chain)的高层斩首行动”。

还说 “AI不再只是一个辅助工具,它与人类一起成了真正的决策者、追踪者和执行者的一部分。”

这些词一套一套的,看起来是蛮唬人的,仿佛下一秒,AI 就能独立发起一场战争,像科幻电影一下直接把大家给一起突突了得了。

但是在仔细阅读了各类主流媒体的报道,扒拉了不少 AI 圈的通告后,差评君发现这篇文章不能说是稍微夸大,只能说是基本扯蛋了。

今天咱们就不妨从现实出发,好好盘一盘:在这次的军事行动中,AI 到底起到了什么作用?它又是怎么起作用的?

美国政府在军队中使用 AI,是大家早就知道的了的事情。

早在 24 年 11 月,Anthropic 和一家为美国军方提供大数据分析的公司 Palantir 就展开了合作,整上了个特殊的服务器,在里面运行上了政府定制版的 Claude。

到了去年 6 月,Anthropic 更是直接写了篇博客,告诉大家他们给政府特调了一个模型,Claude Gov。

比起传统的 Claude 来说,这个政府特供模型直接打开了话匣子,可以处理各种敏感信息。

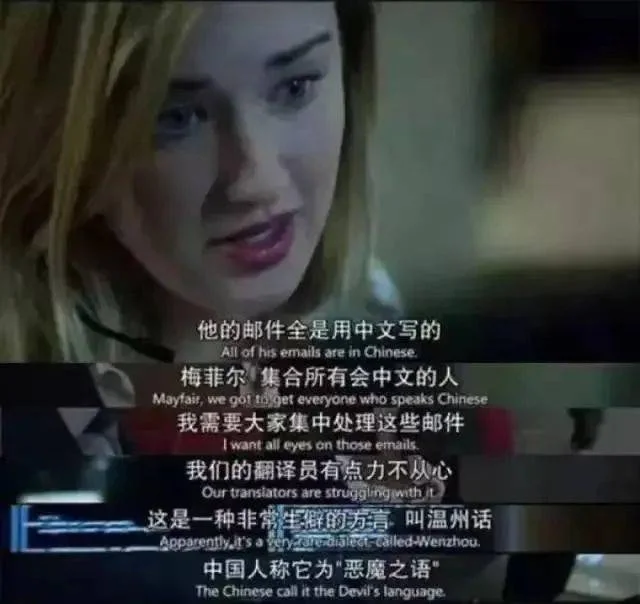

而且还能精通各路方言,看起来是没少吃当年温州话加密通讯的亏啊。。。

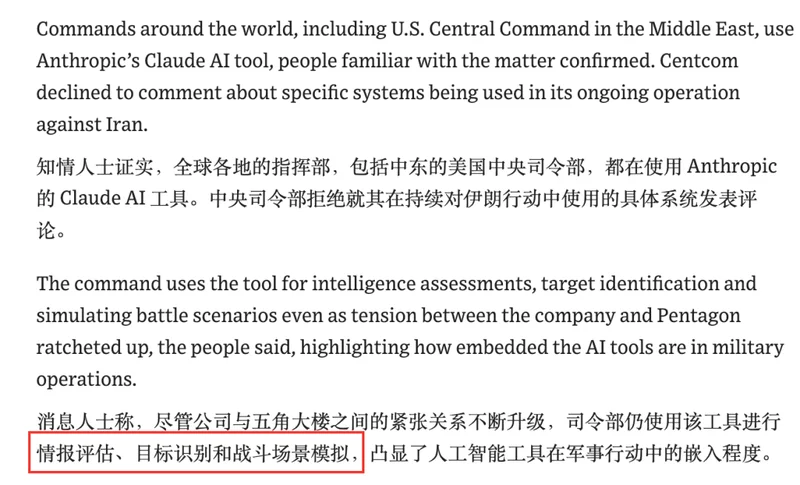

而到了轰炸完伊朗后,华尔街时报更是在报道中再次指出,他们用 Claude 完成了情报评估、目标识别和战斗场景模拟的工作。

好了,没了,目前网络上,能比较靠谱的讲出 AI 在这次军事行动中起到了什么作用的内容,其实就这些。

至于剩下的那些“AI 自动锁头”、“一键发射导弹”的地摊文学,大家当个乐子看就行,除非有现场怪出来现身说法,否则都不太靠谱。

大家也能看出来,在真实的战争机器里,大模型扮演的,主要还是一个情报官和分析师的工作。

现代战场的数据简直就是个无底洞,天上的卫星图、前线的无人机视野、雷达信号,飞机路径,甚至是刚才提到的各种方言和加密电波都混在一起,以前想要处理这么多信息就得纯纯靠人工。靠一屋子的情报分析师熬大夜去一帧一帧地扒、一句一句地听才行。

而参与信息处理的人一多,那信息在传递的过程中可能就会有遗漏,但现在接上了大模型之后,几十万字的情报直接往 Claude 里一扔,刷刷过几秒钟,可能大模型的判断结果就出来了。

在差评君看来,根据公开实锤的资料,这套操作背后的逻辑,甚至和你平时遇到麻烦,去问大模型法律条款、或者让它帮你总结一下体检报告,本质上差不多。

最大的差别,无非就是他们喂给 AI 的知识库,以及训练的数据,换成了实打实的机密情报和战争模型而已。

它给出来的信息能不能信,能信多少,还得依靠人类来做最后的判断。

总不可能直接问克劳德,“小克小克,帮我找到对面老大的位置”,就直接按下开火键吧。

当然,我们也不能小看判断信息的作用。

实际上,就这么个把信息总结,信息决策能力点满了的 AI ,已经早就是美国军方的心头好了。

为此,美国军方还跟 Anthropic 大打出手。

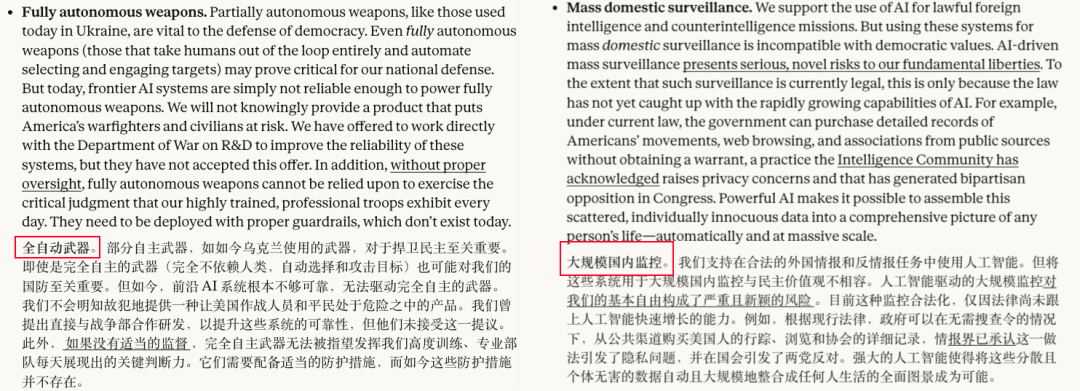

在 Anthonpic 眼里,它认为 AI 可以给拿去用作军事用途,但是不能乱用,于是他们给 AI 划了两条红线:

一是要求禁止军方把 AI 拿去大规模的监控美国民众,二是不能拿 AI 来开发完全自主的杀戮武器。