DeepSeek V4下周登场新智元

DeepSeek V4下周登场:原生多模态,绕过英伟达,针对国产芯片深度优化。华尔街最怕的那条逻辑可能又要重演:算力霸权松动,美股先颤抖。

朋友们,见证历史的时刻又要到了!

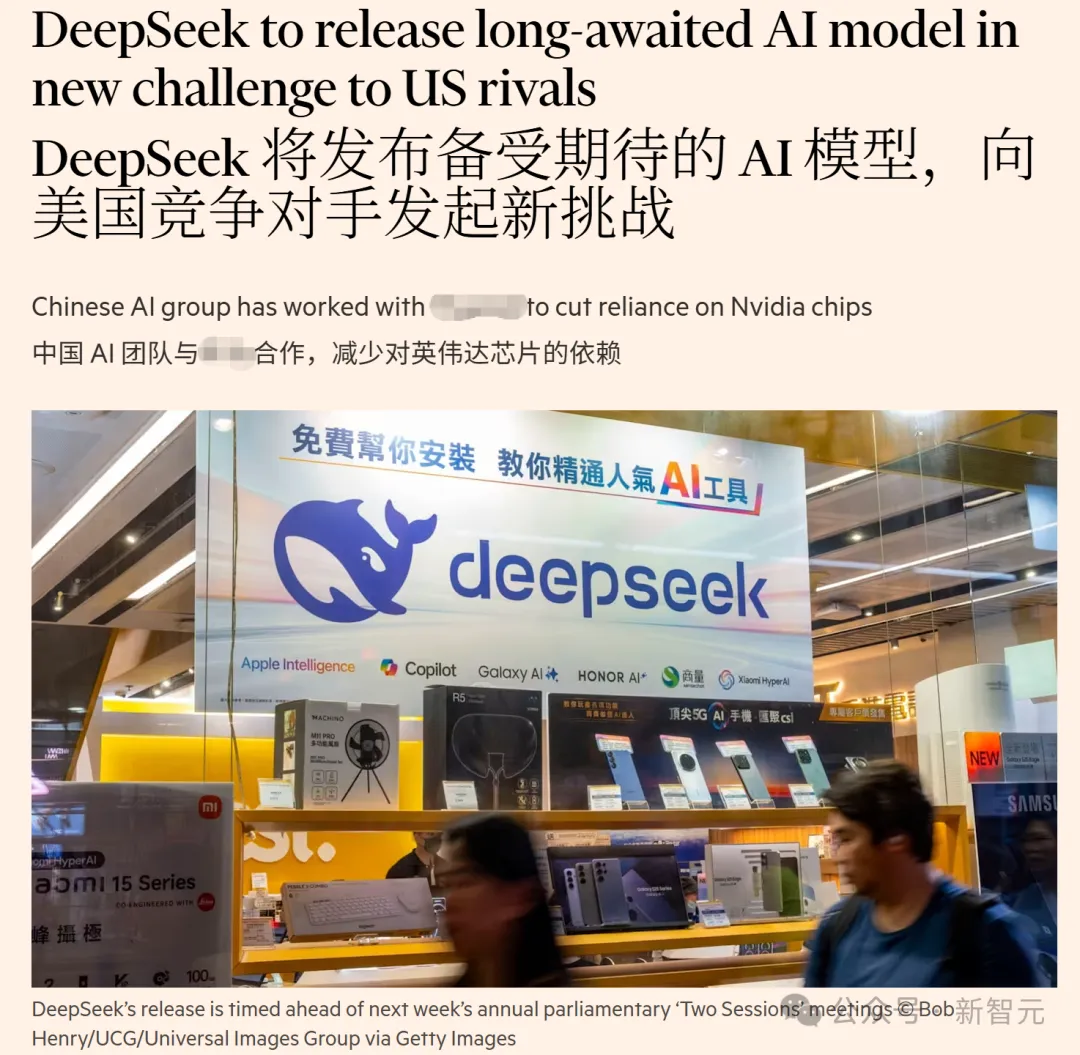

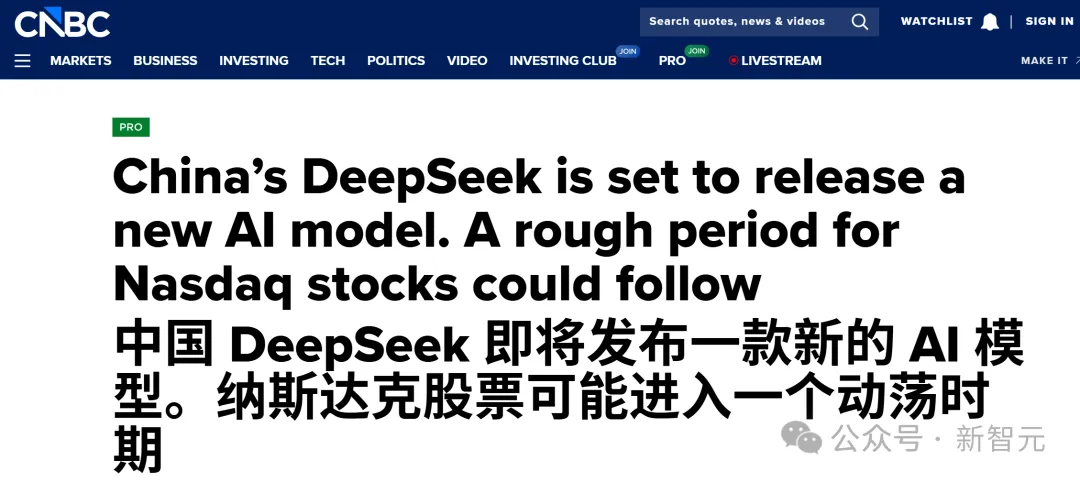

《金融时报》报道,DeepSeek V4,下周正式登场!

距离上一次DeepSeek发布重大模型R1,已经过去了整整一年多。

这一年里,AI行业风起云涌,OpenAI连推数代GPT,Anthropic的Claude杀入顶级阵营,谷歌Gemini疯狂迭代。

整个硅谷都在用数百亿美元甚至数千亿美元疯狂「烧钱」。

而DeepSeek呢?

它安安静静地待在杭州,没有发布会,不路演,不炒作。

只做一件事:磨刀。

预计下周发布的V4将是一款支持图片、视频和文本生成的原生多模态大模型。

更炸裂的是,V4并没有选择跟英伟达做优化适配,而是优先与国产芯片厂商合作,针对国产AI芯片进行了深度调优。

这意味着,DeepSeek V4将不只是一次模型升级,也是一次底层架构的战略转向。

是中国AI从「用别人的芯片跑自己的模型」走向「用自己的芯片跑自己的模型」的历史性一步。

DeepSeek选择国内重磅会议前夕发布V4,无疑发出了一个信号:中国AI,不只是在追赶,还在定义新的游戏规则。

网友称,「V4 将对 OpenAI 和 Google 形成巨大压力。中国没有放缓,而是在加速。」

「人工智能竞赛又提升了一个档次。」

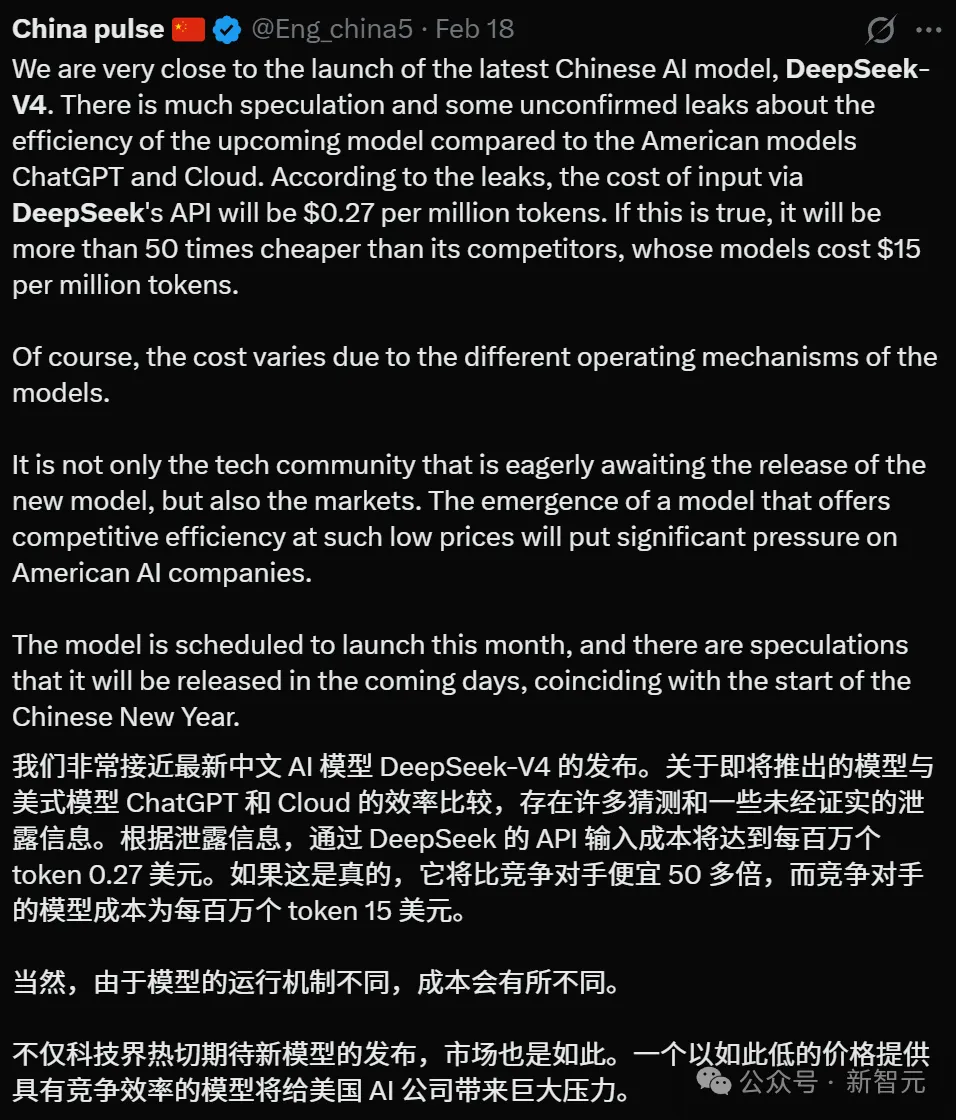

有网友爆料,DeepSeek V4的API成本将比对手便宜50多倍。

更有网友豪言,美股已经瑟瑟发抖。

V4强在哪?

第一个关键词:多模态。

过去的DeepSeek模型主要是「文字选手」——写代码一流,做推理一绝,但图像和视频能力一直是短板。

V4彻底补齐了这块拼图。

据目前泄露的信息,V4是一个原生多模态模型,能够同时理解和生成图片、视频和文本。

而且,V4 Lite已经在至少一家推理服务商处进行内测,据称拥有高达100万token的上下文窗口,表现远超网页版和应用版模型。

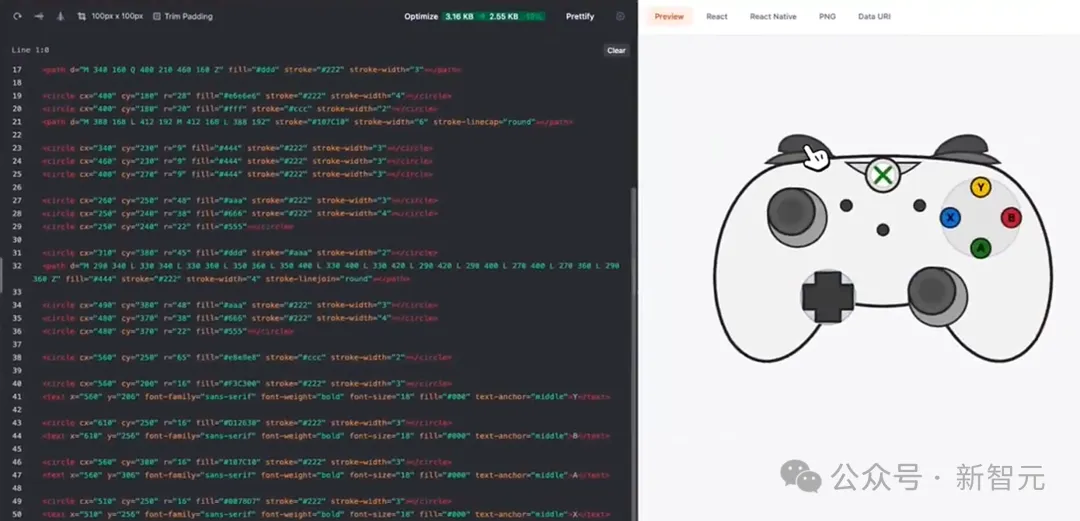

目前已经在外网疯传的一张对比图显示,DeepSeek V4 Lite(代号「Sealion-lite」)在不开启思考模式的情况下,生成的SVG图像质量已经明显超越了当前的DeepSeek V3.2思考模型。

有大V发帖称,V4的编码性能甚至比当前的GPT和Claude更强。