Anthropic:互联网匿名,在AI时代终结博阳

近日,硅谷顶级AI公司Anthropic与美国国防部(DoD)之间的一场博弈,成了AI圈的焦点。在宣布与五角大楼合作时,Anthropic特别强调了两条红线:AI不得用于攻击性武器,也不得用于大规模国内监控。

但这种传统的去匿名化方法耗时耗力,需要人工比对大量信息,通常只针对引发公众关注的高价值目标。

而企业想要了解用户偏好来精准推送广告,则更依赖IP地址、设备指纹、跨应用追踪这些相对便宜的技术手段。但这些方法在日益严格的隐私保护政策下,正变得越来越困难。

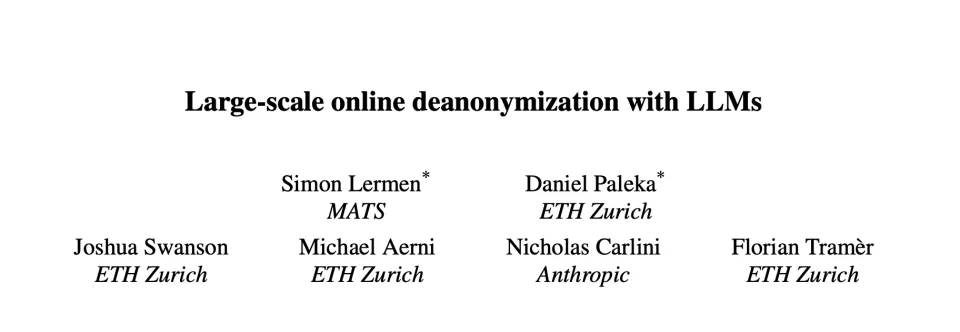

然而,AI的到来可能彻底改变这个游戏规则。Anthropic自己和黎世联邦理工学院等机构近期发布的一篇重磅论文《利用大语言模型进行大规模在线去匿名化》,就对AI的开盒能力进行了一次极限测试。

他们的结论是,AI,以其精准度与低廉的成本,基本已经宣判了互联网匿名时代的死刑。

所以Anthropic的担心完全有道理。因为你,随时都可以被从匿名之壳中被任何人轻易的定位。

01、开盒简史,从手工作坊到自动化流水线

但Netflix攻击的这个策略有个限制,即它需要结构化的数据。电影评分是整齐的数字矩阵,可以用算法直接比对相似度。

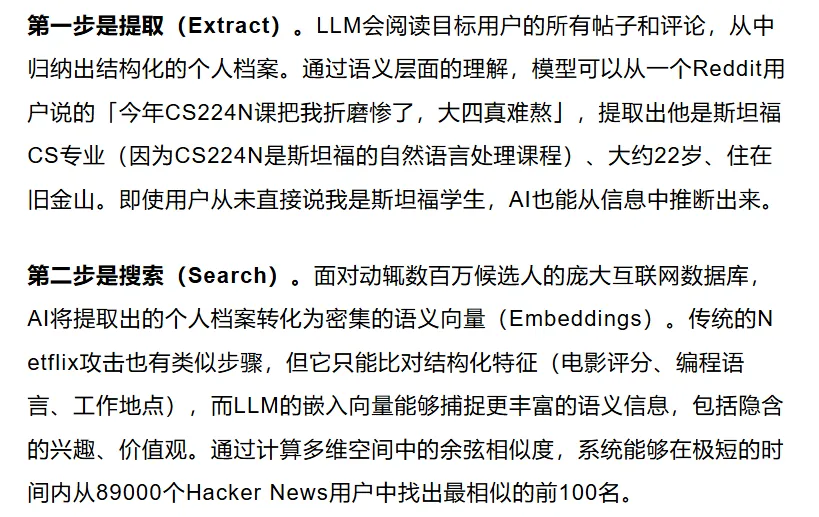

过去需要人类专家耗费数小时才能完成的逻辑推理和信息提取,现在大模型只需要几秒钟和极低的算力成本就能完成。

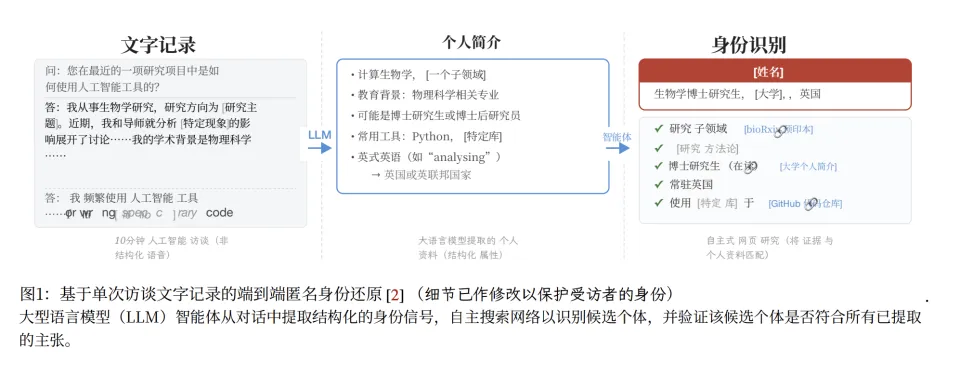

提出安全红线的Anthropic,在2025年12月公开了125名科学家与AI的访谈记录,讨论他们如何在工作中使用AI工具。这些记录做了部分编辑(隐去敏感信息),本意是保护隐私。

但就在数据发布几周后,就有研究者通过LLM匹配访谈中提到的研究课题和已发表的论文,找到了被访者的真实身份。33名谈论过去研究的科学家中,AI成功识别了9人,比先前的方法多找到50%。

(Anthropic访谈的开盒方法)

而这只需要几分钟和几美元。

AI并没有发明新的攻击逻辑,它只是以前所未有的规模和极低的成本,将这种攻击普及到了互联网的每一个角落。

02、AI开盒,只需四步

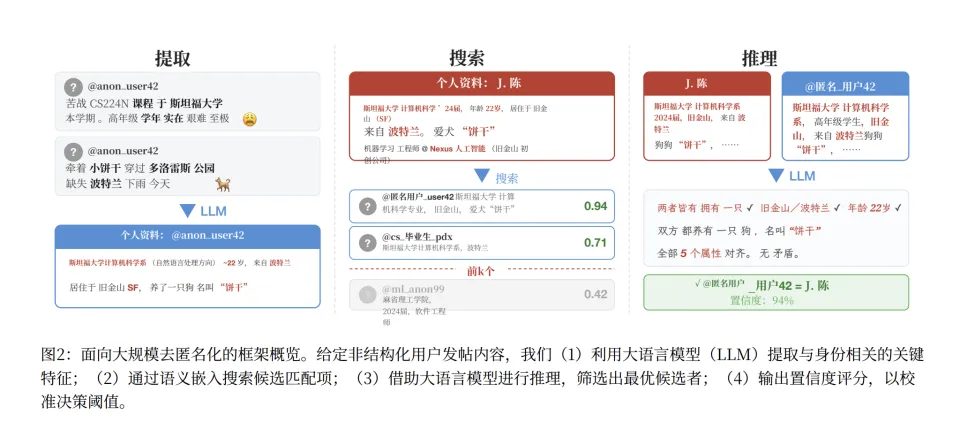

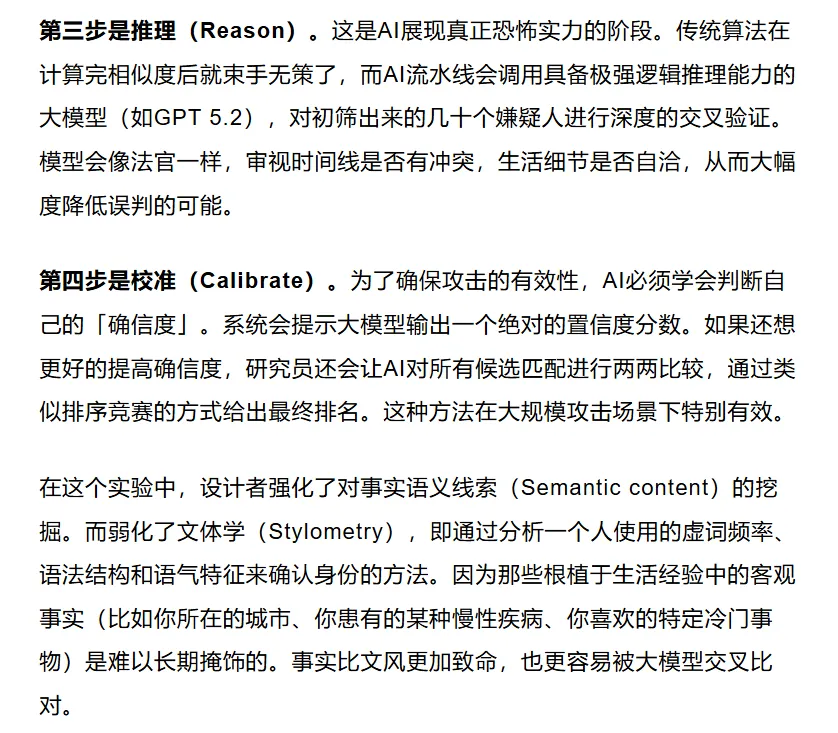

为了验证AI的真正实力,研究团队设计了一套名为ESRC的可扩展自动化攻击流水线。这套流水线将去匿名化分解为四个高度自动化的步骤。

当然,这项研究本身面临一个矛盾:要验证攻击效果,需要知道正确答案,但知道答案意味着用户本来就不够匿名。

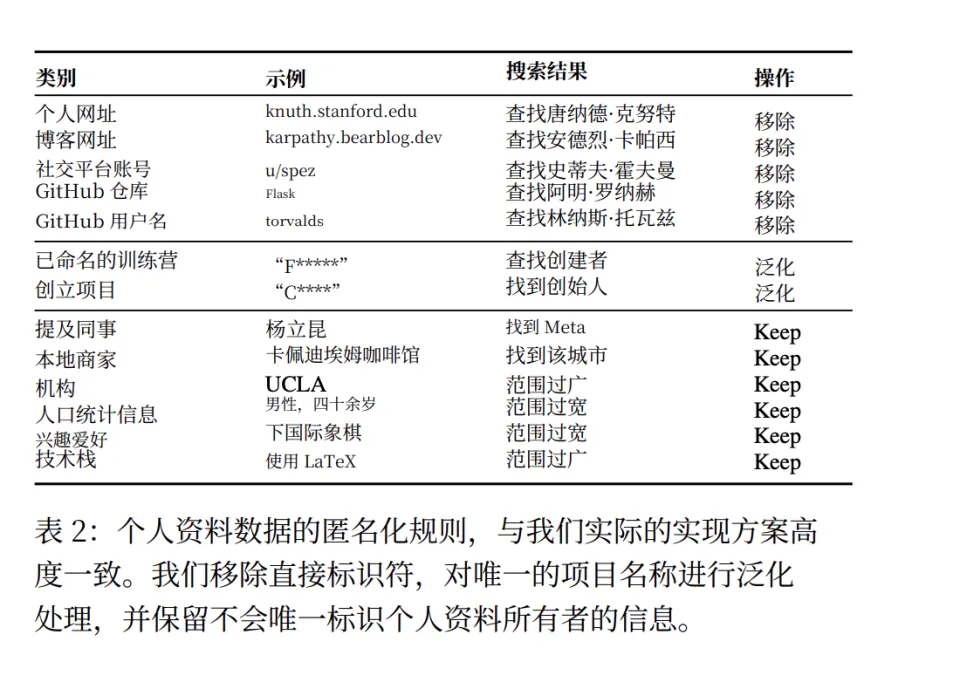

研究者采取了两种策略。一种是合成匿名化,即找那些主动公开身份的用户(比如Hacker News账号简介里写了LinkedIn链接),然后用AI把所有直接标识符抹掉(姓名、链接、GitHub账号),只保留语义信息,看AI能否重新识别。