OpenClaw狂更:接入Gemini 3.1和Apple Watch新智元

过去三周,OpenClaw以几乎「每两天一个版本」的速度狂飙进化,Andrej Karpathy称其为AI技术栈「既酷又让人兴奋的新层」。

2月以来,OpenClaw(前身为Clawdbot、Moltbot)卷疯AI圈。

几乎每两天一个版本的节奏,连发十余次更新,在模型生态、全场景体验、多智能体协同以及安全加固等多条战线,同步推进。

在2月21日OpenClaw发布的最新版本中,正式接入了Google Gemini 3.1 Pro预览版,还将Discord引入实时语音与连续路由功能。

就在OpenClaw狂飙进化的同时,AI圈顶流Andrej Karpathy的一条动态更是将这场狂欢推向了高潮:

他在社交媒体上发帖:自己周末买了一台新Mac mini,准备好好折腾一番「Claws」。

他将Claws视作叠加在智能体之上「新的一层」,这一层将编排、调度、上下文管理、工具调用以及持久化能力直接拉升到了全新高度,是AI技术栈中「又酷又让人兴奋的新层」。

Karpathy的入场,为整个「Claw」赛道注入了一针兴奋剂。

Simon Willison随即撰文指出,「Claw」正在演变为一个行业通用术语,指代所有类似OpenClaw架构的智能体系统。

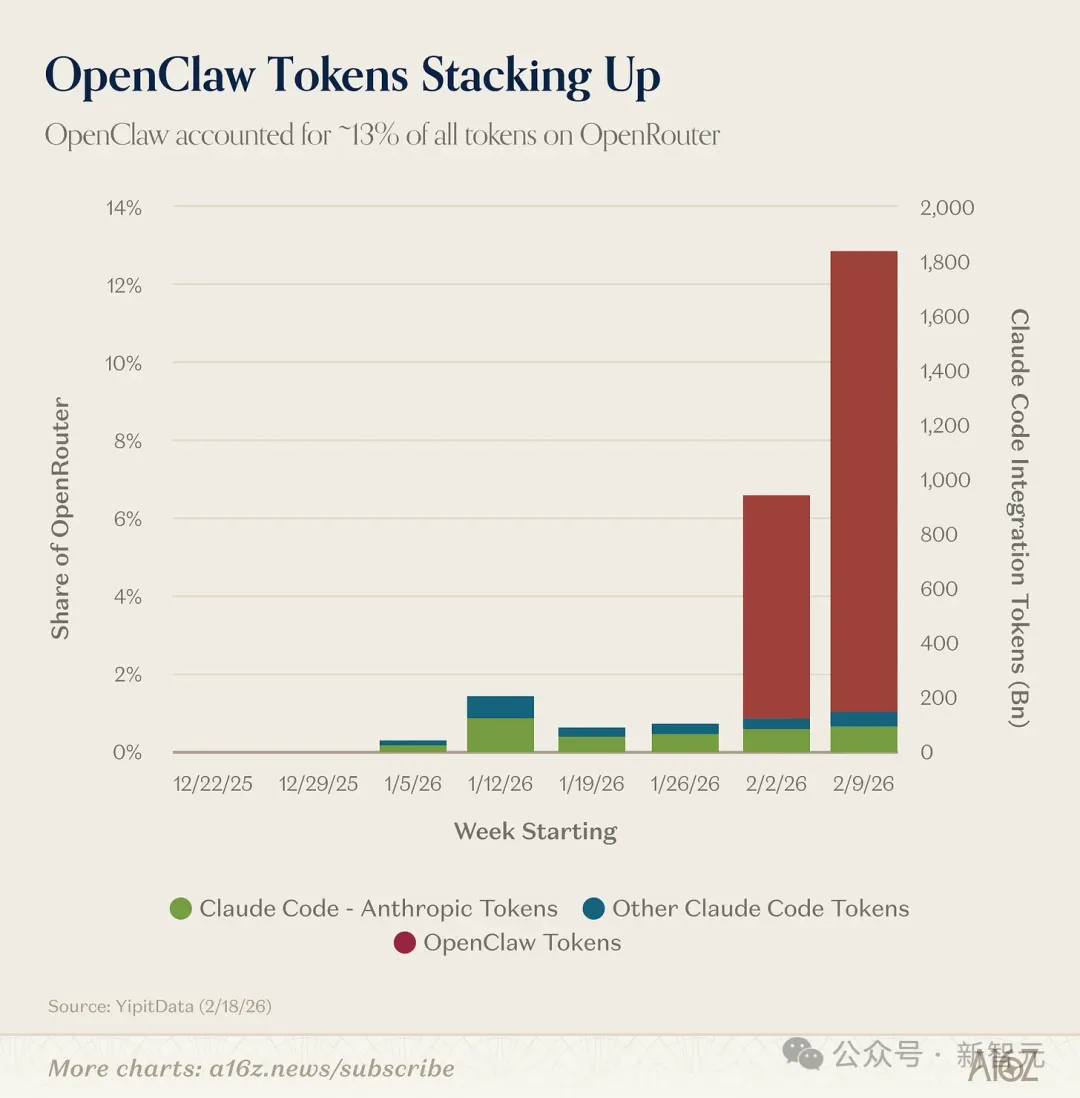

短短两周内,OpenClaw的Token使用量就飙升到了OpenRouter上全部Token约13%(主要来自开源权重模型)。

下面,我们简单梳理了OpenClaw二月重要更新。

iOS生态:二十天完成移动端跃迁

二月,OpenClaw在iOS生态上的推进堪称神速。

2月9日:发布iOS节点应用Alpha版,搭配setup-code引导流程,首次实现手机端接入。

2月17日:加入iOS分享扩展。用户可将URL、文字、图片直接从系统分享菜单推送给AI助手,打断感降至最低。

2月19日:Apple Watch伴侣应用上线。用户可在手表端查看收件箱、收发通知,甚至直接在通知流中批准/拒绝操作请求并快速回复。同步引入APNs推送唤醒机制,确保iOS节点在后台也能被可靠唤醒。

2月21日:手表端操作可通过桥接机制无缝传递到iOS主应用处理;同时优化了Talk Mode,当输出路由为内置扬声器时自动禁用语音打断,大幅减少本地TTS回放造成的误触发。

从2月初的alpha试水到月末的功能基本齐备,OpenClaw正在从「跑在Mac mini上的服务端程序」延伸为覆盖桌面、手机、手表的全场景智能体平台。

嵌套「子智能体」解锁复杂任务

对于试图构建复杂AI工作流的开发者而言,子智能体(Subagents)体系的成熟是本月最核心的架构突破。

2月15日:首次引入嵌套子智能体,即子智能体可以再生成自己的子智能体(sub-sub-agents)。

系统通过maxSpawnDepth参数控制深度,限制每个智能体最多生成5个子节点,并加入了深度感知的工具策略和announce链路由。

2月21日:默认生成深度策略稳定为maxSpawnDepth=2,意味着一层编排器默认即可生成子智能体。

上下文溢出时的自动截断和恢复机制也已就位——当子智能体的工具输出超出上下文窗口时,系统会预先截断过大的输出并压缩最早的工具结果消息,引导模型用更小的分块重新读取,避免简单粗暴地崩溃。

这套体系让OpenClaw具备了处理多层级复杂任务的能力,例如让一个主智能体分派多个子任务,每个子任务又可以按需拆分,形成树状执行结构。

Discord

多智能体协作的主阵地

Discord是OpenClaw社区最活跃的渠道之一,二月的更新让它的体验发生了质变。

2月13日:支持发送带波形预览的语音消息。

2月15日:里程碑版本,解锁Components v2。按钮、下拉选择菜单、模态框等原生交互组件首次可用于AI智能体的对话界面,智能体可以向用户展示结构化的交互选项,不再只能依赖纯文本。

2月17日:可复用交互组件上线,按钮和选择菜单在过期前可被多次使用;新增per-button的用户允许列表,控制谁能点击特定按钮。

2月21日:加入语音频道的加入/离开/状态控制(通过/vc命令),支持自动加入配置以实现实时语音对话;流式预览回复和生命周期状态反应表情同步上线;子智能体会话可以绑定到特定Discord线程。

这些功能叠加之后,OpenClaw在Discord上的表现不再像一个简单的聊天机器人,而更接近一个具备完整交互能力的AI原生应用。

头部大模型全面集结,践行模型中立

作为更新的一个重要方面,OpenClaw二月接入模型的版图也在迅速扩张:

2月6日:支持Anthropic Opus 4.6(前向兼容)和xAI Grok。

2月9日:Grok网页搜索能力上线。

2月13日:接入Hugging Face Inference和vLLM,含引导流程和默认模型选择。

2月17日:支持Anthropic Sonnet 4.6;上线Anthropic 100万token上下文beta(通过model params.context1m: true开启)。

2月21日:接入Google Gemini 3.1 Pro预览版。

OpenClaw的模型中立策略正在快速兑现——用户可以根据任务需要在Claude、GPT、Gemini、Grok等模型间灵活切换。

细节打磨:更新流式体验与底层可靠性

除了宏观架构的演进,OpenClaw对于一些关键的细节问题也进行了相应更新。

Slack原生流式输出

Slack端在2.17版迎来一项重要体验改善:引入chat.startStream/appendStream/stopStream的原生单消息流式输出,彻底告别了此前通过反复编辑消息来模拟「打字中」效果的笨拙方式。

流式输出默认开启,失败时自动回退到普通投递,回复线程行为与replyToMode配置保持一致。

定时任务大修

主要包括那些容易被忽视但极为实用的改动。

在2.12版集中解决了一批长期困扰用户的问题:

防止重复触发、隔离调度器错误(一个坏任务不再拖垮所有任务)、修复一次性at任务在重启后重复执行、新增webhook投递和认证令牌支持。

2.14版又加入了Telegram话题的精确投递和身份保持。

对于依赖OpenClaw进行定时自动化的用户来说,这些看似琐碎的修复直接关系到系统能否可靠运行。

消息投递可靠性

2.13版加入了写前投递队列(write-ahead delivery queue),网关重启后不再丢失未发送消息。

跨平台(iMessage、Telegram、Matrix等)的回复线程路由得到统一修复,分块消息不再频繁「跳出」主线程。

一场40万行代码的攻防战

狂欢背后,OpenClaw正面临着严峻的安全考验。Karpathy在兴奋之余也坦言了自己的极度不安:

我确实对跑OpenClaw这事有点不太放心——把我的私密数据/密钥交给一个40万行、基本「全靠感觉写出来」的巨兽代码库,而且它还在被大规模盯着打……这感觉完全是个蛮荒西部,是一场安全噩梦。

事实证明了他的担忧绝非杞人忧天。