图灵奖得主理查德·萨顿:大模型只是一时狂热DeepTech深科技

近日,图灵奖得主理查德·萨顿(Richard Sutton)以远程连线的方式,在洛杉矶加州大学(UCLA)的纯粹与应用数学研究所(IPAM,Institute for Pure and Applied Mathematics),发表了这篇名为《AI 的未来》(The Future of AI)的最新演讲。

萨顿是强化学习(Reinforcement Learning,RL)领域的奠基人之一,与长期合作者 Andrew Barto 共同获得 2024 年 ACM 图灵奖(ACM A.M.Turing Award),获奖理由是“发展了强化学习的概念和算法基础”。两人合著的教科书《Reinforcement Learning:An Introduction》至今仍是该领域的标准参考书,被引用超过 75,000 次。

萨顿目前是加拿大阿尔伯塔大学计算科学教授、阿尔伯塔机器智能研究所(Alberta Machine Intelligence Institute,Amii)首席科学顾问,同时也是 John Carmack 创立的 Keen Technologies 的研究科学家,这家初创公司的目标是在 2030 年前实现通用人工智能的“生命迹象”。他还创办了 Openmind Research Institute,致力于为年轻研究者提供探索智能基础问题的空间。

在多次公开场合,萨顿对 AI 末日论者的态度都相当直白。2025 年初获奖后接受 BetaKit 采访时,他说:“末日论者越界了,那些担忧被过分夸大了。”他估计到 2030 年创造出类人智能的概率是四分之一,到 2040 年则是一半对一半。对大型语言模型的前景,他同样不太乐观,曾明确表示 LLM “并不在通往真正智能的道路上”。2025 年 6 月在新加坡国立大学的演讲中,他预测大语言模型终有一天会被视为“世界的一时痴迷”,相比之下,基于经验学习的 AI 系统才代表着真正的未来。

这场 IPAM 演讲的内容,与他在 2025 年 5 月 Amii 的 Upper Bound 大会、同年 6 月新加坡国立大学 NUS120 讲座系列等场合的演讲一脉相承,核心论点始终是同一套:人类数据时代正在触顶、经验时代即将开启、去中心化合作优于集中控制、AI 是宇宙进化的必然环节。这些观点在 AI 学术界和产业界引发了广泛讨论,尤其是他将 AI 安全运动类比为对人的集中控制,在安全研究社区中不乏争议。但无论你是否认同他的政治立场,他对 AI 科学现状的那句诊断——“理解太少、调参太多”——恐怕很难轻易反驳。

以下是该演讲的完整编译。

大家好,很高兴能跟你们在一起,虽然只是隔着屏幕。我今天上午看了一些早场的演讲,有些话本来没打算说,但听完之后觉得有必要先讲几句,算是临时加的开场白。

所有人现在都觉得 AI 在飞速进步,一切都令人兴奋。但当所有人都在想同一件事的时候,我们得停下来问一句:真的是这样吗?

语言能力方面确实有真突破,这没问题。我们不久前还很难想象神经网络能把语言运用得这么好,但事实证明确实可以。我们也在用海量算力来生成逼真的图像和视频。可说实话,智能需要生成图像吗?不需要。我们需要处理图像、处理视频,但我们从来不需要生成它们。生成图像和视频不是心智的本职工作,它需要巨大的计算量,很难做,但它本质上并不属于我们通常所说的“智能”的范畴。

那些真正带来巨大经济价值的新应用,绝大多数是超大规模计算和超大规模模式识别的产物。它们是非常特定的能力,并不等同于智能的全部。很多东西只是计算,我们管它叫“智能”,不过是因为这样听起来更重要罢了。

所以我不得不问:作为一门科学,AI 真的在快速进步吗?

我个人的看法是:进步不大。说个可能不是很谦逊的看法,当前 AI 的背后,理解很少,调参很多。我们还不知道心智的原理,不知道智能的原理。作为一门科学,它在很多方面是令人不满的。我倾向于这样看待现在的 AI 模型:它们之所以强大,是因为汲取了全人类的知识;但除此之外,它们是弱的。它们是弱心智,不可靠,容易跑题,会东拉西扯。除了拥有大量知识这一点,它们一点也不强大。

这或许是一个理解今天所谓“AI”的不同视角。

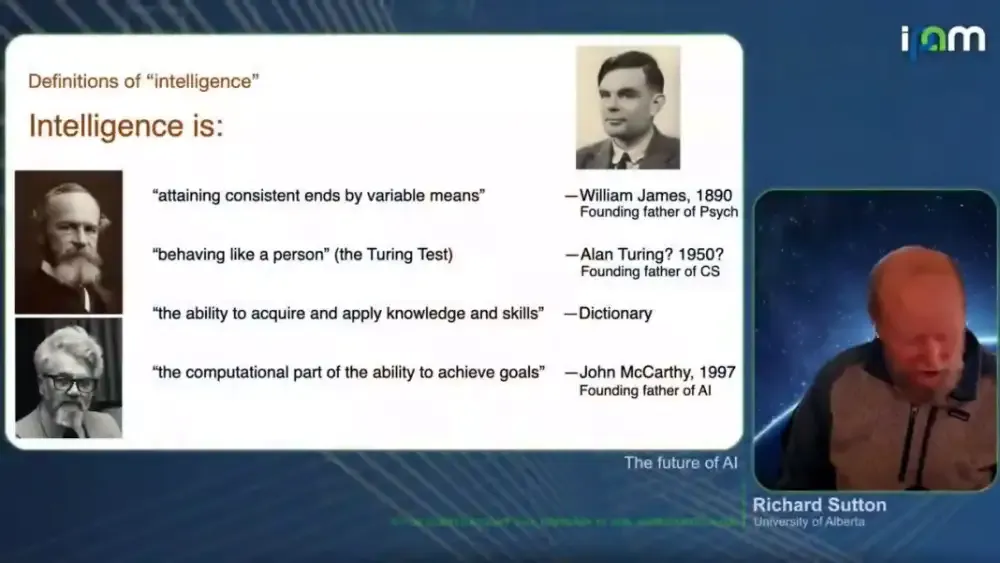

那么智能究竟是什么?这些年有过很多定义。我来列几个有分量的。

最古老的一个可能要追溯到心理学的鼻祖之一威廉·詹姆斯(William James)。1890 年,他没有直接谈“智能”,而是谈“心智”。他说心智的标志是“以变化的手段达成一致的目标”(attaining consistent ends by variable means)。手段可以变化,但结果保持一致,大概就是你想要的东西。

艾伦·图灵(Alan Turing)呢?他其实没有给出一个简洁的定义,但后来被解读为:智能基本上就是表现得像一个人。我们现在用“图灵测试”来形容模仿和冒充一个人。但图灵自己从来没管它叫“图灵测试”,我觉得他也没管它叫“测试”,他管它叫“模仿游戏”(imitation game)。那是一种方式,不是一项考试。不过现在大家已经把“表现得像人”当成了智能的一个重要含义。我对此有异议。人之所以强大,是因为人有智能,所以我们盯着“像人一样行为”看,但真正重要的是:人之所以是人的那个东西到底是什么?

如果你去查字典,字典会告诉你:智能是获取并运用知识和技能的能力。我觉得这个定义其实相当不错。它的核心是知识,获取知识、拥有知识,再加上技能。

AI 领域的一位鼻祖约翰·麦卡锡(John McCarthy)给了另一个定义:智能是达成目标的能力中属于计算的那个部分。我特别喜欢这个定义。你注意看,它说的是“计算的那个部分”,你达成目标并不是因为你更强壮或者传感器更好,而是因为你做了某种心理上的计算。然后“达成目标”是核心中的核心。这跟 William James 说的一脉相承。

(来源:Youtube)

我自己也忍不住跳进来凑了一个定义:智能是通过调适行为来达成目标的能力。跟麦卡锡的差别可能就在“调适”(adapting)这个词。我想强调的是学习的重要性,知识和技能的获取过程本身尤其关键,而不仅仅是拥有它们。

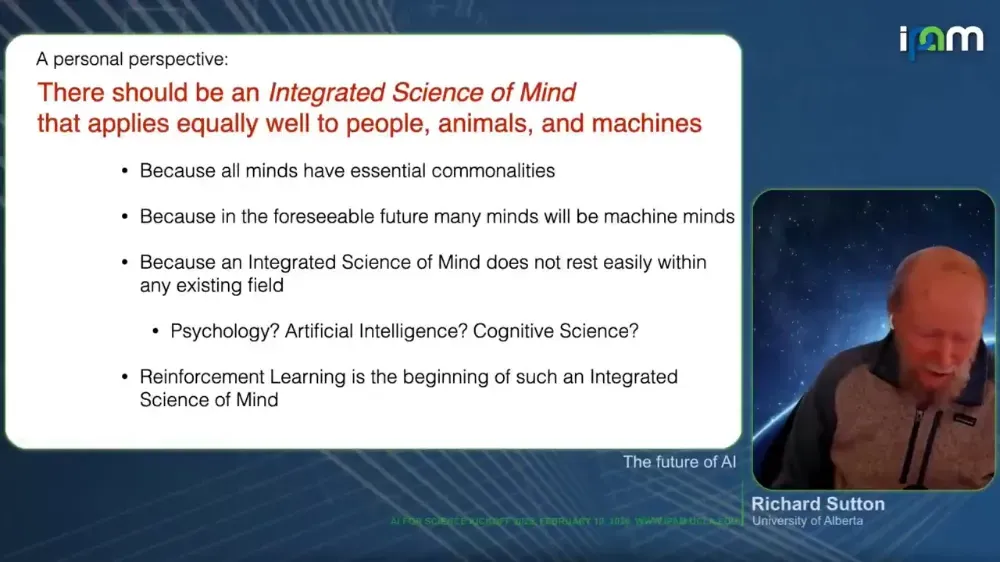

如果你把这些定义叠放在一起看当下的 AI,会发现现代 AI 的主流路线核心是计算和模式识别,很大程度上是在模仿人的行为。但在我个人的视角里,我认为应该有一门新的学科,一门关于心智的统合科学(integrated science of mind),对人、对动物、对机器同样适用。所有这些心智都有本质的共性。人和动物的心智非常相似;机器心智至少在可预见的将来,我们有理由期望它也共享某些本质特征。

(来源:Youtube)

可惜目前没有哪个现成的学科能自然地承担这个角色。心理学本来有可能成为心智科学,但它越来越把自己定义为研究自然心智,即人和动物的心智,而不包括心智“可能是什么”这个更广泛的问题。人工智能关注的是机器,但它已经变得非常工程化,重点在于制造东西,而不是真正理解它,也不怎么关心自然心智。认知科学则漂移到了好几个方向上去了。

不过,我从事的强化学习(Reinforcement Learning,RL),或许是这门统合心智科学的一个开端。因为它确实跨越了很多领域。

什么是强化学习?简单说就是面向智能体的学习,从经验中学习,与环境交互来达成目标。在这些层面上,它比其他类型的机器学习更贴近现实、更有雄心、也更自主,因为智能体在外面行动,不一定有人帮忙。动物在成年以后也没有什么特别的外部帮助,对吧?所以强化学习的核心是带有延迟反馈的试错学习,你最终得到的只是一个奖励信号,告诉你有没有得到你想要的东西。

这是最接近自然学习的机器学习方式。它能自己判断自己是对是错。大语言模型没有任何办法判断自己说的话对不对。但如果你从经验中学习,如果你做了一个关于未来的预测,你可以观察实际发生了什么、验证对错。如果你采取行动并获得奖励,你就能判断自己的行为方式是好是坏。

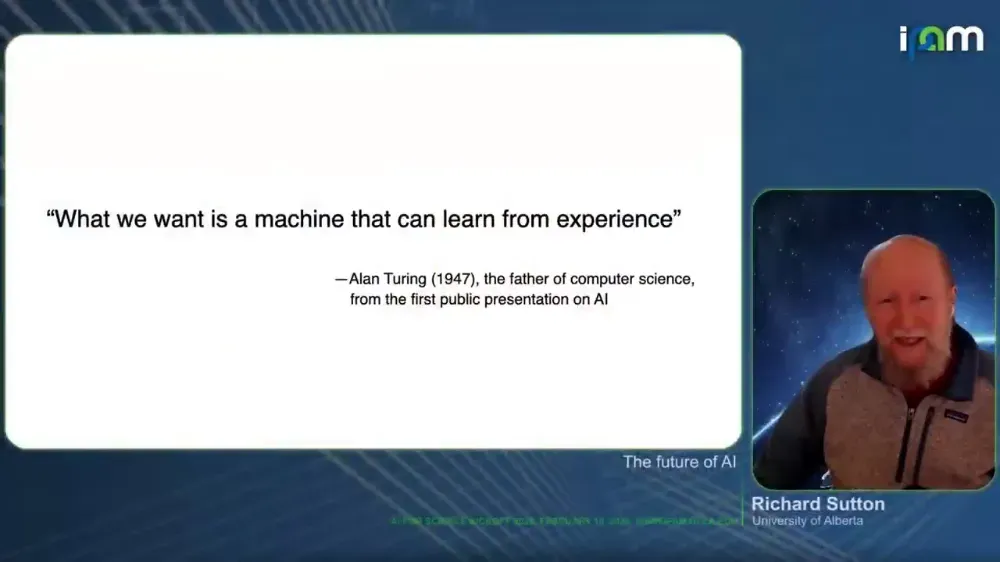

这里我想引用一段图灵的话(What we want is machine that can learn from experience),他自己大概没意识到他其实是一个强化学习学者。这段话出自 1947 年,比强化学习、甚至比 AI 作为一个领域正式存在都要早得多。据我们所知,那是世界上第一次关于人工智能的公开演讲。

(来源:Youtube)

好了,感谢大家听完这段“前菜”。进入正题。

我今天想传达的第一个要点是:当前 AI 的科学趋势在哪里?主要信息是,我们正处在一个“从人类数据中训练”的时代。今天所有的 AI,核心训练方式要么是预测人类在互联网上写下的下一个词,要么是按照人类标注图片的方式去预测标签,然后再由人类专家进行微调。所有这些现代机器学习的目的,都是把人类已有的知识转移到机器里去。转移完成之后,机器就冻结了,不再学习。

这就是我们所处的时代。而我认为我们正在逼近这个时代的天花板。原因很简单:人类数据快用完了。高质量的来源,如整个互联网上的文字、图片和视频等,基本已经被消耗殆尽。这种方法的根本局限在于:它无法学到任何真正新的东西,无法产生真正的新知识。就像陶哲轩所说的,AI 在解决最困难的问题方面,那些需要真正原创性的问题,它依然没有实质性进展。因为它的底层逻辑就是去看互联网上人类已经说过的话,然后做总结归纳。

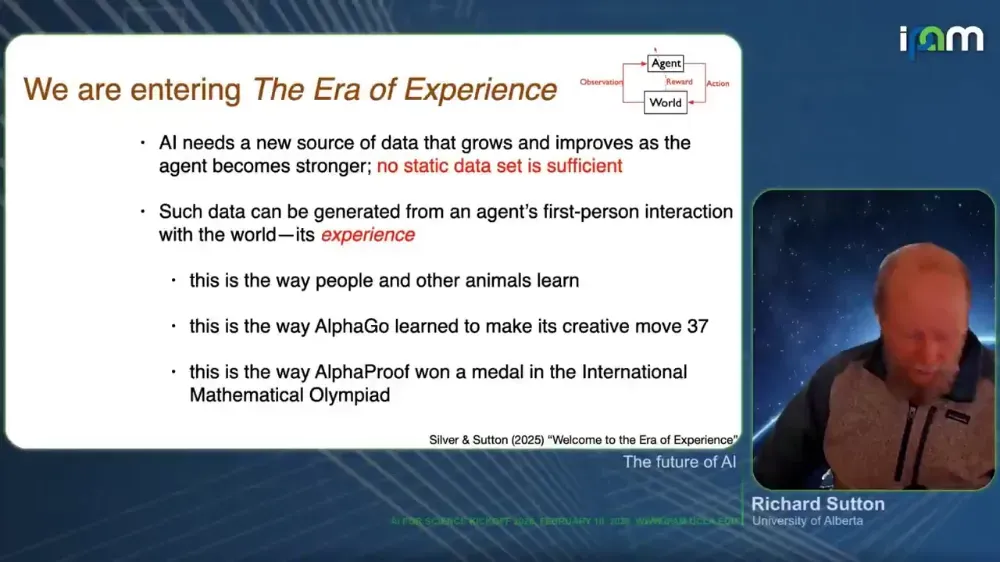

所以真正的前进方向,也是我认为我们正在进行的,是从经验中学习的新时代。因为我们最终需要一个数据源,它能够随着智能体变得更强而同步增长和改善。任何静态数据集都永远不可能胜任这个要求。而你可以从你的经验中获得这样一个不断变化的数据集。这正是人类和动物学习的方式。这也是 AlphaGo 学会那步创造性的第 37 手的方式(编注:2016 年,DeepMind 的 AlphaGo 在与李世石的对弈中下出了被专业棋手称为“百年一遇”的第 37 手,据 DeepMind 事后披露,AlphaGo 曾评估该走法的概率仅为万分之一,但最终通过自我博弈的强化学习选择了它。),也是很多在数学奥林匹克竞赛中获胜的 AI 系统的工作方式。

(来源:Youtube)

我之前播放过一段加速过的婴儿视频,展示一个婴儿在玩具堆里探索。他不会只摆弄一个玩具,他玩一个,觉得腻了,就换一个。每次接触一个玩具,他就学到他能学到的东西,也许只是发现一根绳子可以拉、可以放进嘴里。然后他就换到下一个。这就是我们的数据,生命的数据由我们的行为产生,它不是别人提供给我们的。正因为它由行为产生,它可以自动匹配我们当前的理解水平和能力水平。

还有另一段智能体在迷宫中学习的视频。这是一个非常非常简单的智能体,它要从起点 S 走到目标 G,它唯一知道的就是自己在哪个格子里,它能做的动作只有四种,上、下、左、右。但它能学出一条好的路径。画面中箭头显示的就是它认为的正确方向,绿色深浅代表它认为每个状态有多好。