北大首次让AI能够生成真实火焰新智元

北京大学陈宝权教授团队提出 FieryGS,被 AI 顶会 ICLR 2026 接收。该框架将多模态大模型、燃烧物理仿真与 3D 高斯溅射深度融合,首次在真实 3D 重建场景中实现了物理可信、语义感知且可控的火焰合成,推动数字孪生从「静态重建」迈向「动态物理」。

在通往「空间智能」与「世界模型」的征途上,如何让计算机不仅能以高保真度「重建」静态的三维孪生世界,更能深刻「理解」并精准「预测」其中的物理动态,一直是计算机图形学与人工智能领域的重要研究挑战。

近日,北京大学智能学院陈宝权教授团队的最新研究成果 FieryGS: In-the-Wild Fire Synthesis with Physics-Integrated Gaussian Splatting 被人工智能顶会 ICLR 2026 接收。

这项工作并非视觉层面的简单合成,而是另辟蹊径,构建了一套将多模态大模型(MLLM)的语义理解能力、燃烧动力学物理仿真与 3D 高斯溅射(3DGS)渲染技术深度耦合的框架,首次在真实世界的 3D 重建场景中,实现了物理可信、语义感知且高度可控的燃烧合成。

01. 挑战:当「静态重建」遇上「动态物理」

随着 3D Gaussian Splatting(3DGS)技术的发展,我们已经能够以惊人的速度和照片级的保真度将现实世界数字化。

然而,现有的 3DGS 重建场景本质上是「冻结」的数字孪生——它们拥有精细的几何与纹理,却严重缺失像物理世界那样交互和演化的能力。

当我们试图在这些场景中模拟「起火」这样复杂的物理现象时,往往面临着不可调和的技术矛盾。

一方面,传统的图形学流程(如基于 CFD 的流体动力学与 VFX 特效软件)虽然遵循严谨的物理定律,但其应用门槛极高。

它们通常要求艺术家对场景进行繁琐的手工网格重建、UV 展开及材质属性标注。

面对大规模、非结构化的、不完整的真实世界扫描数据,这种「手动工坊」式的工作流显然难以扩展。

另一方面,以 Sora、Runway 为代表的视频生成模型虽然能凭空创造出视觉效果炫酷的火焰视频,但其本质仍是基于像素概率的预测,而非对物理过程的模拟。

这些模型往往缺乏对三维几何结构和物理守恒规律的本质理解,极易产生「物理幻觉」:例如,火焰在不可燃的金属表面凭空燃烧,或者在生成过程中扭曲了原本的场景结构。

02. FieryGS:语义感知与物理驱动的新范式

FieryGS 的研究正是为了打破这一僵局。

针对上述挑战,FieryGS 提出了一种「语义感知-物理驱动」的全新思路:与其让 AI 去「猜测」像素的运动,不如让 AI 去「理解」物理属性,进而利用准确的物理方程来驱动生成过程。

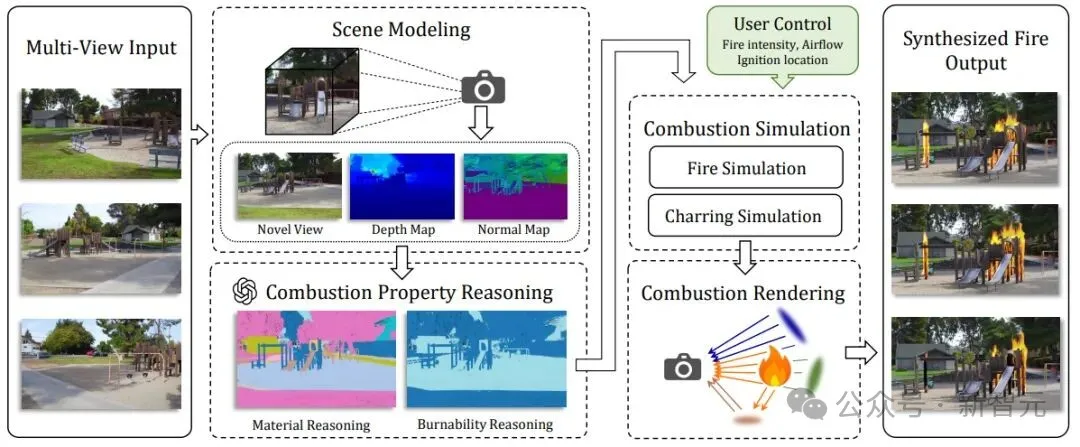

FieryGS 是一套物理集成的 3DGS 框架,其核心在于搭建了一座桥梁,连接了大模型的常识推理能力与传统图形学的物理仿真能力。

系统首先利用多模态大模型(MLLM)作为「物理常识大脑」,对 3DGS 场景进行材质物理属性推断;

随后结合基于欧拉网格的流体力学求解器,驱动火焰与烟雾的演化;

最后通过统一的体积渲染器,输出光影逼真、物理自洽且交互可控的燃烧效果。

其完整技术管线如下图所示:

MLLM 驱动的零样本物理属性推理

要实现符合常识的燃烧,计算机必须具备类似人类的认知能力:「这是什么物体?」「它由什么材质构成?」「它的燃烧特性如何?」。

在 FieryGS 中,静态的 3DGS 场景不再是无意义的点云集合,而是被赋予了丰富的物理语义。