人类画了100年的脑图,AI仅用几小时量子位

好消息,AI也可以帮科学家画脑图了!

近期,一个来自加州大学旧金山分校的神经科学团队提出了一种新的机器学习算法——CellTransformer,仅花费几个小时就完成了对5只小鼠大脑图谱的分类和绘制工作。

这五只小鼠大脑的基因数据中包含1040万个细胞,每个细胞包含数百个基因。但通过这一创新性算法,研究团队不仅清晰地划分出了小鼠大脑内的已知区域,还绘制出了新的脑区。

更夸张的是,这项技术很可能会进一步应用于人类。

画脑图的最新黑科技:CellTransformer

大脑图谱绘制是一门古老的学科,过去画脑图的方法相当复杂,需要科学家用铅笔在脑部图像上画线,连接不同区域。

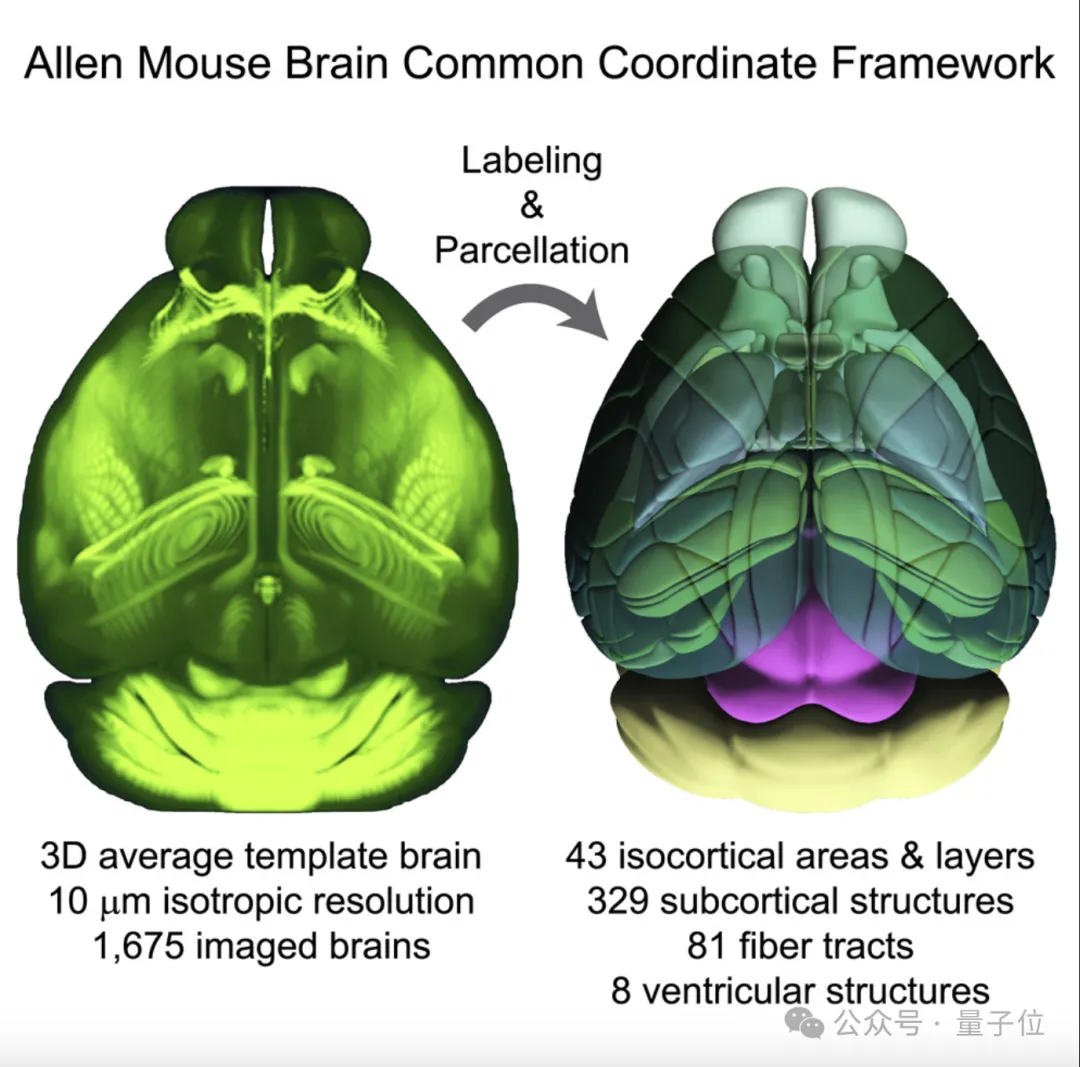

2020年发布的艾伦小鼠脑通用坐标框架(Allen Mouse Brain Common Coordinate Framework),就是采用这种方法画出来的。

这幅脑图基于1675只小鼠的脑部数据,涵盖了1000多个不同的脑区,具有很高的价值。

但这类手工特征很强的图谱也不可避免地存在一个问题:具有主观性。

宾夕法尼亚州立大学医学院的神经解剖学家金永洙(Yongsoo Kim)表示,当他向资深专家请教如何画脑图时,对方往往只有一句话:“这都是我脑子里的。”

不过,今时不同往日。来自加州大学旧金山分校的Reza Abbasi-Asl和他的团队提出了一套名为CellTransformer的编码器-解码器架构,仅花费几个小时便能完成这项工作。

CellTransformer的工作原理是这样的:

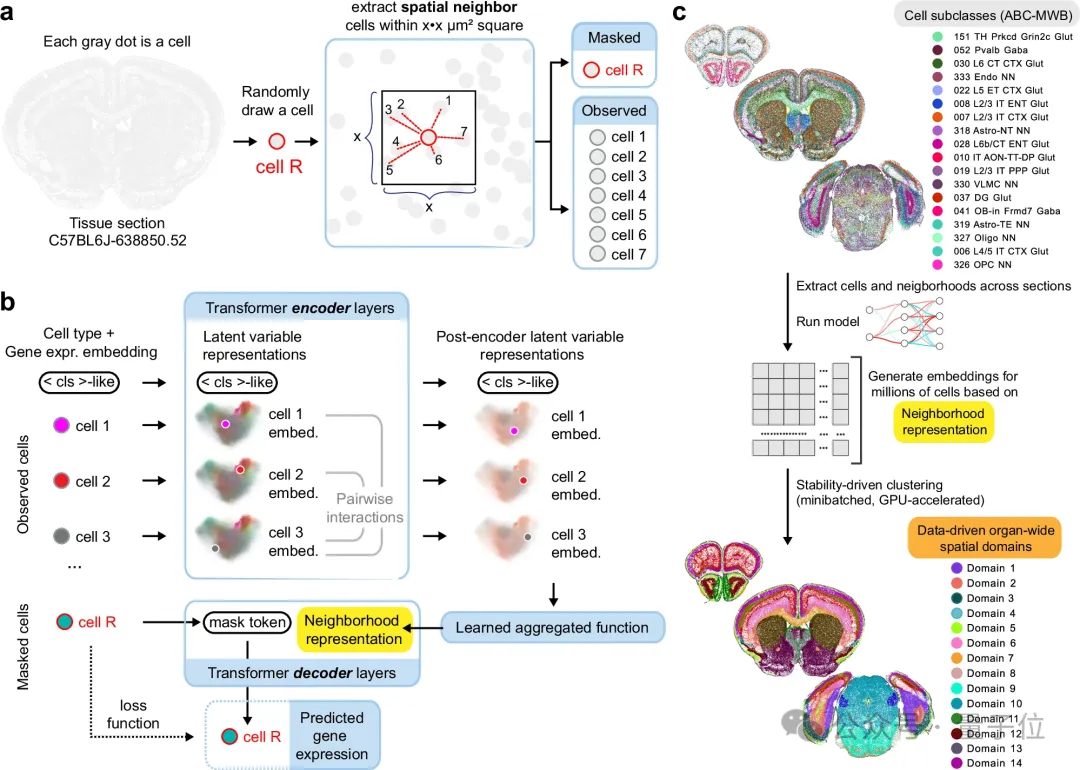

随机遮住一个细胞的身份和基因表达,让模型根据邻居细胞来预测它,预测错了就更新,重复几百万次。

具体来说,研究人员会先给每一个细胞划定一个“邻域”——以它为中心,在一定微米距离内的所有细胞,都会被纳入观察范围。这样模型在同一时间里,既能看到细胞之间的空间结构,又能看到它们在分子层面的差异。

在这个邻域里,每一个细胞都会被当作一个token,就像语言模型里的一个词。

CellTransformer使用Transformer的自注意力机制,让这些细胞彼此“交流”:模型会自动学习,哪些细胞之间的关系更重要,哪些邻居对当前细胞的影响更大。

训练时,研究人员采用一种非常巧妙的自监督方式。模型会随机选中一个细胞,把它的基因表达信息“遮住”,只保留它的细胞类型标签,然后让模型根据周围邻居的情况,去预测这个细胞原本应该表达哪些基因。

在内部结构上是这样的:

通过多层Transformer编码器架构,模型会让邻域内所有细胞的信息充分交互。

随后,它会把这些细胞的表示通过一个学习得到的池化操作压缩成一个向量,用来代表整个邻域的“组织环境”。

接下来,模型再结合被遮住细胞的类型信息,通过一个较浅的解码器,反推出该细胞的基因表达分布。

最后,研究人员为每一个细胞提取一个“邻域表示向量”,把所有细胞、所有切片的这些向量拼接在一起,再用k-means等聚类方法进行分析,脑区就会“自己浮现出来”。

已知的功能区会自然对齐,而在一些区域中,模型还会进一步拆分出更精细的亚区,甚至发现过去从未被系统标注过的新脑区。

结果有多强?

为了验证CellTransformer的有效性,研究团队在ABC-WMB数据集上进行了系统评估,数据集包含5只小鼠的脑组织数据。

其中一只小鼠由艾伦脑科学研究所使用包含500个基因的MERFISH panel 进行处理,并采集了53个冠状切片;其余四只小鼠的数据来自艾伦小鼠脑通用坐标框架的研究,并使用包含1129个基因的panel进行采集。

首先,效率太高了。CellTransformer在数小时内完成了对5只小鼠、1040万个细胞的空间组织建模,这是传统方法在时间和规模上都无法企及的。

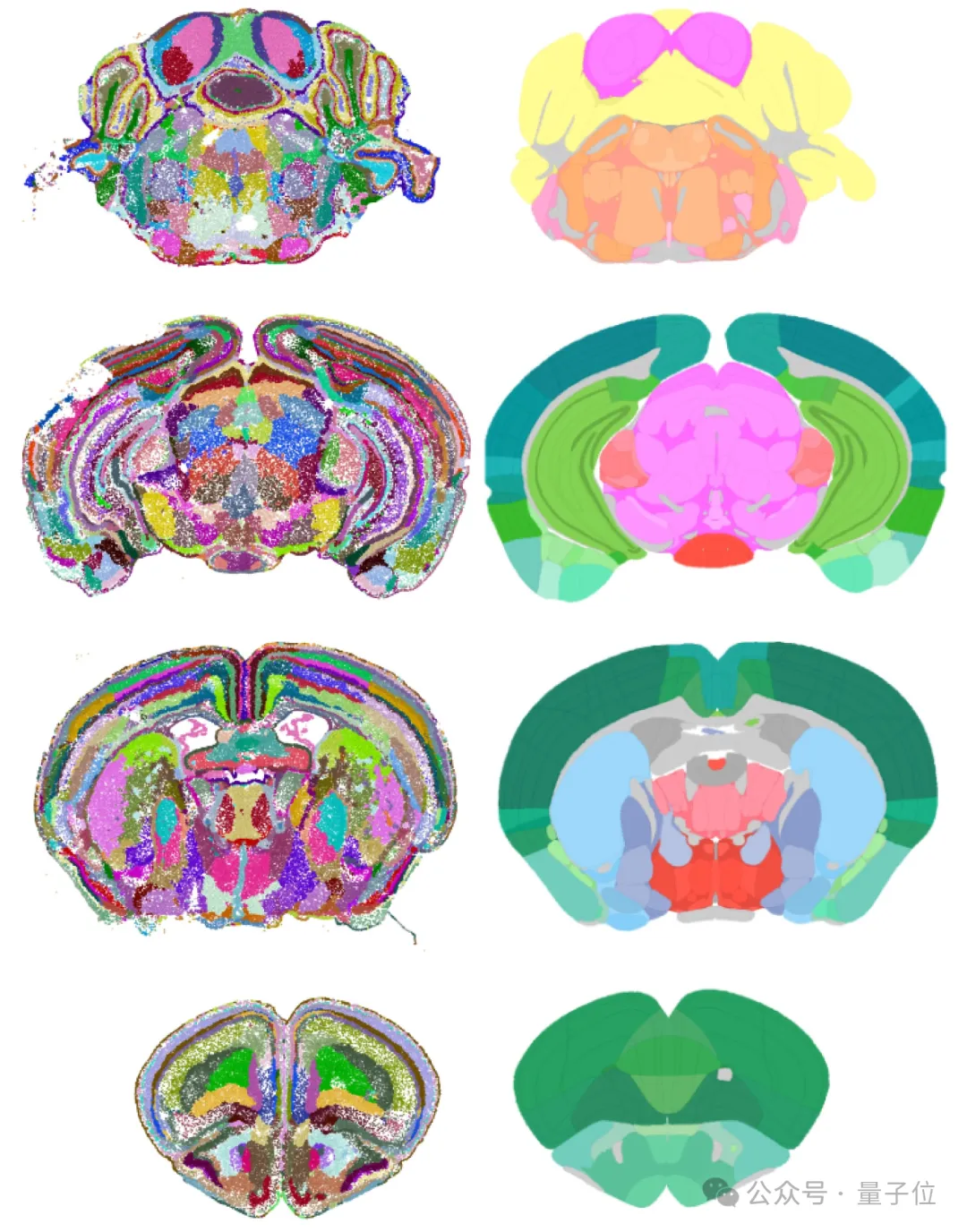

其次,准确对齐已知的脑结构分区。CellTransformer能够在小鼠大脑中定义25到1300个神经区域,并且在完全不使用脑区标签的情况下,高度对齐已知的解剖结构和功能分区。

由于CellTransformer利用其预测结果对细胞进行分组,不会生成全新的脑图,所以也不存在幻觉问题。

研究团队重新采用了手绘的艾伦小鼠脑通用坐标框架,将CellTransformer的输出与其进行比较,发现两者吻合良好,展现了相似的结构,连皮层中的层级结构也能做到一致。

上面这张图中,左边是CellTransformer绘制的小鼠脑图,右边是人类科学家利用艾伦小鼠通用坐标框架绘制的小鼠脑图。两者都定位了大脑中1000多个细胞亚区,但AI发现得更多。