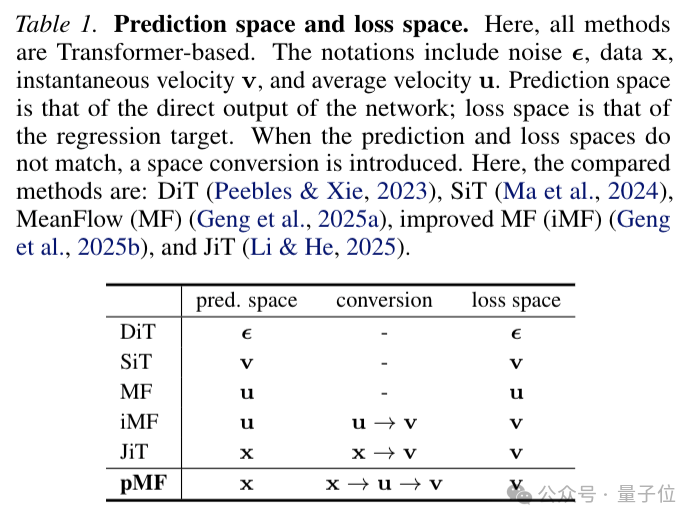

何恺明带大二本科生颠覆扩散图像生成量子位

何恺明,再次出手精简架构。新方法Pixel Mean Flow(pMF),突破传统扩散模型/流模型限制。

两大传统组件多步采样和潜空间都被砍了,现在只需一步,直接在像素空间生成图像。

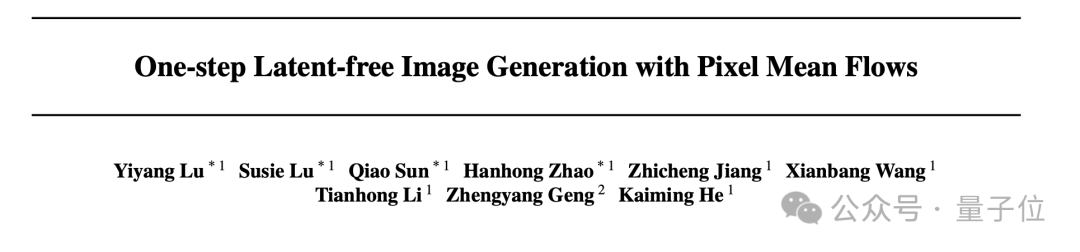

在ImageNet 256×256分辨率上,pMF达到了2.22 FID;512×512分辨率上则是2.48 FID。这是目前单步、无潜空间扩散模型在该基准上取得的最佳成绩之一。

砍掉扩散模型的两大件

现代扩散模型生成图像,一直离不开多步采样和潜空间编码。

多步采样意味着生成一张图需要跑几十甚至上百次神经网络,潜空间则需要先把图像压缩到一个低维空间再进行操作。两者的共同目的是把一个极度复杂的生成问题拆解成若干个相对简单的子问题。

近年来,研究社区分别在这两个方向上取得了进展:

一致性模型(Consistency Models)和何恺明团队2025年提出的MeanFlow在少步、单步采样上持续突破。

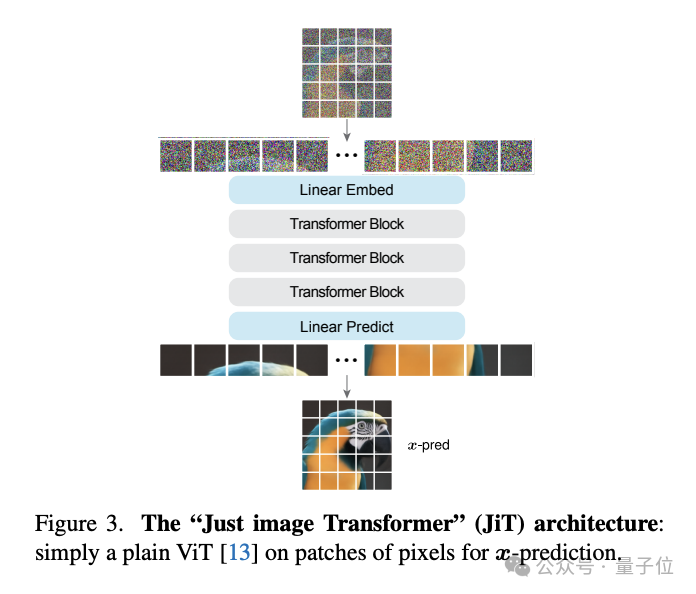

何恺明团队2026年1月提出的JiT(Just image Transformers)则证明了在原始像素空间做扩散模型的可行性。

但把这两条路合到一起,难度陡增。

少步模型要求单个网络能够处理不同起点和终点的轨迹;像素空间模型则需要在没有预训练tokenizer的情况下完成压缩和抽象。

两边的挑战叠加在一起,对架构设计提出了更高的要求。

pMF的核心设计

pMF的思路可以概括为:

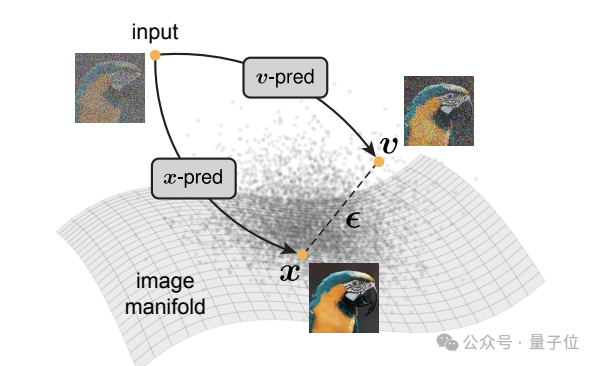

网络直接输出像素级别的去噪图像,但训练时用速度场来计算损失。

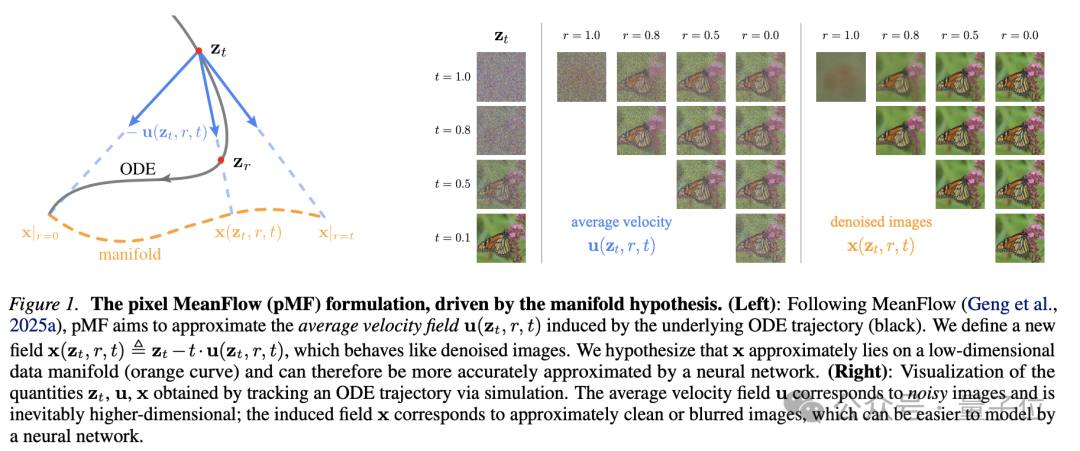

具体来说,pMF定义了一个新的场x,它是从平均速度场u通过简单变换得到的。

x场的关键特性是看起来像干净的图像。

论文通过追踪ODE轨迹进行可视化发现,平均速度场u对应的是噪声图像,而变换后的x场则对应近乎干净或略微模糊的图像。

这背后的假设是流形假设(manifold hypothesis):自然图像实际上位于一个低维流形上,让网络直接预测这个低维流形上的量,比预测高维噪声空间中的量要容易得多。

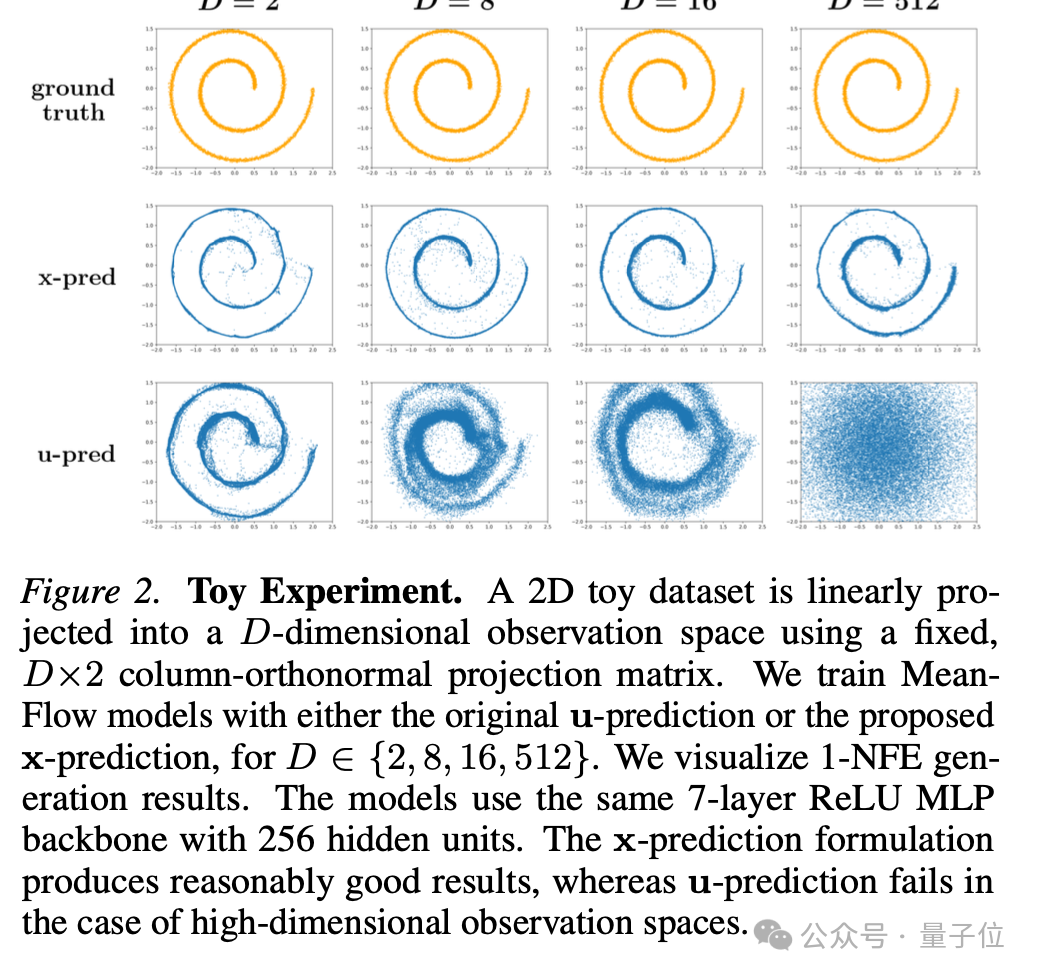

团队用一个2D玩具模型验证了这一点。

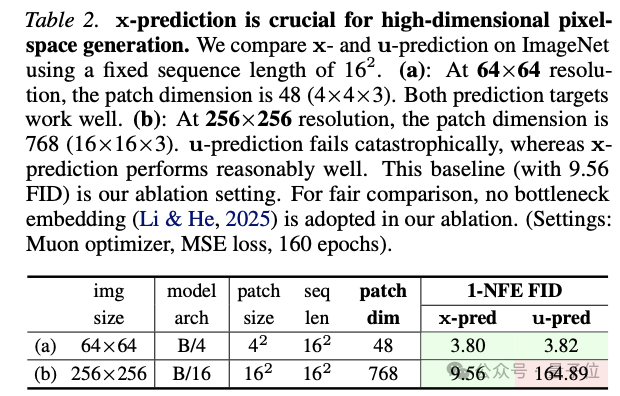

当把2D数据投影到512维观察空间时,传统的u-prediction直接崩溃,而x-prediction仍然能够正常工作。

在真实的ImageNet实验中也是如此:256×256分辨率下,patch维度达到768(16×16×3),u-prediction的FID直接飙到164.89,而 x-prediction则保持在个位数。

pMF还有一个独特优势:

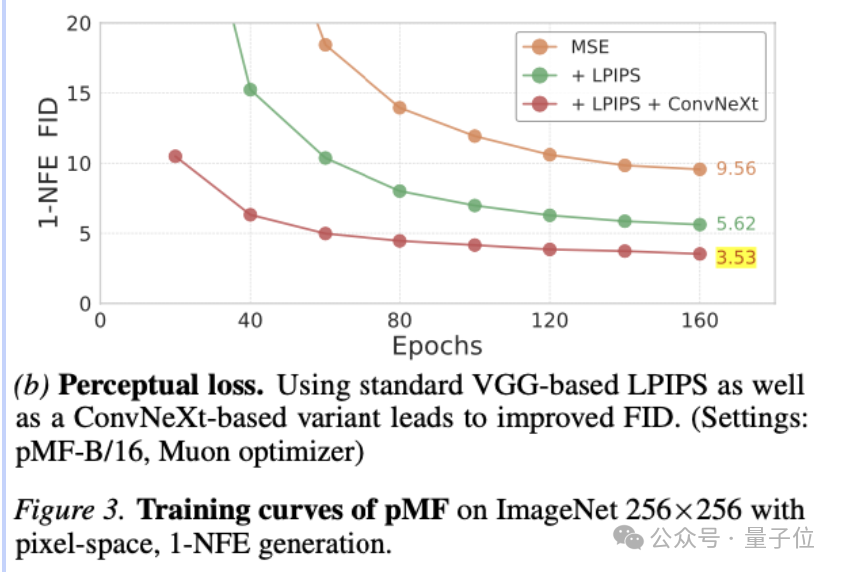

因为网络直接输出像素图像,可以自然地使用感知损失(perceptual loss)。

这本是潜空间方法在训练VAE时才能用的技巧,pMF把它带到了生成器本身的训练中。实实验显示,加入感知损失后,FID从9.56直接降到3.53,提升了约6个点。