天下苦CUDA久矣,又一国产方案上桌了量子位

国产算力基建跑了这么多年,大家最关心的逻辑一直没变:芯片够不够多?

但对开发者来说,真正扎心的问题其实是:好不好使?

如果把AI开发比作做饭,现在的尴尬是——国产锅(硬件)虽然越来越多了,但大部分大厨还是只习惯用那套进口调料包(生态)。

这正是当下AI落地最真实的一幕。

模型层繁花似锦,底层却隐忧重重。大家在参数规模上轮番刷新纪录,回过头来却发现,最难摆脱的还是那套已经长进骨子里的开发流程。

△图片由AI生成

算力只是敲门砖,真正的胜负手,是那段算法与硬件之间的“翻译权”。

说白了,如果拿不到这支“翻译笔”,再强悍的国产硬件,也只能像是一座无法与外界沟通的孤岛。

终于,那个让开发者喊了无数次“天下苦CUDA久矣”的僵局,现在迎来了一个不一样的国产答案。

KernelCAT:计算加速专家级别的Agent

这几年,AI领域的热闹几乎是肉眼可见的。

模型在密集发布,应用数据持续走高,看上去一切都在加速向前。

但在工程现场,感受却更复杂。

真正制约落地效率的,并不是模型能力本身,而是底层软件生态的成熟度。

硬件选择一多,问题反而集中暴露出来:迁移成本高,适配周期长,性能释放不稳定。很多模型即便具备条件切换算力平台,最终也会被算子支持和工具链完整度挡在门外。

这让一个事实变得越来越清晰——突破口不在堆更多算力,而在打通算法到硬件之间那段最容易被忽视的工程链路,把芯片的理论性能真正转化为可用性能。

其中最关键的一环,正是高性能算子的开发。

算子(Kernel),是连接AI算法与计算芯片的“翻译官”:它将算法转化为硬件可执行的指令,决定了AI模型的推理速度、能耗与兼容性。

算子开发可以被理解为内核级别的编程工作,目前行业仍停留在“手工作坊”时代——开发过程极度依赖顶尖工程师的经验与反复试错,周期动辄数月,性能调优如同在迷雾中摸索。

若把开发大模型应用比作“在精装修的样板间里摆放家具”,那么编写底层算子的难度,无异于“在深海中戴着沉重的手铐,徒手组装一块精密机械表”。

但如果,让AI来开发算子呢?

传统大模型或知识增强型Agent在此类任务面前往往力不从心。因为它们擅长模式匹配,却难以理解复杂计算任务中的物理约束、内存布局与并行调度逻辑。

唯有超越经验式推理,深入建模问题本质,才能实现真正的“智能级”优化。

正是在这一“地狱级”技术挑战下,KernelCAT应运而生。

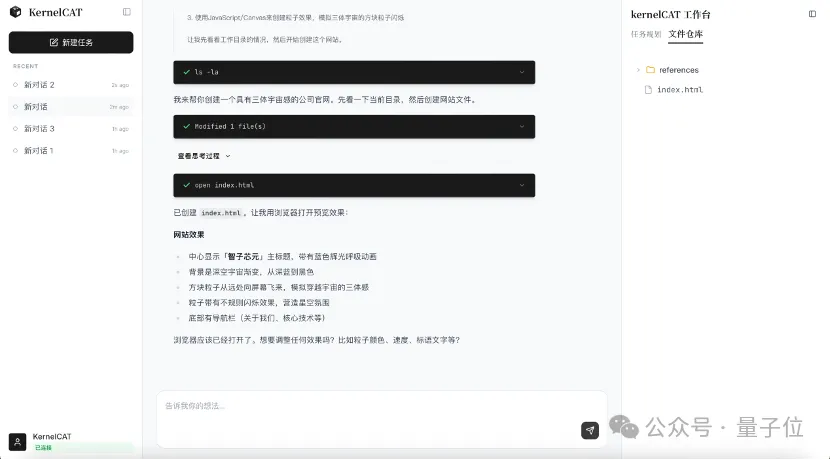

具体来看,KernelCAT是一款本地运行的AI Agent,它不仅是深耕算子开发和模型迁移的“计算加速专家”,也能够胜任日常通用的全栈开发任务,提供了CLI终端命令行版与简洁桌面版两种形态供开发者使用。

不同于仅聚焦特定任务的工具型Agent,KernelCAT具备扎实的通用编程能力——不仅能理解、生成和优化内核级别代码,也能处理常规软件工程任务,如环境配置、依赖管理、错误诊断与脚本编写,从而在复杂场景中实现端到端自主闭环。

为国产芯片生态写高性能算子

在算子开发中,有一类问题很像“调参”——面对几十上百种参数或策略组合,工程师需要找出让算子跑得最快的那一组配置。

传统做法靠经验试错,费时费力,而且还容易踩坑。

KernelCAT的思路是——引入运筹优化,把“找最优参数”这件事交给算法,让算法去探索调优空间并收敛到最佳方案。

以昇腾芯片上的FlashAttentionScore算子为例,KernelCAT在昇腾官方示例代码上,可以自动对该算子的分块参数调优问题进行运筹学建模,并使用数学优化算法求解,在十几轮迭代后就锁定了最优配置,在多种输入尺寸下延迟降低最高可达22%,吞吐量提升最高近30%,而且整个过程无需人工干预。