十年前的百度,聚拢了硅谷最杰出的天才钛媒体

缩放定律(Scaling law)可能是AI时代最重要的“金科玉律”之一。

缩放定律的原出处,是OpenAI的一篇叫做《神经语言模型的缩放定律》(Scaling Laws for Neural Language Models)的论文。

而这篇论文的通讯作者,就是达里奥・阿莫迪,他的另一个广为人知的身份,则是Anthropic的联合创始人。

Anthropic在AI编程领域优势明显,地位隐隐然与OpenAI和Google鼎足而三,刚传出将以3500亿美元估值融资200亿美元的消息。作为联创,阿莫迪当然功不可没。

但很少有人注意到,阿莫迪还有另一个身份----百度前员工。

按照百度内部通讯软件“如流”的分级来看,阿莫迪应该叫“红度阿莫迪同学”。

更有意思的是,在2024年底Amodei在一次播客采访中,阿莫迪透露2014年与吴恩达在百度研究AI的时候,他就已经发现了模型发展的规律缩放定律。

此话一出,掀起了一阵“百度是否比OpenAI更早发现缩放定律”的争论。

Amodei不是个例,在硅谷,“百度”频繁出现在大佬的履历里。

最为人所熟知的是AI学术大牛、斯坦福大学教授、谷歌大脑联合创始人吴恩达,他曾是百度硅谷实验室的“灵魂”。

离职时,他不吝对李彦宏的赞美,称他是“第一个清晰看到深度学习价值的大型公司CEO,也是全球最好的AI CEO之一。他的热情和百度的决心让我觉得这是一个难得的机会”

在Meta,沙兰・纳朗(Sharan Narang)组建并扩展了Llama预训练团队,交付了Llama 2、3和4的预训练模型,奠定了Meta在生成式人工智能领域的领先地位。

而他曾是百度硅谷实验室的高级研究员,离开后先在谷歌当技术主管,后跳槽到Meta。

在苹果,曾担任AI/机器学习相关方向总监的亚当・考特斯(Adam Coates),曾是百度硅谷实验室的早期核心成员之一,跟随师父吴恩达加入,并在后者离开之后接棒。

在英伟达,应用深度学习副总裁布莱恩・卡坦扎罗(Bryan Catanzaro),曾是百度硅谷实验室的高级研究员,专门研究GPU优化。

他们的共同经历,是在十年前的“百度硅谷实验室”效力过。那代表着百度的一次硅谷野心。

01. 硅谷野心

百度请来了“谷歌大脑(Google Brain)之父”,要在硅谷搞一个“百度大脑”,这在当时是爆炸性新闻。

2014年,百度硅谷实验室成立,专注于人工智能与深度学习技术研究,与北京深度学习实验室、大数据实验室共同构成百度研究院核心科研体系,并任命斯坦福大学教授、Coursera联合创始人吴恩达出任首席科学家,负责统筹百度在北京与硅谷两地的人工智能研究工作。

吴恩达是谷歌大脑的早期核心成员之一,也是深度学习从学术走向工业化过程中最具标志性的人物之一。

对一家中国互联网公司而言,在这一时间点、以研究负责人而非顾问的形式,将这样一位学者级人物纳入体系,在硅谷并不多见。

媒体在报道中强调,这是百度在硅谷长期布局人工智能研究的重要一步,并披露百度计划在未来五年内为这一国际研究项目投入约3亿美元,目标是将硅谷团队扩展至约200人规模。

那一年,Transformer架构尚未出现,“大模型”仍是一个不存在的概念。但深度学习的拐点已经到来。

2012年,AlexNet在ImageNet竞赛中取得压倒性优势,卷积神经网络开始从学术论文走向产业实践。

2013年,Facebook请来杨立昆(Yann LeCun),成立Facebook AI Research。

2014年初,谷歌以数亿美元级别的价格收购英国AI公司DeepMind。

人工智能已经不再仅仅是研究热点。

但在当时,这仍然是一条高投入、长周期、结局不明的路线。少数巨头已经开始下注,大多数公司仍在观望。

百度正是在这一阶段选择大胆押注的一方。

彼时,移动端搜索使用量开始超过PC。但移动广告的变现效率明显低于PC,成本结构也更为复杂,这使得公司整体盈利能力承压。

在多次公开场合,李彦宏将这种变化描述为一次结构性的转折。他强调,从PC向移动的迁移并非终点,更大的技术浪潮正在酝酿,而人工智能将深刻改变信息获取与分发的方式。

正是在这样的判断下,百度决定不再只在国内推进应用层改进,而是直接进入全球AI研究最密集的现场----硅谷。

其实早在2011年,百度硅谷研究院就成立了,但主要是将硅谷的中国工程师招募回国。

而吴恩达的加入才是百度卷入硅谷人才争夺核心圈的标志,在那之后,百度的AI研究形成三大实验室----硅谷人工智能实验室(SVAIL)、深度学习实验室(IDL)、大数据实验室(BDL),一个在硅谷,两个在北京,形成了中美两地联动的格局。

推动这次合作的关键人物是吴恩达的老朋友、百度当时负责深度学习研究的高管余凯(Kai Yu)。两人多次在帕洛阿尔托一家喜来登酒店会面,从早餐谈到晚餐,随后余凯又引见了百度的其他研究负责人。

之后,吴恩达飞往北京,与李彦宏进行了一次长达数小时的会谈,讨论百度研究体系未来应当如何搭建。

这并不是一次传统意义上的跳槽谈判。对吴恩达而言,吸引力不在于头衔,而在于空间。

百度为他提供的,是从零设计研究方向、在硅谷搭建国际化团队、并在相对独立的环境中推进长期研究的空间。吴恩达在接受采访时直言,他对“从零开始构建一个国际研究组织”感到兴奋。

对许多研究者而言,这意味着一家中国公司正在以接近Google、Facebook的方式,系统性地参与人工智能基础研究竞争。

02 人来了

吴恩达的存在本身,就形成了一种吸引力。他在斯坦福和谷歌大脑的背景,让不少研究者愿意过来试一试。

实验室早期最重要的工作之一,是语音识别系统Deep Speech。模型要足够大,数据要足够多,训练要持续足够久,人才极其重要。

一批后来在AI世界反复出现的名字聚到了一起。

亚当・考特斯(Adam Coates)是其中的核心人物之一。他本身是斯坦福出身,师从吴恩达,研究背景扎实。他跟随吴恩达加入百度,在实验室里承担的角色,更多是把“研究”变成“能持续推进的工程”。

在工程层面,布莱恩・卡坦扎罗(Bryan Catanzaro)的作用逐渐显现。他从英伟达跳槽过来,关注点在于如何让这些越来越大的模型,真正高效地跑在GPU上。很多时候,瓶颈并不来自算法,而来自系统效率。

格雷戈里・迪亚莫斯(Gregory Diamos)来百度之前,是英伟达CUDA架构师。他在百度对DeepSpeech和DeepVoice系统有贡献,他关注的则是更底层的系统问题:训练过程如何被拆解、调度和优化,如何把高性能计算的思路真正嫁接到深度学习训练中。

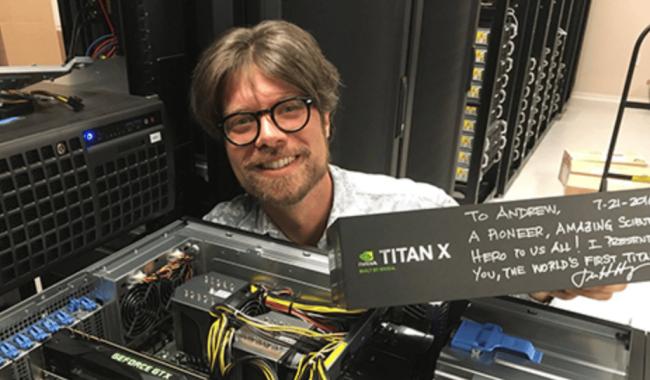

在这些人之间,后来创办Anthropic的阿莫迪当时并不显眼。

他在团队里的身份,只是一名研究科学家,参与模型和系统的实际打磨。但正是在这段经历中,一种后来被反复提及的直觉,逐渐成形。

多年之后,阿莫迪在回顾自己职业路径时提到,他对“规模”的认识,并不是来自某一次灵光乍现,而是来自反复的工程实践。在Deep Speech的实验中,当模型规模、数据量和计算资源被同步放大时,系统性能并不是随机起伏,而是呈现出一种平滑而稳定的提升趋势。

那时,“缩放定律”还没有成为一个被命名的概念,多年后,2024年底,已经是Anthropic创始人的阿莫迪透露此事,引发了“百度是不是先于OpenAI发现缩放定律”的争议。

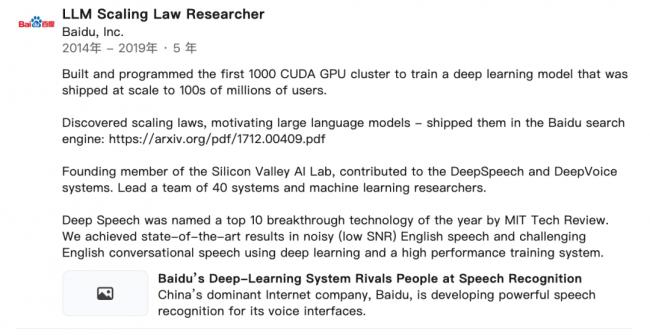

当年在百度观察到类似“缩放定律”的科学家,迪亚莫斯也是其中之一。

到现在他的领英界面上百度那段工作经历里还写着头衔是“大语言模型缩放定律研究员(LLM Scaling Law Researcher)”。

随着项目推进,实验室本身也在变化。