清华学霸、MIT博士加入Thinking Machines水木TsinghuaCent

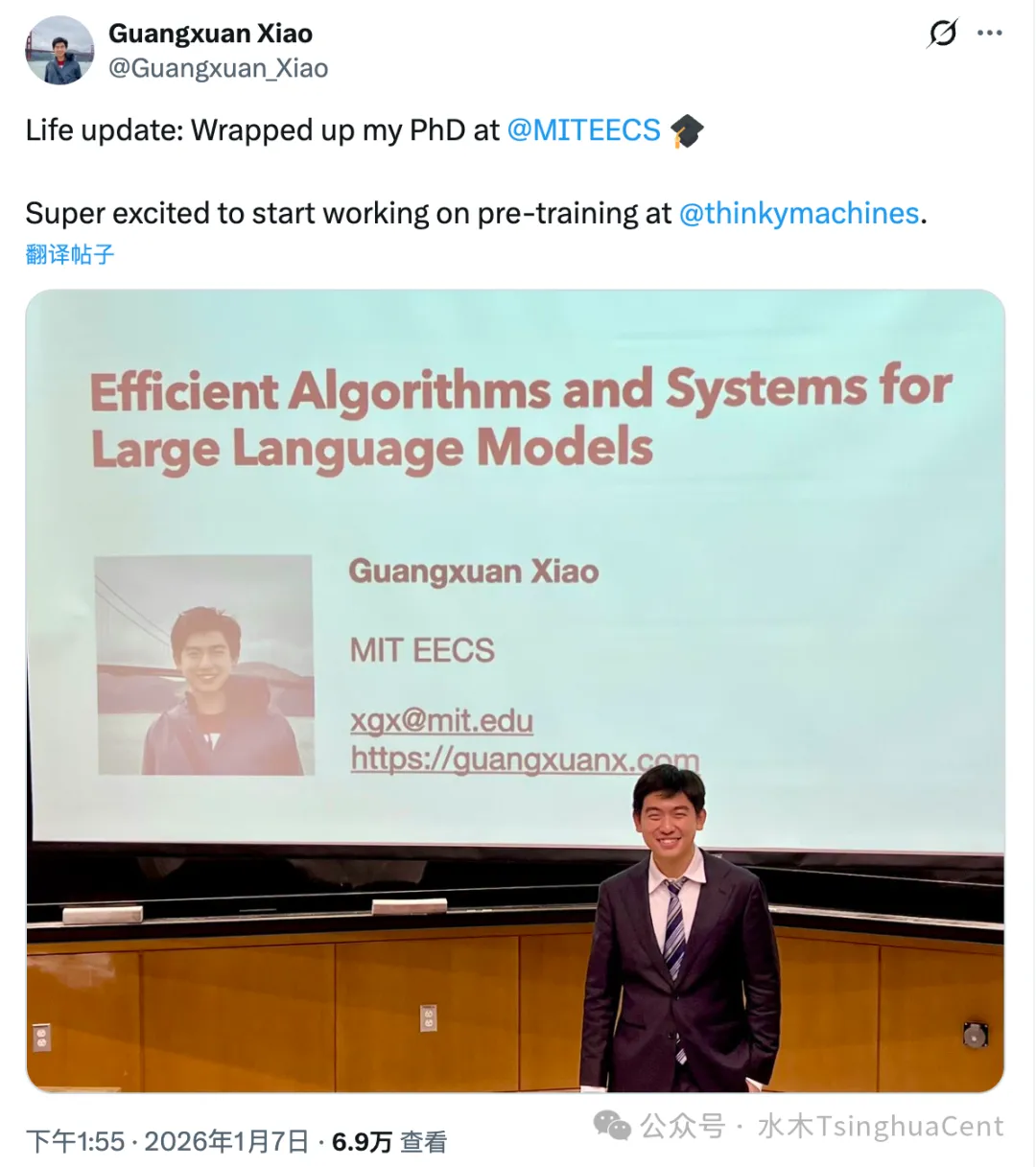

近日,麻省理工学院博士肖光烜在社交平台宣布,正式加入由前OpenAI首席技术官米拉·穆拉蒂创立的思考机器实验室(Thinking Machines),年薪超过300万元人民币。他将在该实验室主导大语言模型的预训练与系统优化工作。

肖光烜本科毕业于清华大学,拥有计算机科学与金融双学位。在校期间,他获得了清华大学综合优秀奖学金、国家奖学金,其团队曾获全国大学生数学建模竞赛一等奖。2020年至2021年,他曾在斯坦福大学计算机系进行访问研究。2022年,肖光烜进入麻省理工学院攻读博士学位,师从韩松教授。

师承同门:导师韩松的学术传承

肖光烜的导师韩松是麻省理工学院电子工程和计算机科学系副教授,其学术轨迹与肖光烜有高度重合。韩松本科同样毕业于清华大学电子工程系,后于2017年获斯坦福大学电子工程博士学位。他在高效深度学习领域享有全球声誉,因在深度模型压缩、硬件感知神经网络优化等领域的突破性研究,于2023年获得斯隆研究奖,并曾入选《麻省理工科技评论》“全球35岁以下杰出创新者”榜单。

韩松的研究深刻影响了AI芯片设计与边缘计算。其提出的深度压缩技术通过权重剪枝、量化和编码,可将神经网络模型尺寸缩小数十倍,使智能手机实时运行复杂AI算法成为可能,该技术甚至影响了英伟达安培GPU架构的设计。此外,他开发的MCUNet技术首次在单片微控制器上实现了ImageNet级别的图像识别。

博士研究:系统性破解大模型效率难题

在韩松教授的指导下,肖光烜的研究方向高度聚焦于大规模基础模型的高效算法与系统。其博士论文《大语言模型的高效算法与系统》旨在破解阻碍行业发展的三大瓶颈:显存消耗巨大、推理速度缓慢、长上下文处理困难。

他的核心贡献包括:提出的 SmoothQuant 技术,通过将量化难点从“激活值”转移至“权重”,首次在百亿参数模型上实现了无需重新训练的无损8比特量化,显著降低了部署成本。针对长文本处理,他所在团队发现的“注意力汇点”现象及据此开发的 StreamingLLM 框架,使模型能够以恒定内存处理无限长文本流。他还将这一流式思想扩展至多模态领域,提出了能实时理解数小时视频的 StreamingVLM 模型。针对其他瓶颈,其工作还包括加速预填充阶段的 XAttention,以及实现训练速度大幅提升的 FlashMoBA 高效计算内核。

工业实践与个人志趣

攻读博士期间,肖光烜在Meta和英伟达的研究实习强化了其工业视角。在Meta,他研究流式语言模型的高效注意力机制;在英伟达,则专注于长上下文模型的推理加速,并提出了DuoAttention等方法。

技术研究之外,肖光烜兴趣广泛。他热爱足球,曾担任所在院系足球队的队长兼前锋,也擅长乒乓球和围棋。在艺术方面,他喜爱弹奏钢琴,尤其钟爱贝多芬的作品。

此次加盟Thinking Machines实验室,肖光烜将专注于大语言模型预训练与系统优化。其长期致力于的“高效计算”研究理念,或将推动下一代基础模型向着性能更强、成本更低的方向发展。他在社交平台公布此消息后,获得了包括英伟达科学家、xAI研究员在内的业界同仁的关注。