AI四巨头“论剑”:大模型的下一步与中国反超可能华尔街日报

大模型竞争已从“Chat”转向“Agent”阶段,重心从榜单分数位移至真实环境的复杂任务执行。行业预判2026年为商业价值落地元年,技术路径正向可验证强化学习(RLVR)演进。面对“中国反超”议题,领军者持冷静态度,将领先概率评估为20%以内,认为中美在算力投入结构、新范式引领及toB生态上的本质差距。

竞争坐标迁移:Chat 时代的工程问题已基本解决,未来的胜负手不再是更聪明的“搜索框”,而是能否完成复杂、长链路的真实任务。AI 的核心价值正从“提供信息”转向“交付生产力”。

核心门槛更迭:Agent 的瓶颈不在于思维深度,而在于环境反馈。未来的训练范式将从人工标注转向 RLVR(可验证强化学习),只有让模型在具备明确对错判定(如代码、数学、真实业务流)的“关卡系统”中自我迭代,才能实现落地。

效率成为新杠杆:高质量数据即将枯竭,未来的竞争是“能源转化效率”的竞赛。通过二阶优化器和线性架构实现更高的 Token Efficiency(单位数据学习效果),是在算力受限背景下突破智能天花板的关键。

概率的清醒认知:行业共识认为中国在旧范式(工程复现、局部优化、toC 落地)上的反超胜率很高,但在引领新范式(底层架构革新、长期记忆等)上的胜率可能不超过 20%,因为美国在基础研究上的算力投入高出数个量级。

弯道超车的机会窗口:反超的机会藏在两个变量里:一是当 Scaling Law 遭遇边际效应递减,全球被迫进入“智能效率”竞赛时,中国的节俭式创新可能突围;二是随着学术界算力条件的改善,2026 年前后可能出现由学术驱动的范式转向。

成功的终极变量:中国最缺的不是榜单分数,而是对不确定性的容忍度。真正的反超取决于我们是否敢于从“确定性的交付压力”中抽身,将资源投向那些可能失败但能定义未来的新范式,而非仅仅在旧赛道刷榜。

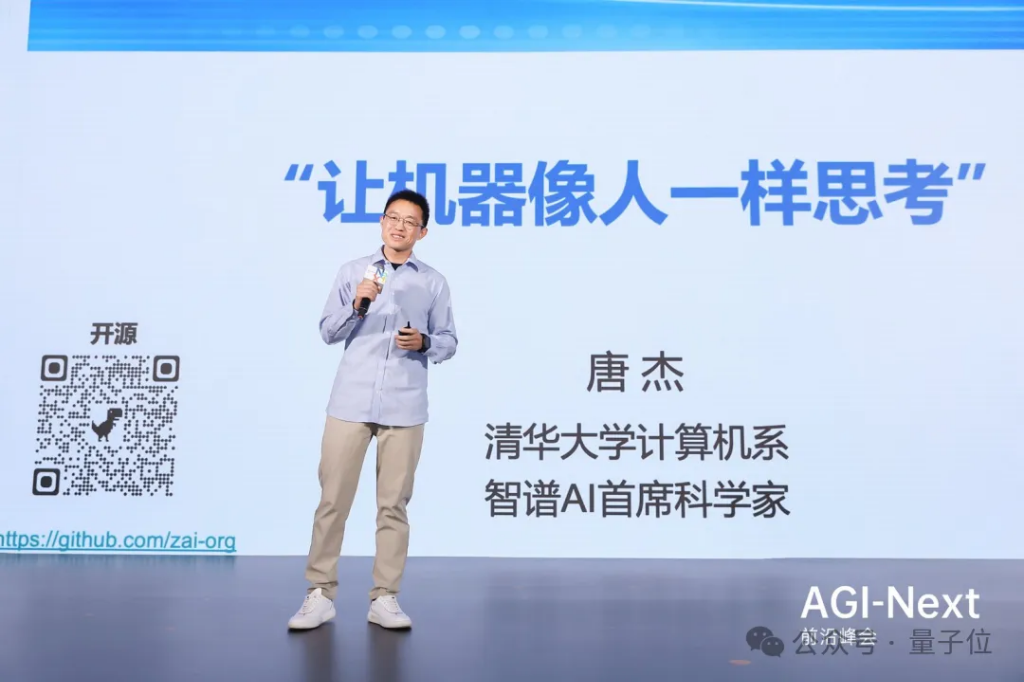

近日,由清华大学基础模型北京市重点实验室发起AGI-Next前沿峰会,把AI圈大半边天聚到了一块。基模四杰全员到场:智谱唐杰、Kimi杨植麟、阿里林俊旸,还有“突然贴脸跳屏”的姚顺雨。

他们认为,大模型竞争已从单纯的“聊天(Chat)”能力和榜单分数,转向能够进入真实环境、可验证并完成复杂任务的智能体(Agent)阶段。行业普遍预计,2026年将不再是“更强模型之年”,而是模型真正跑通业务流程、创造商业价值的关键年份。

针对投资者最为关心的“中国能否反超”这一议题,峰会传递出的情绪冷静而现实。尽管中国具备极强的工程复现与制造逻辑下的追赶能力,但多位核心人物将中国在下一代范式中领先的概率评估为不超过20%。这种谨慎源于中美在算力投入结构上的本质差异——美国倾向于投资“下一代研究”的高风险探索,而中国目前的算力更多被交付与产品化占据。

从“更会聊”到“能做事”:评估坐标发生质变

大模型行业的评估坐标系已发生根本性位移。唐杰表示,Chat这一代的问题已“差不多解决”,行业重心正从“更会聊天”转向“能完成任务”。过去市场追逐的是模型在考卷上的“分数”,而现在的核心指标变成了在真实环境中的“跑通率”。

对于企业而言,AI如果仅是更聪明的搜索框,其价值有限;但如果AI能将任务执行的成功率从偶然变为必然,则意味着生产力的质变。因此,唐杰、杨植麟等四位行业领袖达成共识:AI正在从Chat走向Thinking、Coding与Agent。

在这一阶段,RLVR(可验证强化学习)成为关键技术路径。唐杰强调,在数学、编程等结果可判定的领域,模型可以通过闭环自我探索;但在网页交互等复杂任务中,“可验证空间”稀缺。未来的竞争门槛,不是让模型多想几步,而是建立足够复杂、真实且可判分的“关卡系统”,让模型在其中通过“刷经验”实现迭代。

商业化分歧:ToB的高溢价与垂直分层

随着技术重点转向Agent,商业化路径也出现了明显的分化。姚顺雨指出,toC与toB的逻辑将渐行渐远。在toC市场,用户体验的提升并不必然带来留存提升;但在toB市场,企业最恐惧的不是慢,而是“错且不可控”。

此外,行业对“垂直整合”的看法也在修正。姚顺雨观察到,在toB领域,模型层偏向“硬核工业化”,拼的是预训练与算力;而应用层偏向“业务工程化”,拼的是流程与交付。这导致未来toB市场可能走向分层结构:最强的模型配合最懂场景的应用团队,而非单纯的“模型即产品”。这对中国公司是一个警示:不能只盯着榜单,而需关注在具体业务链路中的落地与迭代能力。

中国反超的概率:乐观预期下的结构性瓶颈

关于“中国领先概率”的讨论,峰会呈现出一种“结构性冷静”。尽管市场热衷于讨论“崛起”与“占榜”,但林俊旸等业内人士将中国领先新范式的概率上限压至20%。

这种谨慎评估基于中美在算力使用上的结构性差异:

投入方向差异: 美国将大量算力投向“下一代Research”,具备高容错率,旨在赌未来;中国则将大量算力用于交付与产品化,旨在“先活下来”。

范式话语权: 姚顺雨指出,中国在复现与工程化上极强,一旦路径被证明可行,能迅速做得更好(如制造业、电动车逻辑)。但真正的难点在于能否引领如长期记忆、自主学习框架等“新范式”,而不是在旧范式里“刷榜”。

算力瓶颈、软硬生态的完善度,以及toB市场的付费意愿,构成了制约中国模型发展的“三道门槛”。如果生态系统只奖励确定性的榜单数字,而将冒险精神挤出组织结构,那么反超将难以实现。

以下为演讲全文,由量子位整理:

我的题目是「让机器像人一样思考」。

2019年,我们在清华的支持下完成成果转化,成立了智谱。

同一时期,我们也持续推动开源,既有模型和工具层面的项目,也有面向开发者的大模型 API 体系。

我在清华待了将近二十年。

回头看,我做的事情其实很简单,主要就两件:

一是早年做AMiner;二是大模型。

有一个对我影响很深的观念,我称之为「像喝咖啡一样做研究」。这件事和今天在座的一位嘉宾密切相关——杨强教授。

刚毕业那会儿我去港科大,学校几乎所有空间都在一栋楼里:教室、实验室、会议室、咖啡厅都在一起。

有一次在咖啡厅遇到杨老师,我说最近咖啡喝得有点多,可能该戒一戒。

他先说「对,应该戒一戒」,接着又说,如果我们做研究也能像喝咖啡一样上瘾,那研究大概就真的能做好了。

这句话对我触动很大,从2008年一直影响到现在。

做研究,本质上需要长期专注和持续投入。AGI正是这样一件事,它并不追求短期见效,而是一项多年投入的工程。

2019 年,我们实验室在图神经网络和知识图谱方向已经有一定国际影响力,但当时还是下定决心阶段性按下暂停键,几乎所有人都转向大模型相关研究。到今天,算是做出了一点点成果。

如果从大模型的发展轨迹来看,用「智能水平」来描述会比较直观。

2020年前后,模型主要解决的是MMU、QA等相对简单的问题;到2021、2022 年,开始进入数学计算和基础推理阶段;通过后训练,这些能力逐步被补齐。

到2023、2024年,模型从知识记忆走向复杂推理,甚至可以处理研究生层级的问题,并开始在SWE-bench这类真实世界编程任务中表现出可用性。

这个过程很像人的成长:从阅读、算术,到更复杂的推理,再到走向真实工作场景。

今年开始,大家也看到 HLE,也就是「人类终极测试」,其中不少问题连搜索引擎都无法直接给出答案,要求模型具备更强的泛化能力。

如何解决,目前仍然没有确定答案,但可以确认的是,到2025年,模型的整体能力仍在快速提升。

从另一个角度看,一个核心问题是:模型如何从Scaling走向真正的泛化能力。