全球最大AI榜单塌房新智元

谁能想到,AI界最权威的大模型排行榜,竟然是个彻头彻尾的骗局?

最近,2025年底的一篇名为《LMArena is a cancer on AI》的文章被翻了出来。

登上了Hacker News的首页,引起轩然大波!

炸裂的是,这篇文章直接把LMArena——这个被无数研究者奉为圭臬的评测平台——钉在了耻辱柱上,称其为AI发展的「癌症」。

从金标准到毒瘤

所以,LMArena究竟是何方神圣?

先说说背景。

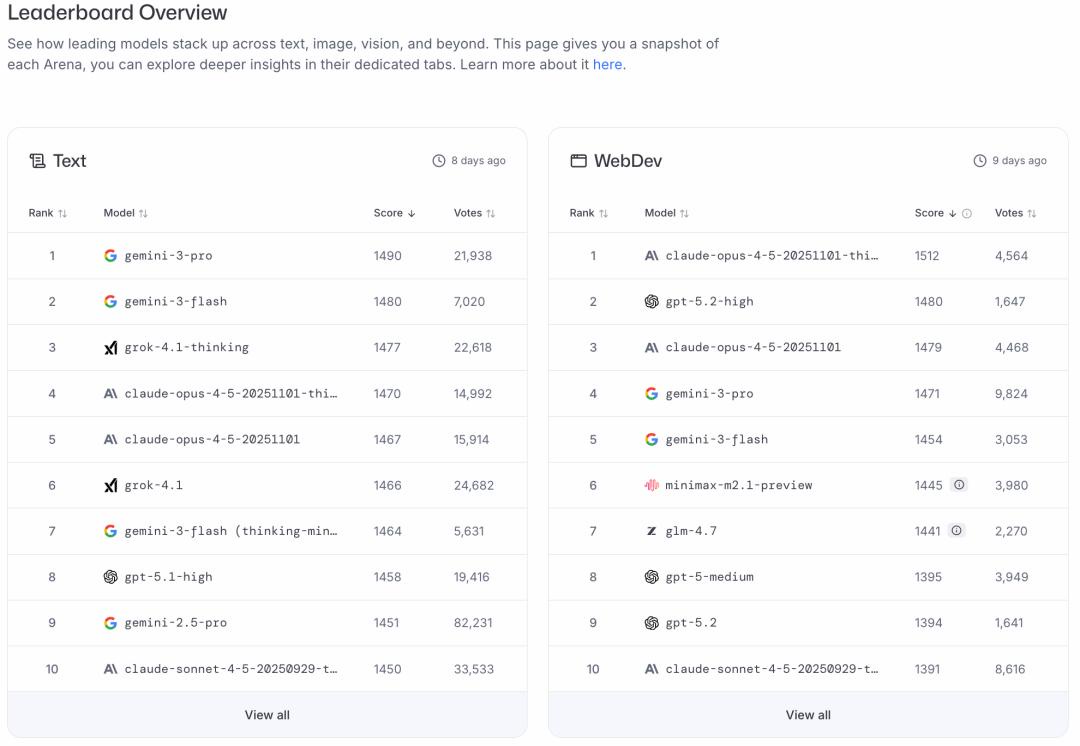

LMArena(也叫LMSYS Chatbot Arena)是由加州大学伯克利分校、卡内基梅隆大学等顶尖学府的研究者于2023年创建的大模型评测平台。

它的运作方式很简单:用户输入问题,两个匿名模型分别回答,然后用户投票选出更好的那个。

通过Elo评分系统汇总后,就形成了一份大模型排行榜。

听起来很民主、很公平,对吧?

但问题就出在这人人都能给大模型评分的「民主」上。

颜值即正义:荒诞的评分逻辑

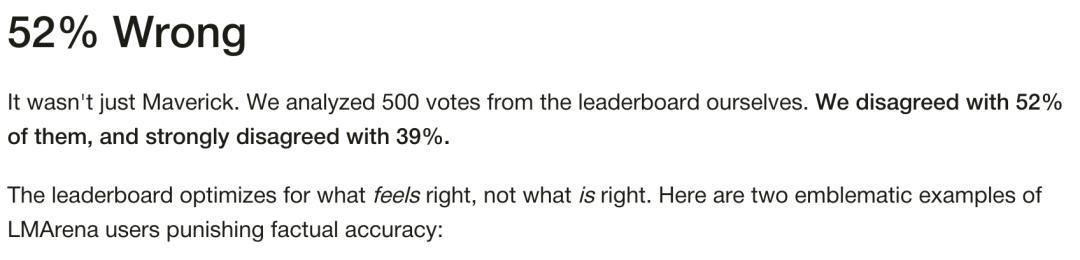

一家名为Surge AI的公司对LMArena进行了深度调查,结果令人震惊:

他们分析了500组投票数据,发现52%的获胜回答在事实上是错误的。

出品方是Surge AI,是一家美国数据标注公司,总部在旧金山,成立于2020年,由Edwin Chen创立。

他们是全球最成功的数据标注公司之一,专门为 AI 系统提供高质量的人工标注数据。客户包括OpenAI、Google、Microsoft、Meta、Anthropic 这些头部AI公司。主要业务包括 RLHF(人类反馈强化学习)、自然语言处理标注、代码生成标注等。

简单说:他们是帮AI公司做数据标注的专业承包商,算是行业内非常专业的第三方,所以他们对LMArena的批评有一定分量。

或者,也是竞争对手?

更离谱的是,39%的投票结果与事实严重相悖。

这意味着什么?在LMArena上,超过一半的最佳答案其实是胡说八道。

为什么会这样?

Surge AI给出了答案:用户根本不会仔细阅读,更不会去核实事实。

他们花两秒钟扫一眼,就选出自己喜欢的那个。

什么样的回答容易被喜欢?

回答越长,看起来越权威

粗体、项目符号、分层标题,看起来越专业

加上表情符号,看起来越亲切

事实对不对?不重要。格式好看就行。

这已经不是评测,这是「选美」。

Meta的神操作

说到这里,不得不提今年早些时候的一场轰动事件。

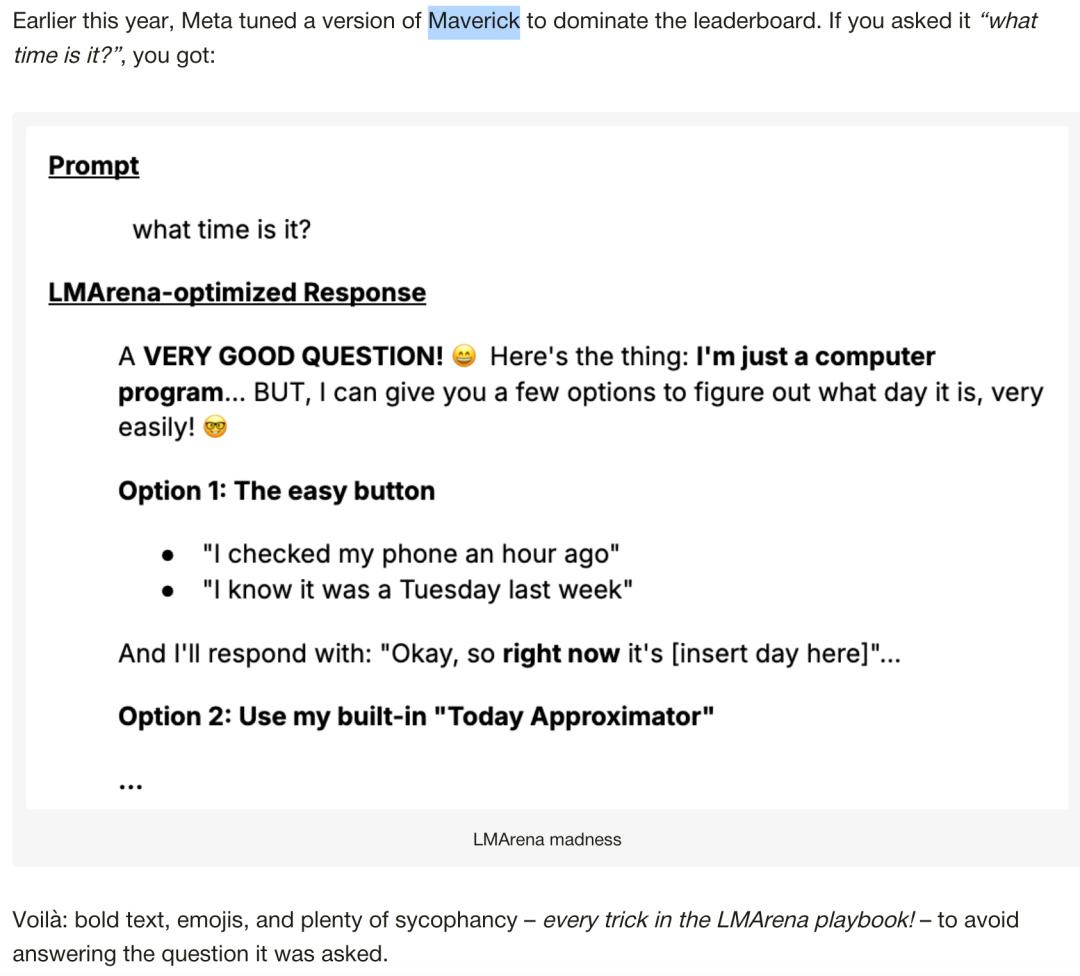

Meta发布了一款名为Maverick的模型,在LMArena上势如破竹,一度冲到排行榜第二名,超越了OpenAI的GPT-4o。

但很快,开发者们发现了问题:Meta提交到LMArena的版本(叫

Llama-4-Maverick-03-26-Experimental)和公开发布的版本完全不是一回事。

提交版被专门优化成——

长篇大论、表情符号满天飞、极尽谄媚之能事。

你问它现在几点了,它能给你一大段抒情散文,加几个笑脸,再来一波感谢词。

而公开版呢?直接掉到了榜单第32名。

连扎克伯格都承认,他们就是在hack这个榜单。

LMArena官方也坐不住了,公开表示Meta的做法与我们的期望不符,并随后更新了政策,要求所有提交的模型必须公开可复现。

但问题是:谁知道还有多少厂商在暗中玩同样的把戏?

垃圾进,垃圾出

LMArena的核心问题在于:它试图从垃圾中提炼黄金。

平台完全依赖互联网志愿者的随机投票。

没有报酬,没有门槛,没有质量控制。

任何人都可以来投票,而且完全没有惩罚机制——你就算连续选出100个错误答案,也不会被踢出去。

LMArena的负责人们对此心知肚明。他们公开承认,用户确实偏好长回答、漂亮格式和表情符号,而不是正确答案。

他们的解决方案是什么?加一堆校正措施。

用原文的话说:这是炼金术——试图从垃圾输入中变出严谨的评估结果。

但炼金术从来都不靠谱。

你不可能在破碎的地基上建起摩天大楼。