DeepMind内部视角:Scaling Law没死新智元

2025年就要结束,DeepMind华人研究员万字长文为我们揭秘了谷歌内部对于AI的预言:除了算力,其他一切都是杂音。

今天是2025年的最后一天了,很多人都在这一天进行AI回顾总结。

在经历一年的模型、算力、资本的新闻轰炸后,AI距离通用人工智能还有多远?

如果说2024年是人们对于AI的好奇之年,那么2025年就是AI深刻影响人类社会之年。

在这充满变数的一年里,我们听到了截然不同的声音:

Sam Altman在2025年中的博文《温和的奇点》中大胆预言:

「我们已经知道如何构建AGI,2026年我们将看到能够产生原创见解的系统。」他坚持认为,Scaling Law远未触及天花板,智能的成本将随着电力的自动化生产而趋近于零。

奥特曼:温和奇点已降临!AI最终掌控物理世界,2030年人类命运大转折

NVIDIA的黄仁勋则将目光从「算力崇拜」转向了「AI工厂」。

他在2025年底的一次演讲中提到:

「AI的瓶颈不再是想象力,而是电力。未来的Scaling Law不仅是模型的堆叠,更是推理效率10万倍的飞跃。」

英伟达AI工厂:人类历史酝酿12000年的绝对必然

相比之下,Meta的前首席科学家Yann LeCun依然嘴炮,他甚至在离职创办新公司前公开表示:

「LLM是通往 AGI 的死胡同,它没有世界模型,就像一个没有躯体的空中楼阁。」

LeCun赌上后半生,押注大模型必死!Hassabis誓将Scaling进行到底

2026年,Scaling Law是否还能继续玩下去?

对于这个问题,一篇来自DeepMind华人研究员的万字长文在社交网络火了:

Scaling Law没死!算力依然就是正义,AGI才刚刚上路。

文章地址:https://zhengdongwang.com/2025/12/30/2025-letter.html

本文是Google DeepMind研究员Zhengdong Wang撰写的2025年度长信。

作者以独特的个人视角,回顾了从2015年至今AI领域的剧变,并深刻剖析了驱动这一切的核心动力——算力。

尽管外界对Scaling Laws存疑,但历史反复证明,随着算力的指数级增长,AI模型不断涌现出超越人类预期的能力。

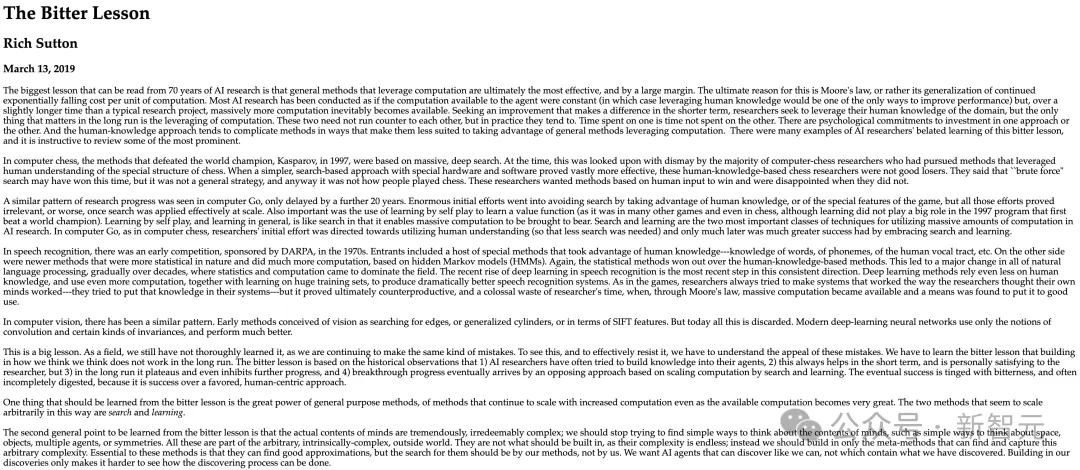

作者结合自己在DeepMind的工作经历,验证了强化学习教父Richard S. Sutton「苦涩的教训」:

通用算力方法终将战胜人类的特定技巧。

这也是我们今年最大的感受!

除了算力,其他都是杂音

2025年12月30日,当回望这波澜壮阔的一年时,脑海中浮现的是十五年前那场由AlexNet开启的视觉革命。

那场辛顿、李飞飞、Ilya都参与的大会,或许就是如今AI时代的真正萌芽。

那时,大多数人认为人工智能仅仅是关于「特征工程」和「人类聪明才智」的博弈,而今天,我们已经进入了一个完全不同的维度:

一个由算力主导、由Scaling Law驱动、且AGI(通用人工智能)才刚刚踏上征途的纪元。

最近大家关注的焦点无外乎:Scaling Law是否已经撞墙?

算力的信仰:为什么Scaling Law从未失效

在2024年底,业内曾出现过一阵强烈的悲鸣,认为预训练数据的枯竭和边际收益的递减标志着Scaling Law的终结。

然而,站在2025年的终点,我们可以负责任地说:

Scaling Law不仅没死,它正在经历一场从「暴力堆参数」到「智能密度」的深刻演化。

十五年一遇的连续性

我们要理解Scaling Law,首先要看到它的历史韧性。

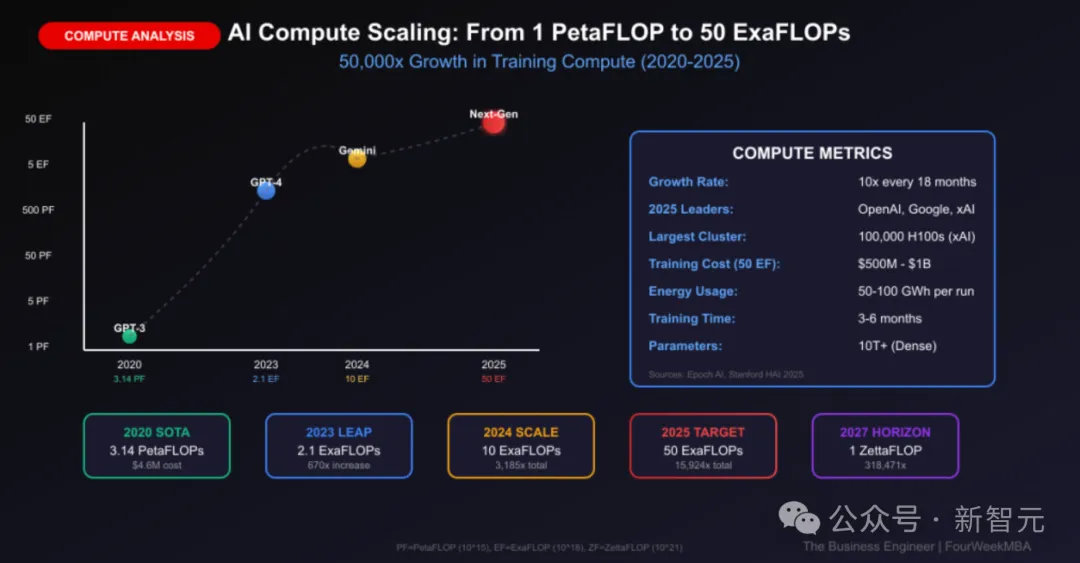

研究显示,过去十五年里,用于训练AI模型的算力每年以四到五倍的速度增长。

这种指数级的复合增长,在人类技术史上是罕见的。

在DeepMind内部观察到,模型在训练过程中所消耗的数学运算量,已经超过了可观测宇宙中的恒星数量。

这种增长并非盲目,而是建立在极其稳定的经验公式之上。

根据Kaplan和Hoffmann等人的实证研究,性能与算力之间存在着明确的幂律关系:性能提升与算力的0.35次方成正比。

文章地址:https://fourweekmba.com/ai-compute-scaling-the-50000x-explosion-2020-2025/

这意味着,每投入10倍的算力,大约能带来3倍的性能增益;而当我们跨越1000倍的算力鸿沟时,性能的提升将达到惊人的10倍量级。

定性跃迁与涌现能力

Scaling Law最迷人的一点在于,它不仅带来了定量的误差减少,更诱发了不可预测的定性跃迁。

在DeepMind的实验中,随着算力的增加,模型会突然展现出逻辑推理、复杂指令遵循以及事实性修正等「涌现能力」。

这种现象意味着,算力不仅仅是燃料,它本身就是一种能够催生智能的物理量。