小扎做了“认知韭菜”——数十亿买Manus王庆法

过去一年,Agentic AI几乎成了所有大模型应用的默认叙事,自动写代码、自动做研究、自动操作软硬件。

昨晚Meta官宣数十亿美元收购Manus以扩展其AI Agent能力,年末将这波Agent热潮推到了新高度。

但笔者呼吁大家冷静,一是小扎的技术落地判断力,已经在元宇宙时期得到了印证;二是实事求是看Agent,演示往往令人震撼,真正落地时却一地鸡毛。

不要让Agent成为下一个元宇宙。并不是因为工程细节没打磨好,也不是模型还不够大,这是一个结构性问题。

UIUC、斯坦福、普林斯顿、哈佛、伯克利等华人学者最近的论文《Adaptation of Agentic AI》【文献1】首次在机制层面,给出了一个非常清晰的解释框架:

大多数所谓智能体Agent系统,根本没有真正的适应闭环。

一、Demo总是成功

因为Demo场景刻意消除了适应的必要性。典型Agent Demo具备几个共同特征:

任务分布与训练/调参高度一致,工具接口稳定、低噪声、近乎确定,Prompt被精心设计输入几乎不偏航,人类在旁边随时软纠错。

在这种环境里,系统只需要做一件事:生成一次性看起来合理的多步计划。

论文启发我们的一个关键洞见是:

这些Agent Demo验证的是静态策略生成能力,而不是智能体能力。直白说,Demo成功并不需要系统具备任何真正的学习或适应能力。

二、落地一地鸡毛

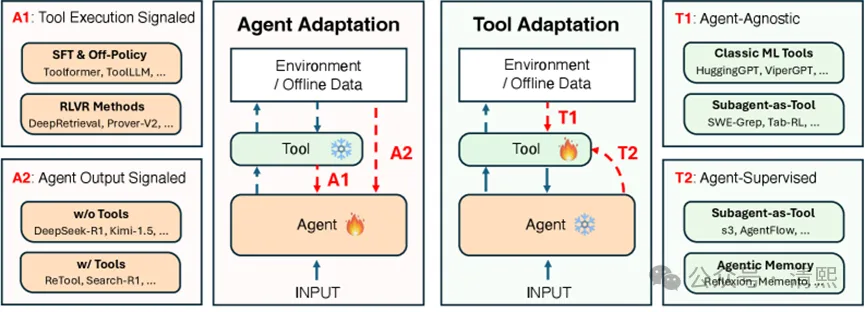

论文将Agent的适应拆成两个正交维度:

谁在被优化?Agent本身 vs 工具;反馈信号来自哪里?执行结果 vs 输出质量,得到四类适应机制(A1 / A2 / T1 / T2)。

图1:智能体人工智能的适应性概览。智能体:作为协同推理模块的基础模型;工具:独立于智能体模型的可调用组件,例如API接口、机器学习模型、子智能体或记忆模块。我们将这些适应性调整分为两类:智能体适应性(A1 & A2):针对智能体模型的适配优化;工具适应性(T1 & T2):为智能体适配工具的调整。

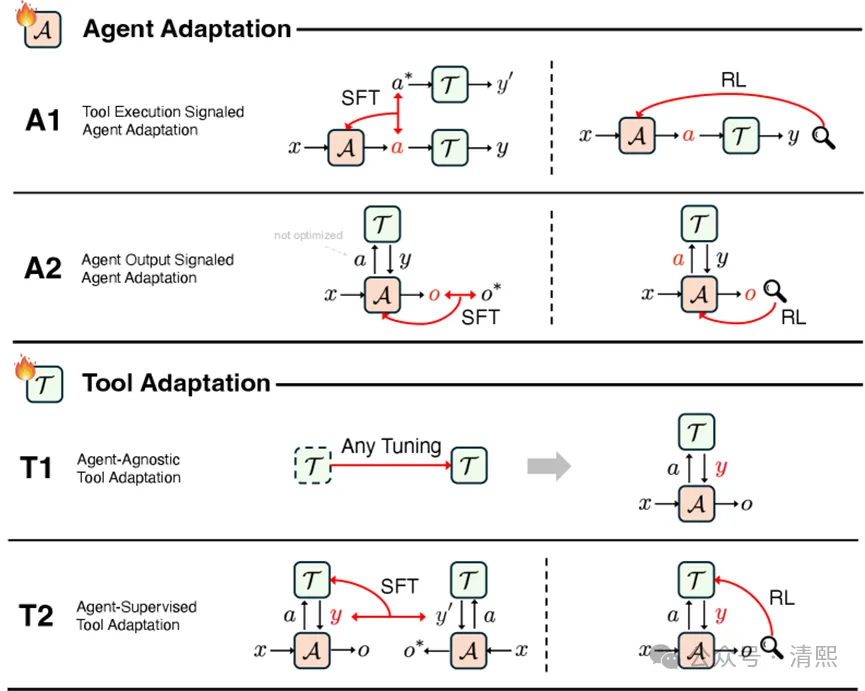

图3:四种适应性范式示意图(A1、A2、T1与T2)。在所有子图中,红色高亮字母表示在适应性调整过程中直接优化的组件。红色箭头指示适应性训练信号的来源。黑色虚线用于区分监督微调(SFT)与强化学习(RL)两种训练场景。

现实中失败的系统,往往四种适应都没有。

1.没有从真实执行中学习,缺失 A1

现实世界的工具是噪声系统:API会失败,数据会过期,环境状态不可完全观测,但大量Agent系统从不利用执行结果反向修正自身策略。

结果是Agent会持续生成语义上合理、物理上不可执行的行动序列。在Demo里看不出来,一上线就是灾难。

2.没有长期质量反馈,缺失 A2

真实任务的成功信号通常是延迟的、模糊的、和非局部的。很多系统只在最终输出层面做一次性评估,中间偏航无法被识别,更无法被纠正。

于是系统呈现出一种典型症状,看起来一直在认真思考,但结果越来越偏。

3.工具被错误地假设为固定且可靠,缺失 T1 / T2

论文一个非常重要但常被忽视的观点是:Agent与工具之间也存在能力错配问题。现实中常见的失败模式包括:

Agent规划能力大于工具真实能力,Agent对工具行为的内在模型是错的,新任务出现,但工具能力从未更新。

没有工具适应的系统,本质上是在用一个静态的外部世界支撑动态推理。

三、真Agent幻觉

这篇论文实际上点破了一个行业级的误解:看起来像Agent不等于具备Agent能力。

很多系统只是LLM +工具调用模板,再加一些prompt控制逻辑。它们不具备任何持续适应机制,却被包装成自主智能体。

在论文框架下,这类系统既不属于A1,也不属于A2,工具层面同样没有T1/T2,注定只能在Demo中成立。

四、越复杂崩得越快

论文隐含了一个非常物理的结论:Agent行为复杂度的提升,对适应机制的需求是非线性增长的。

多步规划必须有A1,长时任务必须有A2,多工具协作必须有T2,开放环境必须持续适应。

现实中的很多环境已经跨过了复杂度临界点,而Agent系统却仍然停留在静态策略生成的架构阶段。崩溃不是偶然,而是必然。

Demo之所以成功,是因为环境在适应系统。实际落地一地鸡毛,是因为Agent并不真的会适应环境。

五、小扎做了认知韭菜

如果Meta收购Manus逻辑建立在Agent Demo等于可扩展Agent能力之上,这笔交易大概率是在为演示幻觉付费。

也就是说,买的是叙事,不是Agent系统能力和适应性。

Manus这类公司在资本层面特别值钱。笔者认为是它们踩中了三个当下最容易被误判的信号:

1.看起来像AGI的行为外观:多步规划,自主调用工具,复杂任务链路,流畅的语言自我解释。

而这些全都是静态策略生成可以伪装出来的东西。这些行为并不必需任何A1/A2/T1/T2级别的适应机制。

2.Demo在去适应化环境中极其稳定:工具可靠,输入受控,任务分布窄,人类隐性纠错。

在这种环境里,任何强一点的LLM + workflow都会显得像智能体。资本往往把这种稳定性误读为系统已经具备自主能力。

3.Agent正好击中大厂的战略焦虑:对Meta而言尤其明显,基础模型层面被OpenAI/Google压制;

应用层缺乏爆点,急需一个下一代计算范式的叙事,Agent是最便宜、最快速、最不需要底层突破的宏大叙事。

真正的问题是,Manus解决了哪一类适应?用论文的A1/A2/T1/T2 框架冷静评估,可以发现:

Agent本身不通过真实执行反馈更新,弱或无A1;没有跨任务生命周期的质量修正机制,弱A2;工具能力基本冻结,无T1;工具适应更多是workflow,而非学习,伪T2。

这意味着,系统的智能外观高度依赖环境假设,一旦环境漂移,能力会断崖式退化,Palantir也有漂移问题。Demo强,不等于可部署,不等于可扩展。

六、不畏浮云遮望眼

虽然对Meta来说,这数十亿美金可能换来叙事、人才、时间窗口,未必亏。但对技术判断来说,如果Meta管理层相信这是Agent能力突破,那就是被认知收割。

真正韭菜的点在于,把语言模型的策略生成能力,误当成具备自我修正的智能体系统。

Manus之类的Agent公司,卖的不是智能,而是在不需要适应的环境中,看起来像智能。

而《Adaptation of Agentic AI》这篇论文,恰恰说明了:一旦进入真实世界,缺乏适应闭环的系统,规模越大,崩得越快。

Agentic AI 泥沙俱下,但群众的眼睛是雪亮的,不畏浮云遮望眼,因为他们掌握了强大的认知武器。

■ 这位90后华人把公司卖给Meta:20亿落袋?(组图)

■ Manus被Meta数十亿美元收购的背后(图)