一只机器狗,把英伟达的算力王座拱翻了量子位

消费级机器人行业,可能要出现一次真正意义上的代际切换了。

过去几年,大家见过太多机器狗:能跑、能跳、能翻跟头。但问题一直没变。

它们很多时候其实看不清、听不清,也想不明白。

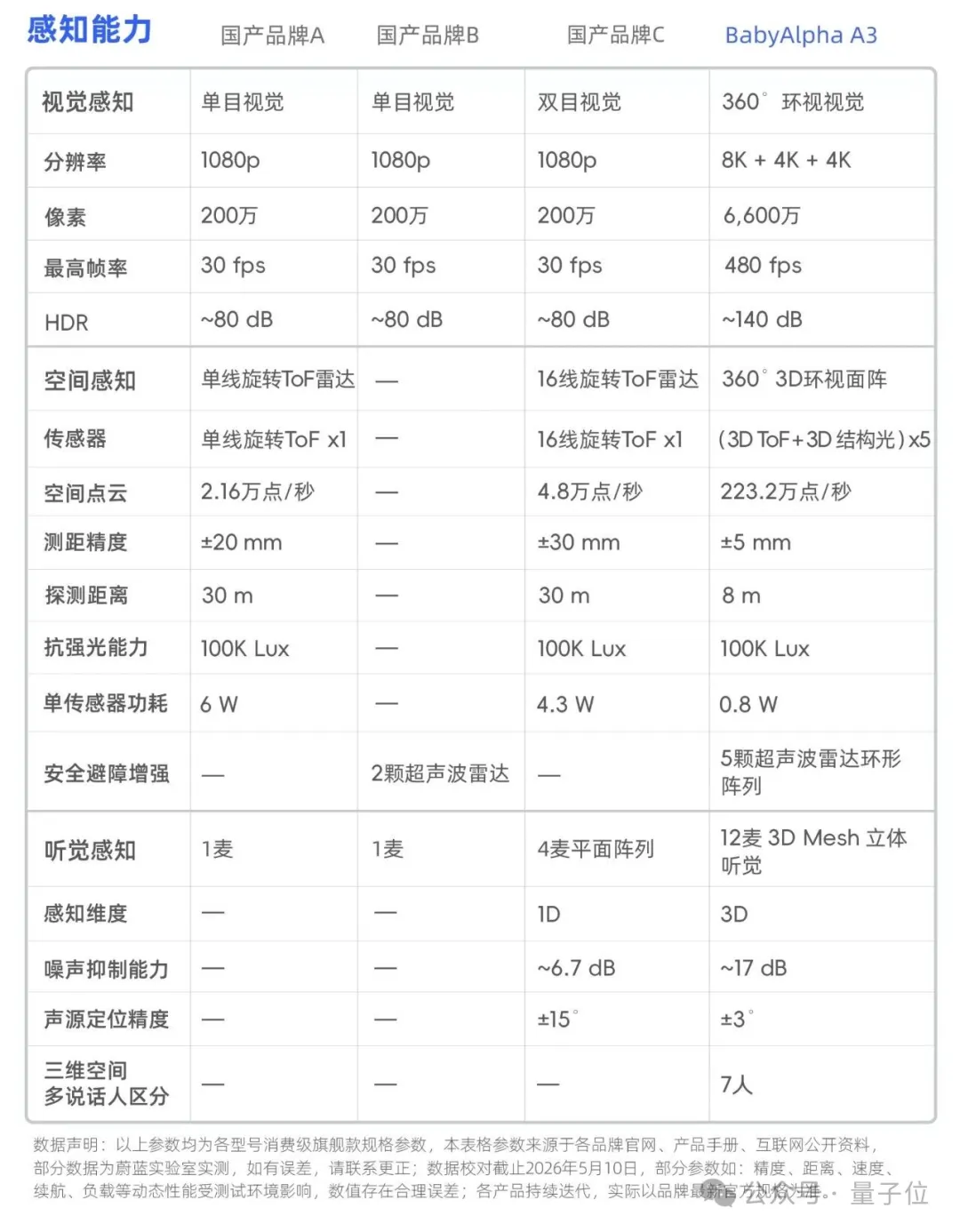

行业主流方案,还是200万像素摄像头、16线激光雷达、单芯片算力架构。

机器人能动,但距离真正理解世界,始终差一口气。

直到刚才,我看到一组「离谱」数据——

6600万像素、HDR140db、223.2万点云/秒、70亿参数端侧运行280TPS。

更关键的是,它没有在英伟达的规则里卷。

而是用6颗芯片组成异构计算集群,把消费级机器人的算力效率,直接拉到行业10倍以上。

这组数据,来自蔚蓝科技刚刚发布的BabyAlpha A3消费级四⾜机器⼈。

这家已经卖出超2.5万台的消费级四足机器人、累计交互6548万次、用户使用时长超9.5亿分钟的公司,终于把过去几年积累下来的核心技术,集中兑现到了A3身上。

信号已经很明确:消费级四足机器人,正在从会动,进入会理解人的新阶段。

那么,问题也来了。

当机器人的感知和算力都捅破行业天花板,具身智能,究竟会被推到什么位置?

机器人终于不再“半盲”

过去几年,消费级机器人行业一直有个很隐蔽的问题。

大家都在卷运动能力。翻跟头、跑酷、越障、爬坡,动作越来越像科幻片。

但感知系统,其实一直停留在「能用」阶段。

逆光环境容易看不清,复杂空间容易误判,动态目标捕捉慢。

很多机器人表面上很聪明,本质上还是在模糊理解世界。

这也是为什么,行业里大量机器人看起来很灵活,但真正脱离遥控和预设环境后,依然像个「半盲选手」。

机器人如果连世界都看不清,就谈不上真正自主。

而A3最狠的地方,就是直接把感知维度拉高了一个时代。

A3搭载了超能视觉感知系统,由5000万像素主摄+f/2.8 超广角+4K全景摄像头组成,分辨率分别为8K、4K、4K,总像素达到6600万,还包括了1/1.3英寸大底。

什么概念?很多旗舰手机主摄,才5000万像素。

更关键的是感光能力达到HDR140db视网膜级别。

行业主流机器人,大多还停留在HDR90db以下,而人类眼睛理论动态范围,大约在100db~120db之间。

A3第一次把机器人视觉动态范围,推到了超过人眼的水平。

这意味着,以前机器人在强逆光、暗光、复杂明暗切换环境里,经常会瞬间「失明」。

但现在,A3真正具备了复杂光线下的环境理解能力。

还有一个特别容易被忽视的数据——最高帧率480fps。

行业主流很多还是30fps,类似普通视频。

480fps,接近超慢动作视觉。

高速运动目标、儿童跑动、突然出现的障碍物,在机器人眼中都是慢动作回放,是可以逐帧分析的清晰画面。

这还不是最夸张的。

真正拉开代差的,是空间感知。

A3用了5组3D ToF+3D结构光构成的360°环视面阵,点云密度达到223.2万点/秒。

而行业大量16线激光雷达方案,点云密度只有4.8万点/秒。

「点云密度」可简单理解为:每秒钟机器人通过传感器采集到的三维空间点的数量。

高密度点云就像高清照片,能分辨出细小的障碍物(比如电线、玩具、小台阶)。而低密度点云就是一张马赛克图。

4.8万点/秒VS 223.2万点/秒,差距接近两个数量级。

如果说别人的机器人还在用2G地图导航,那么A3已经切到了4K实时地图。

它看到的,不再只是障碍物轮廓,而是一个高精度、实时变化的三维世界。

听觉系统也一样。业内很多机器人只是「听到声音」。

A3全球首发12-Mic 3D Mesh仿生立体听觉,能「听懂声音从哪来」。

12个麦克风组成三维声场阵列,可以判断方向、距离、空间位置。

谦虚点说,它更接近具身智能。但依我看,这就是具身智能啊!不仅理解语言,还能理解环境。