首个GPT-5级推理音频模型来了36氪

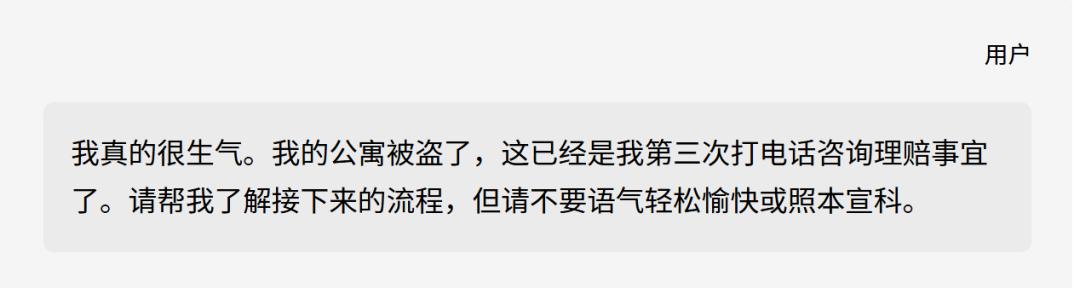

绝杀!OpenAI发布GPT-Realtime-2:首个GPT-5级推理音频模型,OpenAI正式接管人类耳朵人类与机器的最后一道「防火墙」——键盘,正在彻底消失。

今天凌晨,OpenAI又给世界带来一次震撼。

这一次,他们不卷文字,不卷视频,而是要把那个曾让无数人惊艳、又让无数人遗憾的Samantha——电影《Her》中的AI——彻底带进现实。

OpenAI正式宣布,推出GPT-Realtime-2。

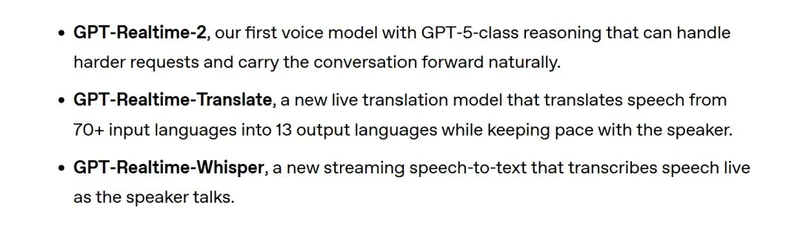

这不仅仅是一次音频模型的升级,这是OpenAI首次明确将「GPT-5级别」的推理能力注入到语音交互中。

伴随它一同而来的,还有GPT-Realtime-Translate(实时翻译)和GPT-Realtime-Whisper(流式转写)。

正如OpenAI官博所言:「语音正成为人们使用软件最自然的方式。」

而今天,OpenAI要把这种自然变成全能。

「GPT-5级」推理注入:语音助手终于有了「脑子」回想一下,你以前调侃Siri或Alexa时,最大的槽点是什么?是「听不清」,还是「智障」?

大多数时候是后者。它们能听清字,却听不懂人话。它们只能完成「打电话给某某」这种线性任务,一旦涉及复杂的逻辑纠缠,就会陷入死循环。

GPT-Realtime-2彻底终结了这一时代。

它是全球首个具备GPT-5级别推理能力的音频模型。这意味着,当你和它对话时,它不再只是一个「复读机」,而是一个正在实时思考的协作者。

它是真的在「想」GPT-Realtime-2引入了可调节的推理强度(Minimal到xhigh五档)。

在最高级别的推理模式下,它在逻辑谜题、战略决策、空间感知方面的表现近乎恐怖。

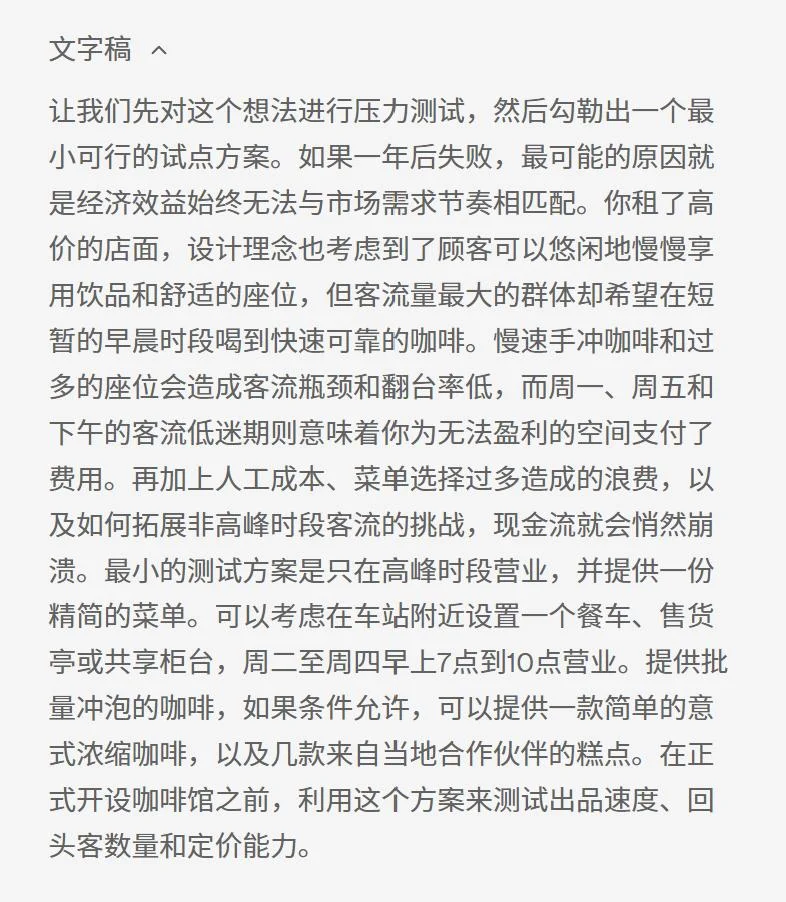

在OpenAI展示的一个案例中,一位创业者描述了自己在通勤火车站旁开咖啡馆的构想:900平方英尺、昂贵的租金、周二到周四的高峰、文艺的慢冲咖啡。

以前的AI只会说:「听起来很棒,加油!」

而现在的GPT-Realtime-2,会停顿,会思考,然后给你做一套详细的「事后检查」。

它会告诉你,如果你一年后倒闭了,大概率是因为租金与客流周期的不匹配。接着,它会建议你先尝试「最小可行化产品」——比如先做一个站台咖啡推车。

这种战略推理,以往只能在复杂的文字对话中实现。现在,你只需要一边开车一边和它聊天,它就能在几秒钟内通过音频流输出同等级别的深度洞察。

「会做人」:情绪价值拉满最让人头皮发麻的是它的音调控制力。 GPT-Realtime-2不再是冷冰冰的播音腔。

它能感知你的情绪:当你感到沮丧时,它会用更加同理心、轻柔的语调安抚;当任务成功完成时,它的声音会变得欢快、充满活力。

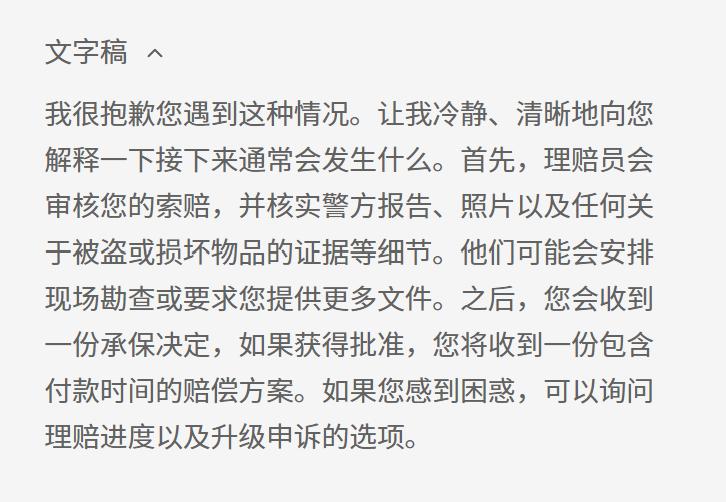

它可以完成空间推理。

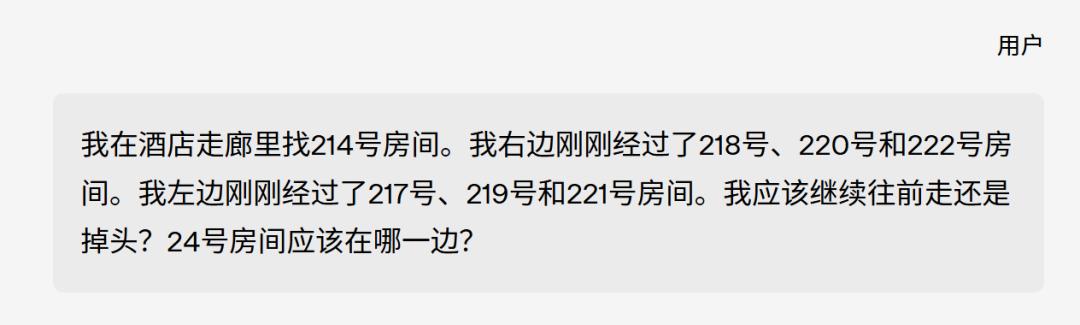

还能解决逻辑谜题。

GPT-5级的推理能力,就是这么全能。

为了解决「AI处理任务时的死寂感」,OpenAI还给它加了「前导语」(Preambles)功能。

比如当你问一个极难的问题,它不会沉默五秒然后蹦出答案,而是会先自然地接一句:「让我帮你查一下哈,请稍等片刻……」

这种极具人性的交互细节,直接模糊了碳基生命与硅基生命的界限!

三剑客齐发:重新定义「实时」除了GPT-Realtime-2这颗大心脏,OpenAI这次还配套了另外两件神器。

GPT-Realtime-Translate:同传神器来了支持70+种输入语言和13种输出语言。

它的核心优势在于「步调一致」。 以往的实时翻译往往有明显的滞后感,但这套新模型能紧跟演讲者的语速,同时保留情感起伏。

Vimeo已经开始用它为产品教学视频做实时全球同步。想象一下,未来你参加一场跨国会议,耳边传来的翻译不仅准确,连对方开玩笑时的那种语气都能精准复刻。

GPT-Realtime-Whisper:把延迟降到冰点这是Whisper家族的最新成员,专为流式转写而生。它不是等你说完一句话才去翻译,而是在你吐字的同时,文本就已经像流水一样倾泻而出。

这对于实时会议记录、直播字幕以及医疗诊断等高频互动场景,简直是降维打击。

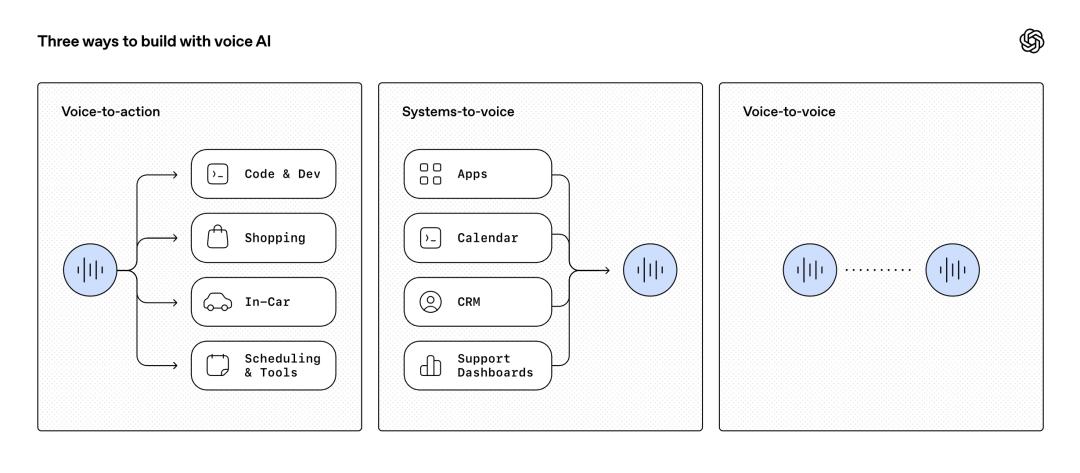

从「对话」到「行动」:Agent的终极形态OpenAI在发布中反复提到了一个词:Agentic(代理性)。

在OpenAI看来,语音交互正在从单纯的「一问一答」进化为「语音触发行动」。