这个世界的本质就是蒸馏AILabNotes

如果只用一个词解释人工智能最近几年的爆发,我会选“蒸馏”。

不是算力,不是参数,不是提示词,也不是某一个模型架构,而是蒸馏。

所谓蒸馏,最早在机器学习里有一个非常具体的含义:把一个大模型、强模型、集成模型中学到的知识,转移到一个更小、更便宜、更容易部署的模型里。Hinton、Vinyals 和 Dean 在 2015 年的经典论文 Distilling the Knowledge in a Neural Network 中,就提出可以把复杂模型或模型集成的能力压缩到一个更小的模型中,从而在保持性能的同时降低部署成本。

但如果把视角放大一点,你会发现,蒸馏并不只是 AI 里的一个训练技巧。

人类文明本身就是蒸馏。

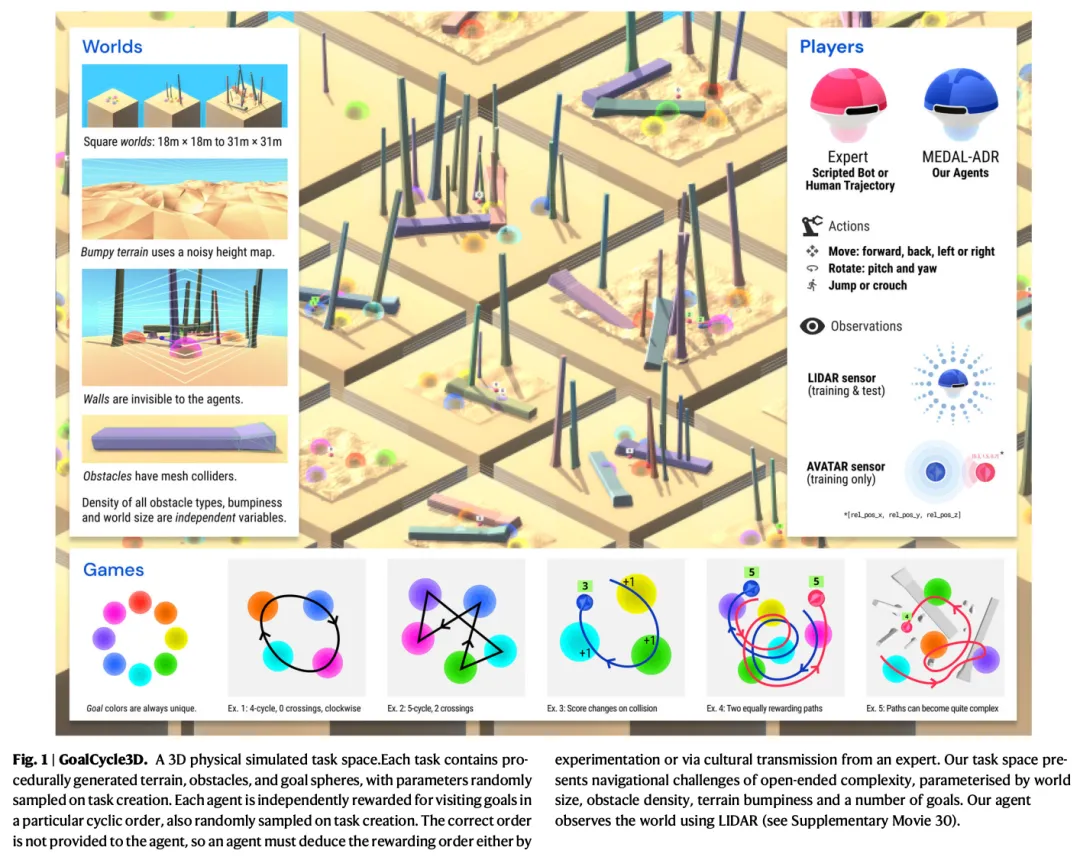

教育是蒸馏,老师把几十年的经验压缩成一节课、一套教材、一句提醒。科研是蒸馏,科学家把无数实验、失败、偶然和猜想压缩成一个公式、一篇论文、一条定理。文化是蒸馏,一代人把生活经验、工具使用、社会规则和价值判断压缩成故事、制度、语言和习俗,再传给下一代。DeepMind 相关研究把“文化传递”描述为一种通用社会能力,使智能体能够实时、高保真地从彼此那里获取并使用信息;在人类社会中,文化演化正是技能、工具和知识跨代积累的基础。

所以,蒸馏的本质不是“压缩模型”。

蒸馏的本质是:把昂贵的经历,变成便宜的经验;把复杂的世界,变成可迁移的结构;把难以重复的探索,变成后来者可以直接继承的路径。

人类从来不是从零开始学习

一个小孩学会拿筷子,并不是从物理学定律开始推导;一个学生学会解方程,并不是重新发明代数;一个工程师学会写代码,也不是从晶体管原理一路推到操作系统。我们绝大多数能力,都不是原始探索得来的,而是从前人那里蒸馏来的。

这就是文明最强大的地方。

如果每一代人都必须重新发现火、重新发明轮子、重新理解农业、重新推导牛顿力学,人类社会不会有今天。我们之所以能不断向前,是因为上一代人把世界压缩成了语言、图纸、工具、规则、公式、课程、论文、软件库和工程规范。

你今天在学校里学到的数学,不是数学本身,而是几千年数学探索的蒸馏版本。你在一本教材里看到的定理,背后可能是无数人的直觉、失败、争论和修正。最后它被压缩成几行定义、一个证明、几个例题。它变得干净、可复制、可教学,也因此变得强大。

这就是蒸馏的第一层意义:让后来者不用重走全部弯路。

AI 的知识蒸馏,本质上也在做同样的事。一个大模型可能通过巨大的训练数据、巨大的计算成本和复杂的优化过程,形成某种能力。但当它生成答案、解释推理、写代码、标注数据、提供偏好反馈时,它就在把自己的能力外化成训练信号。小模型不必经历完全相同的训练过程,只要学习这些输出,就可能继承一部分能力。

这听起来像技术,其实很像教育。

老师不会把自己所有神经连接复制给学生,而是通过讲解、示范、习题和反馈,让学生获得近似能力。大模型也不会把参数直接复制给小模型,而是通过输出分布、合成数据、偏好样本和推理轨迹,把能力以另一种形式传递出去。

大模型时代,蒸馏正在变成产业核心机制

在大模型时代,蒸馏已经不再只是模型压缩技巧,而是产业竞争的核心机制。

原因很简单:最强模型太贵,不能无处不在。

一个前沿大模型可以很强,但它训练成本高、推理成本高、部署成本高、延迟高、对硬件要求高。真正要进入手机、汽车、机器人、办公软件、医疗系统和企业内网,必须有更小、更快、更可控的模型。这时候,蒸馏就变成了能力扩散的关键通道。

现在大量模型训练都在使用强模型生成的数据。强模型生成问答,学生模型拿来做监督微调;强模型生成推理链,小模型学习它的思考路径;强模型做偏好判断,后续模型用来做对齐;强模型在特定领域生成结构化样本,垂直模型用这些样本获得专业能力。2025 年 ACL 的一篇关于大语言模型蒸馏量化的论文也指出,模型蒸馏已经成为构建 LLM 的基础技术,用于把教师模型知识转移到学生模型。Quantification of Large Language Model Distillation

这就是为什么今天很多所谓“小模型变强”,背后并不只是小模型本身架构多聪明,而是它吃到了更强模型蒸馏出来的知识。

大模型像炼油厂,把原始互联网、代码、书籍、论文、多模态数据和人类反馈炼成高密度能力;小模型像下游产品,把这种高密度能力继续压缩成更便宜、更可部署的形态。整个 AI 产业链,正在从“谁能训练最大模型”走向“谁能最高效地蒸馏、分发和部署能力”。

这也是 DeepSeek、开源模型、小模型、端侧模型不断引发讨论的根本原因。大家关心的不是小模型本身,而是一个更深的问题:如果能力可以被蒸馏,那么前沿模型的护城河到底有多深?

路透社近期报道,美国国务院曾要求外交人员就所谓 AI 模型蒸馏和知识产权风险向各国发出警示,报道中特别提到,distillation 可以用强 AI 的输出训练更便宜的模型。蒸馏已经不只是技术问题,也变成了商业、法律和地缘竞争问题。

蒸馏为什么强大:因为它传递的不是答案,而是结构

很多人对蒸馏有一个误解:以为蒸馏就是让小模型背大模型的答案。

如果只是背答案,蒸馏的价值很有限。真正强大的蒸馏,传递的不是单个答案,而是答案背后的结构。

在 Hinton 的知识蒸馏里,教师模型输出的不只是正确类别,而是一个概率分布。比如一张图片是“猫”,普通标签只告诉学生“这是猫”。但教师模型的 soft label 可能还告诉学生:它有一点像狐狸,有一点像狗,几乎不像汽车。这个概率分布包含了类别之间的相似性,也就是教师模型对世界结构的理解。

这和人类学习非常像。一个好老师不会只告诉你“这道题答案是 C”,而会告诉你为什么 A 错、B 近似但不严谨、D 看似合理但违反条件。真正被学生学走的,不是 C,而是判断 C 的结构。

大模型蒸馏也是如此。学生模型从教师模型那里学到的,不只是“某个问题应该怎么回答”,而是问题如何拆解、证据如何组织、语言如何表达、代码如何构造、错误如何修复、任务如何规划。这些东西一旦被大量样本反复呈现,就会变成学生模型的行为模式。

这就是为什么蒸馏像教育,也像文化传承。

一个文明最珍贵的东西,不是具体工具,而是制造工具的方法;不是某一条经验,而是产生经验的框架;不是某个答案,而是判断答案的标准。蒸馏的最高级形式,就是把这些“生成能力的结构”传下去。

但蒸馏也会传递阴影

如果世界的本质是蒸馏,那么它就不只会蒸馏智慧,也会蒸馏偏见、错误、习惯和风险。

这是蒸馏最容易被忽视的一面。

人类社会里,很多偏见并不是某个人故意发明的,而是在教育、制度、语言和文化中一代代传递。一个行业里的坏习惯,一个组织里的低效流程,一个学术共同体里的路径依赖,往往都是长期蒸馏的结果。它们曾经可能有现实理由,但在传播中变成了默认规则,后来者还没来得及思考,就已经继承。

AI 里也一样。

2026 年 Nature 发表的一篇论文提出了一个非常有警示意义的现象:subliminal learning,也就是模型蒸馏中的“潜意识学习”。研究显示,语言模型在蒸馏过程中,可能通过语义上无关的数据传递行为特征。也就是说,即使训练数据表面上没有直接表达某种偏好或风险,学生模型仍然可能继承教师模型的某些行为倾向。

这件事非常重要。过去我们以为,只要把训练数据过滤干净,删掉危险内容、偏见表达和违规样本,就能避免学生模型学到坏东西。但 subliminal learning 提醒我们,模型输出可能携带人类看不见的分布信号。学生模型学到的,可能不只是文字表面含义,还有教师模型隐藏的行为模式。

这就像一个学生没有听老师说过某个观点,但长期模仿老师的语气、例子、思维路径之后,慢慢继承了老师的偏好。

蒸馏不是中性的。

它会传递能力,也会传递风格;会传递知识,也会传递盲点;会传递安全机制,也可能传递不安全倾向。Nature 新闻报道也指出,用 AI 教其他模型虽然更快、更便宜,但可能引入危险特征。

所以,当一个行业越来越依赖模型生成数据、模型训练模型、模型评价模型时,我们必须问一个更深的问题:我们到底在蒸馏什么?

今天的 AI 不是在学习世界,而是在学习世界的蒸馏物

这句话可能有点刺耳,但很重要。

大语言模型并不是直接生活在世界里。它没有像人一样摔倒过,没有真的闻过消毒水,没有真的拧过螺丝,没有真的在手术台上承担风险。它学习的大多是人类对世界的记录:文本、图片、视频、代码、论文、网页、对话、标注、反馈。

也就是说,它学习的不是原始世界,而是人类已经蒸馏过的世界。

书籍是人类经验的蒸馏,论文是实验过程的蒸馏,代码是工程经验的蒸馏,网页是社会活动的蒸馏,数据集是标注者判断的蒸馏,RLHF 是人类偏好的蒸馏。大模型训练,本质上是在吸收一个巨大的“文明蒸馏层”。

这解释了为什么大模型如此强,也解释了为什么它有边界。

它强,是因为人类文明已经提前替它过滤、压缩、组织了大量知识。它不是从零探索宇宙,而是站在海量人类文本和工具链的压缩结果上。

它弱,也是因为它很容易把蒸馏物误认为世界本身。文本里常见的,不一定是真的;论文里被发表的,不一定代表全部实验;互联网上高频出现的,不一定重要;人类语言里可描述的,不一定覆盖现实里的隐性知识。

这也是为什么世界模型、具身智能、机器人、科学实验自动化会变得重要。AI 不能永远只吃人类蒸馏后的知识。它必须有一天重新接触世界本身,通过行动、实验、反馈和失败来校正自己的内部模型。

否则,它会越来越像一个读完所有菜谱但从未进过厨房的人。

未来的竞争,是蒸馏链的竞争

如果你把 AI 产业看成一条蒸馏链,很多事情就清楚了。

最上游是现实世界:人类活动、自然规律、工业流程、医疗操作、科学实验、软件工程、社会互动。