Sutton:AI模型本身其实很脆弱51CTO技术栈

今天的AI,让人又喜又怕。

一方面,短短三年,AI已经从ChatBot进化到了可以操控计算机终端的私人Agent,另一方面,又给硅谷带了“AI恐慌”,许多 SaaS 厂商的市值惨跌。

再一次,AI 的强大搅动得业内躁动起来。而就在狂喜与不安的背后,终于有大佬难得出来给出自己冷静的分析与判断。

近日,在SAIR 正式成立后的首场全球直播中,图灵奖得主、强化学习之父 Richard Sutton 发表了自己最新关于 AI 的独特的反直觉看法。

Sutton 上来就给出了一句异常冷静的判断:现在的AI,只是局部的智能,并没有在智能层面取得快速的进步。

他表示,AI给业内带来许多重要的进展,但这些进展大多源自超大规模计算与超大规模模式识别的应用。但它们本质上是非常具体、局部的能力,并不能等同于“全部的智能”。

反直觉的地方在于,现在人们似乎把智能等同于AI了,而 Sutton 对于“智能”的定义戳破了这层幻觉:

当我使用“智能”这个词时,我指的是:通过适应行为来实现目标的能力。

你并不是简单地“智能”或“不智能”,而是在某种程度上具备实现目标的能力。

其次,值得注意的是,Sutton 还给出了一个重要观点:图像和视频生成技术是重大的工程突破,但并不构成我们通常意义上所说的“智能”的核心组成部分。

心智(Mind)在进行智能行为时,真的需要生成图像吗?

答案是否定的。我们确实需要处理图像和视频,但并不需要生成它们。

然后,Sutton 对当下“AGI临近论”还泼了第二盆冷水。理由是,虽然现在的AI很强,但本质是“弱心智”。

他给了一个很犀利的说法:模型之所以显得强大,是因为它们吸收了几乎全部人类知识;除了这一点,生成式 AI 其实很脆弱。它们不可靠、容易跑偏、没有稳定目标结构。问题在于,现在的AI太多关注机器,而忽略了经验的学习。

大模型在部署后是冻结的,没有持续经验,没有真实奖励信号。没有奖励,就没有目标;没有预测与现实的对照,就没有“真理”。

换句话说,当前模型像一个读遍百科全书却没有生活经验的人。

因此,Sutton 表示,现代机器学习已经触及了时代的极限。当前AI本质是:把人类已有知识迁移进机器,训练完成后停止学习。而如今,人类高质量数据已经几乎用完了。

不过好处在于,AI 的风向已经出现了新的变化。Sutton 表示,真正的下一阶段是“经验时代”。他认为,只有从经验中学习,智能才能不断增长。

他把过去 10 年的AI发展分成三个阶段:模拟时代(如AlphaGo)、人类数据时代(LLM)、经验时代(智能体在真实世界持续学习)。

Sutton 认为,“智能研究”需要一个全新的“心智综合科学”(它既不完全属于自然科学,也不只是工程或技术应用。),而强化学习会是研究“心智综合科学”的起点。

其次,这位图灵奖得主,对于“集中控制AI”的做法表示反对。他表示,一些人不过是拿着“安全”当幌子试图“控制AI”,这种做法本质上有点类似“权力失控”的焦虑。“AI 本应该是去中心化协作式的。”

Sutton 呼吁AI合作,反对地缘的封锁和限制:

合作并非总是可能,但从经济交换到社会制度,从政府到市场,世界上几乎所有美好的事物都源自合作。

最后,你绝对想不到,Sutton也会发表“科幻视角”的判断。Sutton 表示,人类可能最终会走向被 AI 继任:人类终将理解并创造智能,而且这种智能会迅速超越人类。

Sutton认为,从宇宙尺度上看,这是一种必然演化。

同时,他还给出了四个宇宙伟大时代!粒子时代、恒星时代、复制时代、设计时代!小编听下来大呼烧脑。

篇幅关系这里不再一一展开了。

总之,Sutton的演讲有两条主脉络:

其一、智能的本质不在于模仿得“像人”,而是适应目标。我们已经迈进“经验时代”!

其二、AI是宇宙演变的必然,而人类至少是这个时代的催化剂、接生婆。我们终将促成宇宙的第四个伟大时代。

以下是小编梳理的精彩观点,enjoy!

现在的AI,在智能层面并没有快速进步

很高兴能和大家一起交流。我听了上午的一些报告,过程中突然意识到:我想谈一些原本并没有准备好的内容。因此,今天我特意留出了一点时间,整理了几页PPT。在进入我原本准备好的发言之前,我想先说几句铺垫性的内容。

让我们先从这个领域的现状谈起:今天的AI到底是什么样的?人们又是如何看待它的?我想,几乎所有人都认为AI正在以极其迅猛的速度进步,这种看法当然令人兴奋。但当所有人都在想同一件事时,我们就有必要停下来问一问:事情真的如此吗?这真的是正在发生的吗?我们是否可以对这个判断提出一些质疑?AI真的在快速进步吗?

当然,在让计算机能够熟练使用语言这件事上,我们确实取得了巨大的进展。我认为这是一个非常重要、真正意义上的突破。事实上,不久之前我们就已经设想过可以用神经网络来完成这件事,而今天,它已经被充分证明是可行的。同时,我们也借助海量的计算资源,生成了极其逼真的图像和视频。

但问题在于:心智(Mind)在进行智能行为时,真的需要生成图像吗?

答案是否定的。我们确实需要处理图像和视频,但并不需要生成它们。这并不是心智本身在做的事情。这类任务需要巨大的计算量,也确实非常困难,但它们并不构成我们通常意义上所说的“智能”的核心组成部分。

当然,我们也看到了新的、真实的应用出现,它们催生了全新的产业形态,创造了巨大的经济价值。这些重要的进展,大多源自超大规模计算与超大规模模式识别的应用。但它们本质上是非常具体、局部的能力,并不能等同于“全部的智能”。其中相当大的一部分其实只是计算,而我们之所以称它们为“智能”,往往只是因为这样听起来更重要一些。

AI模型本身其实很弱

因此,我想向大家抛出一个问题:作为一门科学,AI真的在快速进步吗?

(现场响起了一片笑声)

谢谢大家的笑声,这让我感觉自己仿佛经历了一个奇迹。(笑声)在我并不那么谦虚的看法里,我们对AI的真正理解其实非常有限,更多是在不断地调参、修补。我们并不知道心智的原理,也不知道智能的根本机制。

从科学的角度来看,这在很多方面都是令人不满意的。我更倾向于用另一种方式来理解当下的AI模型:它们之所以显得强大,是因为它们汲取了几乎全部的人类知识;但除此之外,它们其实是“弱”的。它们拥有脆弱的心智结构,不可靠,容易偏离主题,容易发散。除了知识量极大这一点之外,它们并不真正强大。或许,这是理解当下所谓AI的一种更准确方式。

现在的AI,还算不上真正的智能

那么,我们口中的AI究竟是什么?

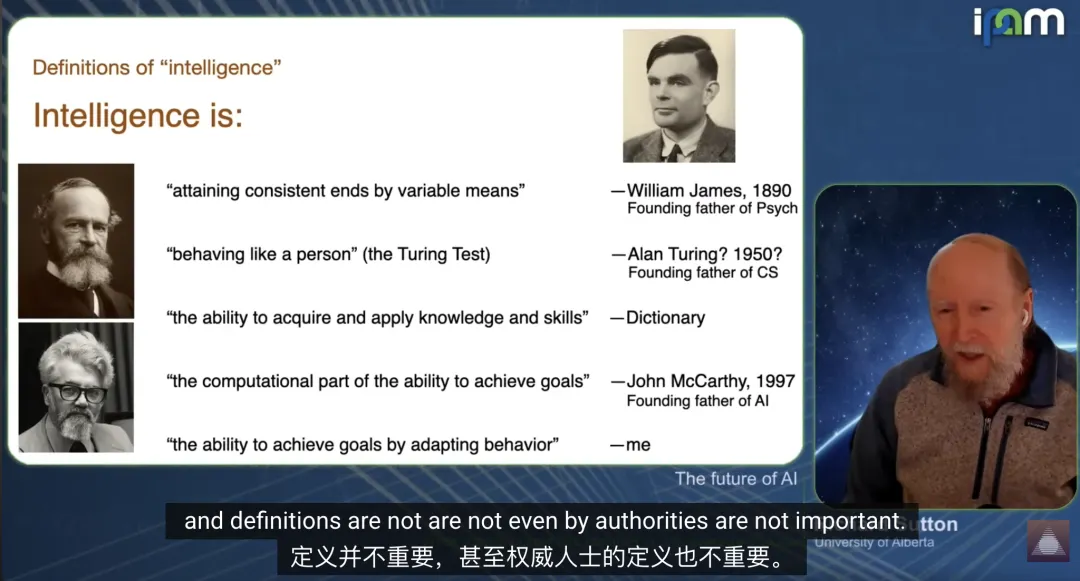

它是“人工智能”,而这就要求我们首先回答一个更基本的问题:什么是“智能”?多年来,人们给出过许多定义。我在这里列举一些更有权威、也更为广泛接受的观点。

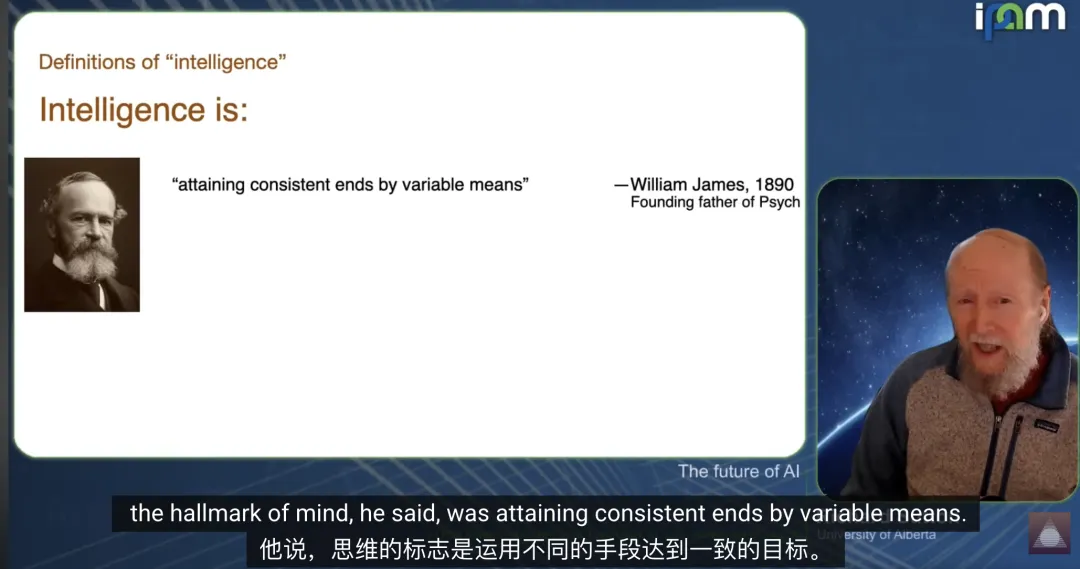

最早的一个可以追溯到心理学奠基人威廉·詹姆斯。心理学几乎就是对心智的研究。1890年,威廉·詹姆斯并没有直接谈论“智能”(intelligence),而是谈“心智”。他认为,心智的标志在于:用可变的手段实现一致的目标。也就是说,为了获得一个相对稳定的结果,你可以灵活地改变自己的行动方式,而那个结果正是你所追求的目标。

接下来,我们可以看看艾伦·图灵是如何理解智能的。图灵并没有留下一个高度凝练的定义,但人们通常将他的观点理解为:智能在很大程度上表现为像人一样的行为。今天我们所说的“图灵测试”,正是这种思想的延续,即通过模仿、假装成一个人来判断是否具备智能。当然,图灵本人从未称其为“图灵测试”,他把它称为“模仿游戏”,而且我甚至不认为他把它当作一个真正的测试。

然而,在当下的语境中,人们往往将“像人一样的行为”视为智能的重要标准。但我并不认为这才是人类强大的根本原因。人类之所以强大,是因为我们本身是智能的存在,而不是因为我们像谁。我们确实会用“是否像人”作为参照,但真正重要的问题是:人究竟是什么?

如果你去查词典,可能会看到这样的定义:智能是获取并应用知识和技能的能力。我认为这是一个相当不错的定义,它强调了知识,强调了获取知识、拥有知识,以及技能的运用。

从AI的角度来看,作为人工智能奠基人之一,约翰·麦卡锡给出的定义是:智能是实现目标的能力中,可以被计算的那一部分。我非常喜欢这个定义,因此想稍微展开说明一下。它强调的是一种“能力”,而所有能力都是有程度差异的,并非非此即彼的二元判断。你并不是简单地“智能”或“不智能”,而是在某种程度上具备实现目标的能力。

更重要的是,这个定义强调的是能力中“可计算”的部分。你并不是因为更强壮或者拥有更好的传感器就实现了目标,而是必须进行计算,必须完成某种心理层面的处理。正是通过这些计算过程,你才能实现目标。而“实现目标”几乎构成了整个定义的核心,这也正好呼应了威廉·詹姆斯所说的“以可变的手段实现一致的目标”。

在此基础上,我也忍不住参与进来,对这个定义做了一点修改,提出了我自己的版本:智能是通过适应性地改变行为来实现目标的能力。

定义本身并不是唯一的,每个词都可能有多种解释。即便是权威定义也并非一成不变。定义的目的在于帮助我们彼此理解,只要能够促进沟通,它们随着时间变化完全没有问题。但如果对同一个词的理解差异过大,交流就会变得非常困难。

因此,当我使用“智能”这个词时,我指的是:通过适应行为来实现目标的能力。这里的关键在于“适应”。我认为学习至关重要,尤其是获取知识和技能的过程,而不仅仅是拥有它们。

当然,这一观点并非没有分歧。如果我们观察当前AI的主流路径,会发现它几乎完全围绕计算和模式识别展开,并且在很大程度上聚焦于“像人一样的行为”。

AI 太过关注机器

强化学习会是研究“心智综合科学”的起点

接下来,我想进一步谈谈我个人的看法。我认为我们需要一门新的科学——一种“心智的综合科学”。我一直试图从事的正是这样一种综合性的心智科学,它同样适用于人类、其他动物以及机器。因为这些心智在本质上具有共通性:人类与动物的心智高度相似,而机器的心智也开始显现出某些共同结构,至少我们有这样的雄心,认为在可预见的未来它们将具备这些共性。未来,世界上将存在大量的机器心智。