蒸馏同事炼化自己,AI仿佛一种黑魔法凤凰网科技

「任何足够先进的技术都与魔法无异。」——阿瑟·克拉克

我在想,为什么每次看到「蒸馏」这个词,总会有一种生理上的不舒服。

这里说的蒸馏不是化学课上的那个,把水煮沸变成水蒸气,不是这个,而是新近 AI 圈子里流行的一件事:把一个人的经验、判断方式、工作方法,提炼成一份结构化的文件,交给 AI 去运行。

这份文件叫 skill,整个过程就叫「蒸馏」。

前不久张雪峰去世,很快,GitHub 上出现了一个开源项目,叫「张雪峰.skill」。开发者说,这不是语录合集,是一套「认知操作系统」。他们研究了张雪峰 5 本书、十几篇深度采访、三十多条语录,提炼出了他的核心思维模型和决策方法。

你可以问它,比如「我孩子河南考生 560 分想学金融怎么办」,它会像张雪峰一样先追问你家庭背景,然后用他那套就业倒推法给你分析,最后不留情面地告诉你先保学校档次再考虑专业。

人没了,Skill 还在替他回答问题。

不光有张雪峰,有人蒸馏出了乔布斯 skill、马斯克 skill、芒格 skill、费曼 skill、特朗普 skill,甚至有毛选 skill。有人做了一整套「数字永生框架」,号称能从你的聊天记录和社交媒体里蒸馏出你的数字分身。

还有「同事 Skill」,能把员工的一套工作方式都总结出来,然后真人员工就不再需要了,「聚是 token,散是 skill」。相对应,有人搞了个「蒸馏协议」,戏称「牛马保护法」,帮你规定公司能不能蒸馏你,蒸馏出来的东西能不能商用,你的数字分身能不能替代你上班。

这算不算异化?马克思讲的那个——劳动者创造的东西不属于劳动者,反过来控制劳动者。公司把你的能力蒸馏成 skill,然后用你的 skill 替代了你,这不就是吗?经典牛马叙事,讲了两百年了。

但如果只是异化,我不会不舒服到这个程度。打工人对异化早就麻了。你告诉我,我正在被资本剥削,OK,好,这事我一直都知道,顶多叹口气,然后继续干活。但你要是告诉我,要把我蒸馏成 skill,我的身体会缩一下。

这是一种生理上的反应,依据心理学的观点,这是触碰到了某些心理原型,因而激发了恶心感。

我们可以先不考虑 AI 这件事,先回到「蒸馏」这个词上,想象一下蒸馏这个过程本身。

蒸馏到底是什么样子?我们应该都见过。现在我们试着把这个过程完整地在脑子里播放一遍。

一个容器,可能是个烧杯,可能是个长颈瓶一类的,里面装着液体。加热。温度升上去之后,液体里的某些成分开始气化,变成蒸汽往上走。蒸汽通过一根管道被导到另一个容器里,在那里冷却,重新变成液体。这部分液体就是馏出物——纯净的、浓缩的、被需要的部分,而留在原来那个容器底部的,是残渣,也就是要倒掉的东西。

这里面至少有三层让我不舒服的地方。

第一是加热。提取不是温柔的,不是从你身上轻轻舀走一勺。它需要对原料施加压力。你得被加热,被逼着改变状态,你身体里的某些东西才会被逼出来。

公司让你把工作经验「沉淀」成文档、把决策逻辑写成 SOP、把你的最佳实践「输出」出来——这些听着很正常的管理动作,如果用蒸馏的画面去看,就是在对你加温。你得反复追问自己,把模糊的直觉强行翻译成清晰的语言。这个过程不舒服,因为它本质上就是施压。

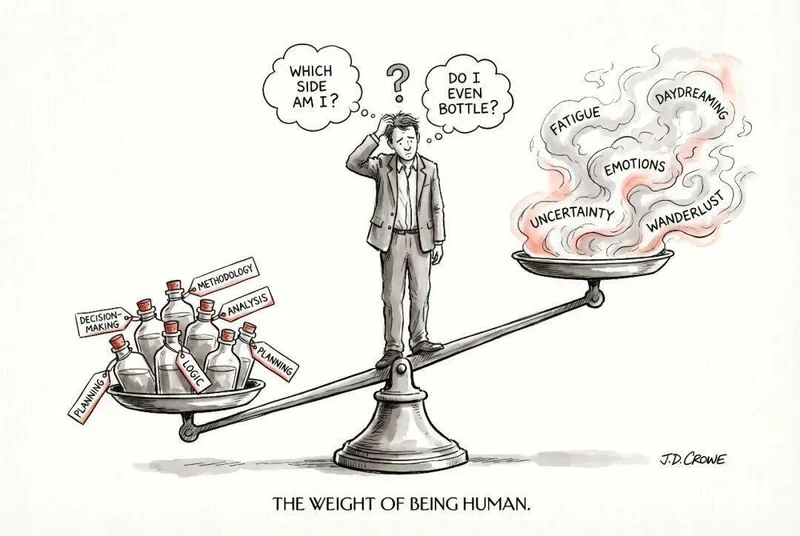

第二是分离。蒸馏的目的是把「有价值的部分」和「没价值的部分」分开。这里面藏着一个判断:你这个人是一种混合物,其中只有一部分是被需要的,比如你的决策模式、你的工作方法、你的判断习惯——这些是馏出物,要被收集。其他的,你的疲惫、你的情绪波动、你每天午饭后犯的困、你对工作意义的追问、你在做判断之前盯着窗外发呆的那三分钟——这些是杂质。这个词在使用的瞬间,就已经把你拆件估值了。

容器本身也让人觉得不舒服。馏出物被收走了,到了一个新的容器里,干净、纯粹、脱离了原来的基质。原来的容器还在,但它已经不重要了。想想看,你不是那个馏出物。你的 skill 是馏出物,你的经验的精华是馏出物。你是什么?你是那个被烧过之后还留在底部的东西。你是原料,不是产品。

如果我们换个词,比如「学习」「传承」「记录」「数字化」这些,这些词也很烦人,但不会让你不舒服。它们的画面里没有火,没有残渣,没有等级判断。

但蒸馏不是,蒸馏的物理过程自带了一整套关于纯与不纯、精华与废料、有价值与无价值的隐喻。你只要用了这个词,这套隐喻就跟着进来。

所以我的对于「蒸馏」的不舒服,并不仅仅来自蒸馏这件事的后果,也来自它所携带的画面。这个画面告诉我:你是原料,你将被加热,你身上有一部分比另一部分更有价值,有价值的那部分会被取走,然后你就是剩下的那个东西。

但这里就有一个问题,「蒸馏」这个词不是 AI 行业发明的,至少大家最早接触它,应该是在化学或者物理课上,那么 AI 的人为什么偏偏选了这个词?它是怎么进入 AI 领域的?

因为 Jeffrey Hinton,这位 AI 领域的教父级人物。

2015 年,Hinton 和 Google 的两个同事发了一篇论文,标题叫《Distilling the Knowledge in a Neural Network》,蒸馏神经网络中的知识。

这篇论文要解决的问题是:大模型太大了,跑起来太贵,没法部署到手机上、没法塞进实时服务里。2015 年的大模型放到今天看不算大,但当时已经够让工程师头疼了——多个模型组成的集成系统,推理一次要把每个子模型都跑一遍,成本扛不住。当然到了今天,这个问题被放大了千万倍:GPT-4 这种几千亿参数的模型,你不可能让每个用户的每次请求都跑一遍完整版本。