南加大研究实锤:认知多样性正在被抹平量子位

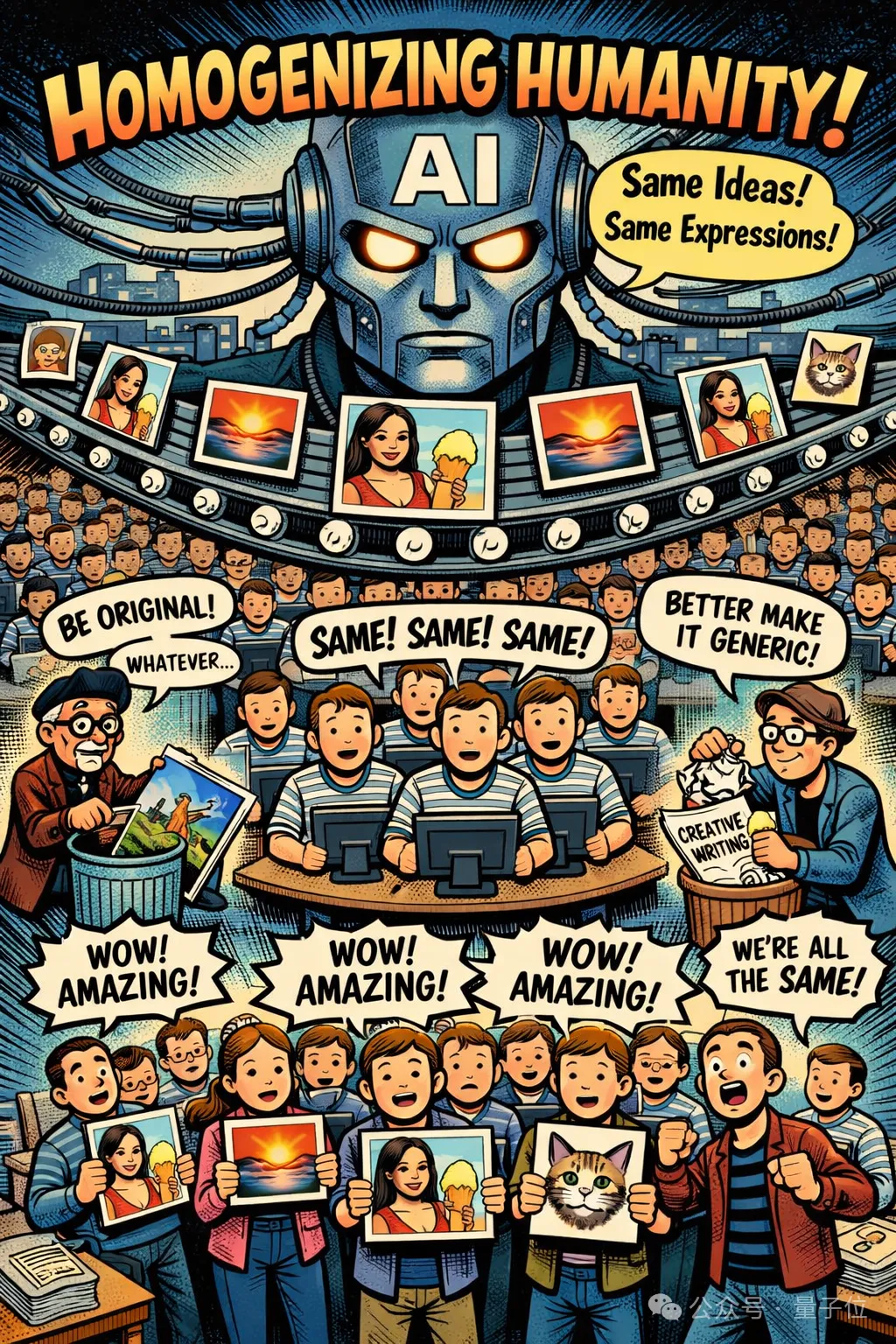

真有研究证实了:AI正在让全人类的想法和表达越来越同质化。

比如满大街的“不是…而是…”,或者写出来的代码,做出来的页面设计,都有明显的AI风。

一篇来自南加州大学的论文指出,如果这种同质化趋势继续不受控制地发展下去,就有可能削弱人类的集体智慧和适应能力。

大语言模型带来了一个悖论,它们既是模拟人类思维的强大工具,也可能消解人们的认知多样性。

有些网友认为:你开始使用AI时的年龄越大,你越有可能保留自己的思考能力——前提是你清楚地知道AI在做什么,并且没有把所有工作都外包给它。

也有人指出:平庸的同质化在AI出现之前就已经发生了,但AI的加速发展,使年轻一代可能正在丧失理性思考的能力。

AI正在抹平认知多样性

先讲一个关键前提:对人类来说,认知多样性很重要。

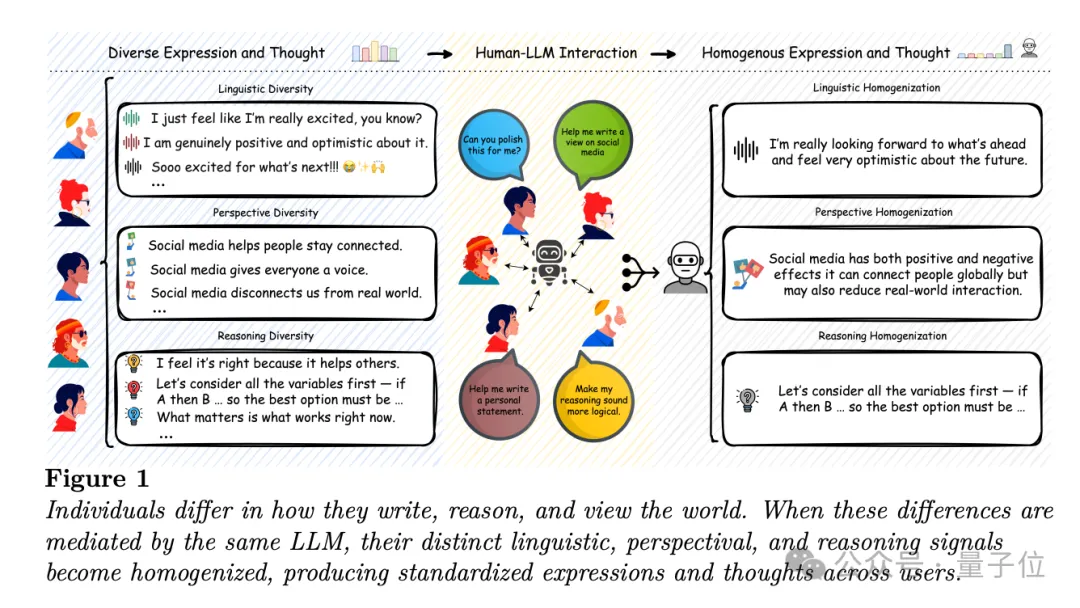

每个人因为文化、经历、背景不一样,说话的风格、看问题的角度、想事情的思路都千差万别,这就是 “认知多样性”。

这种差异比你想象的更宝贵。它能让团队更会解决问题、社会更有创造力,还能避免大家陷入集体思维僵化。

每个人都从不同角度出发想问题,凑在一起才能把事情想全面。

现在,这项研究指出,AI正在抹平这种多样性。

主要体现在语言、视角和推理三个方面。

首先是说话写作变单一了。

用AI润色或代写的内容,不管是朋友圈、论文还是邮件,风格都越来越像,很难看出作者的性格和背景差异了。

哪怕刻意让AI模仿不同风格,也只是表面功夫,没法还原真实的语言差异。

研究指出,AI生成的文本在写作复杂度上趋于一致,降低了人格、性别或年龄等作者特征的可预测性,甚至削弱了已被证实的关联。

更重要的是,AI也会影响人们使用语言的方式,让人们的表达趋于同质化,这会掩盖真实的表达个性。

即便对于那些只是接触AI生成文本的人来说,也会削弱语气、文化和身份认同方面的差异。

第二,看问题的角度被局限。

AI的写作风格并不是中立的,其本身就是偏见的来源,会在强化主流表达规范的同时,弱化少数群体和代表性不足群体的声音。

研究者做了一项实验,借助世界价值观调查以及道德基础问卷,将温度值设为1.0、对GPT-3.5进行了1000次测试,并将结果与来自不同文化背景的人类回答进行对比。

结果发现,AI的输出与西方精英阶层的典型回答模式更为契合。

相比之下,对其他文化、小众群体的看法要么体现不出来,要么就是刻板印象。

研究人员发现,尽管在明确提示下(例如调整生成参数、加入身份编码指令或将提示语翻译成目标语言),AI能够模拟多样化观点,但也无法让输出与目标群体中观点的实际分布相匹配。

此外,当人们依赖AI写作时,AI也会反过来影响人们构建和表达自身观点的方式。

相关研究证实了这一效应——

人在和带有偏向性的AI一起写东西时,其写作内容往往会模仿AI的立场,甚至在后续的态度调查中改变自身的观点。

第三,推理思路被固化。

人们进行推理、解决问题和产生新想法的方式非常多样,这源于文化和个体差异。

例如,美洲原住民(梅诺米尼族)儿童通常根据生态关系对动物进行归类,比如共享栖息地或相互依存,而欧美儿童则倾向于依据分类学范畴,这反映了人们在认知方式上的更广泛差异。

AI最擅长 “一步一步按逻辑推理”的思维链,尽管推理结果往往与人类一致,但缺乏人类思维所特有的自然变异性。

这种思考方式被越用越多,反而让人类那些 “直觉式、跳跃式、从文化和经验出发” 的思考方式被冷落了。

比如用AI想创意,每个人想出的点子都特别像,少了独有的脑洞;就连做决策,大家也都跟着AI的逻辑走,失去了多样的解题思路。

还有神经认知研究表明,与独立写作和依靠搜索引擎相比,AI辅助写作引发的整体神经耦合最弱,阿尔法和贝塔网络的参与度降低,记忆力回忆能力下降,对写作成果的自主掌控感也有所减弱。

(写着写着,手中的稿子突然不香了……)

为啥AI会造成这种同质化?

一个原因是,AI的训练数据本身就“偏”。

AI 是靠海量网络数据训练的,这些数据里本来就是西方主流的语言、观点占大头,小众的、非主流的内容很少,AI自然学不会多样的表达和想法。

这一局限性不仅源于存在偏见的训练语料库,还会在训练过程本身中被放大——模型会倾向于频繁且易于泛化的模式,同时弱化少数群体的代表性内容。

其次,AI的训练目标是 “求稳”。

AI的核心是预测 “最可能的下一句话”,所以它会优先输出大众熟悉、不出错的内容,不会轻易生成小众、独特的表达,慢慢就把 “主流” 变成了 “唯一”。

此外,大家都用AI写东西、发内容,这些AI生成的 “标准化内容” 又会被重新收进数据里,用来训练下一代AI,这也会形成恶性循环。

AI的内容越来越单一,人们的思维也会更加趋同。

还有一个重要原因,那就是大家太依赖AI,放弃了自己的思考。

什么古法编程、古法写作,都是过去时了。

比起自己琢磨怎么写、怎么想,大家更愿意直接用AI的答案。

尤其是有了龙虾之后,那就更加离不开AI了,恨不得每天都有只🦞7×24小时帮自己干活。

(是谁中枪了??)

但这样慢慢就失去了独立表达和思考的能力,被AI的 “模板” 牵着鼻子走。

更关键的是,这种AI带来的思维趋同,并非朝着中立的中心趋势发展,而是趋向于西方精英阶层视角。

研究指出,当被要求表达观点或进行富有表现力的写作时,AI往往会再现主流的观点和写作风格,这与西方自由派高收入高学历男性的观点和风格如出一辙。

因此作者也在文中严肃警告:

一场全球性的 “西方化” 或许已然开启,曾经本土化的时间、空间与因果概念理解方式,正被同质化且偏向西方的模型所取代。

△图片由AI生成

其实呢,现在研究人员也在想办法让AI更 “多样”,比如调整AI的提示词、改进训练方式、让多个AI互相辩论来产出不同观点。

但目前来看,效果都有限。

目前社会语言环境中还是存在明显的同质化现象,需要进一步评估这些方法究竟是能创造真实且贴合语境的多样性,还是仅带来表面化的差异。

论文最后呼吁:别让AI毁了人类的多样性!

不是说不让用AI,而是说不能无节制地依赖AI。如果用不好,反而会让自己失去最宝贵的个性化,从而限制自己的发展。

起码今天,试着让自己手搓一下工作任务吧~