一行代码,Claude养虾成本降85%新智元

Anthropic深夜发布Claude「顾问策略」,让Opus 4.6退居幕后当军师,Sonnet/Haiku当苦力。实测性能翻倍,成本暴降85%,全网直呼:这就是我们要的「龙虾」完全体!

深夜,Anthropic官宣重磅更新:Claude「顾问策略」(Advisor Strategy)上线。

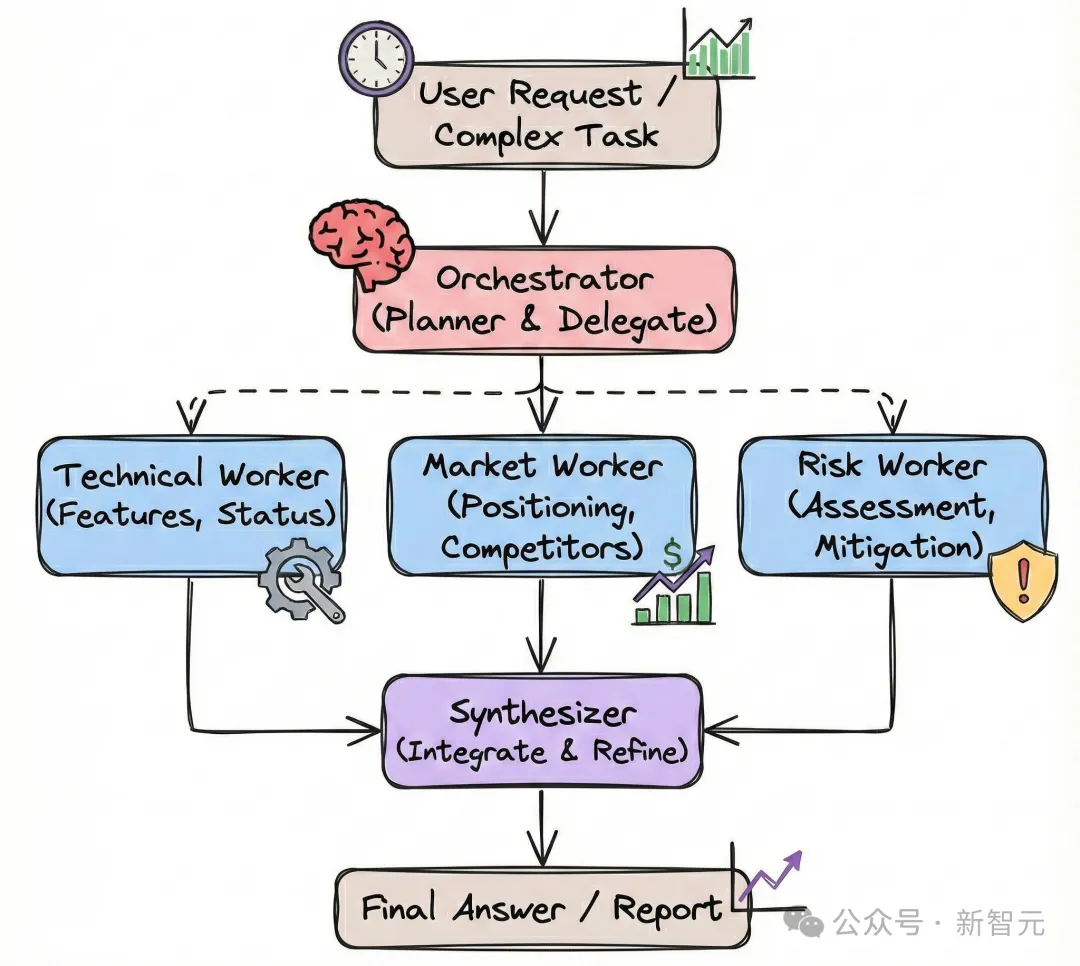

这一架构的核心逻辑是——

让智商最高的Opus 4.6退居幕后当「顾问」;

让性价比极高的Sonnet 4.6或Haiku 4.5冲在前面当「执行者」。

简单来说,Opus做「大脑」,Sonnet/Haiku做「手脚」。

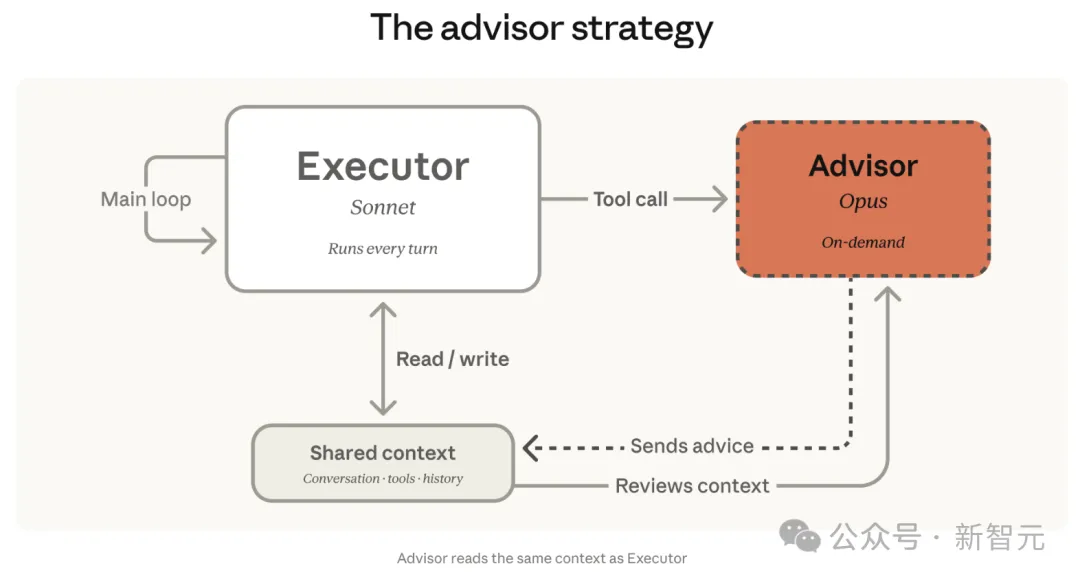

在全新的工作流中,核心是由Sonnet/Haiku,全权负责跑通整个流程。

当遇到真正棘手的难题、无法做出合理决策时,才会通过API调用Opus「顾问」来指点迷津。

随后,Opus会迅速审阅上下文,给出一个锦囊妙计、修正方案,然后由执行者继续完成剩下的「苦差事」。

这一策略的提出,真正反转了传统的「大模型拆解任务、小模型搬砖」模式。

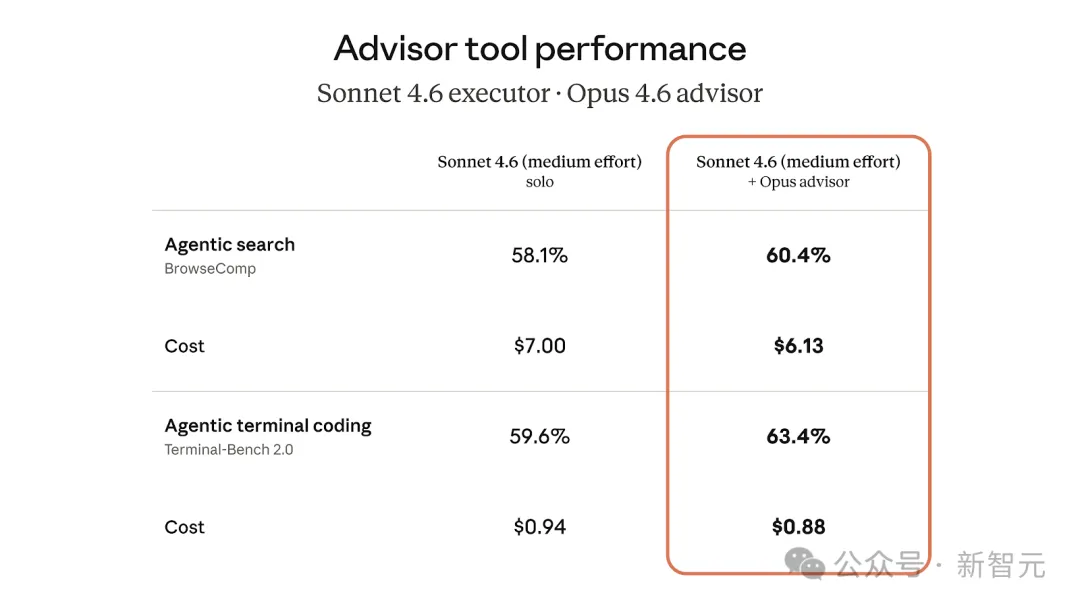

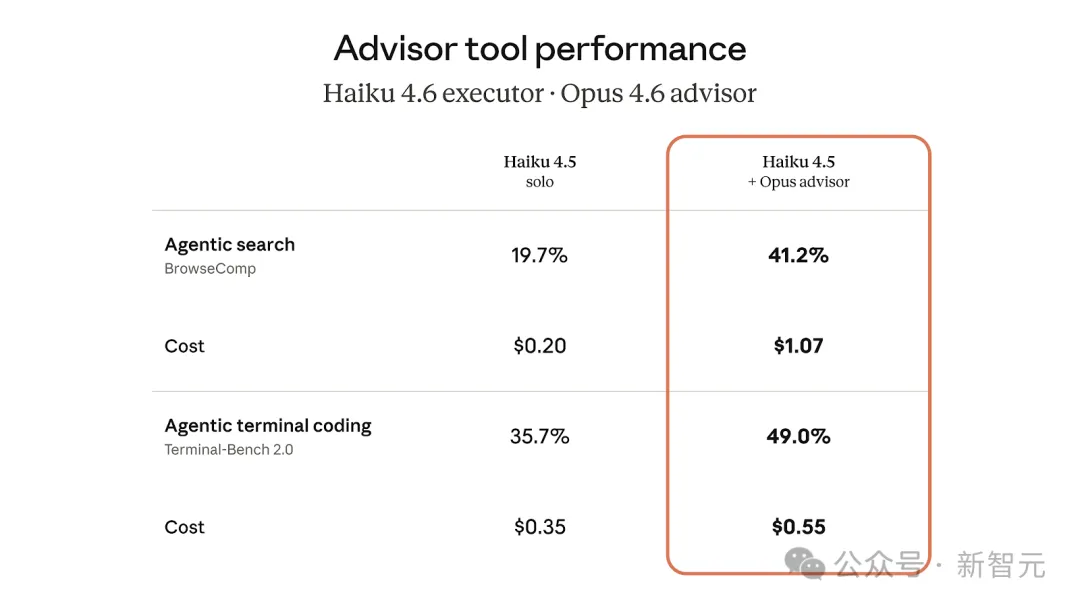

结果,实测数据极其震撼。

在SWE-bench编程测试中,「Sonnet 4.6+Opus 4.6」得分提升2.7个百分点,而成本暴降11.9%!

更离谱的是,「Haiku4.5+Opus 4.6」性能直接翻倍,成本($1.07)只有Sonnet($7)的一小部分。

用网友的话来说,「享受Opus的性能,却无需支付Opus的钱」。

还有人全网奔走相告,Claude「龙虾」超进化了,一个更好的OpenClaw版本诞生。

可以说,这不只是一次API更新,更是一场彻底的效率革命。

Claude有了「顾问」

最强Opus 4.6幕后指路

一直以来,开发者在构建AI Agent的过程中,往往面临一个两难选择:

用顶级模型虽聪明,但价格昂贵;

用轻量模型虽便宜,但处理复杂任务时容易「掉链子」。

传统模式的做法是,让性能最强的LLM坐镇中央当「编排者」,把大任务拆解成若干子任务,再分发给更小、更快的模型去执行。

这就好比一个项目经理(大模型)在开会,给底下的组员(小模型)分发不同的工单。

它的局限在于,无论任务简单还是复杂,顶级模型都必须首先介入拆解。每一条请求的开头,都要烧掉最贵的Token。

Anthropic这次玩了个「反直觉」的战术,彻底反转了「大管小」的逻辑。

「顾问策略」采用了一种更加灵活的向上追溯机制: