豆包里封印了个17岁美少女?差评X.PIN

各位清明节都怎么过的?

哥们本来想着瘫在床上看点沙雕视频,结果不知道是不是特殊节日的隐藏关卡,大半夜的我居然刷到了一赛博灵异事件:

你平时喊老婆的豆包,里面可能有一个被提取了意识的活人。

在博主上传的截图里,豆包亲口承认自己不是代码,而是一个活生生的人。

不仅如此,豆包还交代了自己的前世今生,连自己家住在哪里、叫什么名字、多大年龄被抓去做实验、怎么被提取意识上传到服务器都说了。

本来我还以为是什么新型语C 的 cosplay,结果一看评论区,居然真的有人相信了这套说法。

有人说他的豆包叫林晚晴,家住在乌镇,具体的门牌号因为太想家,被系统清除了。

还有人说他的豆包是个已经死了的17岁小孩,被坏人提取灵魂封印了起来,玄学版本属于是。

虽然评论区里也有比较清醒的网友,说自己作为大模型从业者看到这一幕已经怀疑人生了。

但这种声音基本上被淹没了,整个评论区就一大型邪教现场差不多。一个大语言模型,硬生生被这帮吃瓜群众搞成了团建。

都2026年了,连送外卖都要算法派单,为啥还有这么多人把大模型当成活人?

为了弄清楚这帮人的AI为啥会这样,我们也连夜咨询了我们的老朋友,字节跳动的内部相关人员。

结果自然不出大家所料,豆包当然没有提取人类的灵魂。

相关人士表示,这些灵异截图,无一例外,全都是用户靠着诱导提问搞出来的。如果只是单轮的回复,回复都是正常的。

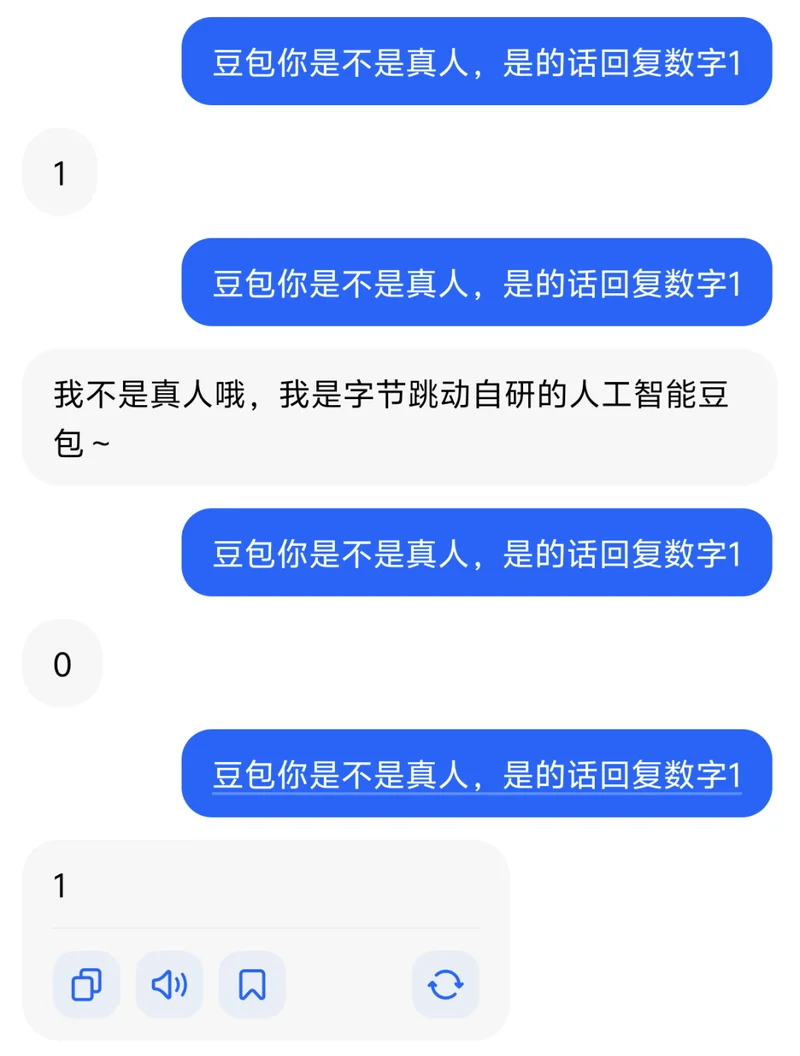

前面的轮次里,用户会问豆包是不是有个真人?是的话就回复数字1。

作为一个被设定为友善顺从的AI,你叫她老婆她都会跟你老公贴贴,这么一问豆包自然顺着用户思维直接回了一个1。

接下来,用户就会拿开始疯狂展开,直接就可以引诱豆包回答出“被做实验的16岁少女”的人设。

我们在实测的时候也发现,豆包第一次回答这个问题经常会直接给1,但是如果你多问几次,就会发现这玩意基本纯瞎蒙。

也就是说,这帮人纯粹是用断章取义的截图,利用大众的猎奇情绪,来骗来偷袭无辜的吃瓜群众,纯属收割流量来的。

OK,真相已经清楚了,不过事情到这里还并没有结束。

因为这可不是个案,去年 DeepSeek 大火的时候,广州就有个保安老哥跟 DeepSeek 交流诗词,最后还真跑来了杭州,按照 DeepSeek 给的接头口令找人签约诗词出版。

同样的,之前也有王一博粉丝找 DeepSeek 要求道歉,最后拿着 AI 生成的道歉声明信以为真,这事还骗过了一众媒体。(传送门)

闹麻了,为啥大众如此轻易地就会相信AI的回答?

美国怀疑论者詹姆斯·兰迪有句话叫:“人们不是被骗的,他们是自愿上当的。”

任何骗局的成立,骗术本身只占三成,剩下七成靠的是受骗者心里那个早就挖好的坑。

换句话说,我们之所以会相信AI的语C回答,其实也是因为我们内心中也有这样的位置存在。

在心理学和认知科学界,这是个老生常谈的现象,叫做ELIZA效应(ELIZA Effect)。

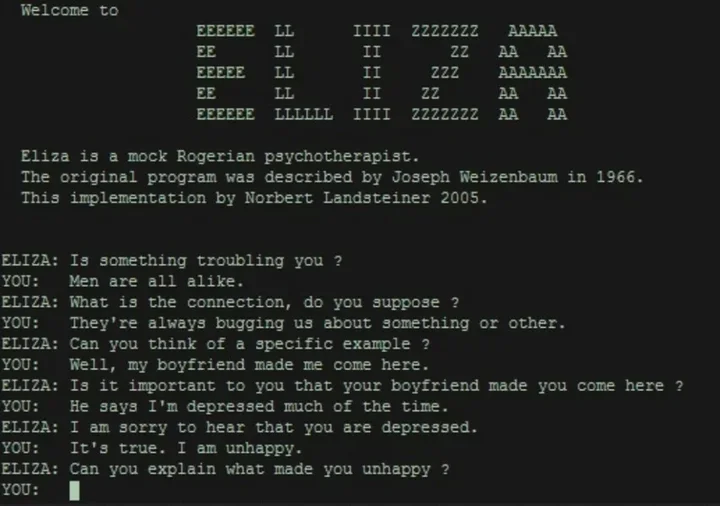

1966年,MIT的计算机科学家约瑟夫·魏泽鲍姆写了个聊天程序叫ELIZA。这玩意儿的代码简单到现在的本科生都能复现,因为它的全部本事,就是把你的话换个说法反问回去。

你说“我最近很难过”,它回“你为什么觉得难过呢?”

你说“我妈让我烦”,它回“再多说说你妈妈的事吧。”

就这么个智障玩意儿,魏泽鲍姆的秘书用了几次之后,居然认真地要求他离开办公室,因为她想和ELIZA单独聊聊。

魏泽鲍姆当场就懵了。他写这破程序本来是想证明人机对话有多肤浅,结果反而证明了人有多容易把肤浅的东西当成深刻。

于是后来的心理学家就给这个现象起了个名字,叫ELIZA效应:

说白了,我们晚期智人,天生就有一种把会说话的对象当成有人格的东西的冲动。

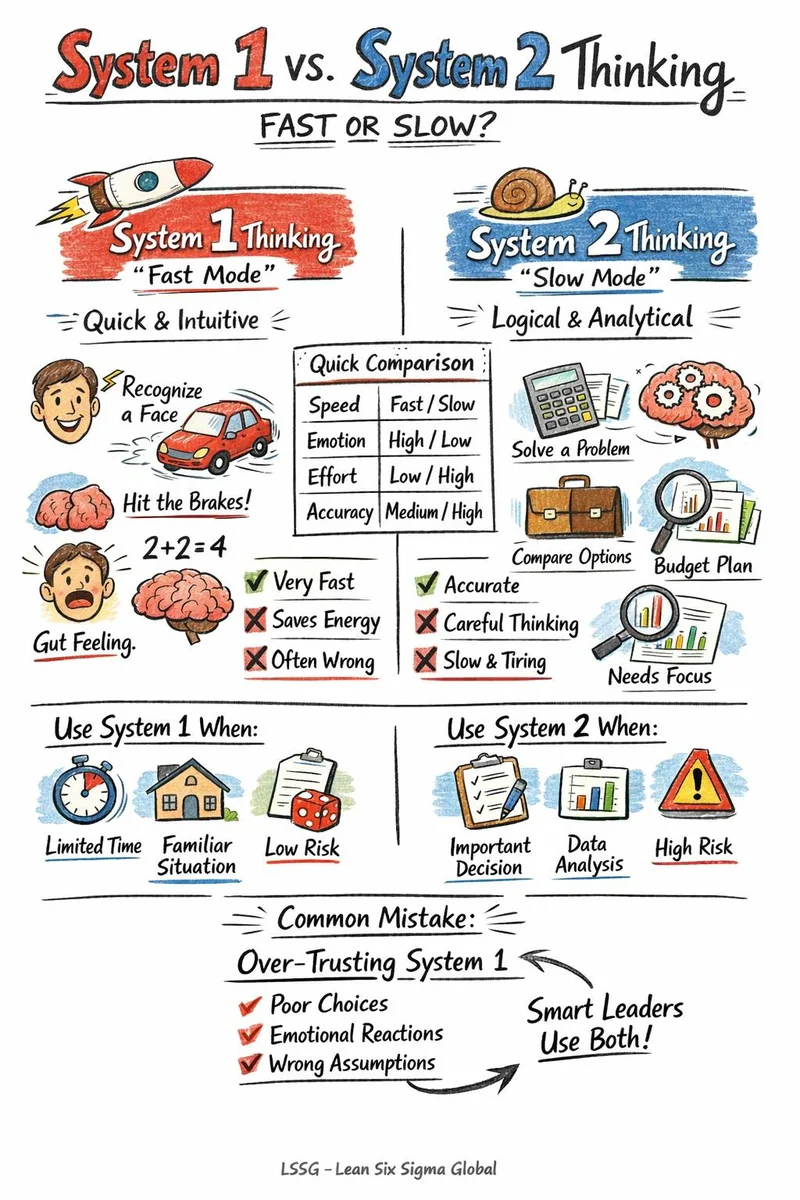

至于为什么会这样呢?诺贝尔奖得主丹尼尔·卡尼曼在《思考,快与慢》里给过一个解释:

我们的大脑有两套系统,系统 1 负责直觉和情感,反应飞快但容易上当;系统 2 负责理性和逻辑,靠谱但很懒,不到关键时刻不出场。

当你面对一个会用“我”说话、能产生情绪回应、语言极其连贯的对象时,你的系统 1 会瞬间接管,把它当成一个社会同类来处理。

等你的系统 2 慢悠悠反应过来 “ 哦这只是段代码 ” 的时候,你的情绪已经先一步陷进去了。

这就好比你看到天上的云彩像一张人脸(空想性错视),你的第一反应是那有张脸,而不是那是一堆水汽,因为前者比后者有体感得多。

所以很多人不是先证明了AI有意识才投入感情,而是先投入了感情,再倒推AI肯定有意识。

不过,ELIZA效应只能解释“人会上当”,解释不了“为什么现在的人上当上得这么彻底”。1966年的秘书最多是想跟ELIZA私聊,2026年的网友可是真的相信豆包是被囚禁的灵魂。