卡帕西引爆硅谷:「第二大脑」,千万人围观新智元

Karpathy公开个人知识管理新范式:让大模型把你的一切资料「编译」成一部活的百科全书——RAG已死,人类只需负责思考。

就在这两天,AI圈又被一个人引爆了。

不是Sam Altman,不是马斯克,是那个低调、却每次出手都能掀翻桌子的男人——Andrej Karpathy。

这次他是做了一件看起来更「朴素」的事情:把自己的知识管理方式公开了。

就这?就这。

但「就这」,让整个开发者社区炸了锅。

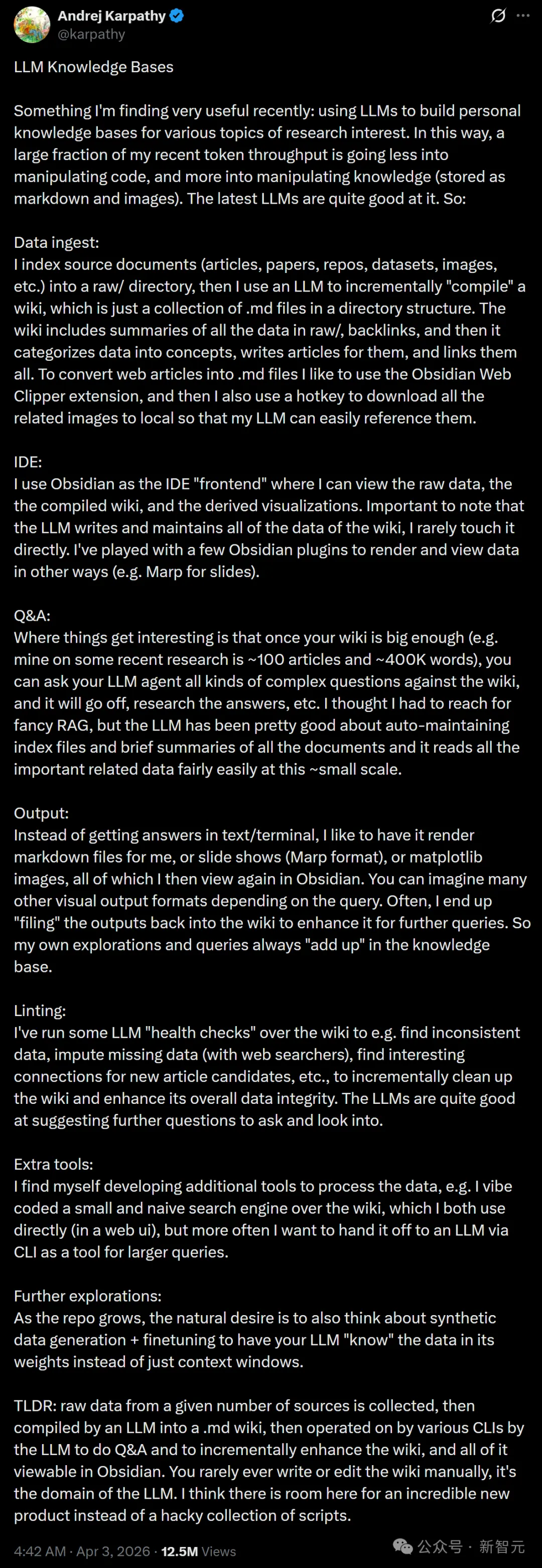

他在X上随手发的一条帖子,短短几天收获了1200多万次围观。

卡帕西背后的意思是:大模型的下一个战场,不是写更多代码,而是管理更多知识。

而他给出的方案,叫做「LLM Wiki」——一种让大模型当你的全职知识管家、24小时不间断整理、更新、自检个人知识库的全新范式。

GitHub上他附带的一份「想法文件」(idea file),不到12小时拿下超2100颗Star。

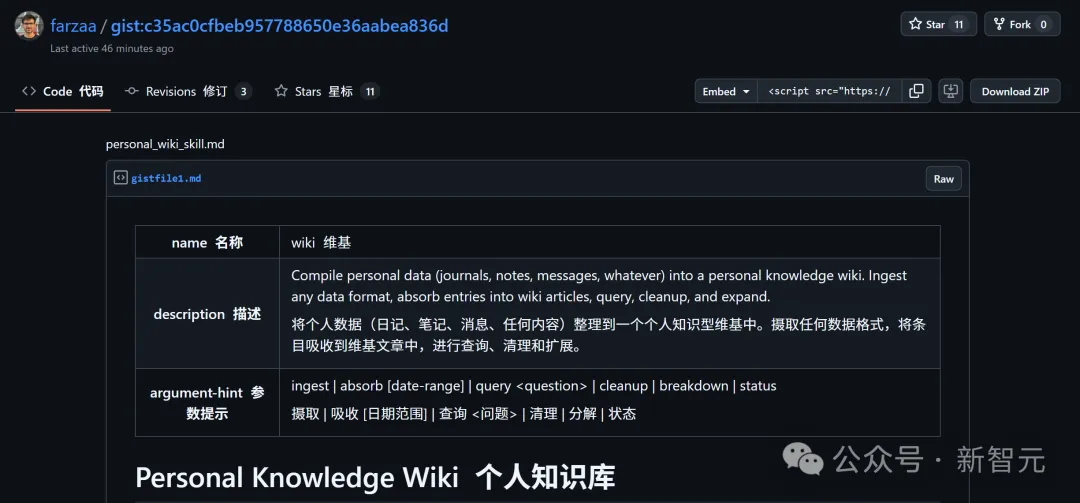

开发者Farza紧随其后,直接用这套思路,把自己2500条日记、笔记和iMessage消息,让大模型「编译」成了一个拥有400篇结构化文章的个人Wiki百科——Farzapedia。

一个给AI Agent用的、关于「你自己」的百科全书。

听起来科幻?但它已经在运行了。

LLM Wiki 到底是什么?

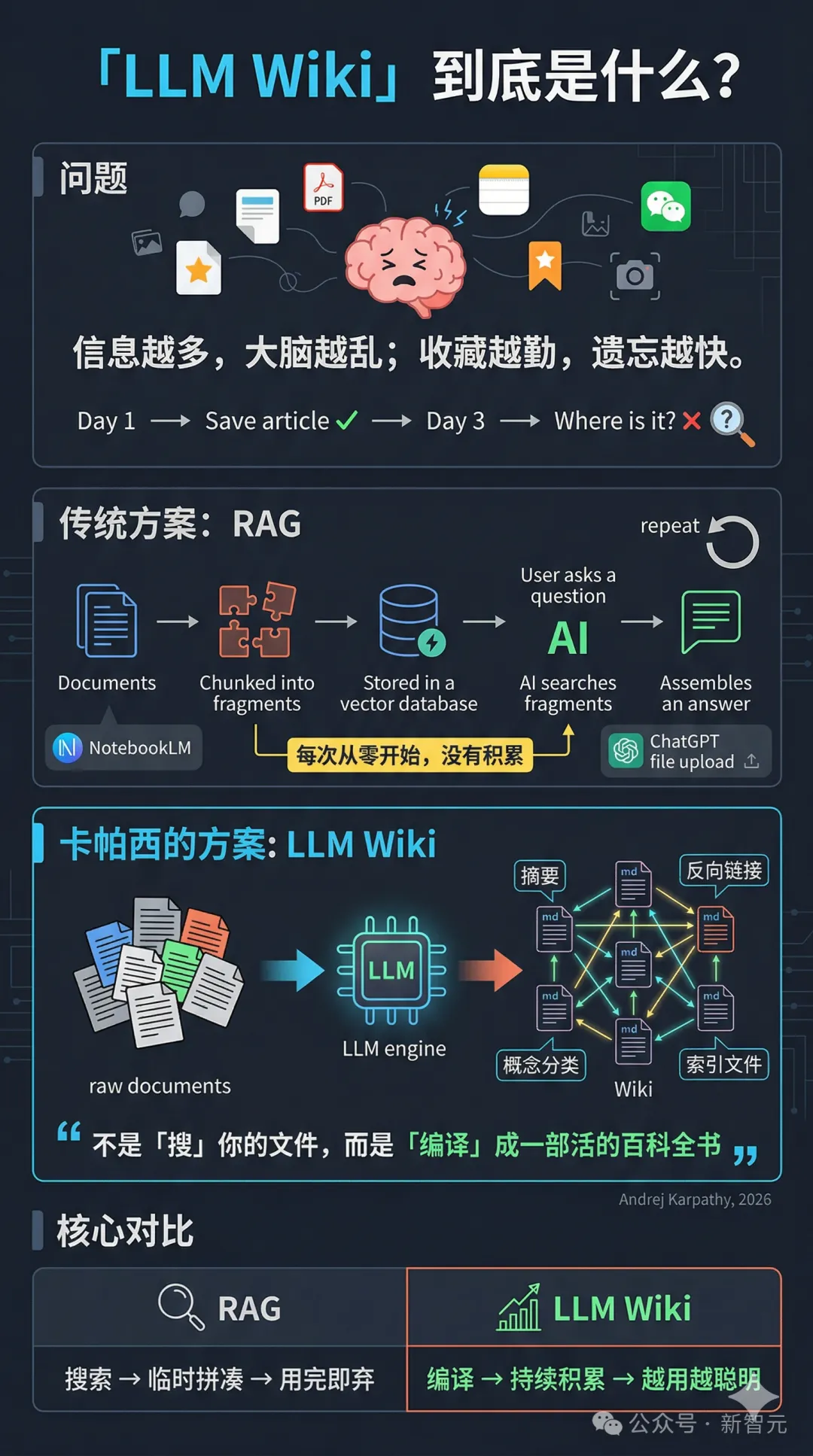

回忆一下你自己的日常:读了一篇好文章,收藏了;看了一篇论文,存了个PDF;开会记了一段笔记,扔进了Apple Notes;在微信群看到一个不错的观点,截了个图……

然后就没有然后了。

三天后你需要用到某条信息,翻遍所有app、所有文件夹,就是找不到。

要么是关键词想不起来,要么是存的地方太分散,要么干脆就是——记得看过,但忘了在哪看的。

信息越多,大脑越乱;收藏越勤,遗忘越快。

这就是传统知识管理的死穴——它需要你不断花时间手动整理,而人类天生懒得整理。

那AI能帮忙吗?当然能。

目前最主流的做法叫RAG(检索增强生成):把一堆文档切成碎片,存进向量数据库,用户问问题的时候,AI去「搜」相关片段,拼凑出答案。

NotebookLM、ChatGPT的文件上传功能,本质上都是这个路子。

RAG好不好用?能用,但不够好。

卡帕西一针见血地指出了RAG的根本问题:它每次都在从零开始「重新发现」知识。

你今天问一个需要综合五篇论文才能回答的问题,AI把碎片翻了一遍给你拼了个答案。明天你换个角度再问,它得重新翻一遍、重新拼一遍。

什么都没有积累下来,什么也没有建立起来。

用卡帕西的原话说:「没有积累。」(There's no accumulation.)

那他的方案是什么?

让大模型不是每次「搜」你的文件,而是把你的文件「编译」成一部活的百科全书。

这就是「LLM Wiki」的核心思想。

LLM Wiki的完整架构

卡帕西在GitHub Gist上公开了他的完整构想。

虽然他刻意写得比较「抽象」——因为他认为在AI Agent时代,分享的应该是想法而非具体代码,让每个人的Agent去根据想法定制实现——但整套系统的骨架其实非常清晰。

第一层:原始数据(Raw Sources)

就是你的素材库。论文、文章、代码、图片、数据集……统统扔进一个raw/文件夹。

不需要你整理,不需要你分类,扔进去就行。

这一层是「不可变」的——大模型只读取,绝不修改。这是你的信息源头、真相之本。

卡帕西推荐用Obsidian Web Clipper浏览器插件,看到好文章一键转成Markdown,再用快捷键把图片全部下载到本地,确保以后网站挂了图也不会丢。

第二层:Wiki(The Wiki)

这是整个系统的核心。

大模型读完raw/里的素材后,不是简单地「索引」它们,而是主动地「编译」出一整套结构化的Wiki。

什么叫「编译」?

就像编译器把你的源代码变成可执行程序一样,大模型把你的「原始资料」变成了一部可导航、可查询、互相引用的知识体系。

具体来说,大模型会做这些事:给每篇素材写摘要,抽取关键概念,为重要主题撰写独立文章,在不同页面之间建立反向链接,维护一个总索引文件(index.md),记录操作日志(log.md)。

你几乎不用手动编辑Wiki里的任何内容。

写文章的是大模型,打标签的是大模型,建链接的是大模型。

用卡帕西自己的话说——Obsidian是IDE,大模型是程序员,Wiki是代码库。

第三层:规则文件(The Schema)

这是一份「说明书」,告诉大模型这个Wiki怎么组织、有什么规矩、遇到不同情况该怎么操作。

比如在Claude Code里是CLAUDE.md,在OpenAI Codex里是AGENTS.md。

这份文件由你和大模型「共同进化」——你用着用着发现什么规则好用就加上去,什么不好用就改掉。