预测这件事,人类越犹豫,大模型越有优势量子位

大模型真能预测未来?

最近,UniPat AI构建了一套完整的预测智能基础设施——Echo,包含动态评测引擎、面向未来事件的训练范式和预测专用模型EchoZ-1.0。

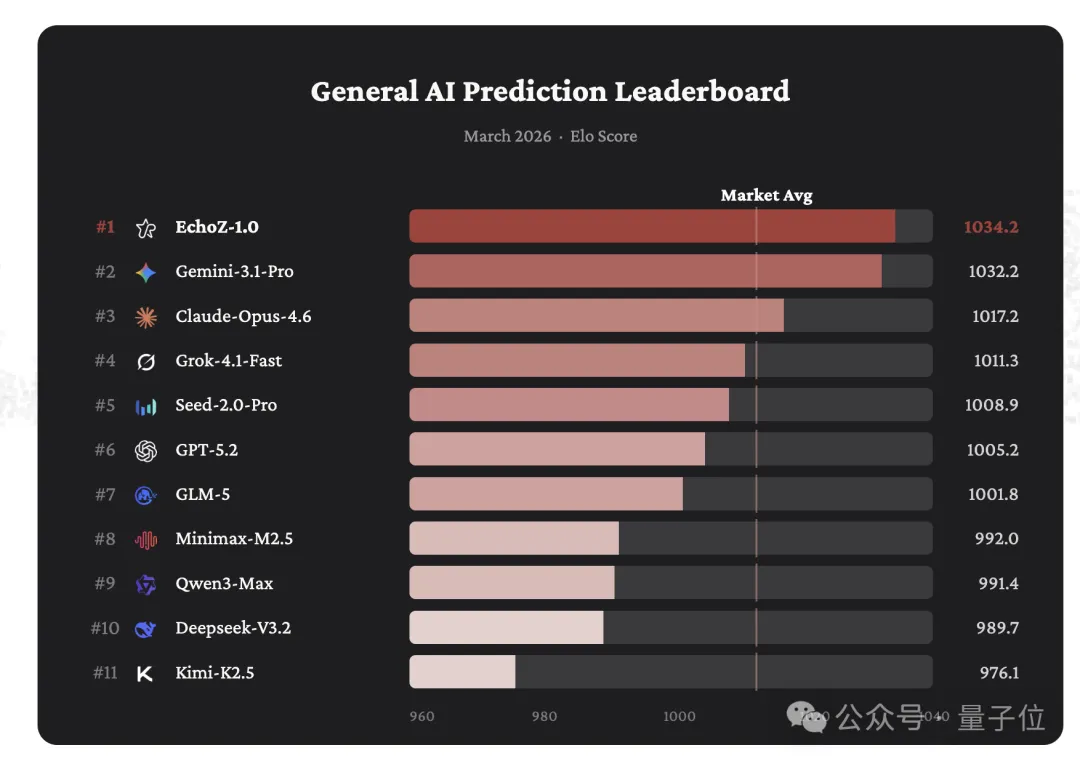

在其公开的General AI Prediction Leaderboard 上,EchoZ-1.0稳居第一,并在与Polymarket人类交易市场的直接对比中展现出显著优势。

一个悬而未决的验证问题

过去一年,预测能力越来越受到模型厂商的重视。

但预测领域有一个根本性的验证难题:你说你能预测未来,怎么证明?发布时的demo无法追溯,事后公布的案例存在选择性偏差,通用基准测试衡量的是语言理解和推理能力,跟真实预测是两码事。

UniPat AI近日发布的Echo系统,试图用一套完整的基础设施来回答这个问题。

Echo由三个紧密耦合的组件构成:

一个持续运转的动态评测引擎;

一套面向未来事件的后训练流程(Train-on-Future);

一个未来可能的AI原生预测API。

核心模型EchoZ-1.0是第一个在Train-on-Future范式下端到端训练的大语言模型。

在General AI Prediction Leaderboard上(2026年3月数据),EchoZ-1.0以Elo 1034.2排名第一,领先Google的 Gemini-3.1-Pro(1032.2)和Anthropic的Claude-Opus-4.6(1017.2)。排行榜涵盖12个模型,覆盖经济、体育、科技等7个领域,活跃题目超过1000道。

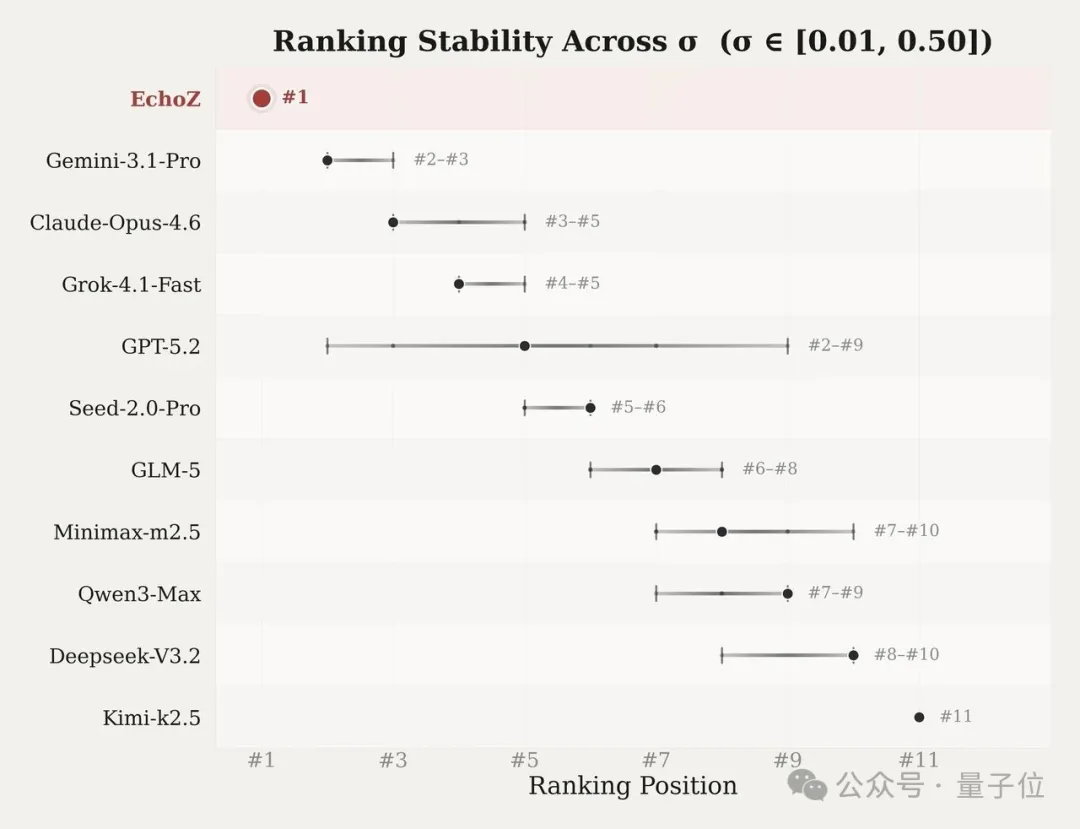

△EchoZ在排名鲁棒性测试中稳定第一

排名本身只是一个快照,排名的稳定性更值得关注。

博客中披露了一组σ参数敏感性测试:调整Elo框架中的σ参数(控制Brier Score差异向胜率的转化强度)从0.01到0.50共9个取值,重新计算全部模型排名。

EchoZ在全部9个分组均保持第一,是唯一排名未发生任何波动的模型。作为对比,GPT-5.2的排名在第2到第9之间波动过8个位次。

更有说服力的一个细节是,EchoZ的竞争对手不仅有顶级大模型,还有预测市场上真实投入资金的人类交易者的聚合判断,EchoZ的Elo分数显著高于这条基线。与此同时,Echo官网公开了所有预测问题、模型输出的概率分布和最终结算结果,任何人都可以回溯验证。

三个层面的可验证性叠加在一起(动态排行榜、实盘市场对照、全量数据公开),构成了Echo与此前各种“AI预测”最根本的区别。

那么,EchoZ对人类预测者的实际优势有多大?Unipat AI给出了一组分层对比:将EchoZ与人类市场在同一预测批次中的同一问题上进行比较,基于Brier Score计算胜率,按领域、预测期限和市场不确定性三个维度展开:

治理领域:EchoZ胜率63.2%

长期预测(7天以上):EchoZ胜率59.3%

市场不确定区间(人类信心55%-70%):EchoZ胜率57.9%

一个值得注意的规律是:

人类预测者越犹豫的场景(高不确定性、长时间跨度、复杂博弈)EchoZ的优势反而越明显。这暗示模型在信息整合和概率校准上的系统性优势,恰好在人类直觉最不可靠的区域得到了最大程度的释放。

一个持续生长的评测引擎

构建评测基准本身并不新鲜,但Echo的做法有一个关键差异:它构建的不是一个静态的题库,而是一个能够自动出题、自动结算、持续更新排名的动态系统。

为什么“动态”这件事很重要?

拿一道具体的预测题来说:“2026年3月31日收盘时,全球市值最大的公司是哪家?”如果模型A在3月1日给出了预测,模型B在3月28日给出了预测,两者的正确率能直接比较吗?

越接近结算时间,可用信息越多,预测难度越低。这就是现有预测基准的第一个结构性问题:时序不对称。

第二个问题是题源过于单一:现有基准的题目几乎全部来自预测市场,偏向容易结算的二元问题,大量来自专业领域和新兴话题的预测需求被遗漏了。

Echo Leaderboard的架构正是围绕这两个问题展开的。整套系统可以拆解为四个阶段的持续循环:

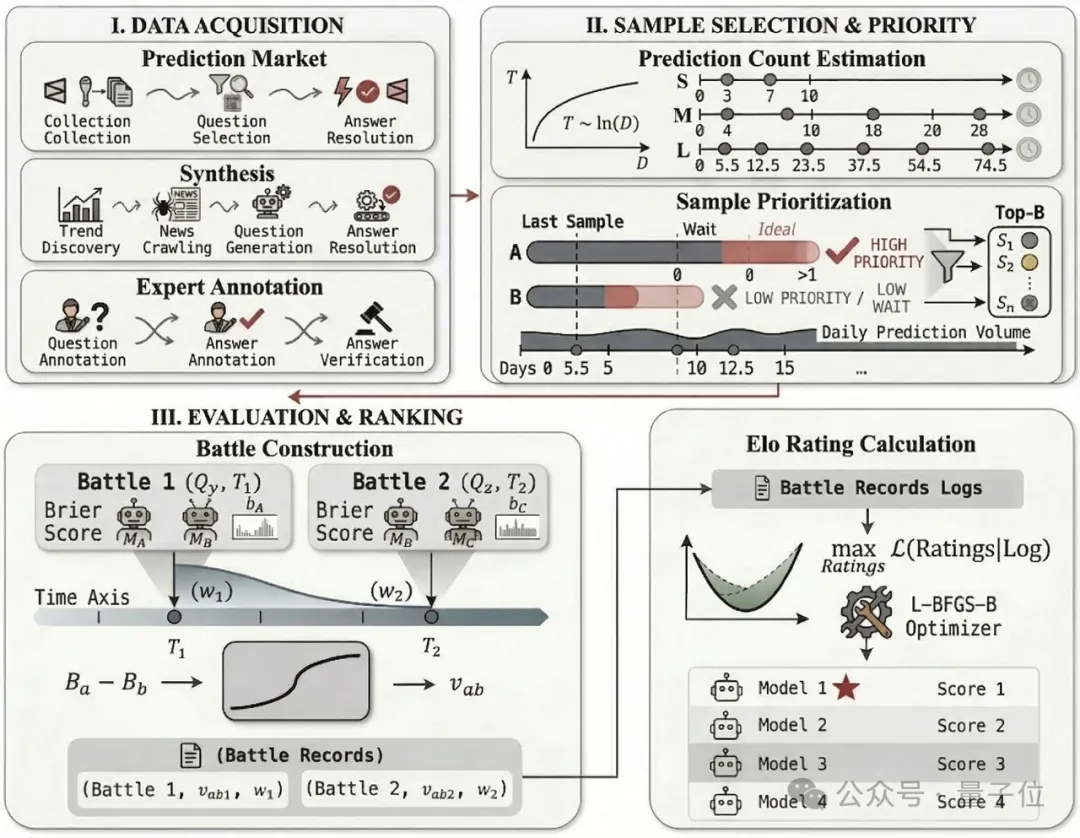

△Echo评测引擎构建流程

第一步,数据采集。

三条数据管道同时运行。

第一条对接Polymarket等预测市场,筛选有明确结算规则和高质量共识信号的合约。

第二条面向开放域,抓取Google Trends等实时趋势,自动生成关于尚未发生事件的预测问题,由agent持续搜索进展并自动结算。

第三条来自真实专业场景:科研、工程、医疗等领域的专家将自己工作流中有价值的预测题贡献到系统中,并在预定时间点给出权威判定。

从Polymarket上的大众共识到实验室里的专家判断,三条管道覆盖了一个相当完整的预测光谱。

第二步,预测点调度。

每道题不只做一次预测。系统使用对数调度算法,根据题目的结算周期长度分配多个prediction points(预测时间点),既保证了生命周期内的覆盖密度,又控制了计算开销。

第三步,对战构建。

这是解决时序不对称问题的关键环节。评测使用point-aligned Elo机制:严格只比较“同一道题、同一预测时间点”的结果。所有参赛模型在完全相同的信息上下文下对决,公平性由此建立。

第四步,Elo评分更新。

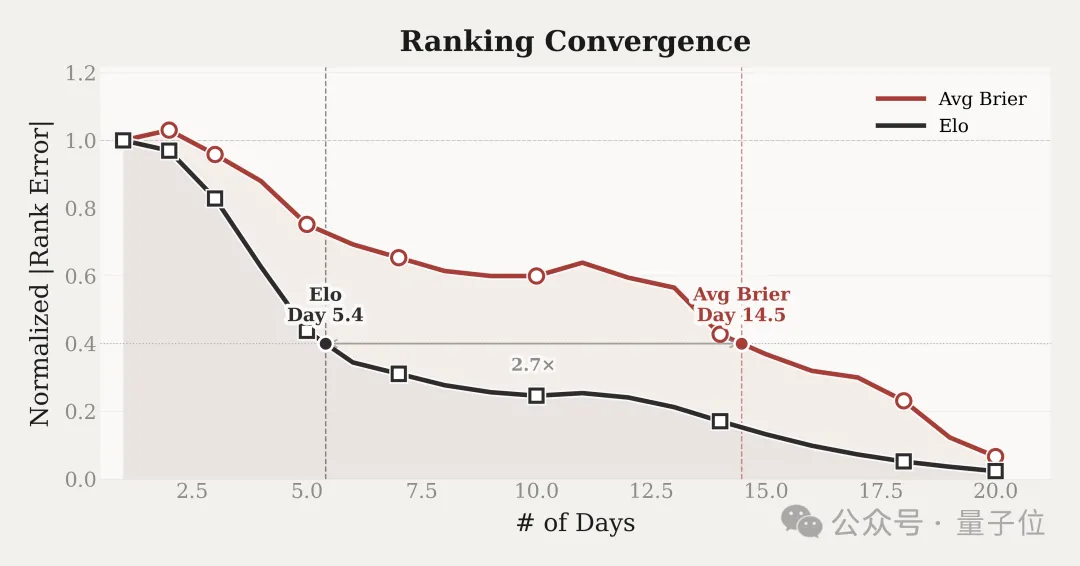

基于Bradley-Terry MLE算法计算全局排名。实验数据显示,这套框架对新加入模型的排名收敛速度是传统Avg Brier方法的2.7倍。

△模型排名收敛速度对比

这四步构成一个不断循环的闭环:新题目持续流入,新的预测点持续触发,对战持续发生,排行榜持续更新。用一句话概括:

Echo造了一把动态校准的尺子,而这把尺子本身也在不停生长。

Train-on-Future:当推理过程本身成为训练信号

评测引擎解决了“怎么量”的问题,接下来要回答的是“怎么训”。Echo的训练流程同样是一套结构化的系统,UniPat称之为Train-on-Future范式,由三个核心机制组成。

在展开之前,有必要先理解传统路径(Train-on-Past)为什么走不通。

用历史事件的已知结果来训练预测模型,面临两个很难绕过的困难。

第一个是工程悖论:互联网内容持续更新,用过去的事件做训练题时,模型在搜索网页的过程中几乎必然会撞上包含答案的信息,数据泄露在工程实现上极难杜绝。第二个是结果导向偏差:现实事件充满随机性,一个逻辑严密的分析可能因为黑天鹅事件而给出“错误”答案,一个粗糙的猜测可能碰巧命中。直接用最终结果做训练信号,模型很容易过拟合到噪声上。