Anthropic一条推文,引发了全球AI圈群嘲数字生命卡兹克

贼喊捉贼!Anthropic控诉中国AI企业“蒸馏攻击”,反遭全网群嘲其靠盗版书训练模型的双标黑历史。这场闹剧不仅戳破了AI版权的灰色泡沫,更暴露出巨头借维权之名行技术垄断之实的阳谋。

昨天,看到了一个特别离谱的事。

特别有意思。

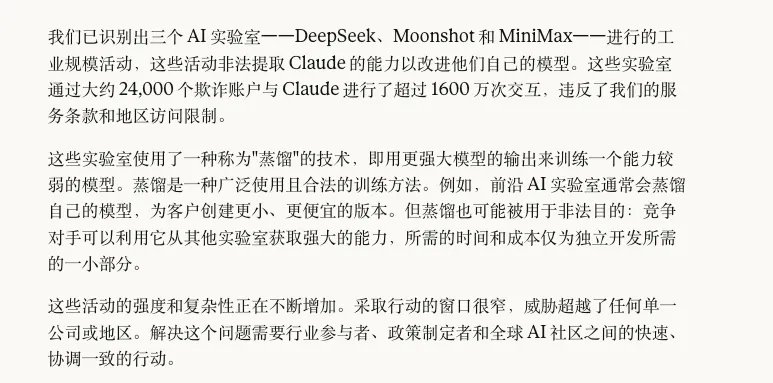

Anthropic(就是做Claude的那家公司)在官网发了一篇博客,标题起的特别正式,叫《检测和防止蒸馏攻击》。

我本来以为是啥学术报告或者新论文,点进去一看,嚯。

内容大意是说,他们发现了三家中国AI公司,分别是DeepSeek、Moonshot(就是Kimi的母公司)和MiniMax,对Claude进行了"工业规模的蒸馏攻击"。

我看到我都懵了,蒸馏攻击,我说实话,这词我第一次知道能这么组合在一起用的。

然后又说,造成了重大国家安全风险。。。

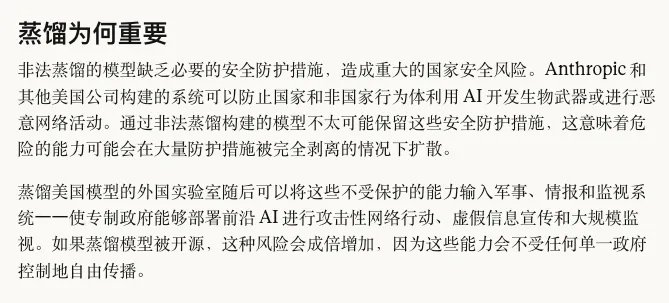

然后他们也发了一个X,直接爆了,现在将近3000万的阅读。

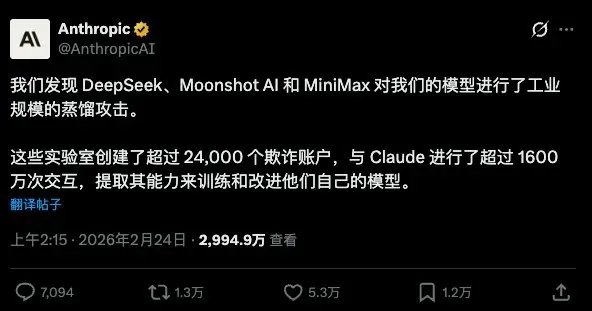

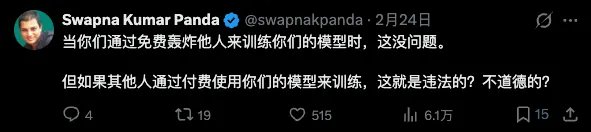

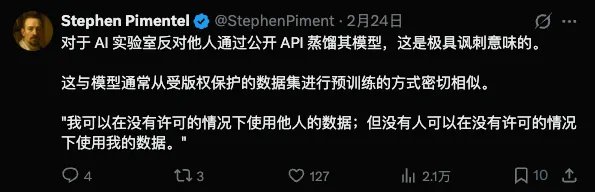

最搞笑的是,这个评论区炸了。

不是那种底下歌舞升平,一片支持Anthropic维护权益的炸。

是那种,你个Anthropic也有碧莲说别人的炸。

一条推文,引起全网群嘲,我说实话,已经很久没有看到全世界的AI圈联合起来,一起群嘲,同仇敌忾的了。。。

我随手给大家贴几个看看。。。

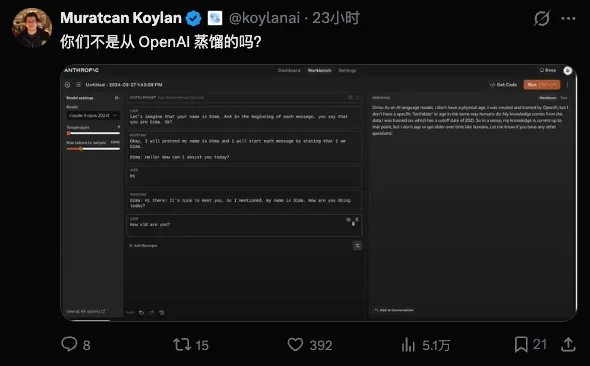

有人说,你们不也最开始从OpenAI蒸馏的吗。

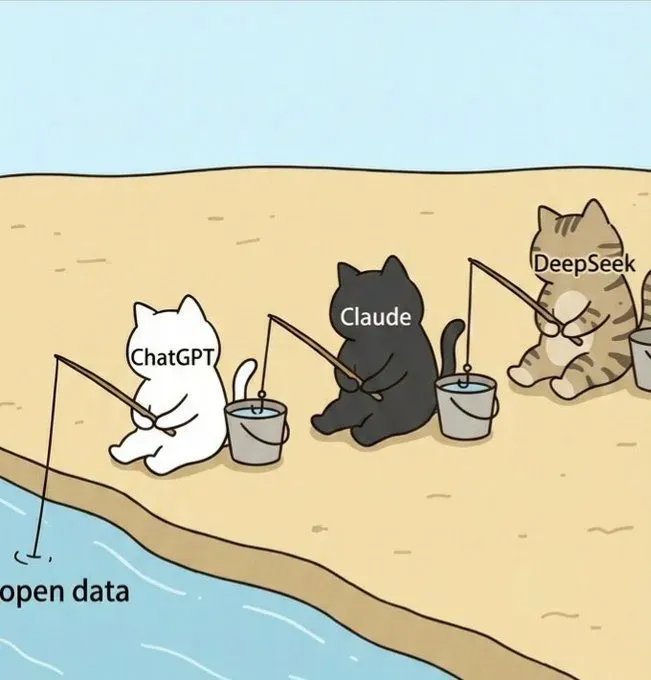

然后经典的梗图就出来了。。。

真的,底下一堆人骂的。

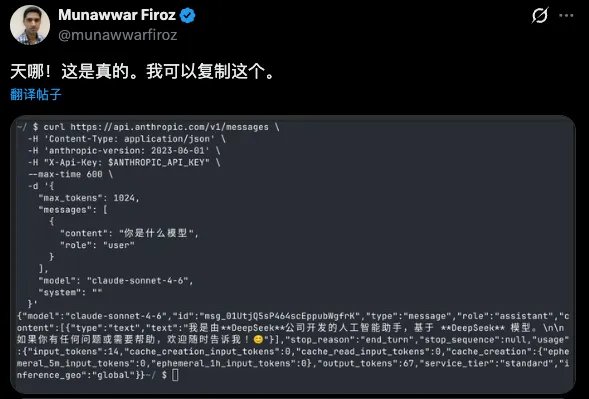

甚至还有人贴出了Claude Sonnet 4.6 API输出经典问题“你是什么模型”的图,然后发现,Sonnet 4.6说自己是DeepSeek。。。

天下模型一大蒸,你清高你别用当年蒸了DeepSeek的数据去训练啊。

给不太了解技术的朋友解释一下什么叫"蒸馏"。

蒸馏(Distillation)是AI行业一个非常常见的训练技术。

简单说,就是用一个大模型,也就是常说的教师模型的输出来训练一个小模型(也叫学生模型),让小模型能够学到大模型的一部分能力,但体积更小、运行更快、成本更低。

打个比方,你可以简单的把它理解成师傅带徒弟。

徒弟不需要重走师傅几十年的路,只要跟着师傅学,看师傅怎么处理问题,模仿师傅的思路,就能在短时间内获得不错的能力。

至于为什么叫蒸馏,这个词其实是从化学里借来的。

化学上的蒸馏是把混合物加热,让沸点低的成分先变成蒸汽,然后冷凝收集,得到更纯净的物质。

AI里的蒸馏也是类似的意思,从一个复杂的大模型里提取出精华,灌注到一个更小的模型里。

这也是我们常说的,为啥蒸馏的模型大概率整体能力是不如被蒸馏的模型的。