清华校友接力引爆架构革命:从ResNet到DDL水木TsinghuaCent

2026年元旦,AI架构领域迎来了“双响炮”。在DeepSeek抛出mHC这一重大改进之后(详见我们昨日的报道:DeepSeek开年新作炸场!前两位作者均为清华人),一项由普林斯顿(Princeton)与加州大学洛杉矶分校(UCLA)联合团队提出的、更具颠覆性的研究“深度增量学习”(DDL)同日亮相。斯坦福教授Christopher Manning对此评价道:“2026年,将成为改进残差连接之年。”值得关注的是,这项可能改写深度学习基础的研究,与之前的ResNet、DeepSeek的mHC一样,其核心推动力均来自清华校友,形成了一个从开创、发展到革新的清华力量传承谱系。

从“只加不减”到“学会忘记”:DDL的颠覆性思路

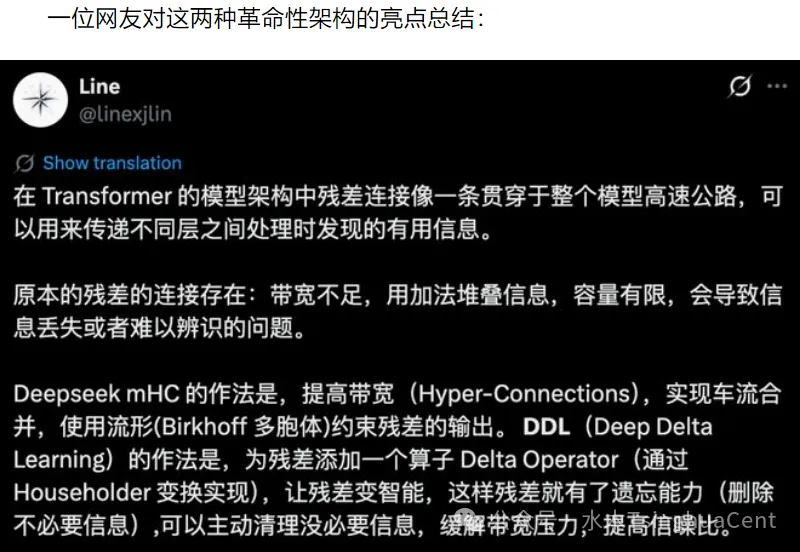

自2015年由清华大学校友何恺明提出的ResNet(残差网络)彻底解决了深度网络训练的梯度消失难题以来,其“残差连接”(即“加法捷径”)设计已成为过去十年几乎所有深度模型的默认骨架。ResNet的保守与稳定功不可没,但其“只加不减”的特性也被认为限制了网络的表达灵活性,让模型难以主动“忘记”无用信息或重构特征。

DDL的提出,正是为了打破这一固有范式。它不再将残差连接视为固定的“直通管道”,而是将其变成一个可学习、可调节的“智能阀门”。通过引入一个核心标量参数,DDL让每一层网络都能自主决定:是像ResNet一样保留全部过往信息,还是主动“清空”或“反转”某些特征方向。这相当于赋予了神经网络动态管理其内部“记忆状态”的能力,从只能做“加法”升级为可进行“加减乘除”的复杂运算,为建模更动态、更复杂的关系提供了底层可能。

架构革命“三部曲”:清华人的传承与突破

短短数日,从mHC到DDL,接连两项重磅研究直指深度学习最基础、最核心的残差连接模块,这绝非巧合。它标志着一个时代的转折:模型能力的提升,正从单纯堆叠参数规模,转向对基础架构进行更精妙的设计。

而在这条演进路径上,清华人的身影清晰而连贯:

开山之作(ResNet):2015年,何恺明(清华基科07本)作为第一作者提出ResNet,用“加法捷径”奠定了现代深度学习的基石。

优化革新(mHC):2026年元旦,解振达、韦毅轩(均为清华大学高等研究院博士)作为核心作者提出mHC,为“加宽”的信息通道引入“流形约束”这一交通规则,优化了稳定与效率。

范式突破(DDL):同一天,由清华校友团队提出的DDL,则挑战了ResNet最根本的“加法”逻辑,让连接本身变得可学习,实现了从“保守叠加”到“主动操控”的范式跃迁。

这三项研究,构成了一个从建立范式、优化范式到超越范式的完整逻辑链,展现了清华群体在AI基础研究领域从追随、并跑到引领的深刻影响力。

作者简介:星光熠熠的清华阵容

这项突破性研究的背后,是一支全部由清华校友主导的“全明星”团队:

张伊凡:普林斯顿大学博士生,2024年获清华大学交叉信息研究院硕士学位,现师从王梦迪教授(Princeton)、姚期智教授(清华)和顾全全教授(UCLA)。

刘益枫:加州大学洛杉矶分校博士生,2024年本科毕业于清华大学交叉信息学院,高中获全国中学生物理竞赛总决赛金牌,是清华“智班”2020年在重庆录取的唯一学生。

王梦迪:普林斯顿大学正教授,2007年获清华大学自动化、外语双学士学位,24岁即获麻省理工学院博士学位并任教于普林斯顿大学,一度引起轰动。

顾全全:加州大学洛杉矶分校副教授,2007年、2010年获清华大学自动化系学士、硕士学位,领导UCLA通用人工智能实验室。

从ResNet到mHC,再到DDL,清华人在AI基础架构的每一个关键历史节点都留下了决定性的印记。这场由校友接力引发的架构革命,不仅预示着大模型底层技术将迎来更剧烈、更本质的进化,也印证了中国顶尖学府在培养能够定义未来科技方向的领军人物方面,所具有的深厚底蕴与强大活力。