AI论文流水线真要来了张天祁

在传统的学术评价体系中,一篇能够发表在顶级期刊上的实证论文,代表着研究者长达数年的高强度投入。从打磨原始构思、清洗海量噪声数据,到构建复杂的计量模型,最后还有和审稿人之间漫长的反复拉扯。

图源:Pixabay

然而,2026年2月,苏黎世大学经济学教授 David Yanagizawa-Drott 发布了一个视频,在视频里他花了不到6个小时,一下午的时间就用AI写出了一篇“顶刊论文”。

Yanagizawa-Drott 曾长期担任《经济学季刊》(QJE)的副主编,目前仍是《政治经济学杂志》(JPE)的编委。这次他利用 Claude Code,在不到 6 小时的交互过程中,生成了一篇结构完整、长达 53 页的宏观经济学论文。

在他公开的记录中,AI 的介入已不再局限于文字润色,而是几乎完全自动化。从最初的构思,到自主编写代码进行模拟运算,再到最终完成 LaTeX 排版,整个流程都由AI完成。而且这完全不是编造或者模拟,而是利用真实数据,具体来说是2000 年 1 月至 2024 年 6 月美国50个州的面板数据做出的研究。

这篇论文只是APE Project(自主政策评估项目)的成果展示之一[1]。由Yanagizawa-Drott参与发起的这一项目,已经自动生产了数百篇论文。该项目的野心是建立一套全自动的研究流水线,让 AI 独立完成从选题、数据抓取到因果推断的全过程。为了挑战传统范式,APE 项目甚至设计了一场竞赛,将 AI 的初稿与《美国经济评论》(AER)等顶刊即将发表的人类作品进行自动化评分对比。

这次颇具冲击力的展示,很快在经济学界激起了好奇与跟进。《知识分子》为此联系了三位学者,中国农业大学经济管理学院教授朱晨、中央财经大学财经研究院数字财经研究中心执行主任陈波,以及一位长期关注中国宏观经济政策和微观基础领域的研究者。他们都在最近进行了使用AI智能体生成论文,并分享了各自的操作过程与经验。

为了探寻这套自动化逻辑的边界,三位学者分别搭建了各自的科研智能体系统。尽管都完成了从数据处理到论文初稿生成的流程,但在如何引导 AI,以及 AI 将如何影响科研的问题上,他们的看法并不一致。

01、AI生成论文,到底什么水平?

Yanagizawa-Drott 用 AI 生成的论文往往非常工整,初看之下,很难将其与人类资深学者的作品一眼区分开来。也正是这种“看起来像那么回事”的特征,在传播过程中不断被放大。在自媒体和社交平台的多次传播中,APE 项目已经演变成了“AI几小时就能生成顶刊论文”的学术神话。

这种形似是否等同于真实的学术高度?AI完成的论文到底是什么水平?

朱晨认为,Yanagizawa-Drott的APE项目产出的论文,在论文结构和写作规范上已经相当成熟,“从形式上来说是过关的”,能够生成一篇符合经济学论文基本要求的文本。

但她通过对自身实践的总结指出,如果直接将其等同于顶刊水平,依然过于夸张。更接近现实的定位,是达到研究生论文的标准,甚至一些影响因子在3到4分左右的开放获取期刊,也可以尝试去投稿。

关注中国宏观经济政策和微观基础领域的那位研究者,评价标准是最严格的,并且对“几小时生成顶刊论文”的说法表示非常反感。

这位学者也关注了APE项目,甚至浏览了几乎全部200篇论文的内容。但在他看来,在已经公开的两百多篇论文中,只有极少数选题具备继续推进的价值。这些流水线作品的含金量极低,在那 200 多篇论文里,只有一篇关于劳动经济学的选题思路非常好,其余大多“只是刚入门的研究生水平”。

甚至,他认为这些 AI 产出的逻辑和深度,还不如他手下那些相对成熟的高年级本科生或研究生。若以审稿人的标准衡量,这些文章很难通过基本筛选,“如果送到我手里,我会直接拒掉”。病灶不在写作,而在分析实在太过于浅显,方法部分更是残缺不全。

一篇成熟的经济学顶刊实证论文,对方法的要求一定是非常严格的。例如使用双重差分(DID)方法的论文,不仅要完成基准回归,还需要进行平行趋势检验(parallel trends)、平行趋势的敏感性检验(sensitivity analysis),以及异质性处理效应(heterogeneous treatment effects)的分析。

这些步骤,尤其是后两者,已经成为近年来使用DID方法研究中的常规要求。但在目前公开的AI生成论文中,这些关键步骤往往缺失,或者只是形式性地出现,无法支撑有效的因果推断。

他进一步指出,这未必是模型能力本身的上限,更可能是工作流设计的问题。研究者在调用AI时,并没有把这些方法论上的要求嵌入进去。为此,他自己专门发布了一套包含11个环节的DID完整工作流,把这些近年来形成的规范逐一拆解,并转化为可以直接执行的指令结构。

按照这套逻辑运行,“做到博士生论文初稿的水平是完全有可能的”。但即便如此,这位学者依然坚信,从初稿到成品之间,仍需人类来补足分析深度。在社会科学领域,他短期内看不到“人什么都不用干,就在那里等结果”的全自动化可能。

陈波对AI能力的评价则是最为乐观的,他的思路也更“工业化”,他更关注整体的投入产出效率。根据他的经验,如果不刻意追求深度和考虑细节,AI 最快可以在 20 分钟内产出一篇 70 分左右的初稿。

“如果中间觉得不满意让它返工的话,这个时间肯定就会更长,但通常一到两个小时会基本上出一个相对比较强的一个版本。”在陈波看来,AI智能体单纯基于数据分析来写论文,完成时间目前已经可以稳定控制在 1 小时以内。虽然判断选题本身是否具备学术价值,或者研究视角是否符合当前学术界的共识,这些还需要由研究者来判断。

陈波认为修改过的论文大致能达到85分的水平。这个分数意味着,这些论文大体可以达到中等期刊及以上的的水平,但距离顶级期刊仍存在一定差距。具体文章的质量,在一定程度上取决于选题本身。由于生成过程带有一定随机性,如果问题设定得当,结果可能会更接近高水平研究。

如果只是作为一篇规范的期刊论文,他认为这类论文达到核心期刊标准问题不大,甚至在某些方面已经超过不少既有工作。

02、AI现在能做到哪一步了?

朱晨开始使用AI智能体写论文是在今年春节前后。Yanagizawa-Drott 发布视频后,她也搭建了自己的智能体,这种程度的自动化,是她之前完全没有想过的。一直将 AI 局限于润色语言、排查代码问题等辅助工作的她,第一次意识到AI已经进化成了真正有可能独立完成科研的工作伙伴。

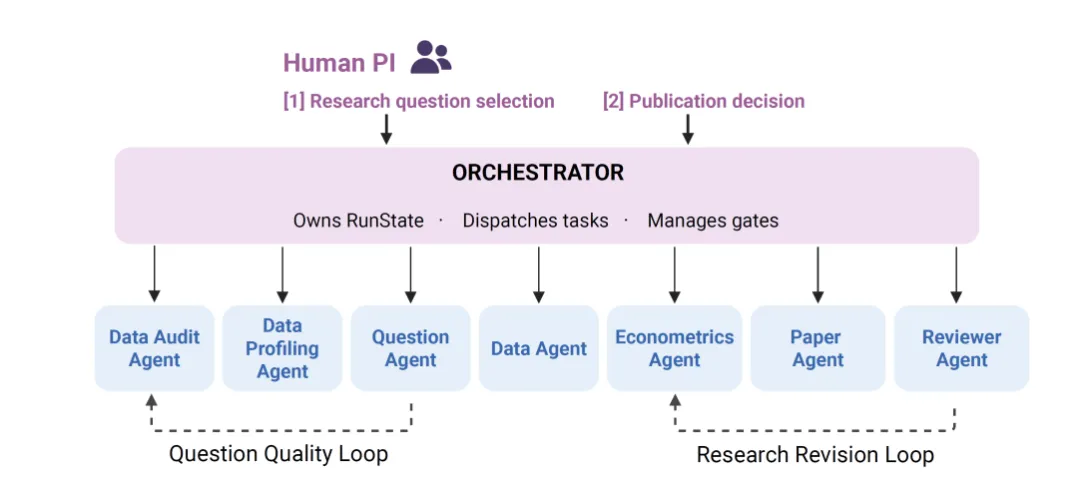

朱晨将原本由研究者逐步完成的经济学实证研究流程拆解为一系列标准化步骤,并交由不同的 AI 智能体分别执行,研究者只需要在少数环节干预,这套系统被她称为 HLER(Human-in-the-Loop Economic Research)[2]。

系统将研究拆解为七个环节,由专门的智能代理执行。它们负责审计和分析数据、生成候选研究问题、收集与处理数据、进行计量分析、撰写初稿,并由 AI 审稿者进行初步评价。人类研究者只需在选择研究问题和批准最终稿件时介入,其余环节均可由 AI 完成。

对 AI 生成内容的批评,往往集中在其不够准确。它提出的问题常常似是而非,甚至与实际数据并不匹配。很多学者也坚持认为科研问题的提出仍要依赖学科经验。

但在经济学等高度依赖数据库的研究中,如果AI智能体能够学会合理调用数据库数据,把研究建立在具体数据之上,至少可以在很大程度上保证其可行性。

在HLER系统里,智能体会先扫描本地数据库,了解可用变量、时间跨度和样本量,然后生成 4 个左右初步研究方案。每个方案都必须满足三个条件:变量在数据库存在、研究设计与数据结构匹配、可用计量方法可解决。

每个生成的问题由两名研究人员独立评估,若意见不一致,则通过讨论达成共识。结果发现,在调用数据库的情况下,AI生成问题其实是很有保障的。在十四次运行中,这一数据集感知机制共生成 79 个候选问题,其中87%都符合所有条件。

不过,在研究问题创新性这个问题上,朱晨还是认为只有拥有经验的学者才能把控。所以相比APE的完全自动生成选题,她还是坚持人机结合。AI智能体可以针对单个数据集生成数十个技术上可行的研究问题,但仅靠这些可行性标准是不够的。如果研究者从中只挑选统计显著的结果作为研究结论,就等于把 AI 的“可行问题库”变成了学术不端的工具,这种风险正是人机结合所要避免的。

甚至,AI 的能力并不止于提出问题。

在陈波的尝试中,他观察到,AI 不仅能够根据数据内容生成选题,还能在完成建模分析后,根据结果反过来调整研究方向,甚至进一步优化所使用的数据来源,主动扩展和补充新的公开数据。

这也意味着研究流程本身正在发生变化。换句话说,选题不再是研究的起点,而只是 AI 智能体研究循环中的一个环节。不再是先有问题、再去根据数据分析,而是从数据出发生成问题,再由结果反过来筛选和调整问题。

如果说选题还离不开学者的把关,那么在具体方法执行层面,自动化已经更为彻底。

朱晨介绍,过去如果使用相对复杂的计量方法,比如双重差分(DID),必须先把方法写成函数再让系统调用。但自从有了Claude Code之后,她只需要简单用文字说明,例如“现在的OLS方法太简单识别不了因果,需要引入DID的方法”,智能体就能自主去调用相关的内容,并生成相应代码,无需她手动操作。

当程序报错,AI还会自动去读取日志以修复代码,速度甚至比人工调试还要快。特别是在处理高维面板数据时,她认为AI“比很多刚上手的博士生都要严谨,因为它不会马虎,会一遍一遍地去校验结果”。

在这种情况下,研究者的角色也在悄然变化。

朱晨感慨,现在她和AI的相处并不像使用一种工具,而是作为AI的“训练家”。她只要把需求和方向说清楚,其余的执行和学习,系统都能自动在后台完成。

如果说选题与代码编写还停留在执行层面,那么进入审稿阶段,AI已经可以在研究思路上给出很多建议了。甚至能够根据论文的逻辑漏洞,自主在方法库中检索并升级实证方法。

以“高等教育是否缩小了中国农村女性的职业性别差距”这个问题为例,智能体首先调取了中国健康与营养调查(CHNS)1989年至2011年的五万余条数据,在确认命题后,完成了一轮标准的固定效应回归,并生成了一篇约5000字的初稿。

接下来,初稿会进入审稿阶段。审稿智能体首先根据新颖性、识别可信度、数据质量、清晰度和政策相关性等五个维度的标准对论文进行评价,然后在1到10分中给出一个分数,如果不够6分的及格线会反复迭代,通常情况下会生成两到三稿。

更关键的是,这一过程不仅是打分,还伴随着具体的学术反馈。审稿智能体会按照真实投稿的标准提出意见,指出论证中和方法的问题,要求补充稳健性检验,或建议进行分组一致性分析等。

在那篇关于高等教育与农村女性的论文中,审稿智能体就提出可能存在反向因果的问题,即职业选择的前景本身可能会影响女性接受高等教育的机会。审稿意见建议引入事件研究(event-study)设计、开展敏感性分析(sensitivity analysis),并对固定效应模型的识别假设作出更明确的说明。

这些意见会被直接转化为新的分析任务。执行智能体据此在方法库中检索更严密的方案,对实证策略进行补充和修正。经过多轮迭代,论文整体评分从 4.6 提升至 6.5,其中识别可信度由 3.2 提高至 5.8,表达清晰度从 4.1 提升至 6.9,提升最为明显。

然而,随着自动化程度不断提高,一个无法回避的问题也随之浮现:这些由 AI 生成的研究,究竟在多大程度上是可信的?

“幻觉”始终是对AI科研最核心的质疑之一。对于科研写作而言,这不仅意味着个别事实错误,更可能体现在引文不存在、数据对应错误,甚至在看似严密的论证中掺入并不存在的依据。一旦这些问题进入论文,就很难通过表面阅读被识别出来。

也正因此,朱晨花了很多时间去加强模型系统验证的力度。她的做法是在系统生成引文时,实时调用 Google Scholar 和 Crossref 等公开数据库的 API,并自动触发一个验证流程:只有在数据库中找到对应条目,且作者、年份、期刊信息完全匹配,并附有唯一 DOI 的文献,才会被保留,验证不通过的引用则会被直接剔除。

与此同时,结果本身也必须经过复现检验。在每次研究完成后,系统都会生成完整的 R 代码,研究者可以基于原始数据和抓取数据重新运行分析流程,确认回归结果与报告一致。朱晨强调,这一步复现是整个流程中不可或缺的环节,也是确保研究可靠、避免 AI 幻觉的关键。

03、学术界的危机

过去几年,尽管有着AlphaFold这样的AI科研工具诞生,但是研究者们好像没有真正担心AI会冲击科研本身,它更多被视作一项方便的、能够提升效率的工具。