华为芯片飙至820亿,英伟达慌了钛媒体

AI芯片格局正在发生变化。

2026年一季度,中国AI芯片战场,华为反守为攻。2026 年5月1日《金融时报》报道,华为预计 2026 年AI芯片收入将至少增长60%,从 2025年的75亿美元(512.1 亿元人民币)暴涨至120亿美元(819.4 亿元人民币)。

推动这轮增长的核心是 AI 芯片需求上升,以及华为新一代 Ascend 950PR 订单增加。

华为昇腾950PR芯片横空出世,冲开了美国对华AI芯片的封锁线。华为2026年AI芯片收入将达120亿美元,同比猛增60%,对比之下,美国H200在华销量依然为0,这是美国封锁倒逼中国自主突破的必然结果。

美芯禁令助攻华为

过去两年,中国企业是真的憋屈。高端芯片买不到,只能将就美国“阉割版”的H20,但谁也没想到?美国政客和英伟达,亲手帮中国踢出了“临门一脚”。

后来特朗普政府批准更高端H200对华销售,附加了苛刻条件:第一是数量封顶,中国客户能买到的H200总量,连美国本土客户采购量的一半都不到,后来特朗普政府又爆出了要定7.5万颗采购上限的消息。

此外,所有运往中国的H200芯片,都得先送到美方指定的第三方实验室“体检”,这样确保芯片没有任何可以被中方自行升级、改造的空间,甚至还要接受美方的各种核查,相当于买一颗芯片,就要被美方全程盯着。

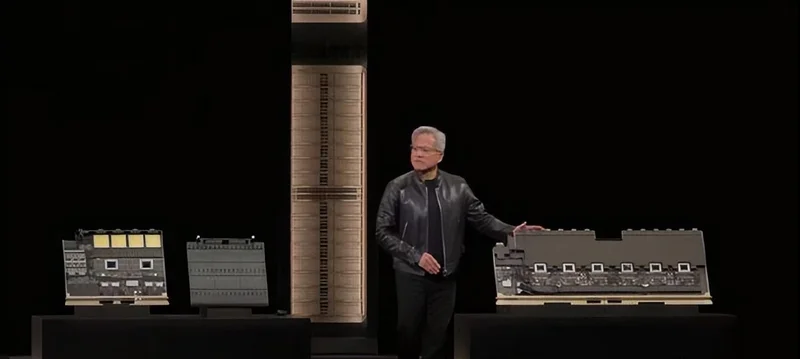

结果呢?中国企业直接集体拒单。首席执行官黄仁勋在过去的一年里频繁走访上海、深圳,甚至在财报会上直言不讳地提醒,中国市场曾贡献了英伟达四分之一的营收,失去这个市场是难以承受的。

如今,对英伟达而言,更难受的事情是,中国本土AI企业DeepSeek正式发布新一代大模型V4,宣布将全面开源,向全球开发者开放使用。

华为官方同步官宣,其最新研发的AI芯片,已成功实现与DeepSeek V4模型的全链路适配,可稳定流畅运行该模型。

大模型有着上万亿个参数,每个参数本质上是一串数字,这些数字全都要存放在芯片的储存空间里;目前英伟达的整个生态体系,主流用 FP8,靠 8 位比特记录一个数字,FP4 只需要 4 位比特就行。

DeepSeek V4 训练时,用了一种叫 mxFP4 的精度方案。FP4 的优势,是更少的存储空间,更低的计算成本,跑差不多效果的模型。如果这套方法论能在华为芯片平台上进一步打磨成熟,美国通过硬件封锁建立的护城河,就会比想象中浅得多。

此外是,随着DeepSeek那套极致压缩算力需求的技术,与华为不断成熟的本土芯片生态深度绑定,中国的AI产业链就有可能在不依赖任何美国硬件的前提下,实现自给自足的高速发展。

英伟达的护城河,从来不是芯片本身。是CUDA——CUDA作为“事实标准”的软件生态位,过去近二十年里,几乎所有主流AI框架、算子库、开源模型的首发优化,都把CUDA作为默认起点。英伟达的CUDA就跟当年的Windows一样,软件、工具、教程、开发者全围着它转。

但华为走出了另一条路:昇腾芯片配套CANN生态系统,全面开源、开放。

DeepSeek V4 在训练阶段选了 FP4,昇腾 950 恰好是国内唯一支持 FP4 的芯片,这根本不是模型做完再临时去兼容国产芯片,而是在模型训练起步阶段,选择精度规格的时候,已经专门为这颗芯片量身铺路了。

据彭博社此前的独家报道,为了实现与国产算力的完美适配,DeepSeek特意推迟了V4模型的发布时间,花费数月时间重新编写底层代码,成功实现从英伟达CUDA框架,向华为自研CANN框架的全面切换,彻底摆脱了对英伟达软件生态的依赖。

就像你设计一把钥匙时,已经知道它要开的那把锁长什么样。

黄仁勋在一档节目中直言:“如果DeepSeek率先在华为平台上发布,对我们国家来说将是可怕的结果。全球AI模型都将运行在非美国硬件上。”

可以说,黄仁勋担心的事情已经发生了。

过去几年,中国 AI 产业的底色一直是「用英伟达的芯片,追美国的模型」;V4 释放的信号已经是开始用自己的芯片跑自己的模型了,芯片和模型从一开始就在一起长。