伯克利、哈佛、宾大、斯坦福重磅综述学习力学清熙

论文开篇提出,一个能刻画神经网络训练过程、隐藏表征、最终权重和性能的科学理论正在形成。

作者整合了五个主要研究方向作为证据:

1)可求解的理想化模型;2)提供洞见的极限分析;3)描述宏观量的简单定律;4)对超参数的理论解耦;5)跨系统的普遍行为。

这些工作的共同点是,关注训练动态过程、描述粗粒化统计量、强调可证伪的定量预测。

论文将这一新兴理论命名为 “学习力学”,并主张它应该是一门数学化、基于第一性原理、能精确预测与实证的学科,最终像物理学那样对整个机器学习领域产生广泛影响。

深度学习是当前最强大也最令人费解的黑箱方法,理论落后于实践,模型仍靠大量试错训练。论文主张:一个深度学习的科学理论,正以学习力学的形态浮现。

1.1 什么是学习力学?

1.2 学习力学为什么重要

深度学习的运动方程是显式且高度可测量的,核心挑战是高维非线性带来的复杂性。

2.1 存在可解析的理想化模型

通过研究简化但不失代表性的模型来构建直觉,是物理学的成功范式,深度学习亦然。

2.2 富有洞察的极限揭示基本行为

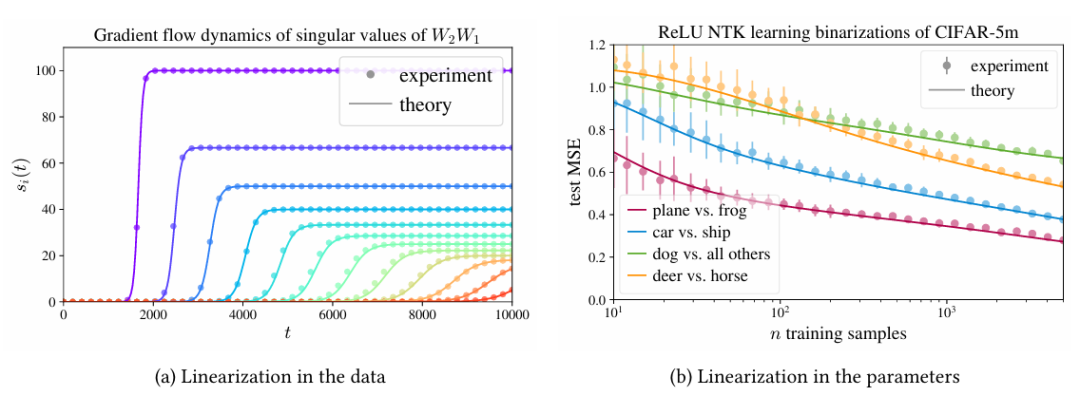

复杂系统在无限大的极限下常会简化,就像理想气体定律在粒子数无限的热力学极限下导出,却能够描述现实气体。这一思路是深度学习理论的核心工具。

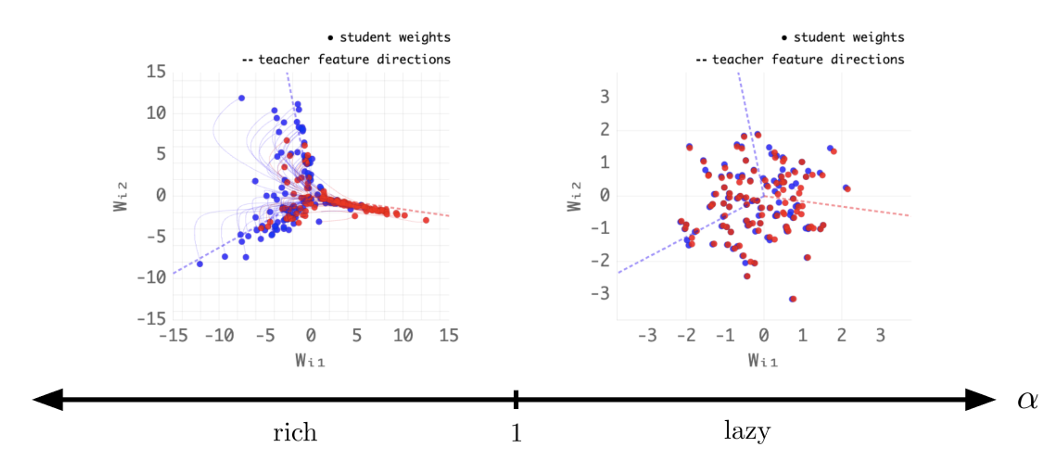

无限宽度与惰性核 / 富特征二分:

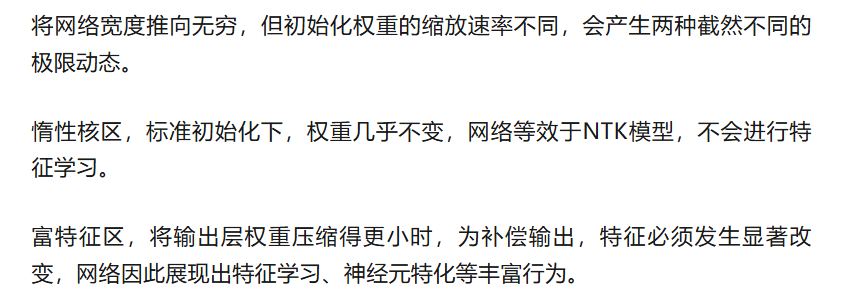

无限深度、上下文长度等极限同样存在。不同变量的联合缩放极限尤其重要,如将参数和数据量同时推向无穷,是理论解释计算最优缩放定律的关键。

离散化假说:

一个普遍信念是,真实网络可被理解为无限大理想模型的有噪、有限离散化版本。这暗示着,有限宽度、深度等效应通常只是对理想性能的扰动和成本妥协,而不是带来根本性的优势。

2.3 简单的经验定律捕捉有意义的宏观统计量

科学史上许多重要定律(例如牛顿三定律、欧姆定律)都是先作为经验规律被发现。深度学习同样具备这一条件。

粗粒化与潜表征权重:

包括神经坍缩,网络末层特征会形成规则的几何结构;神经特征假设,首层权重的结构与输入梯度的外积相关;以及守恒定律,源自参数化中的对称性。

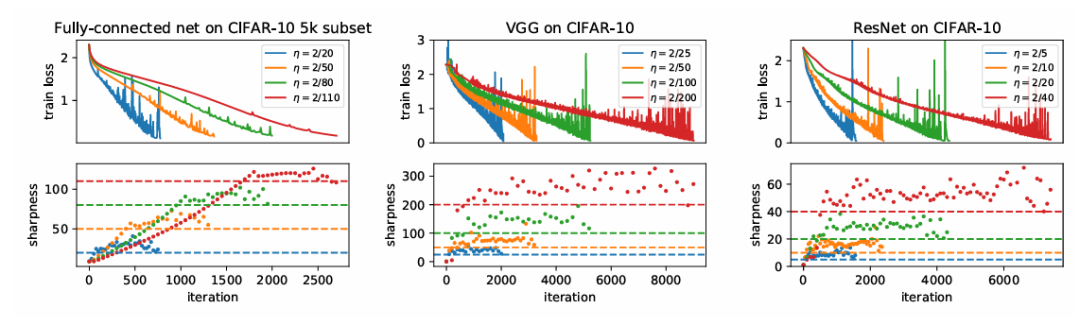

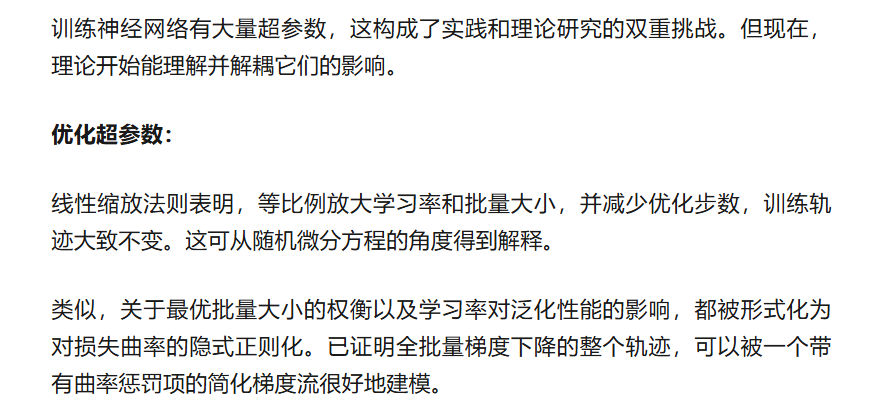

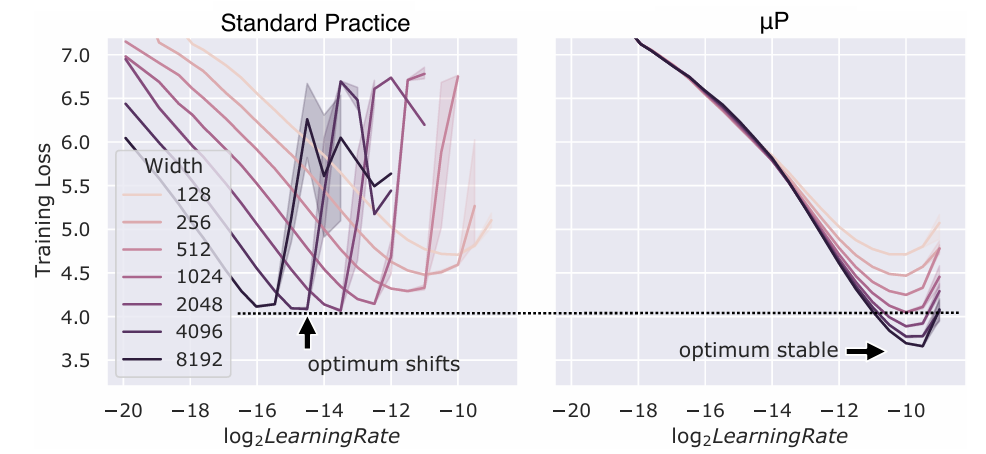

2.4 超参数可以被解耦和理解