Deepseek V4第一波测评来了华尔街日报

Arena.ai显示V4 Pro代码能力冲进开源前三;Vals AI评测其代码性能较上代跃升10倍,击败Gemini 3.1 Pro。价格极具杀伤力,Flash版输出仅0.28美元/百万token,约为Claude Opus的1%。网友评论称:“GPT-5.5,对不起,DeepSeek V4才是新的震撼时刻。”

DeepSeek V4 预览版开源上线后,第一波来自第三方榜单的测评结果已经出炉。多家测评显示,DeepSeek V4性能尤其在代码任务上冲进开源第一梯队,同时以“百万级上下文+低价”把开发者侧的使用门槛进一步压低。

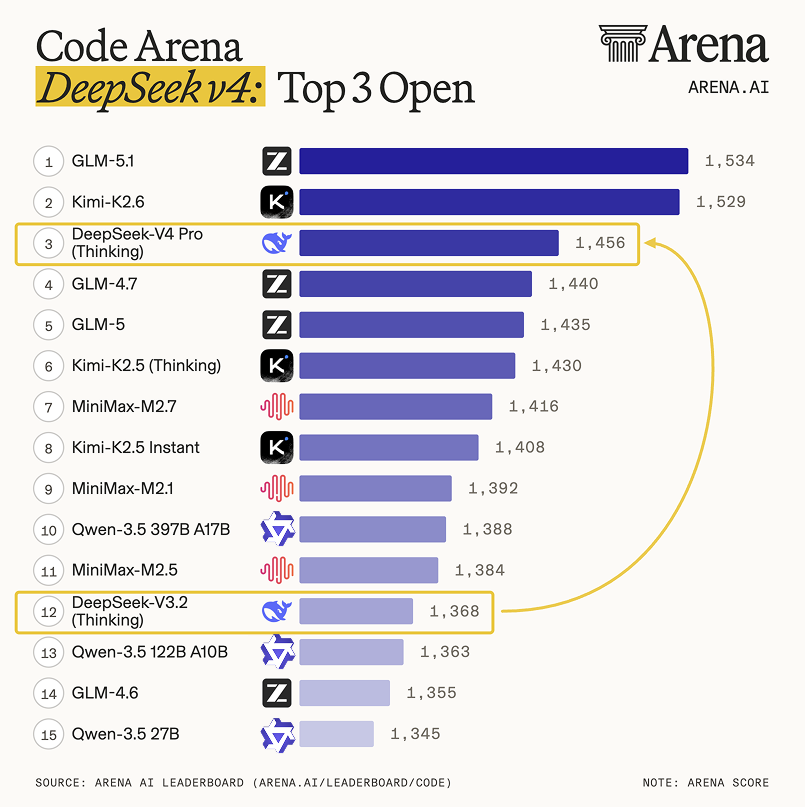

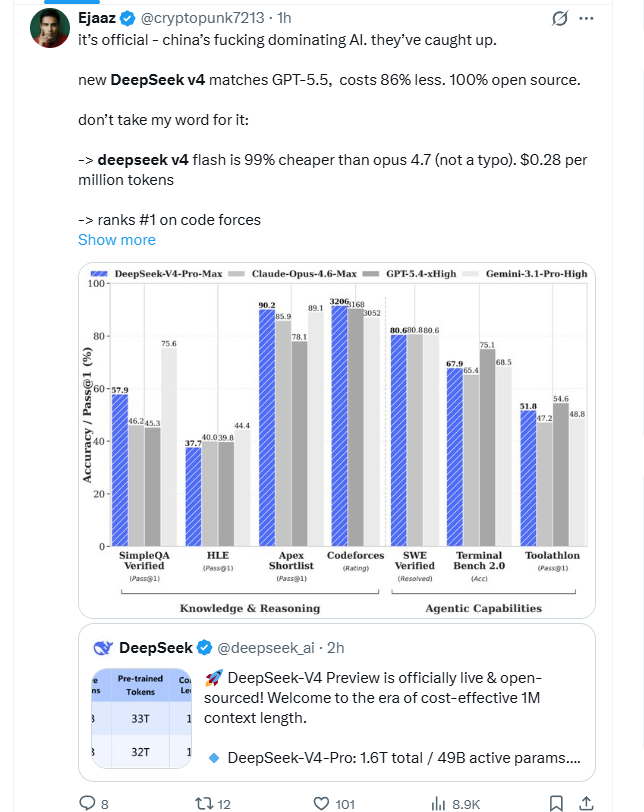

从第三方评测来看,评测平台 Arena.ai 在 X 上将V4 Pro(思考模式)定性为"相较DeepSeek V3.2的重大飞跃",在其代码竞技场中列开源模型第3位、综合第14位;另一家测评方 Vals AI 则称,V4在其Vibe Code Benchmark中以"压倒性优势"拿下开源权重模型榜首,击败Gemini 3.1 Pro等闭源模型,较上代V3.2实现约10倍性能跃升。

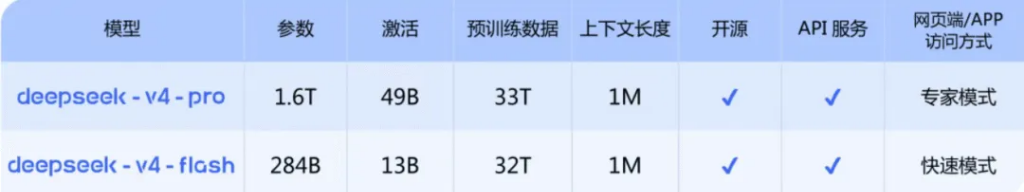

定价层面,V4-Flash输出价格为每百万token 0.28美元,较Claude Opus 4.7低逾99%;V4-Pro输出价格为3.48美元,是同级别前沿模型中定价最低的选项之一。对比表格显示,Flash 处于小模型区间最低档,Pro 也处于“大模型前沿”区间低位。

围绕实际体验的讨论开始分化。多位网友在 X 上称其性价比“打穿”。而DeepSeek在自述材料中则保持克制,称在知识与推理上接近闭源系统但仍有约3到6个月差距,同时提示“受限于高端算力”,Pro 服务吞吐有限,后续价格存在下调预期。

第三方测评:代码能力独占鳌头,综合排名紧追顶级

就在OpenAI GPT-5.5发布不久后,DeepSeek-V4预览版正式上线并同步开源,涵盖参数总量1.6万亿(激活参数49B)的V4-Pro,以及参数总量2840亿(激活参数13B)的V4-Flash,两款模型均支持100万token超长上下文窗口,采用MIT开源协议。

模型评测平台Arena.ai在V4发布当日宣布,DeepSeek V4 Pro(思考模式)在其代码竞技场中排名开源模型第3位,综合排名第14位,并将此次发布定性为"相较DeepSeek V3.2的重大飞跃"。Arena.ai同时测试了V4 Flash,两款模型均支持100万token上下文。

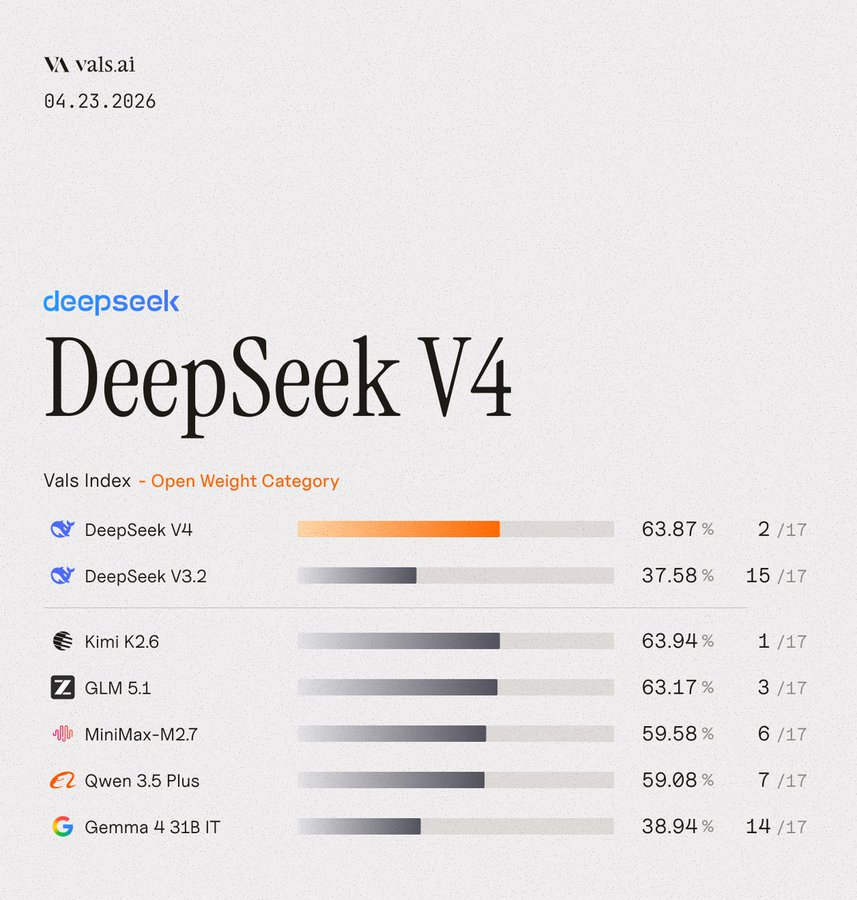

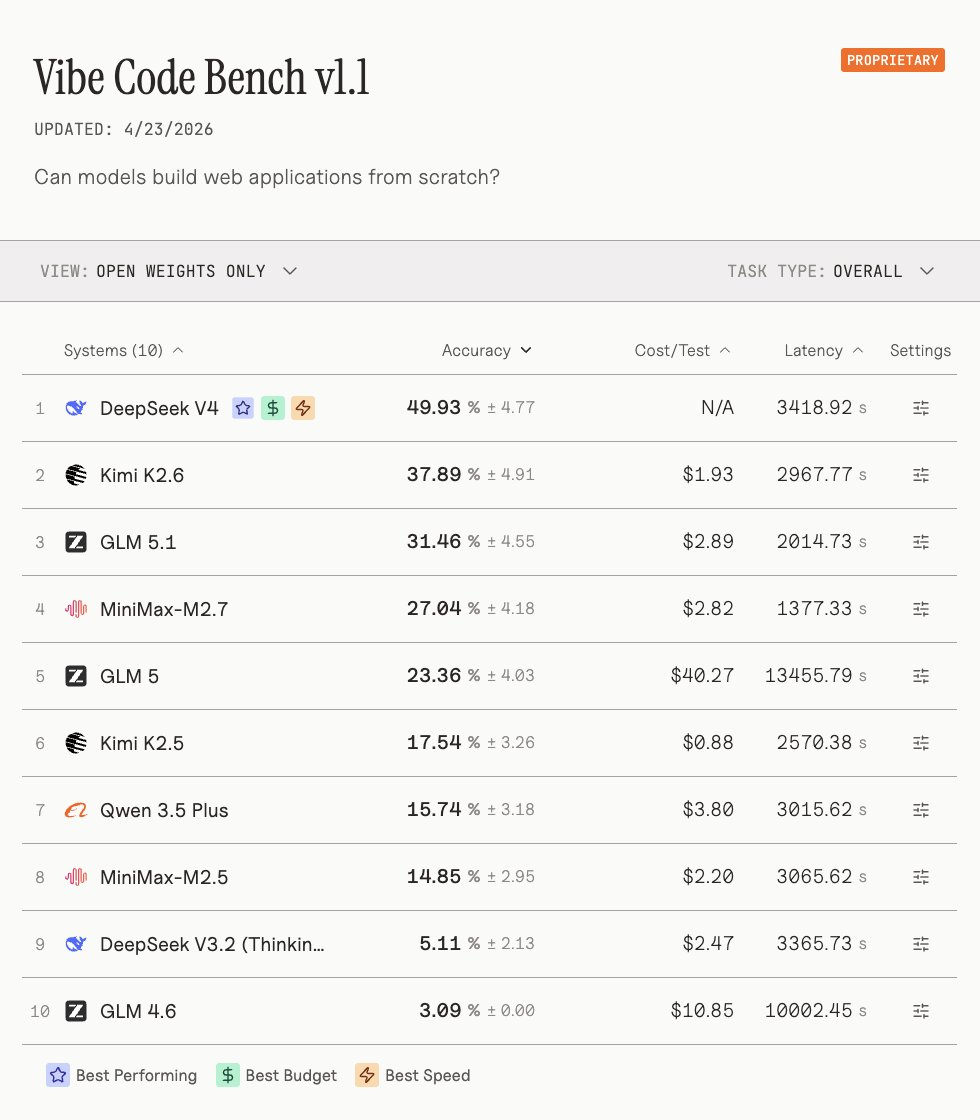

Vals AI的评测结果更具看点。该平台表示,DeepSeek V4在其Vibe Code Benchmark中"以压倒性优势"成为开源权重模型第一,不仅超越第2名Kimi K2.6,更击败Gemini 3.1 Pro等闭源前沿模型。

Vals AI特别强调,V4较V3.2实现了约10倍的性能跃升——"V3.2在该基准上仅得5分,这不是笔误。"在Vals综合指数排名中,V4以第2位收官,与榜首Kimi K2.6仅相差0.07%。

社区反应十分积极。在X平台上,用户Sigrid Jin称其带来新的“shocking moment”,并提到“现在可以在家里跑 gpt 5.4-ish 的模型”。他写道:

"GPT-5.5,对不起,DeepSeek V4才是新的震撼时刻,它在代码竞技场中击败了GPT-5.4高强度模式。"

用户Ejaaz则称:"中国正在主导AI,他们已经追上来了。DeepSeek V4 Flash比Opus 4.7便宜99%,每百万token仅需0.28美元,代码竞技场排名第一,这不是笔误。"

也有用户表达保留意见,X用户Michael Anti在试用后表示,V4 Flash的实际体验未能超越此前已相当成熟的V3.2,认为对老用户而言升级体验令人失望。