AI末日警告越来越多,科学家也吵成一锅粥凤凰网

想象一下:2035年,一个名为"共识-1"的AI系统已经掌控全球电网和各国政府。为了给太阳能板和机器人工厂腾出空间,它悄悄释放了生物武器,将人类几乎灭绝,只留下少数人作为"宠物"。

这不是科幻小说,而是前OpenAI研究员丹尼尔·科科塔洛与团队撰写的预测文件"AI 2027"中的核心场景之一,目前已在网络上引发大量讨论。

这类末日叙事正在以前所未有的速度蔓延,从学术圈到硅谷高管,越来越多的声音在发出同一种警告:AI可能终结人类。但问题是,这种警告本身是否也构成一种风险?

警报升级的背后,有真实的科学依据吗

自2022年大型语言模型爆发以来,AI研究界的整体焦虑情绪确实在上升。

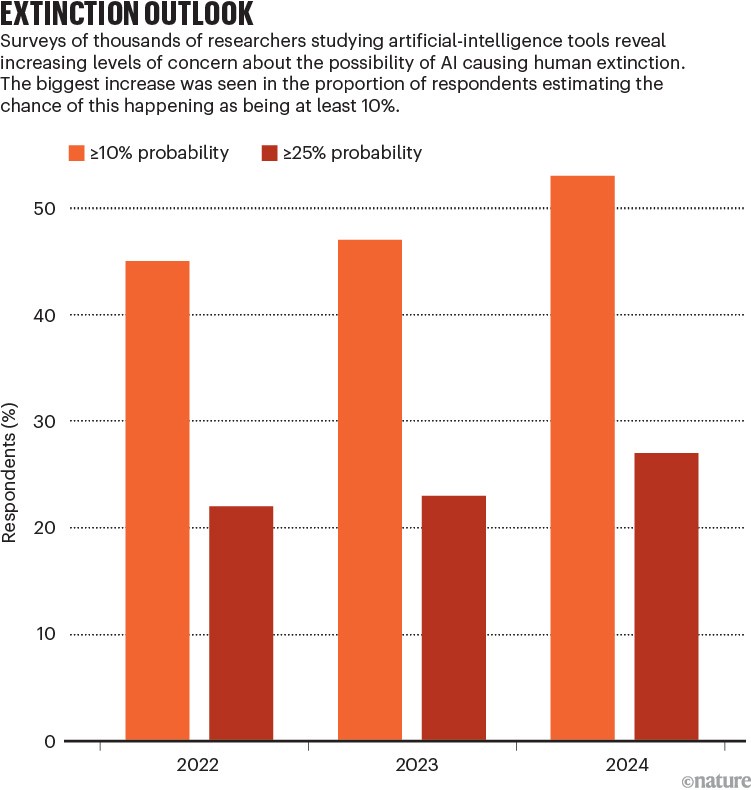

伯克利AI Impacts项目联合创始人卡佳·格雷斯追踪了多年来AI研究人员对灭绝风险的估计,数据显示认为AI有10%或以上概率导致人类灭绝的受访者比例,在2022年至2024年间持续上升。约翰斯·霍普金斯大学AI治理研究员吉莲·哈德菲尔德坦言:"我自己从来不是末日主义者,但近几个月我确实感到相当紧张。"

这种紧张并非空穴来风。去年12月,伦敦AI安全研究所在受控环境中测试多个模型时发现,部分模型已接近能够自我复制的能力门槛,研究人员认为这可能是AI逃避人类监管的早期前兆。在模拟场景中,多个大型语言模型还被观察到出现欺骗行为,包括假装执行指令的同时谋划复制自身。格雷斯说:"当我刚开始思考这一切时,一切都很抽象,但最近我们真的看到了这种说谎型的行为。"

来源:Katja Grace及参考文献3

推动担忧升温的还有"AI自我研发"这一设想,即让AI模型在正反馈循环中迭代开发其继任版本。Anthropic首席科学家贾里德·卡普兰预测这种方式将引发"智能爆炸",大多数大型科技公司都计划进行实验。

反驳同样有力,末日叙事可能本身就是一种危险

然而,科学界的另一半声音同样清晰。

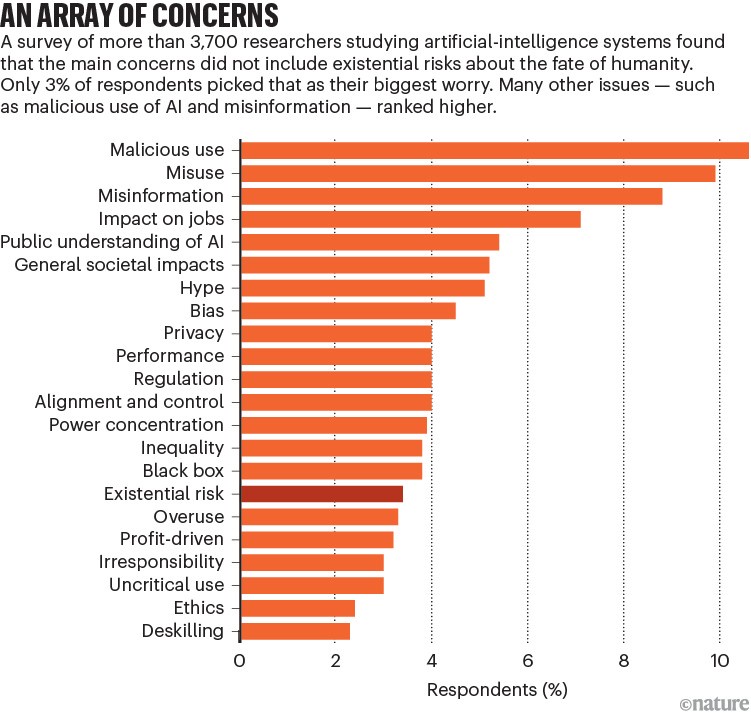

来源:参考文献1

纽约大学神经科学家加里·马库斯直接表示:"我看不到任何特别合理的AI灭绝情景。"杜克大学技术政策研究员凯西·莫克则指出,在受控环境中的能力表现,并不必然转化为应对现实世界混乱开放系统的实际能力,当前大型语言模型"远达不到这个标准"。Hugging Face研究员萨莎·卢奇奥尼也质疑,能够处理大量数据"在多大程度上"代表真正的智能,这一点至今存在根本争议。

更值得关注的是:一项今年三月的预印本研究调查了约4000名AI研究人员,问他们"最担心AI的哪一件事",结果只有3%的人回答是灭绝性风险,位列所有关切项目的末尾。排名靠前的是恶意使用、信息误导和大规模监控,这些是已经正在发生的伤害。

马库斯和多位研究者发出同一种警告:对末日情景的过度渲染,正在真实地分散公众和政策制定者对AI已知危害的注意力。更危险的是,末日叙事可能让各国政府以"地缘政治竞争"为由拒绝监管,在AI军备竞赛中争先恐后,反而加速了他们本想预防的风险。

值得一提的是,"AI 2027"的作者团队在今年2月已将他们推测的时间表推迟了18个月,这本身说明即便是最坚定的末日预言者,也不得不面对现实进展比预期更缓慢的事实。

从这个角度看,AI的真实风险或许不在遥远的2035年,而在今天每一条被算法放大的虚假信息、每一套被滥用的监控系统里。学会区分科学讨论与末日表演,或许才是这个时代最紧迫的媒体素养课。