谷歌AI起大早赶晚集?智东西

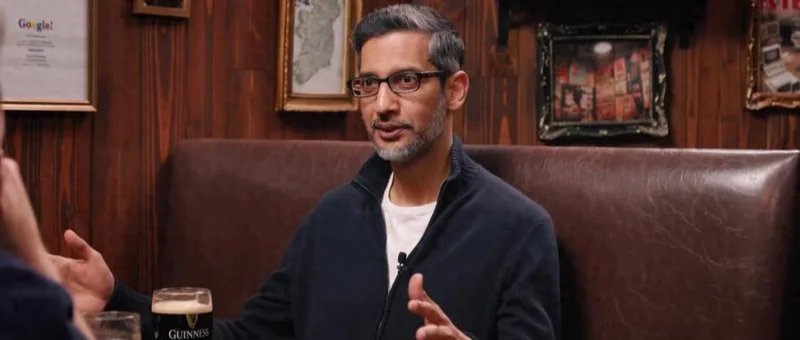

4月7日,金融科技公司Stripe发布了其对谷歌CEO桑达尔·皮查伊(Sundar Pichai)长达一个多小时的采访视频。在这期播客中,Pichai正面回应了业界关于谷歌在AI领域“起大早,赶晚集”的调侃,称谷歌早在多年前就已构想出类似ChatGPT的产品,并推动了基于Transformer架构的产品化落地原型——LaMDA,但因其“有害内容含量高”而最终未发布。

Pichai还认为,OpenAI推出ChatGPT时前景并不明朗,只是OpenAI比较幸运,通过GitHub找到了AI编程这一落地的突破口。

聊到中国时他忍不住感慨:“中国的(基建等)建设速度之快令人惊叹。”他还特别提到,中国现在的开源模型做得非常出色,而谷歌刚发布的Gemma 4,算是除了中国开源模型之外,另一款很能打的优秀开源模型。

在运营层面,Pichai揭示了当前谷歌面临的全新管理挑战,他每周会花1小时时间亲自分配TPU。他称,目前谷歌受晶圆产能、内存和电力的供应限制,还甚至说道:“我们连足够的电工都找不到。”

在这些制约因素中,Pichai认为内存是最关键的组件。由于头部内存厂商很难大幅扩产,短期内内存供应瓶颈仍会存在。但这也会推动技术创新,谷歌计划把内存的使用效率提升30倍。

采访中还谈到了未来搜索形态的变化趋势,Pichai称:“未来的搜索会成为智能体管理器。”

2015年,Pichai正式出任谷歌CEO,至今已十年有余。在这期播客中,Pichai还提到除已披露的太空数据中心与量子计算外,其旗下Wing无人机配送正快速扩围,不久将覆盖4000万美国人。同时,他坦言AI正深刻重构谷歌内部工作流,以Antigravity(Jet Ski)为代表的智能体管理工具已在核心团队全面推广,谷歌第一个完全由智能体完成的内部业务预测会在2027年出现。以下是这期播客的核心内容:

1、智能体的拐点:Pichai预测2027年智能体将迎来拐点。AI将全自动完成谷歌的业务预测,深度改造财务、运营等非技术流程。

2、早已有ChatGPT构想:谷歌的LaMDA模型是ChatGPT早期原型,谷歌因安全与质量标准未达标迟于ChatGPT推出。

3、算力资源的分配:Pichai每周会花1小时时间亲自分配TPU,并统筹内部业务与谷歌云客户的算力供给。

4、传统搜索将进化:传统搜索形态未来或将淡出,因为设备形态本身就会发生改变。而未来搜索将成为智能体管理器,而AI将接替传统搜索功能,在后台异步处理用户复杂需求。

5、否认对AGI态度冷淡:谷歌从创始团队起就深度布局AGI,包括谷歌DeepMind CEO戴密斯・哈萨比斯、谷歌首席科学家杰夫・迪恩,以及前Google Brain核心成员伊利亚・苏茨克韦尔、达里奥・阿莫代伊等人,都深度参与过AGI相关的研究。

6、发展瓶颈:谷歌在晶圆、内存、电力与审批效率面临发展瓶颈,其中电力能源问题相对好解决,真正拖慢项目进度的,往往是审批和监管环节。

7、隐藏王牌:谷歌持续押注太空数据中心、量子计算、Gemini机器人以及Wing无人机,同时同步推进Isomorphic AI制药。

8、转型痛点:年轻公司凭借“AI原生”的组织架构在转型中具备天然优势,而大公司虽然技术架构完整,但需要在组织层面进行大量再培训、流程重构和变革管理,转型相对吃力。

9、看好机器人项目:Pichai称现在Gemini机器人模型在空间推理等方面已经达到业界顶尖水平,谷歌正重新与Boston Dynamics(曾被谷歌收购后又被其出售)以及Agile等公司展开合作,推进相关技术落地。同时在扩大其旗下Wing公司的无人机配送项目规模。

10、谷歌搜索:谷歌搜索能大幅领先同行,其部分关键点突破得益于(谷歌推出的为深度理解语言与上下文,并直接应用于谷歌搜索,大幅提升复杂查询的准确率的模型)BERT和MUM模型。

一、关于Transformer与ChatGPT的“先发后至”

John Collison:人们谈及谷歌与AI时,经常提及的一段往事是:Transformer架构诞生于谷歌,却主要被ChatGPT这类外部产品率先落地使用。你现在如何看待这件事?

Sundar Pichai:我觉得这件事值得好好聊聊,其实外界对于这件事本身存在一些误解。

Transformer架构的研发工作,是在大规模使用TPU的背景下开展的。从某种意义上讲,Transformer从一开始就是为了解决具体的产品实际需求而被设计出来的。当时团队正在思考怎么优化翻译效果。

至于TPU,我们面临的问题是:语音识别功能确实有效,但突然要把它卖给20亿用户,芯片算力根本不够,该如何解决推理算力问题——(被主持人打断)

John Collison:这点我之前确实不知道。Transformer特指?

Sundar Pichai:Transformer出自我们的研发团队,但团队的研发方向始终围绕解决产品问题。Transformer问世后立刻就被投入使用。

很多人低估了BERT和MUM模型的价值,因为我们对搜索质量的把控极为严苛。那段时间,谷歌搜索之所以能大幅领先同行,部分关键突破正是得益于BERT和MUM。

我们研发出Transformer后,立刻将它应用于搜索,提升语言理解能力,让系统更好地解析网页内容、理解用户查询,并持续迭代优化模型。

我们内部也在推进产品化落地,当时有团队在研发一个名为LaMDA的模型。显然,我们并不是第一个推出这类产品的公司。但我认为,这并不是因为我们只停留在研究层面、没有朝着产品方向去落地应用。在我看来,实际情况其实是——(被主持人打断)

John Collison:你做了这项研究,然后你发现按照你的预期使用它能带来巨大的的投资回报率。只是并非所有基于这项技术诞生的产品,都是由你们自己创造出来的,不过这也很正常。

Sundar Pichai:ChatGPT这类产品的构想,我们其实早就有了,原型就是LaMDA。大家如果还记得的话,当时谷歌内部有一名工程师认为LaMDA具备了自我意识。他当时在内部所对话的这个系统,本质上就是ChatGPT的早期版本。我们甚至已经在其他项目组里,做出了它的产品化版本,只是谷歌大概晚了九个月才对外推出。

事实上,在2022年的谷歌I/O开发者大会上,我们发布了AI Test Kitchen,其核心就是LaMDA,但我们对它做了限制,因为当时内部还没有推出经过RLHF(基于人类反馈的强化学习)优化的端到端版本。我看到的未优化版本,有害内容含量很高,当时根本不可能对外发布。

此外,作为一家始终把搜索质量放在核心位置的公司,我们对产品上线的质量标准要求更为严格。但这并不代表我们没有采取行动,当时我们一直在研究如何以稳妥的方式将它推出。

我还想说,即便OpenAI发布ChatGPT时,他们也是在几个月前才与微软达成合作。回头看,当时的发展前景也并非完全明朗。我认为他们很幸运,因为他们还通过GitHub在编程领域找到了技术落地的突破口。我想我们当时或许错过了某个信号。

在编程领域,模型迭代带来的提升可能比纯语言领域更显著。从GPT-2到GPT-3再到后续的GPT-4,如果将它们用于编程任务,进步幅度会显得尤为突出,这些关键都有据可查。

回到你最初的问题,与其说关键在于研发到产品的过程本身,不如说是其它多重因素共同作用的结果。

Elad Gil:我记得和参与过ChatGPT研发的人聊过,他们是在感恩节那周发布(ChatGPT)的,当时只是一次低调发布,并不像是声势浩大地宣布重磅产品,它也没被视作未来地核心业务。它的爆火显然更像个意外。

Sundar Pichai:在我看来,它当时更像是一个很有意思的测试案例,效果确实很惊艳。

我对这类事件的理解是:在消费互联网领域,意外总会发生。我和Elad Gil早年在谷歌时,公司有个产品叫谷歌视频搜索(Google Video)。后来YouTube出现了,我们最终收购了YouTube。再比如如果你在Facebook,后来Instagram出现了,没人会在当时就觉得大惊小怪,毕竟Facebook后面直接收购了Instagram。

但我始终认为,消费互联网的逻辑就是:两三个人的小团队不断做原型、试错,抛出无数创意。我并不是想贬低什么,只是想说,总会遇到这样的时刻。没人能在车库里灵光一闪,就做出一款比iPhone更好的手机,这不现实,但消费互联网本并非如此。所以我们只需意识到这一点,坦然接受即可。

二、谷歌的速度战略与搜索的未来

John Collison:说到2026年的AI竞赛,我有一点让我印象深刻,那就是谷歌长期以来都把速度作为核心差异化优势。初代谷歌搜索速度极快,甚至还会在结果页显示查询耗时,多少带点炫技的意味。后来的Gmail快速搜索、Chrome浏览器,对比同期竞品都具备速度优势。

如今,我会因不同需求使用不同的AI服务,但基于TPU运行的Gemini就是快得出奇。我很好奇,这是明确的产品战略,还是有更复杂的考量?

Sundar Pichai:我一直都很注重速度,为了便于理解我暂且把它称为“延迟”,并且把延迟视作优秀产品的核心特征之一。同时,低延迟也往往意味着产品的底层技术架构足够优秀。还有一种速度同样重要,那就是产品发布、迭代和更新周期的速度。这两者都至关重要。

但单说延迟,嘴上说追求低延迟很容易,可产品功能一直在持续升级,技术边界不断拓展,如何在功能与延迟之间找到平衡,这才是难点。

举个例子,比如搜索功能。我和团队沟通时了解到,他们会为子团队设置毫秒级延迟预算。如果上线一项优化能减少3毫秒延迟,就能获得1.5毫秒的延迟预算奖励,另外的1.5毫秒会直接转化为用户可感知的速度提升。

根据不同团队的业务场景,有的团队延迟预算可能是30毫秒,有的则是10毫秒。团队可以使用这部分预算,但必须接受严格的审核把关。这也足以体现我们对延迟的重视程度。

Elad Gil:人类能感知到的延迟大概是几百毫秒级别,对吗?是这个阈值影响体验吗?

Sundar Pichai:没错。据我最新查看的数据面板,过去五年里,我们把搜索延迟降低了30%,与此同时产品功能还在持续升级。

这也是我们打造Gemini的核心思路,即在前沿性能与速度之间找到平衡。Flash系列模型能达到Pro版本90%的能力,但它的运行速度更快、服务效率更高,垂直整合的技术架构也为此提供了支撑。

Elad Gil:你如何看待搜索的未来?如今很多人都在讨论,对话交互会成为新的信息获取方式。显然,Gemini已经融入了谷歌搜索,AI生成的结果也成为搜索的一部分。但不少人还在进一步谈论智能体工作流(agentic flows)。

例如未来每个人都会拥有专属的个人智能体,无需手动输入查询,它会直接替你完成任务。比如你不用再搜索旅行攻略,它会直接为你规划好一整趟行程。你认为搜索的未来究竟是什么?它只是一种流量分发渠道,还是会进化成一款全新的未来产品?

Sundar Pichai:在我看来,搜索业务每经历一次变革,就能承载更多功能。我们必须吸纳这些新能力,持续拓展产品的边界。

比如移动互联网时代,产品迭代速度就非常快。当人们走出纽约地铁,想要的不是网页信息,而是找到目的地,这时候搜索服务就要跟着该变。用户的期待在不断变化,产品也要随之跟进。

放眼未来,现在很多单纯以获取信息为目的的查询,在之后的搜索中都会变成由智能体主动代劳。系统不再只是给出答案,而是会直接帮用户完成任务,同时处理多项事务。

Elad Gil:十年后搜索还会存在吗?还是会进化成全新形态?

Sundar Pichai:它会持续进化。未来的搜索会成为智能体管理器,帮用户完成各类任务。某种程度上,我现在使用的Antigravity,就是多个智能体协同工作的形态。我能预见搜索会实现类似功能,从而帮用户高效处理事务。

John Collison:(对Elad Gil)我理解的你的问题的核心在于,如果我们把“搜索”定义为:输入不超过一行的提示词,接着它给出一堆网页的查询结果,而不是直接给出正确答案或解决方案。像这种传统(搜索)产品形态未来还会存在吗?

Sundar Pichai:如今谷歌搜索的AI模式下,用户会输入深度研究类查询,这已经超出了你说的传统定义,但用户已经适应了这种变化。我认为未来人们还会发起需要持续一段时间的复杂任务,这些任务完全可以在后台异步完成,不用用户一直盯着等结果。

Elad Gil:这就像生命从单细胞生物演化成复杂生命体,同理,搜索的旧范式是否会彻底消失?说到底,今天的传统搜索终将进化为智能体,未来的交互界面也将以智能体为核心,十年后,搜索框或许将不再是主流形态。

Sundar Pichai:毕竟设备形态本身会发生改变,I/O大会的展示内容也会彻底革新。纠结十年后会发生什么容易让人陷入内耗,但我们很幸运,当下技术迭代速度极快,聚焦未来一年的规划就足够令人兴奋。

如果是在过去,我们可能需要展望五年后的愿景,而如今,模型一年后的形态就会变得截然不同。能紧跟这条技术曲线本身就已经很激动人心了。

搜索会持续进化,当下正是行业扩张期。很多人低估了一点,但在我看来AI领域绝非零和博弈。人类未来能创造的价值正呈指数级增长。想通这一点后,外界的诸多质疑都会不攻自破。TikTok崛起后YouTube依然发展得很好,Instagram出现后Facebook也没有衰落,类似案例比比皆是。

如果把行业视作零和博弈,发展前景会显得艰难。但只要我们坚持创新、推动产品进化,就总能抓住新的增长机会。

我们现在同时做搜索和Gemini,两者在某些方面会重叠,在某些方面又会彻底走向不同方向。我觉得两条线并行、坦然接受这种共存,反而是件好事。